И уже скоро. Стартап Fathom Computing в ближайшие два года планирует выпустить оптическое устройство, которое обойдет GPU по скорости тренировки крупных нейронных сетей. Разработчики хотят разместить оптический компьютер в облачном дата-центре, чтобы к нему могли получить доступ создатели систем искусственного интеллекта со всего мира.

О решении Fathom и о том, кто еще занимается такими разработками, расскажем под катом.

/ фото European Space Agency CC

Вычисления с GPU-ускорением реализовали в компании Nvidia около десяти лет назад. Теперь технология применяется в дата-центрах научных лабораторий, ИТ-компаний и IaaS-провайдеров, предоставляющих работу с vGPU, для реализации высокопроизводительных вычислений.

Однако рынок становится все более требовательным к скорости обработки больших объемов данных — порядка 90% всей информации было сгенерировано за прошедшие 2–3 года — по данным IBM, человечество генерирует 2,5 квинтиллиона байт в день.

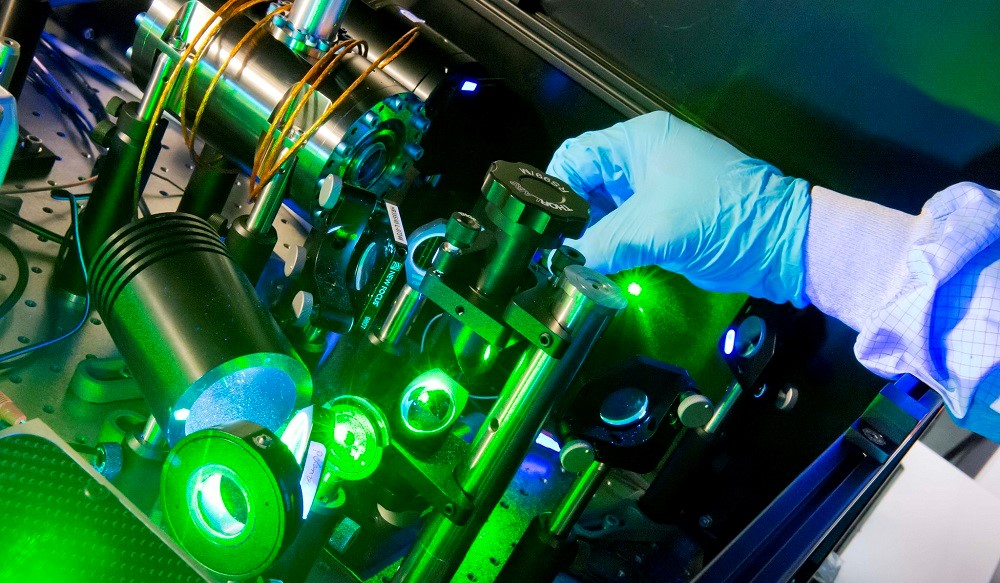

Основатели Fathom Computing убеждены, что оптические компьютеры помогут быстрее адаптироваться к изменяющимся требованиям к работе с данными. Прототип, созданный в компании, выполняет математические операции быстрее, так как закодированные значения передаются посредством световых лучей — последовательность линз и оптических элементов (например, интерферометров) меняет параметры света, на основании чего система генерирует результат.

Журналисты Wired описали внешний вид устройства, как «кучу линз, кронштейнов и проводов, напоминающих разобранный телескоп». Сейчас все эти компоненты помещены в большой черный ящик, однако ученые работают над тем, чтобы «упаковать» все это в стандартный сервер, который поместится в стойку дата-центра.

Компьютер Fathom не является универсальным процессором, он «заточен» под выполнение определённых операций линейной алгебры. В частности, Fathom используется для обучения рекуррентных нейронных сетей с архитектурой LSTM и нейронных сетей прямого распространения.

Сейчас команда тестирует компьютер, обучая его распознавать рукописные цифры. Пока что системе удалось добиться точности распознавания в 90%. На сайте проекта разработчики привели визуализацию потока данных LSTM, который генерирует их система управления.

В Fathom Computing отмечают, что планируют создать первую production-ready систему, которая превзойдет компьютеры с GPU по скорости тренировки сетей, в ближайшие два года.

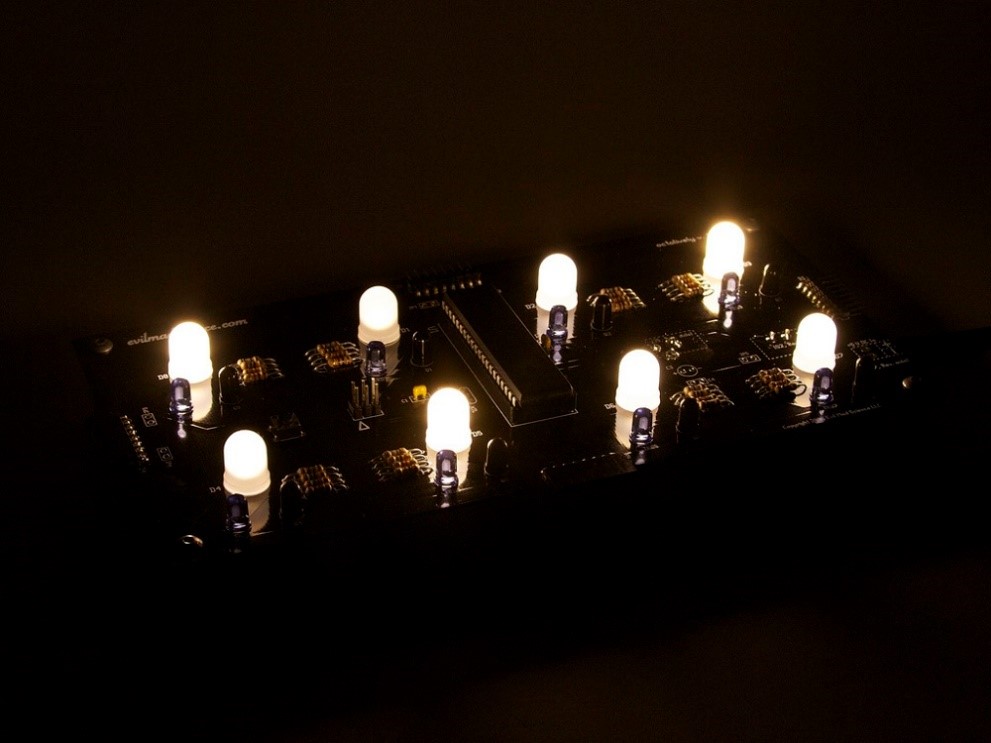

/ фото Windell Oskay CC

Компания Fathom не единственная, которая занимается созданием оптических чипов для ускорения глубокого обучения. Свою работу в этой области проводит Массачусетский технологический институт (MIT).

Ученые из MIT разработали чип, который они называют «программируемым нанофотонным процессором». Он выполняет матричные операции, используя набор волноводов, связи между которыми подстраиваются в зависимости от задачи. Чип построен на базе интерферометра Маха — Цендера, который изменяет свойства проходящих лучей и является эквивалентом матричного умножения, и ряда аттенюаторов, слегка снижающих световую интенсивность. Эти процессы обеспечивают обучение оптической нейронной сети.

Над созданием кремниевого фотоэлектронного процессора для рынка систем AI также работает стартап Lightmatter. Разработчики используют технологию MIT. Тест прототипа из 56 программируемых интерферометров Маха — Цендера, реализованных на интегральной схеме прошел прошлым летом.

Система училась распознавать гласные звуки на наборе аудиозаписей. В ходе эксперимента удалось добиться точности распознавания в 75%. Системы на базе «классического» железа достигают порога в 90%, поэтому ученые продолжат развивать и улучшать архитектуру чипа.

Еще один стартап LightOn в середине февраля объявил о начале тестирования прототипа оптического модуля Optical Processing Unit (OPU) в дата-центре. В компании отметили, что им удалось сократить время, необходимое для выполнения задачи Transfer Learning с 20 минут на классических GPU до 3,5 минут.

Открытое бета-тестирование установки начнется весной на облачной платформе LightOn Cloud. Сейчас система работает с PyTorch и совместима с Scikit-Learn. В будущем будет добавлена поддержка других популярных ML-фреймворков, например TensorFlow.

P.S. Еще несколько свежих постов из Первого блога о корпоративном IaaS:

О решении Fathom и о том, кто еще занимается такими разработками, расскажем под катом.

/ фото European Space Agency CC

Вычисления с GPU-ускорением реализовали в компании Nvidia около десяти лет назад. Теперь технология применяется в дата-центрах научных лабораторий, ИТ-компаний и IaaS-провайдеров, предоставляющих работу с vGPU, для реализации высокопроизводительных вычислений.

Однако рынок становится все более требовательным к скорости обработки больших объемов данных — порядка 90% всей информации было сгенерировано за прошедшие 2–3 года — по данным IBM, человечество генерирует 2,5 квинтиллиона байт в день.

Основатели Fathom Computing убеждены, что оптические компьютеры помогут быстрее адаптироваться к изменяющимся требованиям к работе с данными. Прототип, созданный в компании, выполняет математические операции быстрее, так как закодированные значения передаются посредством световых лучей — последовательность линз и оптических элементов (например, интерферометров) меняет параметры света, на основании чего система генерирует результат.

Журналисты Wired описали внешний вид устройства, как «кучу линз, кронштейнов и проводов, напоминающих разобранный телескоп». Сейчас все эти компоненты помещены в большой черный ящик, однако ученые работают над тем, чтобы «упаковать» все это в стандартный сервер, который поместится в стойку дата-центра.

Компьютер Fathom не является универсальным процессором, он «заточен» под выполнение определённых операций линейной алгебры. В частности, Fathom используется для обучения рекуррентных нейронных сетей с архитектурой LSTM и нейронных сетей прямого распространения.

Сейчас команда тестирует компьютер, обучая его распознавать рукописные цифры. Пока что системе удалось добиться точности распознавания в 90%. На сайте проекта разработчики привели визуализацию потока данных LSTM, который генерирует их система управления.

В Fathom Computing отмечают, что планируют создать первую production-ready систему, которая превзойдет компьютеры с GPU по скорости тренировки сетей, в ближайшие два года.

/ фото Windell Oskay CC

Другие разработки

Компания Fathom не единственная, которая занимается созданием оптических чипов для ускорения глубокого обучения. Свою работу в этой области проводит Массачусетский технологический институт (MIT).

Ученые из MIT разработали чип, который они называют «программируемым нанофотонным процессором». Он выполняет матричные операции, используя набор волноводов, связи между которыми подстраиваются в зависимости от задачи. Чип построен на базе интерферометра Маха — Цендера, который изменяет свойства проходящих лучей и является эквивалентом матричного умножения, и ряда аттенюаторов, слегка снижающих световую интенсивность. Эти процессы обеспечивают обучение оптической нейронной сети.

Над созданием кремниевого фотоэлектронного процессора для рынка систем AI также работает стартап Lightmatter. Разработчики используют технологию MIT. Тест прототипа из 56 программируемых интерферометров Маха — Цендера, реализованных на интегральной схеме прошел прошлым летом.

Система училась распознавать гласные звуки на наборе аудиозаписей. В ходе эксперимента удалось добиться точности распознавания в 75%. Системы на базе «классического» железа достигают порога в 90%, поэтому ученые продолжат развивать и улучшать архитектуру чипа.

Еще один стартап LightOn в середине февраля объявил о начале тестирования прототипа оптического модуля Optical Processing Unit (OPU) в дата-центре. В компании отметили, что им удалось сократить время, необходимое для выполнения задачи Transfer Learning с 20 минут на классических GPU до 3,5 минут.

Открытое бета-тестирование установки начнется весной на облачной платформе LightOn Cloud. Сейчас система работает с PyTorch и совместима с Scikit-Learn. В будущем будет добавлена поддержка других популярных ML-фреймворков, например TensorFlow.

P.S. Еще несколько свежих постов из Первого блога о корпоративном IaaS:

- NetApp от А до Я: обзор технологий вендора, используемых в современных СХД

- Организация блокчейн на VMware vSphere: от теории к практике

- IaaS: Первые шаги после аренды облачной инфраструктуры

- Системы хранения данных NetApp в 2017 году: обзор продуктов компании

- Балансировка нагрузки в облаке IaaS: как работает DRS