Это обзор систем построения отчетов. Какие бывают, зачем они нужны и куда все это движется. В рассмотренных далее системах речь пойдет только об отчетах. А отчет – это выборка данных из источника по заданным критериям. Другой функционал данных систем не будет рассматриваться. Со всеми системами отчетности о которых пойдет речь, я либо работал напрямую, либо они использовались в проектах, в которых я участвовал.

Представьте себе ваши данные перед тем, как вы их соберете

Перевод подготовлен для студентов курса «Прикладная аналитика на R».

Нам, как исследователям данных (data scientist), часто дают набор данных и просят использовать его для получения информации. Мы используем R для обработки, визуализации, моделирования, подготовки таблиц и графиков, чтобы поделиться результатами или опубликовать их. Если мы смотрим на данные таким образом, то нам не важно откуда эти данные пришли. Размер выборки, набор признаков и их шкалы фиксированы. Тем не менее, процедуры, используемые для сбора или генерирования данных, чрезвычайно важны для будущего анализа, а также для качества информации, которую мы, в конечном итоге, можем получить. Процесс сбора данных влияет на то, как следует анализировать полученные данные. Для исследований, которые измеряют причинно-следственные связи, важно какие данные следует брать во внимание, а какие нет.

Python or R: Which Is A Better Choice For Data Science?

Data science is going to revolutionize this world completely in the coming years. The tough question among data scientists is that which programming language plays the most important role in data science? There are many programming languages used in data science including R, C++, Python.

In this blog, we are going to discuss two important programming languages namely Python and R. This will help you choose the best-fit language for your next data science project.

Python is an open-source, flexible, object-oriented and easy-to-use programming language. It has a large community base and consists of a rich set of libraries & tools. It is, in fact, the first choice of every data scientist.

Обработка русских текстовых данных в Azure Machine Learning

Анонс! Приглашаем принять участие в хакатоне по технологиям Машинного Обучения

Машинное обучение сегодня набирает все большую популярность. Его возможности обеспечивают работу решений по улучшению сервиса для клиентов, предсказанию и предотвращению сбоев оборудования, повышению операционной эффективности, предотвращению мошенничества. Ранее для бизнес-прогнозирования компании могли использовать исключительно внутренние on-premise решения, из-за чего на аналитические процессы уходили недели или даже месяцы. Это требовало привлечения труда квалифицированных сотрудников и больших денежных затрат. Кроме того, языки программирования для статистических вычислений до сих пор были недостаточно хорошо изучены и распространены, из-за чего машинное обучение оставалось недоступным для очень многих компаний.

Сделать технологии машинного обучения доступным большому количеству пользователей стало возможным благодаря запуску нового сервиса Azure Machine Learning, который позволяет в считанные часы создавать модели, определяющие вероятность того или иного события, используя данные, хранящиеся в SQL Server и других платформах, включая Microsoft Azure HDInsight, реализацию Hadoop.

Участвуйте в хакатоне и выиграйте Nokia Lumia 640 и Nokia Lumia 930!

Подробности и регистрация на https://events.techdays.ru/machine-learning/2016-05/

Приключения при настройке сервисов машинного обучения в MS SQL Server 2019

В статье описано, как настроить сервисы машинного обучения для R и Python. Несмотря на большой опыт в IT, сразу у меня не работает примерно ничего. Поэтому будут ссылки на то, что делать, если сразу не завелось. В итоге я поставила новый экземпляр с сервисами машинного обучения, которые, наконец! заработали.

RStudio, R Markdown, Latex и отчеты в PDF формате. Мой опыт

RStudio, R Markdown, Latex и отчеты в PDF формате. Мой опыт.

Сегодня я хочу рассказать о том, как я писал отчеты на R, с чем сталкивался и как решал проблемы, которые возникали по ходу разработки. Отчеты были в формате PDF и запускались из Python в Camunda.

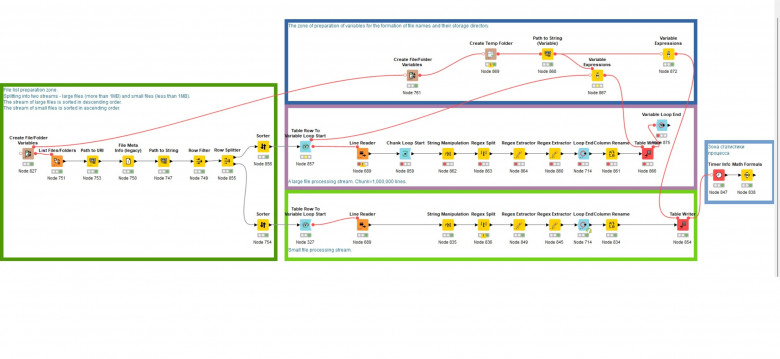

Производительность и стабильность Knime на слабых компьютерах

Наступают времена, когда офисному сотруднику недостаточно знать Word и Excel в качестве минимального обязательного базиса программных продуктов. No‑code/Low‑code платформы и продукты — вот что незаметно становится обязательным для владения каждым. Эти платформы есть самый быстрый на сегодня способ без изучения языков программирования овладеть навыками использования искусственного интеллекта, машинного обучения, анализа big data, причём очень бигдата — на сотни миллионов строк.

Платформа Knime — один из таких инструментов. На первый взгляд это улучшенный Excel+BI. Но, когда посмотришь поглубже его возможности, то, очевидно — это обязательный инструмент будущего, по крайней мере для тех кто не являясь программистом хочет получить навыки как у программиста. Для простоты — Knime это «графическое» программирование. Берёшь квадратики, размещаешь в виде бизнес‑процесса, соединяешь их между собой и оп! — уже провёл анализ маркетингового плана или парсинг сайтов конкурентов или анализ рекламных текстов с помощью NLP. Или, даже строишь приборную доску управления производственного предприятия будучи простым менеджером/инженером. Или ведёшь обработку научных данных.

Knime позволяет, конечно, и код писать, причём на трёх языках Python, Java, R, но это не обязательно. Бизнес‑процессы знаешь, рисуешь? Вперёд!

Разумеется, при работе с огромными массивами данных, требования к компьютерным ресурсам возрастают. И что делать, если вам доступен простенький офисный или домашний компьютер? Или, если вы видите что аренда облачного ресурса на месяц дороже, чем купить компьютер с 64Гб оперативной памяти и процессором гоняющим Atomic Heart или Hogwartz Legacy на среднемалках?