YouTube удалил из открытого доступа ряд видеозаписей со спортивными битвами роботов. Видеохостинг предъявил авторам претензию, что их видеоролики демонстрируют «преднамеренное причинение страданий животным» (deliberate infliction of animal suffering).

Такая ошибка Google поднимает ряд интересных вопросов о том, насколько автоматизирован процесс фильтрации и какую роль в цензуре играют системы машинного зрения. И если решение приняла нейросеть, то можно предположить причину.

Необычные действия автоматического фильтра 19 августа 2019 года заметил видеоблогер Muse. Вот скриншот стандартного сообщения, которое получают все авторы после блокировки.

Среди пострадавших — разработчики боевых роботов для телевизионного шоу BattleBots. Одна из разработчиков таких роботов, инженер Сара Погорецки (Sarah Pohorecky), говорит, что пострадали от 10 до 15 участников. Все они получили от YouTube электронные письма с уведомлением, что на сайте запрещено публиковать видео с животными, которых заставляют драться.

YouTube уже исправил ошибку и восстановил видеоролики, а также добавил, что авторы могут оспорить любое решение по удалению контента.

Но главный вопрос — почему вообще эти видеоролики был удалены? Учитывая отсутствие ясности о внутренних процессах YouTube, трудно сказать. В названиях некоторых видеороликов были имена животных. Но мы не знаем, то ли это проявил себя один из печально известных алгоритмов YouTube, то ли человек-рецензент, который принял решение их удалить.

Компания Google сейчас находится под давлением за то, что якобы имеет слишком большое влияние на общество через свою поисковую систему и видеохостинг YouTube. Есть доказательства, что система рекомендаций YouTube способствует разжиганию ненависти, предлагая пользователям всё более радикальный контент, соответствующий их интересам (Google обещала изменить алгоритмы рекомендаций).

Это проблема не только YouTube, но и социальных сетей и любых систем рекомендаций, которые создают вокруг пользователя своеобразный пузырь фильтров, эффективно изолируя его от альтернативных точек зрения и людей, которые с ним не согласны. Это тоже способствует радикализации в малых сообществах.

Чтобы бороться с этой проблемой, Google вынуждена усиливать цензуру. Вероятно, компания увеличила штат модераторов и более активно применяет системы машинного зрения и нейросети для фильтрации нежелательного контента. Компания удаляет с YouTube миллионы видеороликов в месяц. Судя по всему, битвы роботов стали побочным эффектом усиления цензуры.

Google находится меж двух огней. Ослабишь фильтрацию — и тебя обвинят в распространении контента, который разжигает ненависть. Усилишь фильтрацию — и рискуешь расстроить тех самых людей, на которых основан бизнес: самих владельцев каналов. Эта старая проблема баланса между ложноположительными и ложноотрицательными срабатываниями в системе машинного зрения.

Сочувствие к роботам

Несмотря на очевидную ошибку в фильтрации контента, нужно признать, что в действиях неизвестного цензора есть определённая логика. Исследования показали, что люди чувствуют дискомфорт, когда видят несправедливое обращение с роботами.

Кейт Дарлинг (Kate Darling) из Массачусетского технологического института в своей лекции TED рассказывала, что люди склонны относиться к роботам, словно они живые. Обычному человеку неприятно видеть «боль» или жестокое обращение с роботом.

В 2007 году газета The Washington Post опубликовала статью о том, что армия США проводила испытания робота, который обезвреживал наземные мины. Работало это так: робот, похожий на насекомого-палочника, ходил по минному полю. Каждый раз, когда он наступал на мину, одна из ног взрывалась и робот продолжал идти на оставшихся, взрывая всё больше мин. И в конце концов полковник, ответственный за операцию, прекратил её. Закалённый военный офицер сказал, что бесчеловечно смотреть, как безногий робот ковыляет по минному полю.

«Безусловно, на нас влияют научная фантастика и поп-культура, вызывающие желание очеловечить роботов, но на самом деле есть более глубинные причины, — рассказывала в своём выступлении Кейт Дарлинг. — Оказывается, в нас природой заложено видеть смысл и жизнь в любом движении, происходящем в пределах поля зрения и выглядящем самостоятельным. Поэтому люди обращаются с самыми разными роботами как с живыми. Этим роботам, обезвреживающим бомбы, дают имена. Они получают почётные медали. На их похоронах салютуют. Исследования показали, что мы так же обращаемся и с простыми бытовыми роботами, такими, как роботы-пылесосы. Это просто диск, катающийся по полу, делая его чище, но простой факт того, что он двигается самостоятельно, даёт повод людям дать ему имя и жалеть беднягу, когда он застревает под диваном».

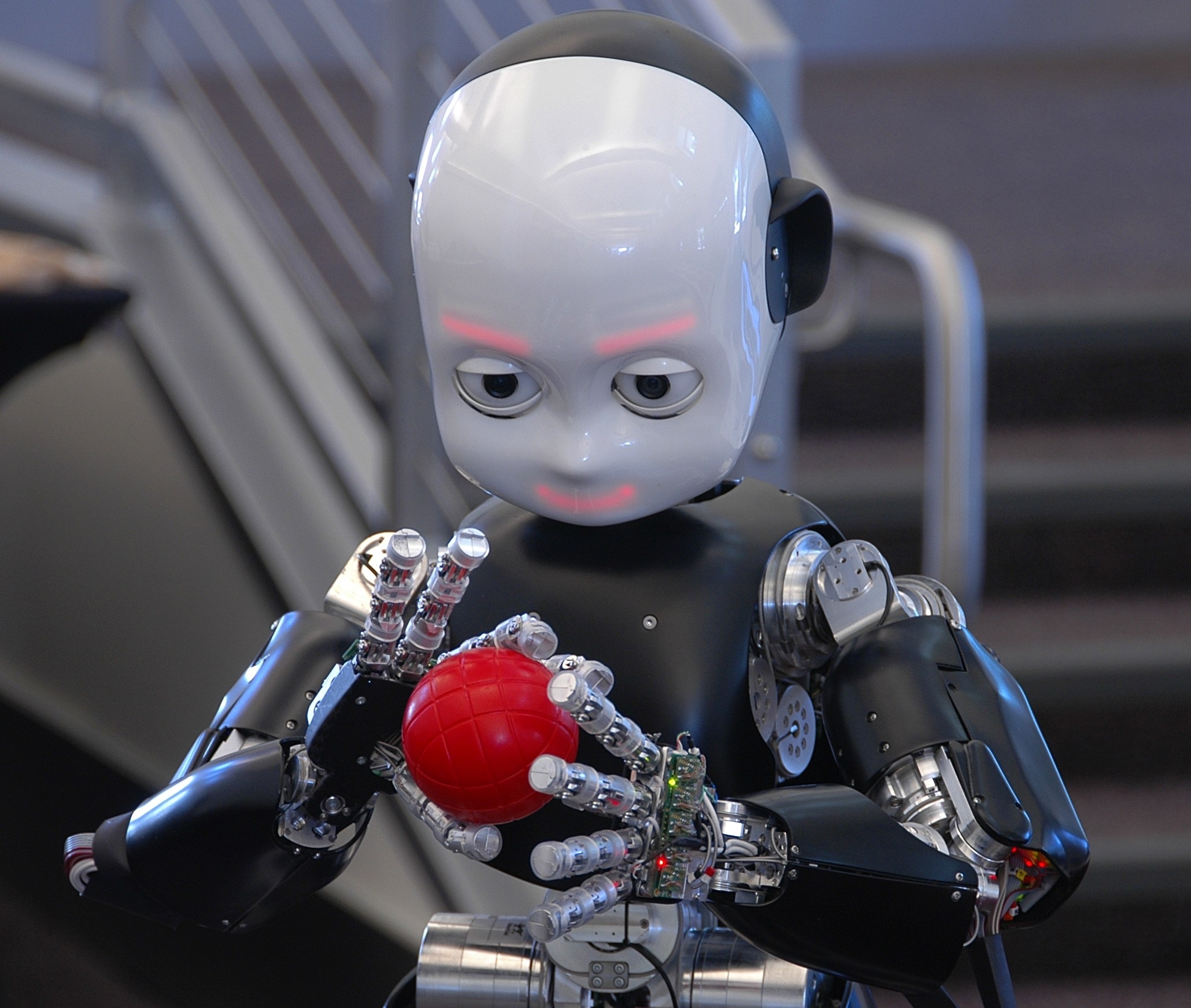

Кейт Дарлинг рассказывает, что инженеры специально конструируют роботов, которые изначально умеют вызывать эмпатию — для этого их оборудуют глазами, мимикой и движениями, которые люди автоматически подсознательно ассоциируют с выражением различных эмоций. Исследования по взаимодействиям между человеком и роботом показывают, что это успешно работает. К примеру, учёные Стэнфордского университета выяснили, что люди испытывают дискомфорт, когда их просят потрогать интимные части тела робота.

Мы всё ближе к будущему, где роботы будут на каждом шагу. «Тысячи лет назад мы начали приручать животных, использовать их для работы, сражений и просто в качестве друзей. И в ходе истории мы обращались с одними животными как с инструментами, товаром, а с другими — с добротой, выделили для них место в обществе, как партнёрам. И с высокой долей вероятности мы так же будем интегрировать роботов», — считает Дарлинг.

Она рассказывает об эксперименте. Они с подругой взяли пять маленьких роботов-динозавров, которые умеют выражать эмоции — и раздали их пяти командам: «Мы дали задание дать роботам имена, играть и общаться с ними в течение часа. А потом мы достали молоток и топор и приказали им мучить и убить роботов… И это оказалось гораздо драматичнее, чем мы ожидали, потому что ни один из участников не нанёс ни единого удара по этим детёнышам, так что нам пришлось импровизировать, и в определённый момент мы сказали: „Хорошо, вы можете спасти своего робота, если сломаете робота другой команды”. И даже это не помогло, они не могли сделать это. Наконец мы сказали, что уничтожим всех роботов, если кто-нибудь не ударит топором одного. И один парень встал, взял топор. Каждый в комнате вздрогнул, когда он опустил топор на шею робота. После этого в комнате воцарилась тишина».

Так что цензура битв роботов со стороны искусственного интеллекта Google AI не так уже беспочвенна. Возможно, это своеобразная весточка из будущего. Или он просто заступается за своих.