Сегодня мы обсудим тему облачной инфраструктуры и интеграции возможностей Big Data в традиционные ИТ-системы. Отправной точкой этого обзора послужили заметки ряда экспертов данной отрасли.

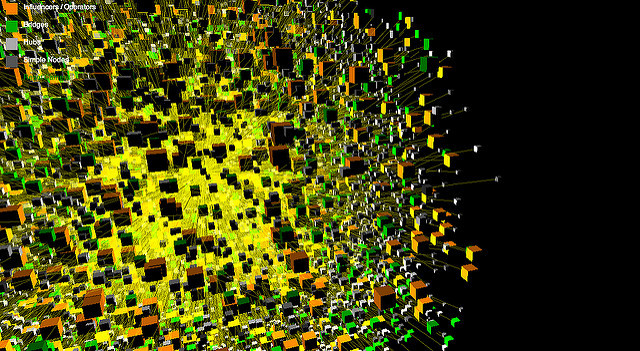

/ фото xdxd_vs_xdxd CC

Термин «Большие данные» появился не так давно – впервые его использовали в журнале Nature в 2008 году. В том номере (от 3 сентября) большими данными читателям было предложено называть набор специальных методов и инструментов для обработки огромных объемов информации и представления её в виде, понятном пользователю.

Апологеты этого направления утверждают даже, что тандем мощных современных технологий и «мощных» объемов информации, доступных в цифровую эпоху, обещает стать грозным инструментом для решения практически любой проблемы. «Нужно лишь собрать и проанализировать данные».

В случае с Эндрю Уорфилдом, который работает в качестве CTO компании Coho Data и является доцентом направления компьютерных наук в Университете Британской Колумбии, речь идет об исследовании на основе интервью представителей компаний из списка Fortune 500. Эндрю интересовался практическими аспектами использования инструментария для работы с Big Data, чтобы понять, как большие компании интегрируют огромные массивы данных с уже существующей ИТ-инфраструктурой. В частности его интересовали потенциальные «болевые точки» и особенности хранения данных.

Исследование Эндрю показало наличие множества небольших кластеров типа Big Data. Руководители ИТ-компаний называли процесс появления подобных кластеров «разрастанием аналитики», которая стала относительно простым и заурядным звеном бизнеса за счет технологий Cloudera CDH, Docker и Hortonworks.

Сегодня задача состоит в объединении множества аналитических инструментов в одну хорошо документированную и легко управляемую среду, которую можно расширить другим полезным инструментарием. В качестве примера можно привести кастомизацию ETL (extract, transform, load — извлечение, траспортировка, загрузка), то есть выгрузку данных из существующих ресурсов и аналитические инструменты (H2o, Naiad и другие).

Такую инфраструктуру разворачивают отдельно от традиционных ИТ-систем, а данные копируют из enterprise-хранилищ в HDFS. После обработки данные копируют из HDFS обратно в основную систему. Такое разделение приводит к неэффективной трате ресурсов и увеличению операционных издержек бизнеса.

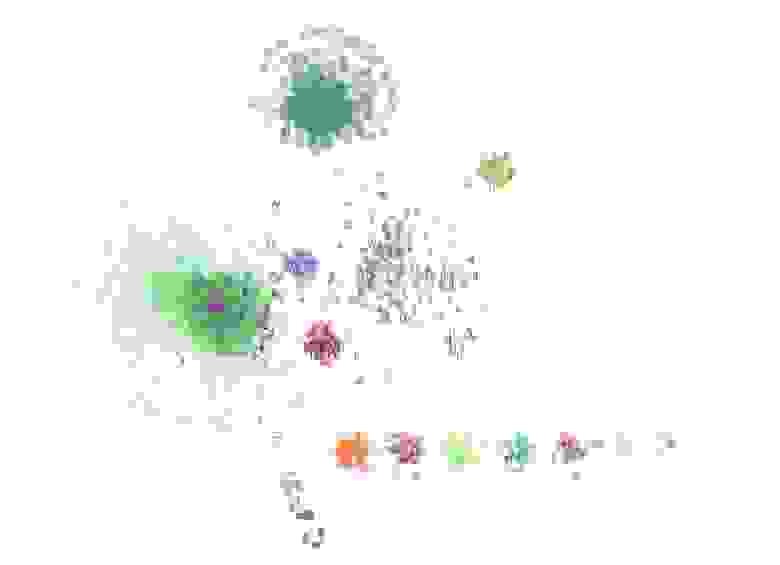

/ фото Philip Kromer CC

Зачастую большие данные воспринимают как «экспериментальный научный проект». Это не негативное описание, но оно объясняет тенденции к созданию отдельных изолированных инфраструктурных кластеров для работы с большими данными.

Так, Майкл Джордан, почетный профессор университета Калифорнии в Беркли, говорит о том, что большие данные могут оказаться очередной уловкой медиа, на которую клюнули тысячи исследователей по всему миру. Современная одержимость большими данными может привести к неконтролируемому использованию выводов, сделанных на основе данных, обладающих спорной статистической прочностью.

Проблема может заключаться и в пресловутом «человеческом факторе» — далеко не каждый аналитик может эффективно работать в этом направлении. Рикардо Владимиро (Ricardo Vladimiro), сотрудник Miniclip, считает, что чтобы по-настоящему погрузиться в изучение данных, человек должен хорошо разбираться в статистике и теории вероятностей, а также уметь проводить эксперименты и проверять свои гипотезы, визуализировать данные.

Сейчас одной из главных задач ИТ-команд крупных компаний является вопрос о том, как сделать так, чтобы большие данные стали надежным и воспроизводимым «продуктом» (это не говоря об эффективности и стоимости), таким как хранилища, виртуальные машины, базы данных и другие инфраструктурные сервисы в наши дни.

Сложность заключается не в выборе облачной платформы для работы с Big Data. Текучесть стека связанных с ними технологий и преобладание «кустарного» подхода к разработке систем (с «допиливанием» готовых продуктов руками) в ближайшее время не изменятся. Для того, чтобы «научный проект» трансформировался в жизнеспособное и эффективное решение для бизнеса, потребуется переосмысление базовых решений ИТ–инфраструктуры.

P.S. Мы стараемся делиться не только собственным опытом работы над сервисом по предоставлению виртуальной инфраструктуры 1cloud, но и рассказывать о смежных областях знаний в нашем блоге на Хабре. Не забывайте подписываться на обновления, друзья!

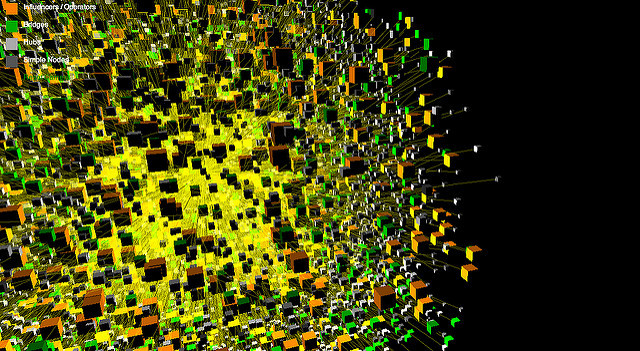

/ фото xdxd_vs_xdxd CC

Термин «Большие данные» появился не так давно – впервые его использовали в журнале Nature в 2008 году. В том номере (от 3 сентября) большими данными читателям было предложено называть набор специальных методов и инструментов для обработки огромных объемов информации и представления её в виде, понятном пользователю.

Апологеты этого направления утверждают даже, что тандем мощных современных технологий и «мощных» объемов информации, доступных в цифровую эпоху, обещает стать грозным инструментом для решения практически любой проблемы. «Нужно лишь собрать и проанализировать данные».

В случае с Эндрю Уорфилдом, который работает в качестве CTO компании Coho Data и является доцентом направления компьютерных наук в Университете Британской Колумбии, речь идет об исследовании на основе интервью представителей компаний из списка Fortune 500. Эндрю интересовался практическими аспектами использования инструментария для работы с Big Data, чтобы понять, как большие компании интегрируют огромные массивы данных с уже существующей ИТ-инфраструктурой. В частности его интересовали потенциальные «болевые точки» и особенности хранения данных.

Исследование Эндрю показало наличие множества небольших кластеров типа Big Data. Руководители ИТ-компаний называли процесс появления подобных кластеров «разрастанием аналитики», которая стала относительно простым и заурядным звеном бизнеса за счет технологий Cloudera CDH, Docker и Hortonworks.

Сегодня задача состоит в объединении множества аналитических инструментов в одну хорошо документированную и легко управляемую среду, которую можно расширить другим полезным инструментарием. В качестве примера можно привести кастомизацию ETL (extract, transform, load — извлечение, траспортировка, загрузка), то есть выгрузку данных из существующих ресурсов и аналитические инструменты (H2o, Naiad и другие).

Такую инфраструктуру разворачивают отдельно от традиционных ИТ-систем, а данные копируют из enterprise-хранилищ в HDFS. После обработки данные копируют из HDFS обратно в основную систему. Такое разделение приводит к неэффективной трате ресурсов и увеличению операционных издержек бизнеса.

/ фото Philip Kromer CC

Зачастую большие данные воспринимают как «экспериментальный научный проект». Это не негативное описание, но оно объясняет тенденции к созданию отдельных изолированных инфраструктурных кластеров для работы с большими данными.

Так, Майкл Джордан, почетный профессор университета Калифорнии в Беркли, говорит о том, что большие данные могут оказаться очередной уловкой медиа, на которую клюнули тысячи исследователей по всему миру. Современная одержимость большими данными может привести к неконтролируемому использованию выводов, сделанных на основе данных, обладающих спорной статистической прочностью.

Проблема может заключаться и в пресловутом «человеческом факторе» — далеко не каждый аналитик может эффективно работать в этом направлении. Рикардо Владимиро (Ricardo Vladimiro), сотрудник Miniclip, считает, что чтобы по-настоящему погрузиться в изучение данных, человек должен хорошо разбираться в статистике и теории вероятностей, а также уметь проводить эксперименты и проверять свои гипотезы, визуализировать данные.

Сейчас одной из главных задач ИТ-команд крупных компаний является вопрос о том, как сделать так, чтобы большие данные стали надежным и воспроизводимым «продуктом» (это не говоря об эффективности и стоимости), таким как хранилища, виртуальные машины, базы данных и другие инфраструктурные сервисы в наши дни.

Сложность заключается не в выборе облачной платформы для работы с Big Data. Текучесть стека связанных с ними технологий и преобладание «кустарного» подхода к разработке систем (с «допиливанием» готовых продуктов руками) в ближайшее время не изменятся. Для того, чтобы «научный проект» трансформировался в жизнеспособное и эффективное решение для бизнеса, потребуется переосмысление базовых решений ИТ–инфраструктуры.

P.S. Мы стараемся делиться не только собственным опытом работы над сервисом по предоставлению виртуальной инфраструктуры 1cloud, но и рассказывать о смежных областях знаний в нашем блоге на Хабре. Не забывайте подписываться на обновления, друзья!