Оценка того, эгоистичны или альтруистичны водители вокруг, имеет большое значение.

Представьте, что вы пытаетесь повернуть налево на оживленную дорогу. Машина за машиной проезжают мимо, удерживая вас в ловушке, ваше напряжение растет. Наконец, великодушный водитель замедляется достаточно, чтобы пропустить вас. Проверка встречного движения, небольшой разгон, и вы успешно вливаетесь в трафик.

Такие сцены разыгрываются по всему миру бесчисленное количество раз в день. И это ситуация, в которой сложно понять физику движения и мотивы других водителей, о чем говорит тот факт, что в Соединенных Штатах каждый год происходит 1,4 миллиона аварий при поворотах. Теперь добавьте в эту ситуацию автономные автомобили. Обычно они ограничиваются только оценкой физических параметров и принимают более осторожные решения в ситуациях с неоднозначной обстановкой.

Подписывайтесь на каналы:

@AutomotiveRu — новости автоиндустрии, железо и психология вождения

@TeslaHackers — сообщество российских Tesla-хакеров, прокат и обучение дрифту на Tesla

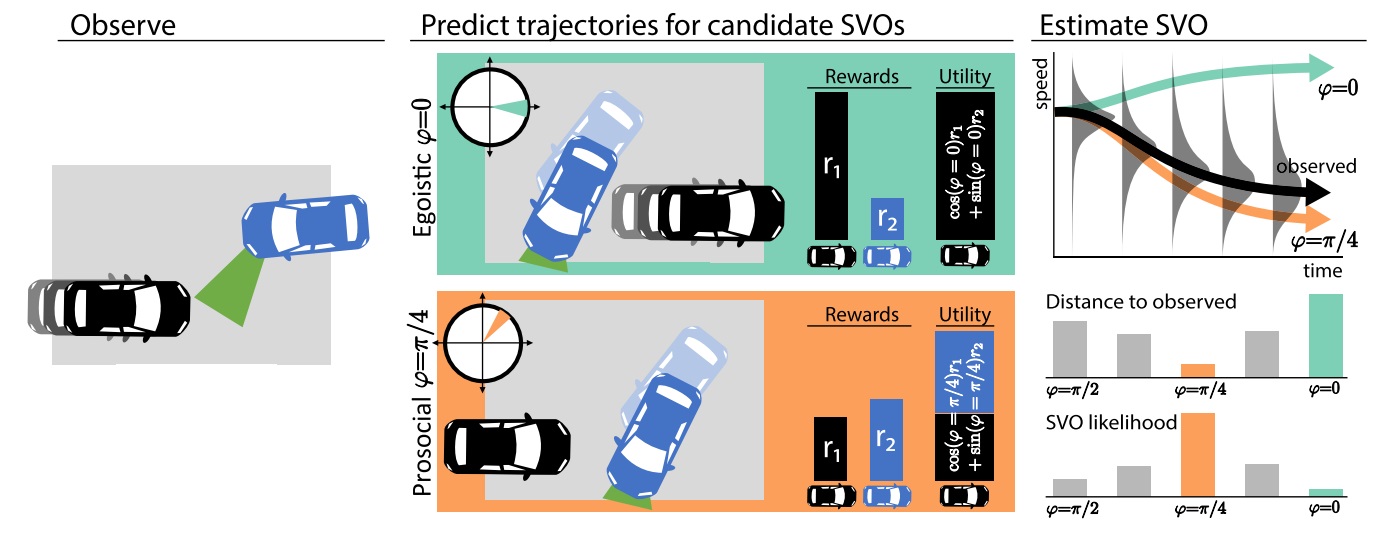

Зная «социальные предпочтения» водителя мы можем предсказать его поведение. Автономный автомобиль (синий) наблюдает за траекторией другого человека-водителя (черный). Мы можем спрогнозировать будущее движение черного транспортного средства на основе модели принятия решений, максимизирующей полезность («Вождение как игра в смешанном системе человеке-робот»).

Недавно группа ученых в области компьютерных наук выяснила, как улучшить работу автономного транспортного средства в этих условиях. Ученые, по сути, частично обучили свои автономные автомобили теории разума (theory of mind), которая позволяет транспортным средствам лучше интерпретировать поведение живых водителей, которые находятся рядом.

Разум теории

Теория разума настолько близка к нам, что порой тяжело осознать, насколько редко она встречается за пределами нашего вида. Мы легко можем понять, что другие люди думают так же, как и мы, и мы используем этот инструмент, чтобы оценить их знания и возможные мотивы. Мы используем этот инструмент в большинстве социальных взаимодействий, включая вождение. В то время как дружеское махание рукой от другого водителя может означать, что он уступает вам дорогу, то зачастую вы можете сделать выводы и просто на основе того, как он ведет машину.

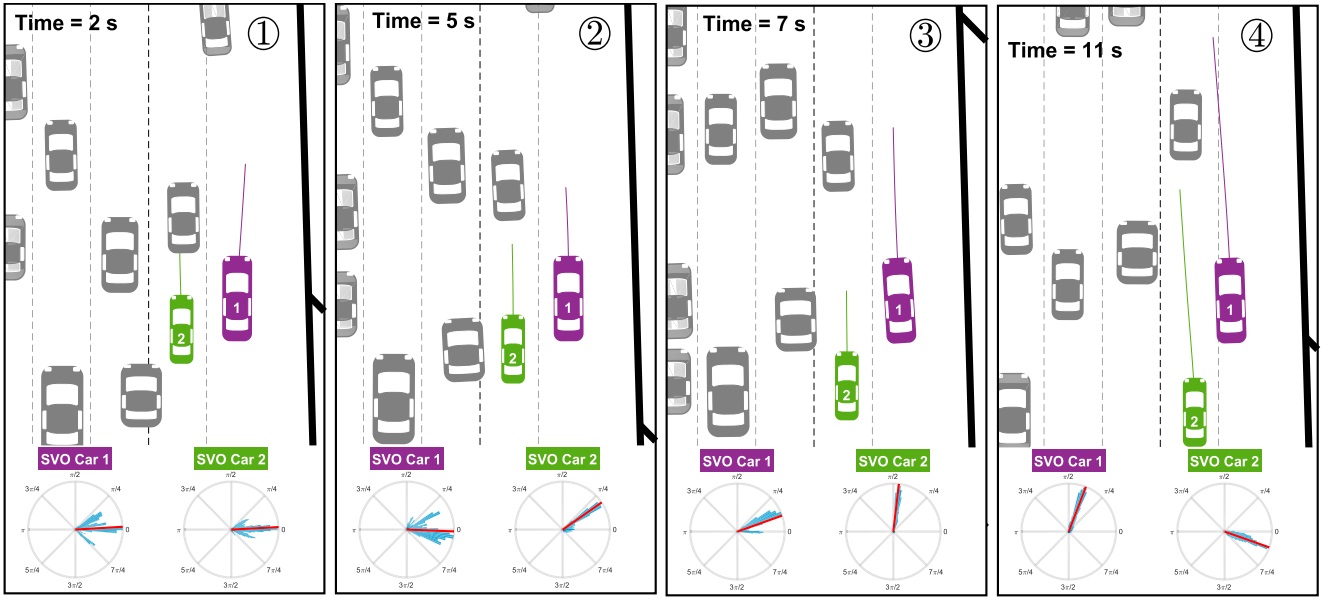

Датасет NGSIM с n = 2 активных автомобилей (фиолетовая и зеленая) и n = 50 «препятствий» (серые). Фиолетовая машина пытается встроиться в поток и должна повзаимодействовать с зеленой машиной. Жирная линия показывает предсказанную траекторию алгоритма. Синее показывает распределение, красная — оценку.

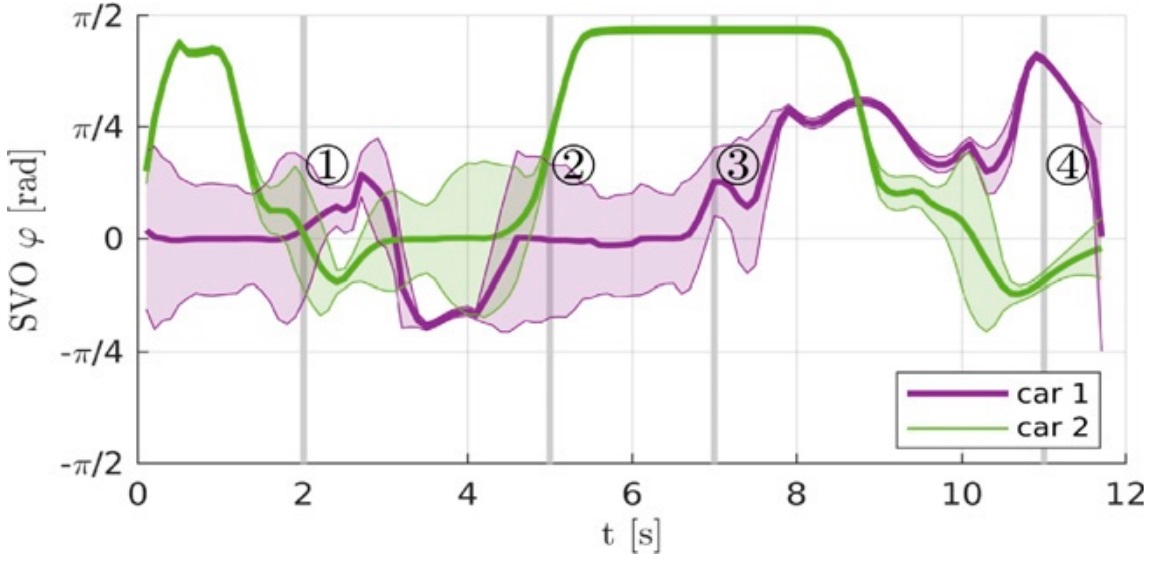

Сплошная линия показывает оценку «социальных предпочтений» во времени, а заштрихованная область показывает доверительные границы. Первоначально автомобиль 2 не взаимодействует с автомобилем 1 и не позволяет ему встроиться в поток. Через несколько секунд автомобиль 2 становится более просоциальным, что означает «притормозить/(dropping it back)» и позволяет первой машине встроиться в поток.

К сожалению, автономные автомобили в этом не очень хороши. Во многих случаях их поведение ничего не сообщает другим водителям. Исследование ДТП с автономными автомобилями в Калифорнии показало, что больше чем в половине аварий в автономные машины врезались сзади, так как водители-люди не могли понять действий машин на автоматическом управлении (В частности Volvo работает над тем, чтобы это изменить)

Невозможно думать о том, что мы сможем полноценно обучить автономные машины теории разума в ближайшее время. Искусственный интеллект не настолько развит, и это будет излишне для машин, которые взаимодействуют только с ограниченным количеством видов человеческого поведения. Однако группа исследователей из MIT и Делфтского технологического университета решила, что использование очень ограниченной теории разума возможно для принятия некоторых решений на дороге, включая повороты и ситуации, когда необходимо влиться в поток движения.

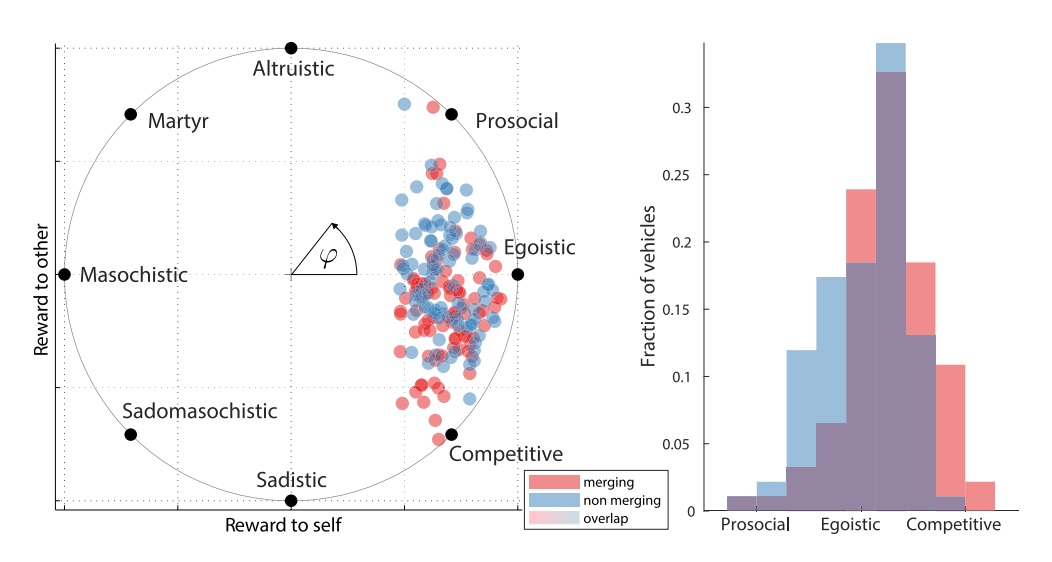

«Социальные предпочтения» представлены в виде углового предпочтения ϕ, в зависимости от того, как люди распределяют веса/ценность награды/выигрыша в игре про социальную дилемму.

Идея, которая лежит в основе работы исследователей, описана в новой статье в PNAS и включает в себя концепцию ориентации на социальные ценности, которая позволяет оценить, насколько эгоистичны или альтруистичны действия человека. И хотя, конечно, существуют подробные опросы, которые могут дать детальное описание ориентации на социальные ценности человека, автономным машинам обычно некогда проводить опросы среди водителей вокруг.

Таким образом, исследователи разбили ориентацию на социальные ценности на 4 категории: альтруисты, которые стараются быть максимально позитивными к другим водителям; просоциальные водители, которые стараются действовать максимально выгодно для всех остальных (иногда это может быть и эгоистичное ускорение); индивидуалисты, для которых на первом месте их собственный опыт вождения; и водители, которые соперничают со всеми остальными в навыках управления автомобилем.

Ориентация на ценности (Social Value Orientation, SVO)

Исследователи вывели формулу, по которой можно рассчитать ожидаемую траекторию движения для каждой из категорий водителей, учитывая стартовые позиции других машин.

Автономные автомобили были запрограммированы сравнивать траектории реальных водителей с рассчитанными, и использовать это сравнение для определения, к какой из четырех категорий эти водители скорее всего принадлежат. Учитывая эту классификацию, автономная машина сможет спроектировать свои дальнейшие действия. Как писали исследователи, «Мы расширяем возможности рассуждений автономных автомобилей, объединяя оценки личности и стиля вождения других водителей с помощью социальных сигналов».

Это существенно отличается от некоторых работ в этой области, связанных с теорией игр. Эти работы подразумевали, что каждый водитель старается максимально увеличить свою выгоду, альтруизм – лишь случайность в этом увеличении. Новая же работа, напротив, включает альтруистическое поведение в свои расчеты и признает, что поведение водителей сложно оценить, и что они могут менять свои намерения по мере развития ситуации. Фактически, предыдущие исследования показали, что в ситуациях кроме вождения около половины исследованных людей показали просоциальное поведения, а другие 40% были эгоистичны.

(Слева) расчетное распределение предпочтений SVO синей машины показано в виде полярных гистограмм в кругах SVO при подготовке и осуществлении встраивания в поток. (Справа)

средняя оценка показана красным цветом, а реальность (80°, альтруист) в черном. Оценки SVO с границами неопределенности 1-σ показаны справа. Зона взаимодействия соответствует серой области.

После внедрения системы, исследователи получили данные о расположении и траекториях транспортных средств, когда водители вливались в поток машин на шоссе, что зачастую требует щедрости других водителей. С системой ориентации на социальные ценности, искусственный водитель смог сделать более точные прогнозы траекторий движения водителей-людей – ошибки снизились на 25%. Система также работала со сменами полосы движения на заполненных автострадах, равно как и при поворотах в поток движения.

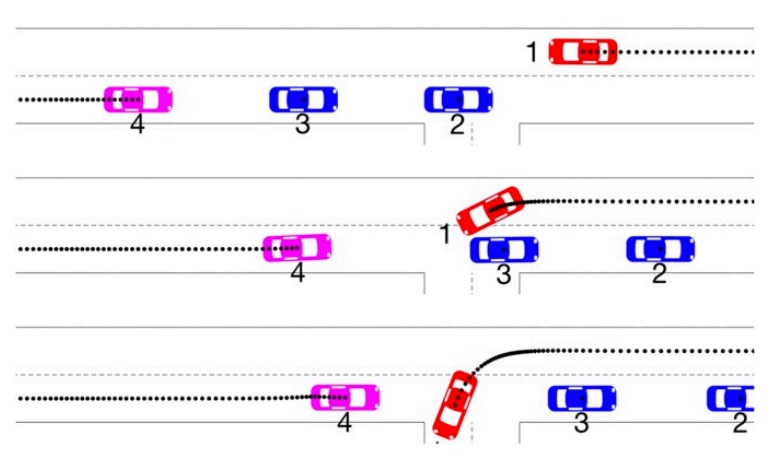

Небезопасный левый поворот автономного автомобиля (красный; i = 1) со встречным движением. Когда автономный автомобиль приближается к перекрестку, две эгоистичные машины (синие; i = 2, 3) продолжают движение и не уступают. Третий альтруистический автомобиль (пурпурный; i = 4) уступает, замедляется, позволяя автономному автомобилю совершить встраивание.

Используя эти оценки, исследователи могли также сделать некоторые выводы по имеющимся моделям трафика. Например, они выяснили, что водитель на шоссе может начать эгоистично следовать за машиной перед собой, затем начать действовать альтруистично, сбросив скорость, чтобы другой водитель мог влиться в поток движения, а затем снова вернуться к эгоистичному подходу. Аналогично водители, сталкивающиеся с выездом на автостраду, обычно соперничали с другими – как в ситуациях, когда вы видите машину, которая выезжает и замедляет всех, кто застрял за ней.

Пока мы еще далеки от того, чтобы дать автономным машинам полноценный искусственный интеллект или полную теорию разума, но исследования показывают, что можно получить значительную выгоду от использования их ограниченных версий. И это отличный пример того, что если мы хотим интегрировать автономные системы в социальные взаимодействия, то может быть очень важно уделять внимание на то, что уже выяснили ученые-социологи.

Подписывайтесь на каналы:

@AutomotiveRu — новости автоиндустрии, железо и психология вождения

@TeslaHackers — сообщество российских Tesla-хакеров, прокат и обучение дрифту на Tesla

О компании ИТЭЛМА

Мы большая компания-разработчик automotive компонентов. В компании трудится около 2500 сотрудников, в том числе 650 инженеров.

Мы, пожалуй, самый сильный в России центр компетенций по разработке автомобильной электроники. Сейчас активно растем и открыли много вакансий (порядка 30, в том числе в регионах), таких как инженер-программист, инженер-конструктор, ведущий инженер-разработчик (DSP-программист) и др.

У нас много интересных задач от автопроизводителей и концернов, двигающих индустрию. Если хотите расти, как специалист, и учиться у лучших, будем рады видеть вас в нашей команде. Также мы готовы делиться экспертизой, самым важным что происходит в automotive. Задавайте нам любые вопросы, ответим, пообсуждаем.

Мы, пожалуй, самый сильный в России центр компетенций по разработке автомобильной электроники. Сейчас активно растем и открыли много вакансий (порядка 30, в том числе в регионах), таких как инженер-программист, инженер-конструктор, ведущий инженер-разработчик (DSP-программист) и др.

У нас много интересных задач от автопроизводителей и концернов, двигающих индустрию. Если хотите расти, как специалист, и учиться у лучших, будем рады видеть вас в нашей команде. Также мы готовы делиться экспертизой, самым важным что происходит в automotive. Задавайте нам любые вопросы, ответим, пообсуждаем.

Читать еще полезные статьи: