Исследователи научились редактировать видеоролики, вкладывая в уста человека на видео любые слова и предложения. Технология обрабатывает ролик таким образом, что выглядит все это весьма естественно и органично, заметить подделку можно только в том случае, если подозревать редактирование.

Создала новый алгоритм объединенная команда исследователей из Стэнфорда, Института Макса Планка, Принстона и компании Adobe. Редактирование заключается лишь в создании текста, который должен произнести человек с ролика. Всю остальную работу выполняет нейросеть. Заметить подделку сложно потому, что мимика и паттерны движений «спикера» сохраняются, технология позволяет маскировать следы вмешательства.

Для того, чтобы этого добиться, создатели алгоритма научили его анализировать видео. Нейросеть выделяет необходимые жесты, элементы мимики и слова с артикуляцией, а затем комбинирует отдельные кадры таким образом, чтобы модифицированный ролик выглядел нетронутым. Результат представляет собой, фактически, компьютерную модель, которая выполняет необходимые владельцу технологии действия.

Движения губ, языка, все артикуляционные элементы оригинальны, нейросеть «вырезает» их из первоначального ролика. После этого ролик выглядит не слишком натурально, поскольку содержит большое количество врезок и пауз. Поэтому технология «сглаживает» получившийся вариант, чтобы тот выглядел максимально естественно.

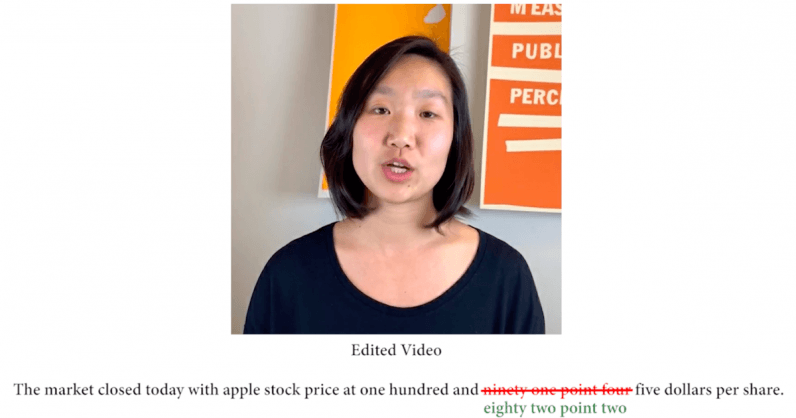

Перед использованием нейросеть нужно обучить — ей требуется «скормить» не менее 40 минут видео с тем человеком или людьми, речь которых будут заменять. Правда, это актуально лишь для англоязычных видео, поскольку в английском языке всего 44 фонемы, так что нейросеть гораздо проще обучить на примере английского языка, чем русского или японского. Тем не менее, с течением времени эта технология может быть использована и для редактирования видео с людьми, которые говорят на любых других языках. Ниже показано видео, которое служит демонстрацией возможностей описываемой технологии.

Конечно, эта работа поднимает ряд вопросов. Один из них — информационная и медийная безопасность. Если в уста любого человека можно вложить любые слова, причем результат будет выглядеть очень естественно, то не является ли технология опасной? Авторы разработки утверждают, что да, ее могут использовать злоумышленники. Но ведь, к примеру, графические редакторы существуют очень давно, с их помощью также можно подделывать что угодно, но мир и мы вместе с ним продолжаем существовать.

Кроме того, авторы говорят, что понимают, что эта же технология может использоваться недобросовестными политиками. Последние смогут избежать необходимости наговаривать речи перед камерой, если их заменить «говорящими головами», сформированными из более ранних выступлений, запечатленных на видео.

Для того, чтобы обнаружить подделку, авторы идеи предлагают использовать специализированные вотермарки и некоторые другие приемы, которые дадут возможность распознать подлог.

Конечно, факт модификации видео легко доказать, если есть оригинальное видео. В дополнение к этому авторы планируют разработать методы защиты медиаконтента, добавляя в исходный вариант «цифровые отпечатки», которые легко обнаружить и понять, является ли ролик оригиналом или подделкой.

С полным текстом исследования можно ознакомиться вот здесь.