В предыдущей публикации, первой по счету, мы рассказали кратенько о себе, чем занимаемся и про наши планы. Получили такое количество обратной связи (и по щам тоже – все за дело, заслужили) и за все благодарны (особенно за неразрушающийся контроль).

Во-первых, была поднята тема ответственности. Эта темы и без AI тяжела, а с ним то – и подавно. Дело даже не с технологии, AI или ML, или что угодно – это просто добавление еще одного звена, который еще больше усложняет всю систему. Тема ответственности за технологию – тема особая, требующая отдельного поста или даже серии постов. Мы пока не готовы к этому, но мысли есть на тему.

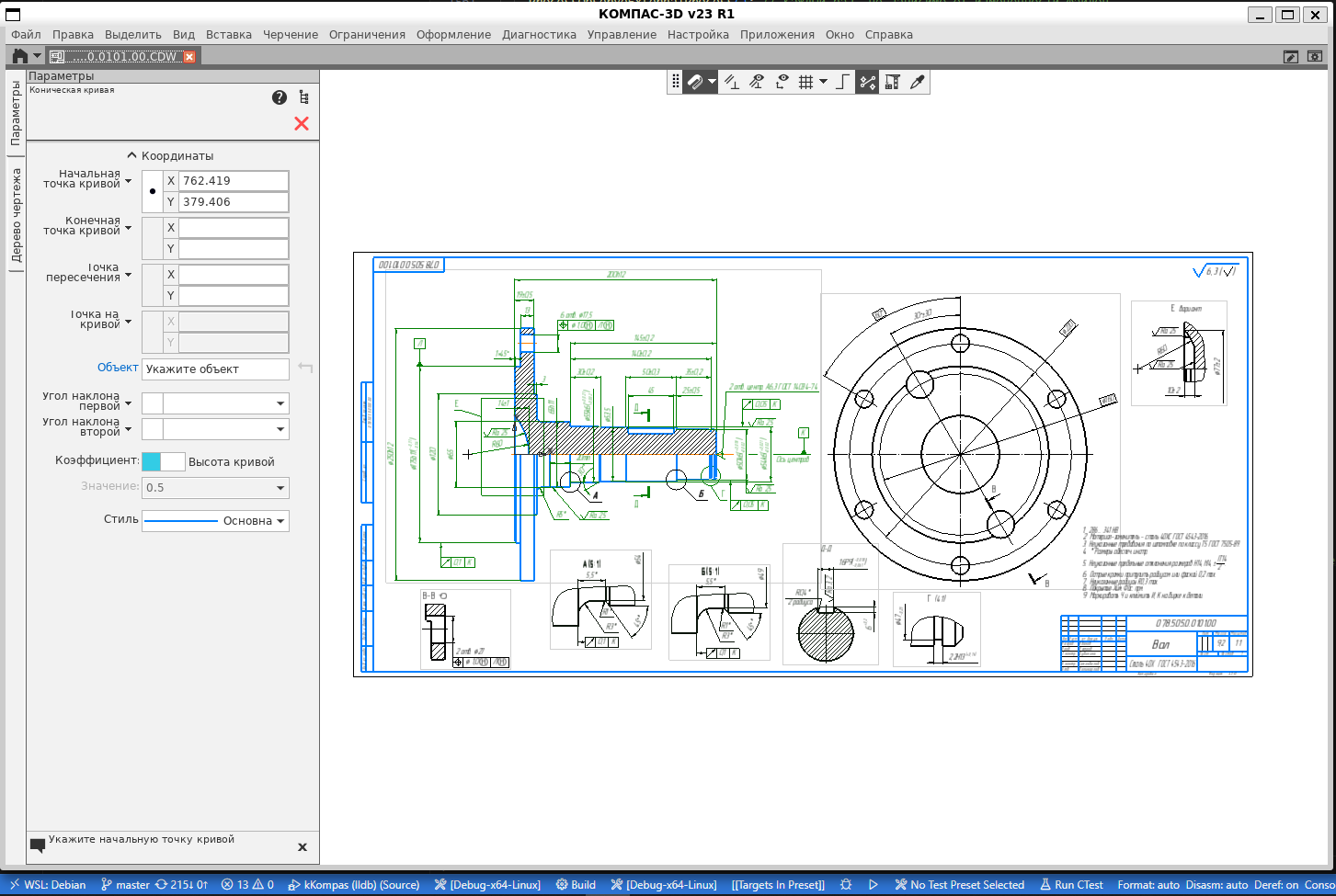

У одного из членов нашей команды есть научрук, доктор технических наук Ясницкий Л.Н., автор нашумевшей в свое время статьи «По ком звонит Ansys» как раз про ответственность технологии, включая гибель людей в Трансвааль‑парке в 2004 г. Всем советуем почитать, статья больше задает вопросы, чем отвечает, но мысль такая же как и в комментах к нашей первой публикации — надо создавать методологию ответственности.

Еще страшней тема в продолжении: алгоритм минимальности числа жертв при их неизбежности и степень его повсеместного применения или внедрения. Тут впору вспомнить «не убий» в Азимовском варианте. Уточним, Айзек Азимов в своем рассказе «Хоровод» ввел четыре правила робототехники, ну их правда изначально три было, потом добавился четвертый. Если же учесть, что в некоторые немецкие автомобили встроен AI, который работает не по принципу «минимальности жертв» при неизбежном ДТП, а по «мой хозяин должен остаться в живых, так как он меня за этим и купил», то поле для рассуждения становится просто необъятным. Вернемся к нашим тросам‑канатам.