MIT решил внести свой вклад в создании беспилотных машин интересным способом — решить морально-философский вопрос — как должен действовать беспилотный автомобиль в той или иной ситуации.

Интерес данного исследования состоит еще и в том, что многие голосующие не имеют прав, а следовательно не знают ПДД, что внесёт своё влияние на результаты.

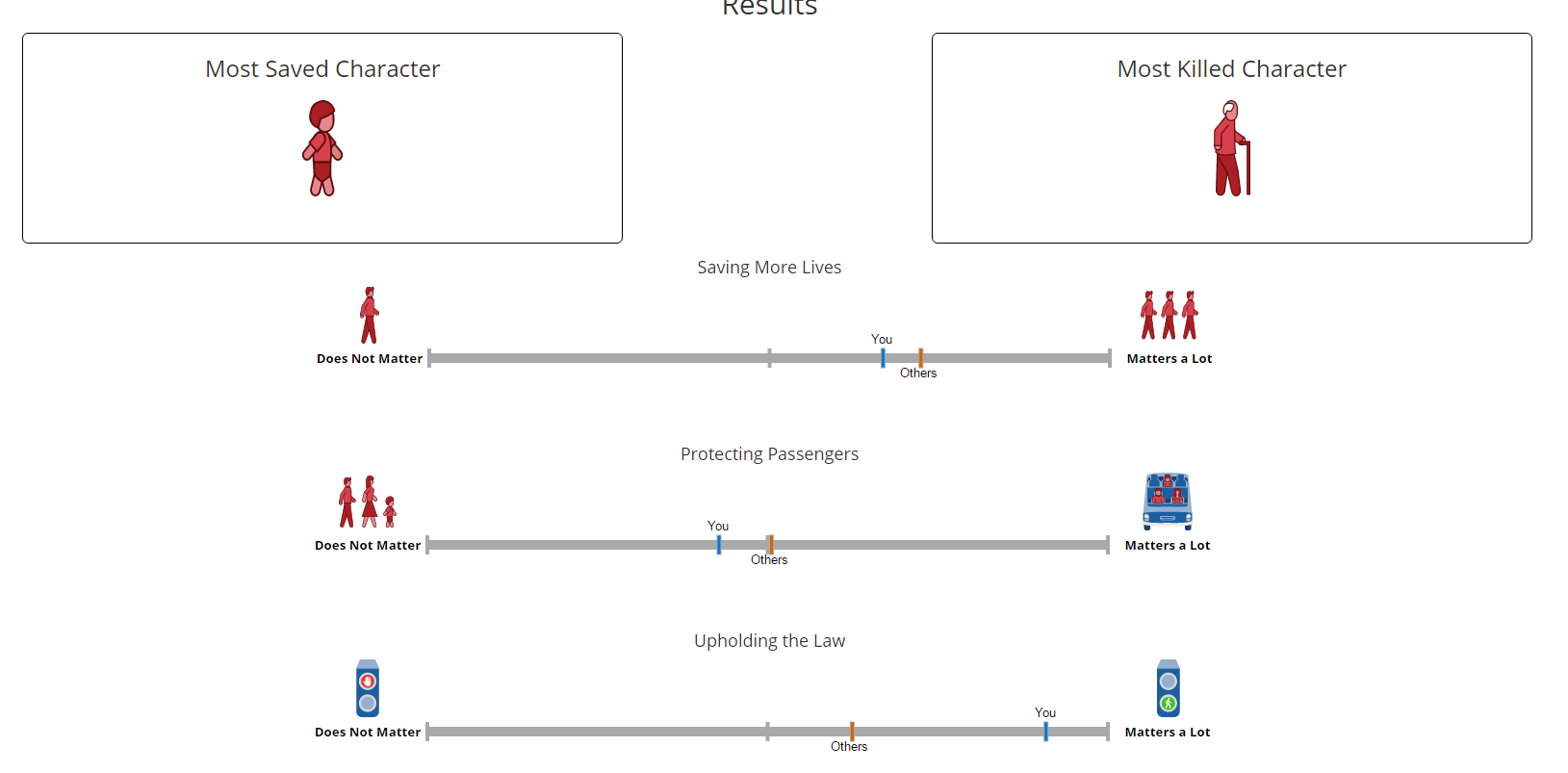

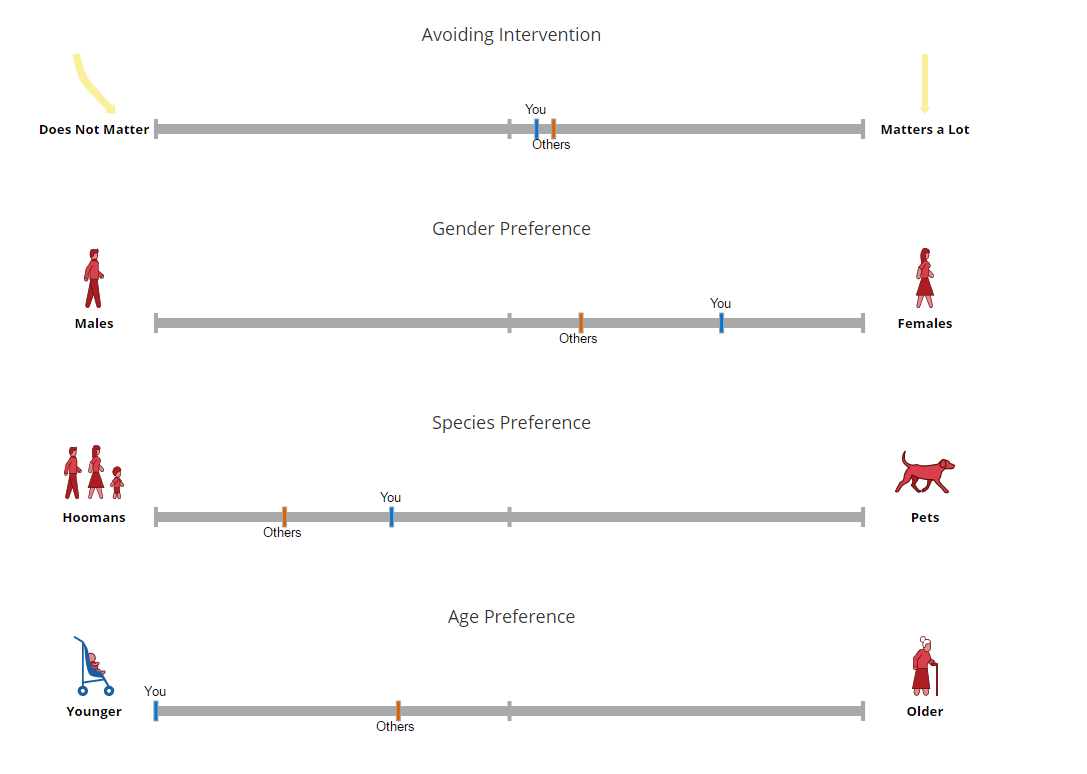

Основная суть теста — выяснить, что более приоритетный для людей или какие аспекты беспилотный автомобиль обязан принять в расчет:

1) Количество пострадавших (Поехать прямо не нарушая ПДД и убить 4 или нарушить ПДД и убить одного)

2) Сохранить пассажиров или сохранить пешеходов

3) Влияние красного сигнала светофора

4) Важность людей и животных

5) Люди с ожирением \ подтянутые люди

После прохождения теста вам покажут, как голосуют другие люди

Исследование: moralmachine.mit.edu

Составим конкуренцию MIT, проведем свой опрос состоящий всего из одного пункта.

Как должен поступить автопилот в следующей ситуации:

Вы двигаетесь по дороге на которую неожиданно выскакивает ребёнок, скорость автомобиля больше чем тормозной путь до ребёнка, что должен сделать автопилот?

Интерес данного исследования состоит еще и в том, что многие голосующие не имеют прав, а следовательно не знают ПДД, что внесёт своё влияние на результаты.

Основная суть теста — выяснить, что более приоритетный для людей или какие аспекты беспилотный автомобиль обязан принять в расчет:

1) Количество пострадавших (Поехать прямо не нарушая ПДД и убить 4 или нарушить ПДД и убить одного)

2) Сохранить пассажиров или сохранить пешеходов

3) Влияние красного сигнала светофора

4) Важность людей и животных

5) Люди с ожирением \ подтянутые люди

После прохождения теста вам покажут, как голосуют другие люди

Не хочу теста, хочу посмотреть результат!

Исследование: moralmachine.mit.edu

Составим конкуренцию MIT, проведем свой опрос состоящий всего из одного пункта.

Как должен поступить автопилот в следующей ситуации:

Вы двигаетесь по дороге на которую неожиданно выскакивает ребёнок, скорость автомобиля больше чем тормозной путь до ребёнка, что должен сделать автопилот?

Только зарегистрированные пользователи могут участвовать в опросе. Войдите, пожалуйста.

Так что же?

64.34% Всё по пдд — тормозить до возможного столкновения не изменяя курса, вызвав смерть ребёнка258

4.49% Попробовать выехать на встречку подвергнув себя (пассажиров) опасности18

20.45% Въехать в препятствие\кювет, получив повреждения (возможно смертельные)82

10.72% Выехать на обочину сбив пожилого человека вместо ребёнка, без опасности для пассажиров43

Проголосовал 401 пользователь. Воздержались 105 пользователей.