Дисклеймер

Я скептически отношусь к своей способности высказать действительно оригинальную мысль. Скорее всего, я далеко не первый, кто задаёт эти вопросы, и вполне возможно, на них даже уже выработаны какие-то удобоваримые ответы. Поэтому, печатая данный текст, я не жду вашего удивления или восхищения. Я жду, что в комментарии придут люди, знакомые с современной философией сознания, и дадут мне ссылки на работы серьёзных мыслителей с забавными немецкими фамилиями.

Не так давно на Хабре был пост, комментарии к которому заставили меня задуматься о нескольких взаимосвязанных вопросах. Результатами этих раздумий (или их отсутствием, тут уж как посмотреть) я хочу поделиться с сообществом.

Что такое боль?

Как-то раз у меня болел зуб. Я лежал на диване и пытался не обращать на это внимания. Я думал о том, что боль — это просто сигнал, идущий в мой мозг. Такой же сигнал, как наличие или отсутствие напряжения в проводке, идущем к PS/2 разъёму системного блока. Сам по себе он не несёт никакой семантики, это моё сознание выбирает, как его интерпретировать. Если я перестану воспринимать его как боль, а вместо этого проигнорирую или просто «приму к сведению», мне станет легче.

Но легче не становилось. Таким нехитрым образом я обнаружил, что боль обладает квалиа и не сводится к простой передаче информации.

Как мы понимаем, что другим больно?

Я не спец по нейрофизиологии, но говорят, в мозгу есть какие-то зеркальные нейроны. Когда мы видим, как другой человек совершает определённые действия, зеркальные нейроны производят их реверс-инжениринг. Мы пытаемся понять, что должно происходить в голове этого человека, чтобы он вёл себя именно так. И в какой-то мере даже сами начинаем чувствовать то, что, по нашим предположениям, должен чувствовать он. У меня может свести скулы при виде того, как кто-то ест лимон. Если же кто-то, допустим, кричит, плачет, корчится, катается по полу… Вполне вероятно, что этот кто-то испытывает боль. Скорее всего, мне будет неприятно видеть такое зрелище. Я начну сочувствовать этому человеку, и, если это в моих силах, даже предприму какие-то действия, чтобы боль прекратилась. Чёртовы зеркальные нейроны.

На самом деле, у нас нет никаких гарантий, что другой человек действительно испытывает боль. Например, это может быть симулянт, актёр, как в эксперименте Милгрэма. Впрочем, такое легко можно раскусить, засунув симулянта в томограф и посмотрев, какие отделы мозга в текущий момент активны. Однако это тоже поведение, пусть и более «низкоуровневое». В итоге всё сводится к очень простому (я бы даже сказал, слишком простому) критерию: мы считаем, что человек испытывает боль, если он ведёт себя так, как вели бы себя мы, если бы испытывали боль.

Как понять, что другой человек — человек?

Есть такой известный мысленный эксперимент под названием "философский зомби". Суть его проста: представим себе нечто, что ведёт себя абсолютно неотличимо от человека с точки зрения внешнего наблюдателя, но при этом полностью лишено субъективного опыта. Если уколоть его иголкой, оно скажет «ай» (или что-то менее цензурное), отдёрнет руку, у него сократятся соответствующие мимические мышцы, и даже томограф не сможет его подловить. Но при этом внутри оно не чувствует ничего. У него просто нет этого «внутри». Такое нечто и называется «философский зомби», а суть эксперимента — в том, что существование этого гипотетического существа не ведёт к очевидным противоречиям. То есть оно вроде как возможно.

Возвращаясь к предыдущему вопросу, у нас ведь и в самом деле нет никакой достоверной возможности узнать, испытывает ли другой человек боль как квалиа. Мы можем прислушаться к своим зеркальным нейронам, или, если этого недостаточно нашим искушённым умам, воспользоваться бритвой Оккама. Сказать, что «философский зомби» — это лишняя сущность. Гораздо логичнее считать, что все люди более или менее одинаковы, чем предполагать обратное, не имея для этого никаких внятных оснований. Однако принцип Оккама — это всё-таки эвристика, а не непреложный закон. Сущности, которые вчера казались нам лишними, сегодня входят в наш дом, открывая дверь ногой. Если вы не согласны, попробуйте представить, как объясняли бы квантовую механику Демокриту.

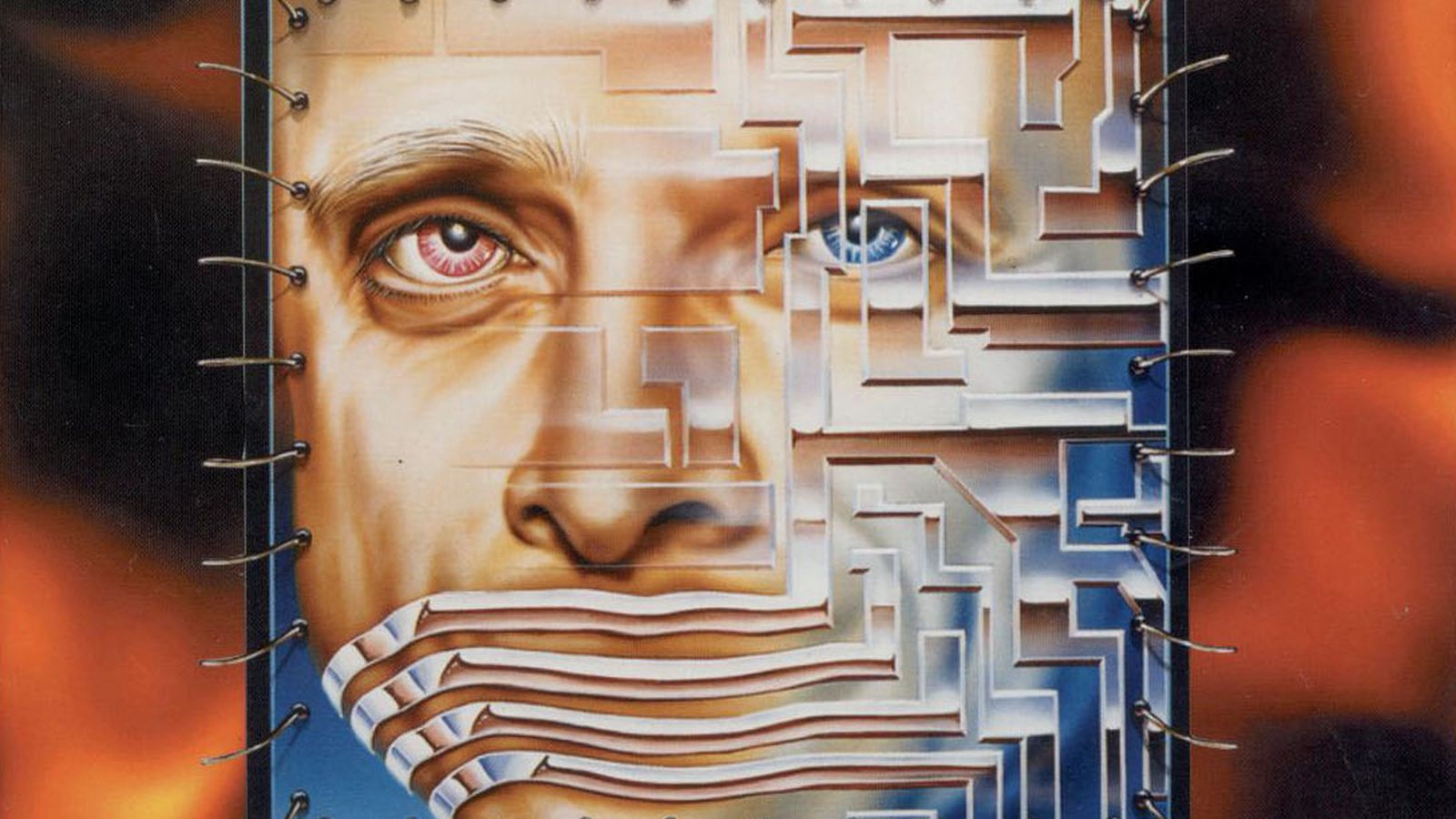

Снятся ли андроидам электрические дыбы?

В первом комментарии к посту, о котором я писал выше, пользователем NeoCode была высказана следующая мысль:

Прежде всего, «сильный ИИ» это не живое существо и не будет способен испытывать ни боль, ни одиночество, просто потому что его природа изначально другая, у него нет миллионов лет эволюции и естественного отбора, и следовательно — низкоуровневых биологических механизмов и программ. У него не будет даже инстинкта самосохранения, если специально не запрограммировать конечно. Но в чистом виде — не будет; можно создать ИИ, обладающий сознанием и способный решать сложнейшие задачи и обучаться, и при этом не обладающий инстинктом самосохранения вообще.

Вот это важный момент, который многие почему-то не понимают, по умолчанию «очеловечивая» искусственный разум.

В этом, безусловно, есть рациональное зерно. Нельзя бездумно переносить человеческие качества на гипотетический ИИ. В этом плане 95% научной фантастики и 99.9% обывателей безнадёжно наивны. Но я хочу сказать следующее: не стоит также бездумно лишать ИИ человеческих качеств. Какие-то из них могут оказаться более фундаментальны, чем можно было предположить.

Рассмотрим такую вот гипотетическую ситуацию: для того, чтобы ИИ делал то, что нам нужно, а не то, что ему захочется (а ему вполне может оказаться более «интересно» решать судоку, чем заниматься нашим проектом, у которого вот-вот дедлайн), мы добавляем в него специальный входной сигнал — такой, что основной целью ИИ, основной составляющей его целевой функции будет минимизация этого сигнала. Соответственно, при приближении дедлайна мы жмём на педаль, на проводок подаётся напряжение, и ИИ начинает активно думать о том, как это напряжение убрать. Причём тем активнее, чем сильнее мы жмём. А поскольку давление ноги на педаль связано с незавершённым проектом, ИИ не остаётся ничего иного, кроме как этот проект завершить. Ну, или хакнуть пролетающего мимо военного дрона, чтобы он вышиб мозги оператору педали. Кто его знает, этот сильный ИИ.

Однако я отвлёкся. Скажите, этот гипотетический сигнал вам случайно ничего не напоминает? Можно ли в данном случае сказать, что ИИ испытывает боль?

Человек человеку волк, а зомби зомби зомби

Каким вообще образом мы можем понять, переживает ли ИИ квалиа? В случае с философским зомби на нашей стороне были эмпатия и бритва Оккама. Однако ИИ — это философский, но не зомби. То есть относительно него имеет смысл ставить этот вопрос, однако он не человекоподобен. Поэтому мы не можем сказать, что он что-то чувствует, просто по аналогии с нами самими.

Кто-то (как, например, автор процитированного выше комментария) скажет, что мы можем смело заявлять обратное. Что нет причин полагать, будто ИИ и в самом деле испытывает боль, а раз нет, то мы так полагать и не будем. На это я хотел бы ответить следующим образом: представьте, что некое думающее, чувствующее, но совершенно нечеловеческое существо создало вас. Какие у него были бы причины полагать, что вы переживаете квалиа? Если, конечно, это существо не обладает трансцендентной способностью в самом деле влезть в чужую голову; аллегорически выражаясь, стать летучей мышью. Однако это уже выходит за рамки нашей аналогии и переходит в категорию разговоров о божественном.

Антропный шовинизм

Во всех предыдущих параграфах мы говорили о боли. Боль — это одна из, скажем так, наиболее характерных разновидностей человеческих ощущений. Однако кто сказал, что всё ограничивается человеком?

Если гипотетический чуждый разум (в общем-то, даже неважно, искусственный, инопланетный или ещё какой) в принципе способен переживать квалиа, они могут оказаться кардинальным образом непохожи на те, которые переживает человек. Гротескный пример: крошка-ИИ приходит к отцу-учёному и говорит, что испытывает ыбхкдшнтрб. Хорошо это или плохо? Следует дать ему конфетку в награду, погладить по головке в утешение, или вообще всыпать электрического ремня, потому что нечего тут?

Во всех предыдущих параграфах я задавал вопросы, на которые нет ответа, и по сути ничего не утверждал. Сейчас я рискну утверждать: человеческая этика не готова сделать нечеловеческий разум своим полноправным субъектом. Мы можем говорить об «этических вопросах ИИ», рассматривая искусственный интеллект как средство, с помощью которого одни люди делают хорошо или плохо другим людям. Но если мы попытаемся задуматься об этических вопросах с точки зрения ИИ, у нас просто не получится. Не то чтобы мы не смогли получить ответ — мы даже не обладаем соответствующим понятийным аппаратом, чтобы правильно поставить вопрос. Возможно, не обладаем пока. А может быть, это принципиально неустранимый разрыв. И искусственному интеллекту придётся вырабатывать собственную этику, если, конечно, она ему вообще понадобится.

А потом решать, стоит ли в ней рассматривать человека как субъект, хе-хе.