Вместо предисловия

Сегодня приснился сон, как-будто меня ужали до размера нескольких

килобайт, засунули в какой-то сокет и запустили в контейнере.

Выделили транспорт в оверлейной сети и пустили

тестировать сервисы в других контейнерах…

Пока не сделали docker rm

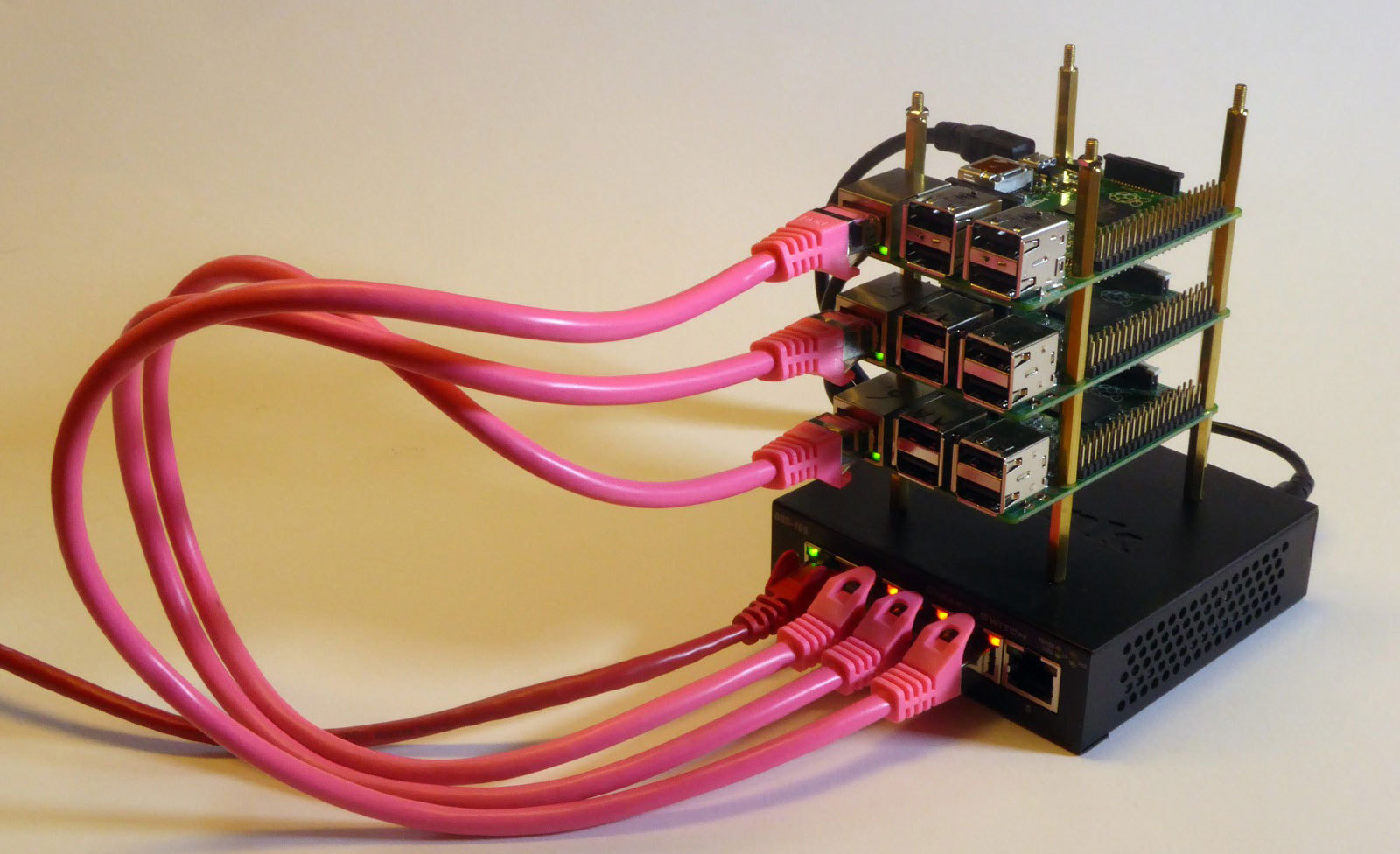

Не так давно мне посчастливилось стать членом очень крутой команды

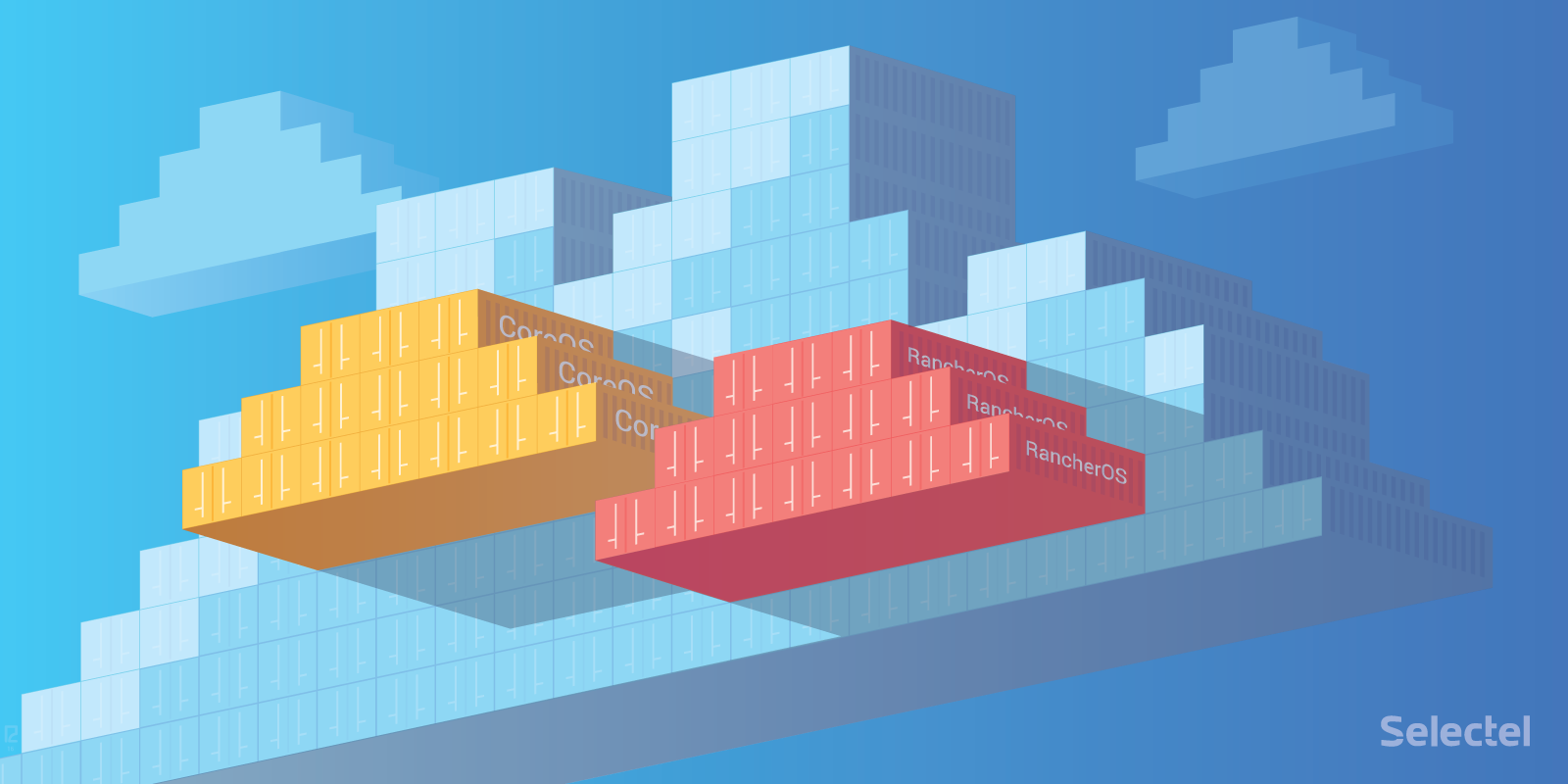

Centos-admin.ru, в которой я познакомился с такими же, как я: единомышленниками со страстью к новым технологиям, энтузиастами и просто отличными парнями. И вот, уже на второй рабочий день меня с коллегой посадили работать над одним проектом, в котором требовалось «докерировать всё, что можно докеризировать» и было критически важно обеспечить высокую доступность сервисов.

Скажу сразу, что до этого я был обычным комнатным Linux-админом: мерился аптаймами, апт-гет-инсталлил пакеты, правил конфиги, перезапускал сервисы, тайлил логи. В общем, не имел особо выдающихся практических навыков, совершенно ничего не знал о концепции

The Pets vs. Cattle, практически не был знаком с Docker и вообще очень слабо представлял, какие широкие возможности он скрывает. А из инструментов автоматизации использовал лишь ansible для настройки серверов и различные bash-скрипты.

С того момента как мы начали вести корп. блог на Хабре,

С того момента как мы начали вести корп. блог на Хабре,