Введение в Gestures

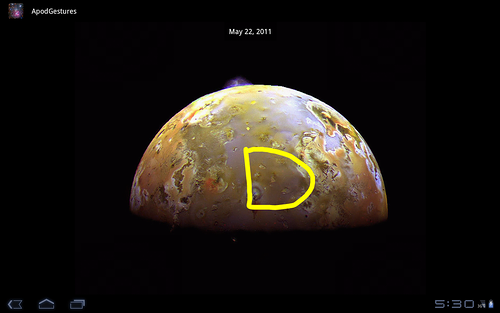

Сейчас мы на боевом примере поработаем с жестами в среде Android. Приложение будет клиентом сайта Astronomy Picture of the Day by NASA. На этом сайте ребята каждый день выкладывают какую-нибудь замечательную картинку, связанную с астрономией. Жестами мы будем ходить вперед/назад и вызывать диалог выбора даты. А чтобы было еще интересней — напишем его для Honeycomb.

Статья состоит из двух частей: первая — покажет, как создавать жесты с помощью приложения Gestures Builder и выгружать их из эмулятора в отдельный бинарный файл. Во второй части, мы загрузим его в наше приложение и начнем использовать.

Gesturin — ввод жестами для Android

В этом посте я расскажу, как создать метод ввода жестами для Android. Данный метод ввода можно сделать похожим на рукописный ввод, но есть одно ограничение — нужно рисовать букву (цифру, слово) не отрывая пальца. В реализацию входит метод ввода и утилита для настройки жестов, которая является переделанным «Gesture Builder» из примеров к Android SDK.

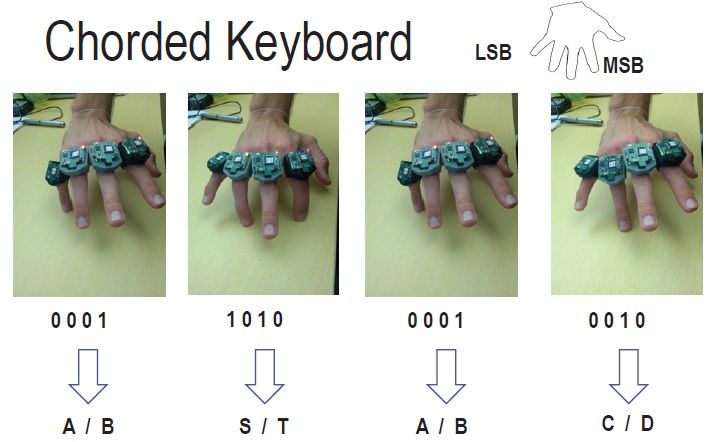

В поисках виртуальной клавиатуры или «интернет вещей» на кончике пальца

«В мире, где дисплей встроен в очки, а компьютер лежит в кармане, вам понадобятся акселерометры на кончиках ваших пальцев. Таким образом вы получите клавиатуру, мышь, да хоть аэрогитару, где бы они вам не понадобились.»

Такова цель одного из пионеров идеи «интернета вещей» (IoT) Криса Пистера, профессора из университета Беркли. Сейчас Крис занят попытками уместить узел IoT (и по совместительству набор сенсоров) на кристалле. И на кончике пальца.

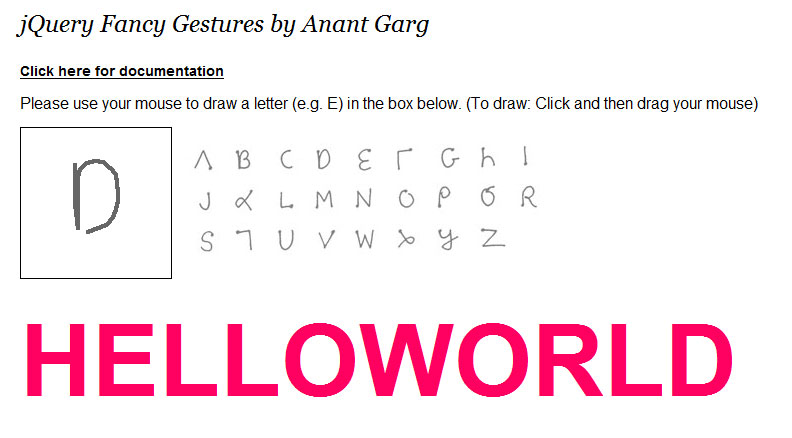

Модные «жесты» jQuery

Возможности

- Можно создавать свои собственные жесты;

- Можно иметь множество областей на странице, которые будут способны распознать жесты;

- Есть визуальная обратная связь;

- Работоспособность во всех основных браузерах.

Благодарности

Этот скрипт инициирован из скрипта распознавания жестов мыши от Didier Brun.

Демонстрация

Запустить демонстрацию распознавания жестов мыши

Скриншот модных жестов jQuery

Safari & Mouse gestures

Но как же быть тем, кто предпочитает Сафари?

Для это есть замечательная программка XGestures. О ней я и хочу рассказать.

Поддержка multi-touch и жестов в Flash платформе

How to crack a self-service terminal and why 80% of them are under threat

I always loved playing with things and testing them under all sorts of wacky conditions as a kid and even considered getting a job as a tester, but I never did. Nevertheless, I still like taking things made by someone else and poking them for vulnerabilities.

I remember, when first self-service payment terminals started popping around town, I saw one of them put up a browser window while updating, and the game was on — I broke it almost immediately. There’s been a lot of discussion about it since then and developers have started to pay a lot more attention towards security in these machines.

Recently, fast-food joints have started installing these terminals. Obviously, it’s quite convenient: just tap a couple of virtual buttons, place an order, pay with a bank card and wait for your number to show on the screen.

Also, nearly every big mall has these interactive boards with floor plans and information on various sales and discounts.

How secure are they?

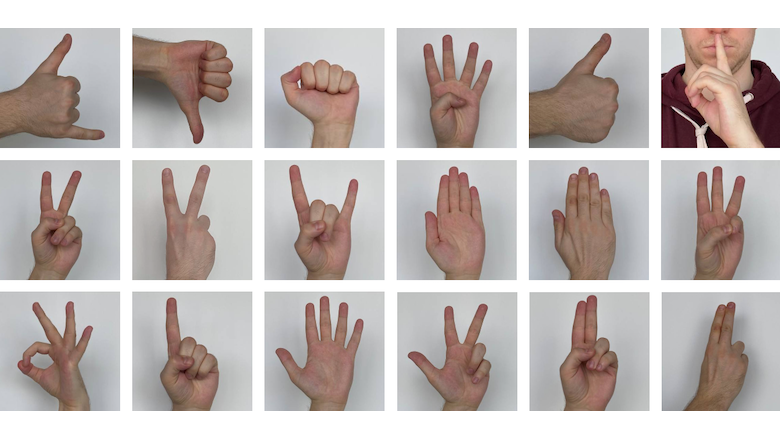

HaGRID — огромный открытый датасет для распознавания жестов

Хороший набор данных невероятно важен при обучении нейросетей. Наш датасет изображений с жестами HaGRID (Hand Gesture Recognition Image Dataset) — один из таких. С его помощью можно создать систему распознавания жестов, которая будет отлично работать в совершенно разных ситуациях. Например, жестовое управление можно использовать в видеоконференциях, для управления устройствами умного дома или мультимедийными возможностями автомобиля. Ещё одна важная возможность — создание виртуальных помощников для пользователей с дефектами речи или использующих язык жестов. Ниже рассказываем, как всё это работает, и делимся ссылками на датасет и набор предобученных моделей к нему.

JavaScript: управление содержимым веб-страницы с помощью жестов

Привет, друзья!

Еще недавно управление содержимым веб-страницы с помощью жестов можно было наблюдать разве что в фантастических фильмах. Сегодня все, что для этого требуется — видеокамера и браузер (и библиотека от Google).

В данном туториале мы рассмотрим 5 примеров:

- получение данных с видеокамеры и их отрисовка на холсте (canvas);

- обнаружение и отслеживание кисти руки;

- управление "курсором" с помощью указательного пальца;

- определение жеста "щипок" (pinch);

- нажатие кнопки с помощью щипка.

Все примеры будут реализованы на чистом JavaScript.

Источником вдохновения для меня послужила эта замечательная статья.

Для обнаружения и отслеживания руки и жестов будет использоваться MediaPipe. Для работы с зависимостями — Yarn.

Код примеров можно найти в этом репозитории.

Легким движением руки

Жесты — это один из самых простых и доступных интерфейсов для управления устройствами и сервисами. Такие системы развивают сейчас не только компании уровня Google и Apple, но десятки стартапов в самых разных отраслях: от медицины до безопасности. Расскажу об этом подробнее