Здравствуйте, уважаемые друзья!

В одной из своих статей я писал о том, как воспринимается и проявляется выгорание. Действительно, по своему воздействию это разрушительный процесс, эффекты от которого человек замечает не сразу, что только усиливает негативные последствия.

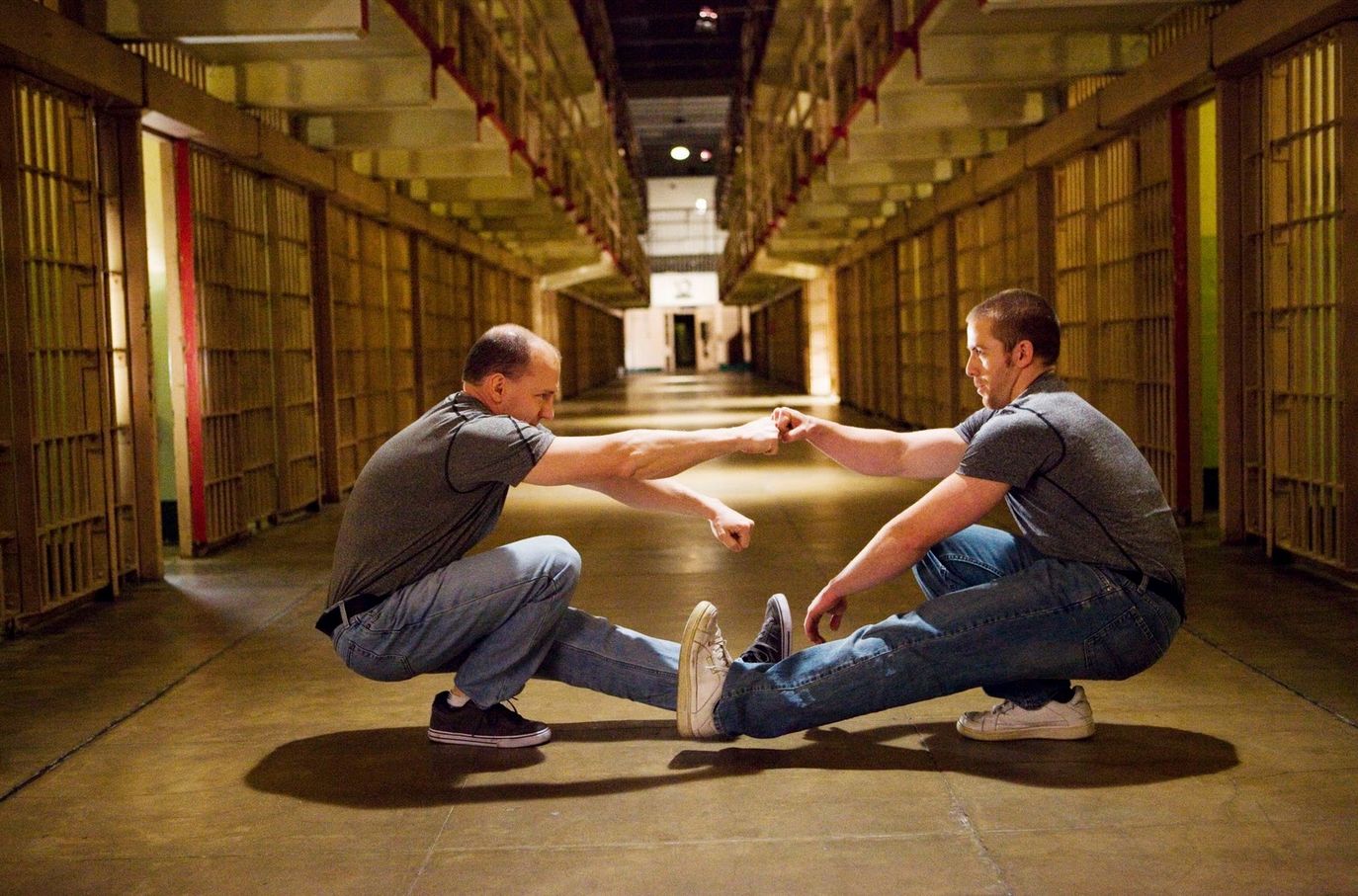

Это длительный процесс работы (и по сути жизни) под давлением, в условиях перерасхода энергии, постоянных перегрузок и периодического эмоционального кризиса, в ходе которого человек испытывается на прочность (и в плане стойкости, и в плане способности меняться – исправлять ошибки своего подхода к распределению энергии).

Так же, как у человека, который долго голодал, происходят изменения в мировоззрении, так и перенесенное выгорание накладывает свой отпечаток на личность человека и его отношение к себе и тому, чем он занимается.

Независимо от контекста, выгорание для человека – это всегда определенные мучения, боль и дискомфорт – и в первую очередь внутренний. Работа на минимуме энергии, через надрыв, когда желание заниматься этой работой уходит, а нагрузки растут – это дает ощущение внутреннего неблагополучия и превращает работу уже в некую форму насилия над собой. По мере развития выгорания этот дискомфорт переходит на внешний уровень и ощущается физически. И чем дальше – тем тяжелее ущерб.

Но такой опыт нельзя воспринимать только как негативный. Это ошибка. Любое значительное событие в жизни или период с высокой отдачей энергии меняет человека.

И выгорание не исключение. Насколько сильно меняет, и в хорошую или плохую сторону – человек выбирает сам, и иногда этот выбор человек совершает значительно позже (после выгорания), анализируя личный опыт и проводя работу над ошибками.