Хабр Курсы для всех

РЕКЛАМА

Практикум, Хекслет, SkyPro, авторские курсы — собрали всех и попросили скидки. Осталось выбрать!

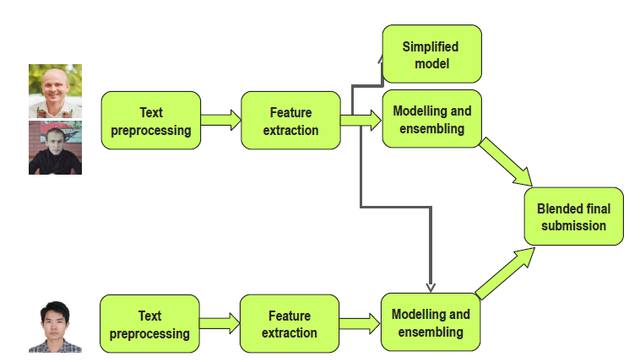

Под объединением/укрупнением команд имеется ввиду объединение независимых результатов (ensembling) и идей на заключительной стадии?

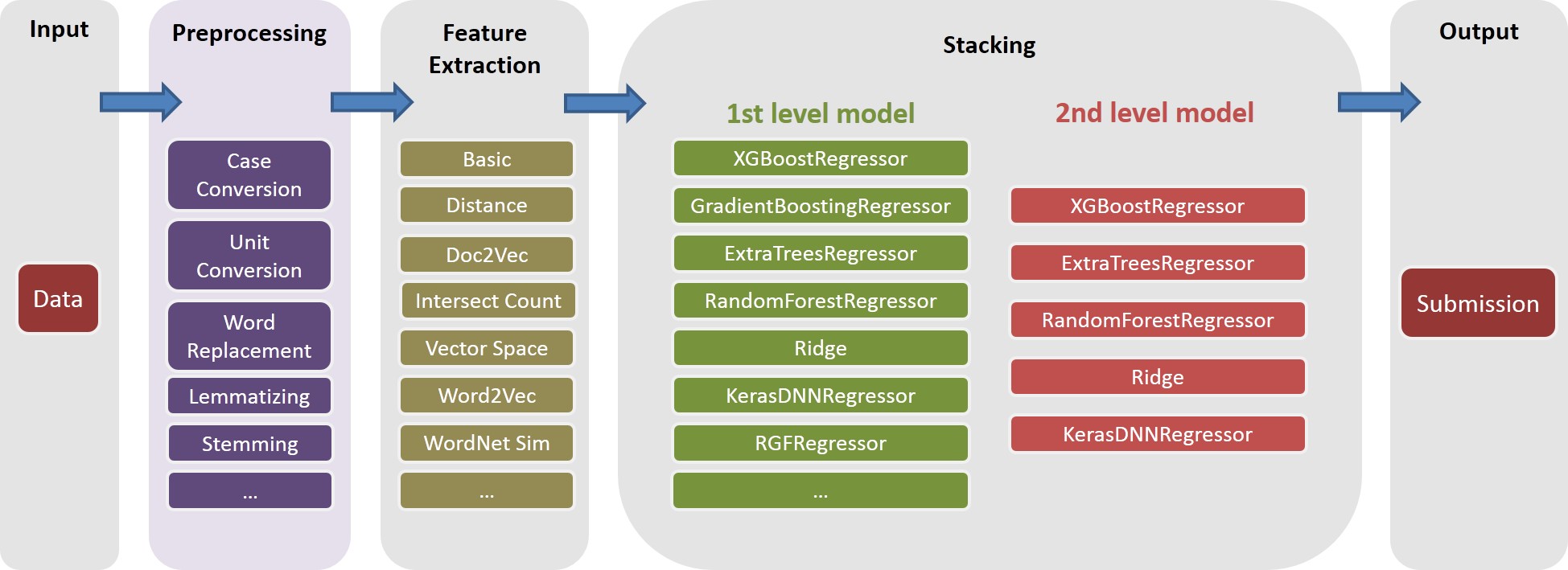

Ваш основной метод построения модели был основан только на xgboost, или Вы использовали и другие пакеты (RF (RandomForest), плюс еще какая-то экзотика на удачу)?

Kaggle: История о том как мы учились предсказывать релевантность поисковых запросов и заняли 3-е место