«С высокоскоростными компьютерами одним воздухом не обойтись»

В кинофильме «Железный человек 2» есть момент, когда Тони Старк смотрит старый фильм своего почившего отца, где тот говорит: «Я ограничен технологиями своего времени, но однажды ты сможешь разобраться в этом. И тогда ты изменишь мир». Это фантастика, но идея, которую она выражает, вполне реальна. Идеи инженеров часто сильно опережают их время. В «Звёздном пути» гаджеты были всегда, но остальному миру пришлось работать несколько десятилетий над тем, чтобы создать планшеты и электронные книги.

Концепция жидкостного охлаждения прекрасно вписывается в эту категорию. Сама идея существует с 1960-х, но она оставалась радикальной по сравнению с куда как более дешёвым и безопасным вариантом воздушного охлаждения. Потребовалось более 40 лет, пока жидкостное охлаждение не начало понемногу развиваться в 2000-х, да и тогда оно было в основном прерогативой любителей ПК, стремившихся разогнать свои CPU далеко за пределы рекомендованных Intel и AMD ограничений.

Сегодня системы жидкостного охлаждения набирают популярность. Такую систему для ПК можно купить меньше, чем за $100, а кустарное производство, нацеленное на промышленное применение и дата-центры (типа CoolIT, Asetek, Green Revolution Computing, Ebullient) предлагает жидкостное охлаждение (ЖО) для серверных. ЖО в основном используют в суперкомпьютерах, высокоскоростных вычислениях или других ситуациях, где требуется огромное количество компьютерной мощности, а процессоры работают почти со 100% загрузкой, но подобные варианты становятся всё более распространёнными.

Существует два популярных типа ЖО: прямое охлаждение чипов и погружное. При прямом охлаждении радиатор крепится к CPU, как у стандартного кулера, но вместо него к нему подсоединяются две трубки. По одной подходит холодная вода, охлаждающая радиатор, поглощающий тепло CPU, а по другой уходит горячая. Затем она охлаждается и возвращается к CPU по закрытому контуру, напоминающему кровоток.

При погружном охлаждении оборудование заливается жидкостью, которая, очевидно, не должна проводить электричество. Этот подход больше всего похож на бассейны охлаждения ядерных реакторов. Погружное охлаждение остаётся более продвинутым вариантом, и требует более дорогих теплоносителей, нежели прямое подключение, где можно использовать обычную воду. Кроме того, всегда существует риск утечки. Поэтому пока что наиболее популярным остаётся вариант прямого подключения.

В качестве одного из основных примеров возьмём компанию Alphabet. Когда эта родительская для Google компания в мае 2018 представила процессоры для ИИ TensorFlow 3.0, директор Сундар Пичаи сказал, что эти чипы настолько мощные, что «впервые нам пришлось установить в дата-центрах жидкостное охлаждение». Эту цену пришлось заплатить Alphabet за восьмикратное увеличение производительности.

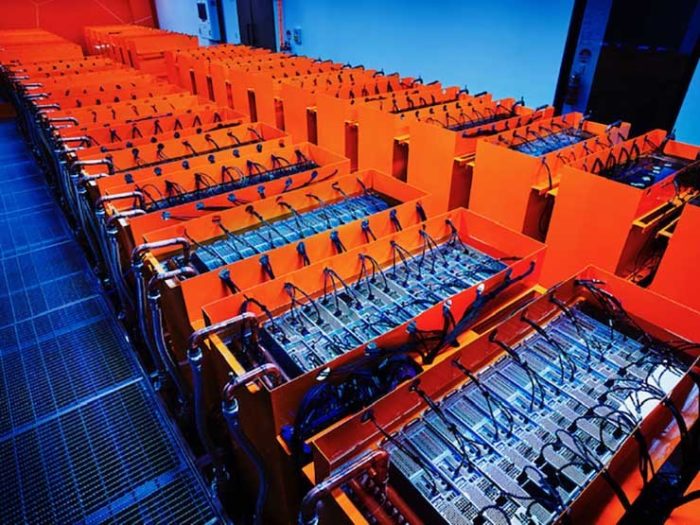

С другой стороны Skybox Datacenters недавно объявила о планах создания огромного суперкомпьютера на 40 000 серверов от DownUnder GeoSolutions (DUG), предназначенного для разведки месторождений нефти и газа. Этот проект будет выдавать 250 петафлопс вычислительной мощности, больше любого из существующих – и ожидается, что серверы будут охлаждаться при помощи жидкости, будучи погружёнными в цистерны, заполненные диэлектрической жидкостью.

В любом случае, «жидкостное охлаждение – это охлаждение будущего, и всегда им будет», — сказал Крэйг Пеннингтон, вице-президент проектного отдела в операторе дата-центров Equinix. «Кажется очевидным, что это правильный подход, но никто его не применял».

Как же ЖО превратилось из эзотерического искусства на рубеже вычислений в практически общепринятый метод в современных дата-центрах? Как и все технологии, это произошло частью в результате эволюции, проб и ошибок, и большого количества инженерных решений. Однако за ЖО сегодняшние дата-центры должны благодарить ранних оверклокеров, являющихся невоспетыми героями этого метода.

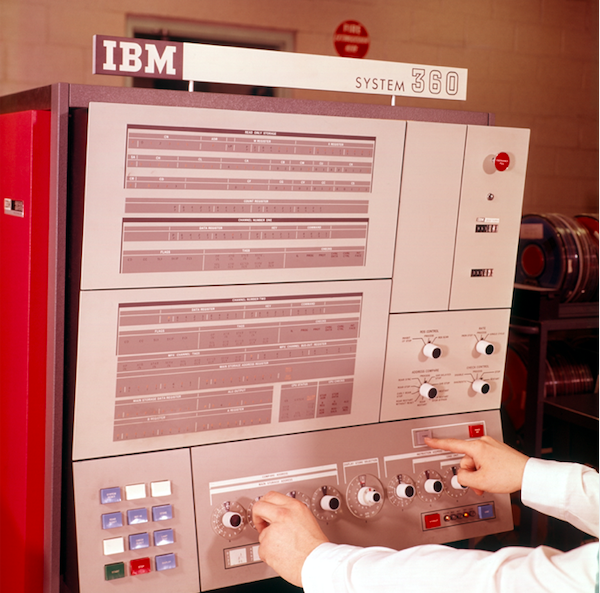

Панель управления системы IBM System 360 обработки данных

Что мы имеем в виду под жидкостным охлаждением

Жидкостное охлаждение стало популярной идеей в 1964, когда IBM изучала вопрос погружного охлаждения для мейнфрейма System 360. Это был один из первых мейнфреймов компании; серии 700 и 7000 существовали более десяти лет, а System/360 «начала эру компьютерной совместимости – впервые позволив разным машинам из продуктовой линейки работать совместно», как пишут в IBM. Концепция была простой: охлаждённая вода должна была протекать через устройство, охлаждающее её до температуры меньше комнатной, а потом воду подавали бы прямо в систему. Схема, использованная IBM, сейчас известна, как заднее охлаждение, когда радиатор крепится сзади мейнфрейма. Устройство засасывало горячий воздух из мейнфрейма вентиляторами, а потом этот воздух охлаждался водой, примерно как радиатор охлаждает двигатель автомобиля.

С тех пор инженеры усовершенствовали эту базовую концепцию, и появилось две доминирующих формы ЖО: погружение и прямой контакт. Погружение – это оно и есть; электроника находится в жидкой ванне, которая, по очевидным причинам, не может быть водной. Жидкость не должна проводить электричество, то есть, быть диэлектриком (такие компании, как 3М даже специально разрабатывают жидкости для этого).

Но у погружения есть много проблем и недостатков. К находящемуся в жидкости серверу можно подобраться только сверху. Поэтому там должны быть расположены внешние порты. Серверное размещение корпусов 1U в стойке был бы непрактичным, поэтому сервера не получится размещать последовательно. Диэлектрик, а обычно это минеральное мало, очень дорогой, и его сложно очищать в случае утечки. Понадобятся особые жёсткие диски, а переделка дата-центра потребует значительных вложений. Поэтому, как в случае с упомянутым выше суперкомпьютером, погружение лучше всего осуществлять в новом дата-центре, а не переделывать старый.

ЖО прямого контакта, напротив, заключается в том, что радиатор (или теплообменник) находится на чипе, как обычный радиатор. Вместо вентилятора в нём используются две водяные трубы – одна приносящая холодную воду для охлаждения, а вторая уносящая горячую воду, нагретую контактом с радиатором. Подобная форма ЖО стала наиболее популярной, её переняли у таких производителей, как HP Enterprise, Dell EMC и IBM, а также у производителей корпусов Chatsworth Systems и Schneider Electric.

Прямое охлаждение использует воду, однако оно очень чувствительно к её качеству. Нефильтрованную воду из-под крана использовать нельзя. Только посмотрите на свой кран или душевую лейку. Никому не нужно накопление кальция в серверах. По меньшей мере для прямого охлаждения требуется чистая дистиллированная вода, а иногда её смесь с антифризом. Изготовление такого теплоносителя – само по себе наука.

Intel’овский связной

Как мы перешли от радиаторов IBM к современным экастравагантным системам охлаждения? Опять-таки, благодаря оверклокерам. На рубеже веков жидкостное охлаждение начало набирать популярность у оверклокеров ПК и любителей, собиравших свои компьютеры, которые хотели повышать скорость их работы за пределы официальных ограничений. Однако это было эзотерическое искусство без стандартных проектов. Каждый делал что-то своё. Собиравшему всё это человеку нужно было быть таким макгайвером, что сборка изделий IKEA казалась полной ерундой. Большая часть систем охлаждения даже не влезала в корпуса.

В начале 2004 года ситуация благодаря внутренним изменениям в политике Intel начала меняться. Инженер из дизайн-центра в Хилсборо, штат Орегон – где проектируется большинство чипов компании, несмотря на то, что её штаб-квартира находится в Санта-Кларе, Калифорния – уже несколько лет работал над особым проектом по охлаждению. Проект обошёлся компании в $1 млн, и был нацелен на создание жидкостного кулера для процессоров от Intel. К сожалению, Intel собиралась его закрыть.

Инженер надеялся на иной исход. Чтобы спасти проект, он пришёл с этой идеей в Falcon Northwest, компанию из Портленда, выпускавшую геймерские надстройки для компьютеров. «Причина состояла в том, что в компании думали, что жидкостное охлаждение подстрекает людей на оверклокинг, а это занятие в то время было под запретом», — сказал Келт Ривз, президент Falcon Northwest. И в такой позиции Intel была своя логика. В то время беспринципные розничные продавцы из Азии продавали разогнанные ПК под видом более мощных, и с плохим охлаждением, и в глазах общественности это каким-то образом превратилось в проблему Intel. Поэтому компания выступала против разгона.

Однако этот инженер из Орегона считал, что если он сумеет найти клиентов и рынок для такого кулера, то Intel в результате уступит. (Кроме того, получившийся у Intel продукт был куда как лучше по качеству, чем то, что имелось на рынке, сказал нам Ривз). Поэтому после определённых внутренних уговоров и переговоров между компаниями, Intel позволила Falcon продавать системы охлаждения – в частности потому, что Intel уже производила их тысячами. Единственным подвохом было то, что Falcon не могла упоминать о том, что в деле участвует Intel. Falcon согласилась, и вскоре стала первым производителем, поставлявшим полностью герметичные системы ЖО в стиле «всё в одном» для ПК.

Ривз отметил, что это передовое решение для ЖО было не особенно дружелюбным для пользователя. Falcon пришлось изменить корпуса, чтобы туда вмещался радиатор, и изобрести пластину охлаждения для воды. Но со временем производители кулеров, например, ThermalTake и Corsair, изучили то, что делала Intel, и занялись последовательными улучшениями. С тех пор появились несколько продуктов и производителей, к примеру, CoolIT и Asetek, специально делавших ЖО для дата-центров. Часть их продуктов – к примеру, трубы, которые не ломаются, не трескаются и не протекают с гарантией до семи лет – в итоге были предоставлены по лицензии производителям систем охлаждения для конечного пользователя, и такой обмен технологиями в обе стороны стал нормой.

И по мере роста этого рынка в разных направлениях даже Intel в итоге поменяла своё мнение. Теперь она рекламирует возможности разгона процессоров серий K и X, и даже не заботится о том, чтобы продавать вместе с топовым CPU для игроманов штатные кулеры.

«ЖО уже опробованная технология – ею занимаются все на стороне потребителя, — сказал Ривз. Intel перестала поставлять штатные кулеры с самыми мощными CPU, потому что им нужно ЖО; это уже доказано и благословление от Intel получено. Не думаю, что найдётся кто-то, кто скажет, что полные решения для этого недостаточно надёжны».

Погружное охлаждение в дата-центре. Короба заполнены диэлектрической жидкостью, которая поступает по трубам

Жидкостное охлаждение от Skybox Datacenters с погружением. Теплообменники погружаются вместе с компьютерным оборудованием, и диэлектрическая жидкость не покидает цистерну. Водяной контур проходит через комнаты и подходит к каждому теплообменнику.

Факты в пользу практичности жидкостного охлаждения

Долгое время в традиционных дата-центрах предусматривали фальшпол с небольшими отверстиями, через которые поднимался холодный воздух, засасываемый серверами. Это называлось CRAC, или кондиционер компьютерной комнаты. Проблема в том, что сейчас уже недостаточно продувать холодный воздух через отверстия в полу.

Основная причина недавнего бума в области жидкостного охлаждения – это необходимость. Сегодняшние процессоры слишком сильно греются, а сервера расположены слишком близко, чтобы воздух мог эффективно их охлаждать, как отмечают даже в Google. Теплоёмкость у воды в 3300 раз больше, чем у воздуха, и водяная система охлаждения способна прокачивать 300 л воды в минуту, по сравнению с 20 кубометрами воздуха в минуту.

Проще говоря, вода может охлаждать гораздо эффективнее и в гораздо меньшем пространстве. Поэтому после многих лет попыток уменьшить энергопотребление, производители процессоров могут разбрасываться мощностью и выкручивать напряжение для максимальной производительности – зная, что жидкостное охлаждение справится с этим.

«Нас просят охлаждать чипы, энергопотребление которых скоро выйдет за пределы 500 Вт, — сказал Джеф Лайон, директор CoolIT. – Некоторые процессоры, ещё не вышедшие на рынок, будут потреблять по 300 Вт. Всё это развивается по запросу ИИ и машинного обучения. Скорости роста уровня охлаждения просто не хватает».

Лайон сказал, что CoolIT рассматривает возможность расширить систему охлаждения до чипсетов, систем регулирования мощности, сетевых чипов и памяти. «Не будет ничего радикального в том, чтобы заняться ещё и памятью, — добавил он. – Есть варианты RAM с продвинутой упаковкой, потребляющие по 18 Вт на DIMM. Типичный DIMM потребляет 4-6 Вт. Среди систем с большим объёмом памяти мы встречаем сервера, где установлено 16, а то и 24 DIMM – а это очень много тепла».

Один за другим производители сталкиваются с такими запросами. Equinix наблюдает, как средняя плотность растёт от 5 кВт до 7-8 кВт, а теперь и до 15-16 кВт, причём некоторое оборудование демонстрирует плотность уже в 40 кВт. «Так что общий объём воздуха, который надо прокачать, становится слишком большим. Это не случится мгновенно, но в следующие пару лет произойдёт фундаментальное принятие жидкостного охлаждения», — сказал Пеннингтон из Equinix.

Немного о погружном охлаждении

Компания Green Revolution Cooling концентрируется на погружном охлаждении, и её директор Питер Поулин говорит, что с точки зрения энергоэффективности погружное охлаждение лучше прямого по двум причинам. Во-первых, со всех серверов удаляются вентиляторы. Только это в среднем уменьшает энергопотребление на 15%. А один клиент компании уменьшил его на 30%.

Есть ещё одно непрямое преимущество устранения вентиляторов: тишина. Несмотря на то, что в серверах часто используются очень маленькие вентиляторы, в серверных ужасно шумно, и находиться в дата-центре неприятно как из-за жары, так и из-за шума. Жидкостное охлаждение делает эти места куда как более приятными для работы.

Ещё одно преимущество – для поддержки системы погружного охлаждения требуется очень мало энергии. Там всего три движущихся части: помпа для циркуляции охладителя, помпа для перемещения его к башне охлаждения, и вентилятор башни охлаждения. После замены жидкостным охлаждением воздушного потребление электричества может упасть до 5% от того, что тратилось на кондиционирование воздуха. «Вы получаете огромное снижение потребления энергии, что позволяет вам делать много всего другого, — сказал Поулнин. – В зависимости от потребителя, дата-центр может быть более энергоэффективным или же уменьшить выбросы углерода, которые ассоциируются со строительством дата-центров».

Факты в пользу энергоэффективности жидкостного охлаждения

Потребление энергии уже довольно давно заботит индустрию дата-центров (Агентство по охране окружающей среды США отслеживает этот показатель не менее десяти лет). Сегодняшние дата-центры – это огромные предприятия, потребляющие, по оценкам, 2% от всей мировой электроэнергии, и выбрасывающие в атмосферу столько CO2, сколько и индустрия авиаперевозок. Поэтому интерес к этому вопросу не угасает. К счастью, жидкостное охлаждение позволяет уменьшать счета за электричество.

Первая экономия происходит из-за отключения кондиционирования воздуха в дата-центре. Второе – устранение вентиляторов. В каждой серверной стойке есть множество вентиляторов, нагнетающих воздух, однако их количество можно уменьшить до небольшого числа или до нуля, в зависимости от плотности.

А с технологией «сухого охлаждения», в которой отсутствует замораживание, можно достичь ещё большей экономии. Изначально охлаждение с прямым подключением прогоняло воду через холодильник, охлаждавший её до 15-25 градусов Цельсия. Но в итоге оказалось, что жидкостные охладители, пропускавшие воду через длинную последовательность труб и вентиляторов, охлаждают трубы, нагревающиеся от горячей воды, и естественная тепловая диффузия также охлаждает воду до достаточной температуры.

«Поскольку этот процесс настолько эффективен, вам уже не надо беспокоиться об охлаждении воды до какой-то низкой температуры, — говорит Пеннингтон. – Тёплая вода всё равно эффективно забирает весь жар у серверов. Не нужен цикл компрессии, можно просто использовать сухие кулеры».

Сухие кулеры также экономят воду. Крупный дата-центр, использующий холодильники, может потреблять миллионы литров воды в год, однако дата-центр с сухими кулерами не потребляет воды. Это экономит и энергию, и воду, что может оказаться весьма полезным, если дата-центр будет расположен в черте города.

«Мы не потребляем большого количества воды, — сказал Пеннингтон. — Если всё аккуратно спроектировать, получится закрытая система. Вода не вливается и не выливается, нужно просто доливать воды где-то раз в год, чтобы цистерны оставались полными. Вы ведь не доливаете воду себе в машину постоянно, вот так и у нас».

Принятие следует за эффективностью

Один реальный пример: Dell, перейдя на жидкостное охлаждение, увеличила эффективность использования энергии (PUE) на 56%, как утверждает Брайан Пэйн, вице-президент по управлению продуктом и маркетингом PowerEdge в Dell EMC. PUE – это отношение энергии, которую необходимо затрачивать на охлаждение системы, к энергии, необходимой для работы системы [на самом деле, это отношение общей энергии, используемой дата-центром, к энергии, которая тратится непосредственно на питание IT-инфраструктуры / прим. перев]. PUE равная 3, означает, что на охлаждение системы тратится в 2 раза больше энергии, чем на питание системы, а PUE = 2 означает, что и на питание, и на охлаждение энергии тратится одинаково. PUE не может быть равна 1, поскольку охлаждение необходимо, но операторы дата-центров одержимы попытками приблизить показатель как можно ближе к 1,0.

Кроме улучшения PUE, увеличение вычислительной мощности, которое получают клиенты Dell, может составлять до 23%, и это не перегружает систему сверх меры. «На основе необходимых вложений в инфраструктуру, мы прогнозируем годовую окупаемость системы, — говорит Пэйн. – Я бы сравнил это с покупкой более энергоэффективного кондиционера для дома. Вы немного инвестируете, но затем со временем ощущаете выгоду по счетам за электричество».

В качестве совершенно иного приверженца жидкостного охлаждения возьмём суперкомпьютерный центр в Огайо, OSC. В этом кластере трудятся 1800 узлов. После перехода на ЖО, как сказал Даг Джонсон, главный системный архитектор, центр вышел на PUE = 1,5. OSC использует внешний контур, поэтому вода выводится из здания и охлаждается до температуры окружающей среды, которая летом в среднем равняется 30 °C, а зимой – гораздо меньше. Чипы доходят до 70 °C, и даже если вода нагревается до 40 °C, она всё равно остаётся гораздо холоднее чипов, и служит своей цели.

Как многие из ранних приверженцев новой технологии, для OSC это всё в новинку. Пять лет назад центр вообще не использовал ЖО, а сегодня оно занимает 25%. В центре надеются, что через три года планка вырастет до 75%, а ещё через несколько лет они полностью перейдут на ЖО. Но даже в сегодняшнем состоянии, по словам Джонсона, для охлаждения центра требуется в четыре раза меньше энергии, чем до перехода на ЖО, и в целом это решение уменьшило общее энергопотребление на 2/3. «Думаю, что процент будет повышаться, когда мы начнём интегрировать в систему охлаждения GPU».

С точки зрения клиента для оценки новой технологии нужно потратить время и энергию – только поэтому такая крупная компания, как Dell вообще согласилась сотрудничать с CoolIT для рекламирования ЖО. Неудивительно, что на первом месте среди беспокойства клиентов остаётся возможность утечки. Однако, несмотря на все колебания, оказывается, что в данный момент у них нет особого выбора, если они хотят достичь наилучшей производительности.

«Страх перед утечками был всегда, — говорит Лайон из CoolIT. – Изменилась ситуация, и теперь других вариантов просто нет. С высокоскоростными компьютерами одним воздухом не обойтись».