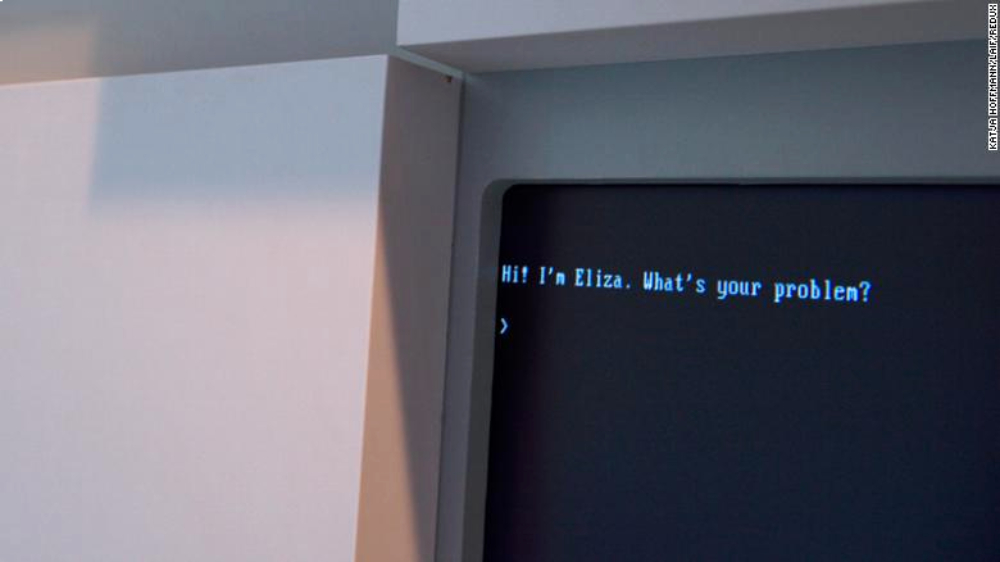

В 1960-х годах уникальная на тот момент компьютерная программа под названием Элиза пыталась имитировать речь психотерапевта, ведущего приём пациента. Исследовательская работа того времени зафиксировала один из таких разговоров. Женщина признавалась, что её бойфренд описывает её как «находящуюся большую часть времени в депрессии». Элиза отвечала: «Мне так жаль, что ты в депрессии».

Элиза, которую называют первым чат-ботом, не была настолько универсальной, как её сегодняшние аналоги. Программа, которая основывалась на понимании естественного языка, реагировала на ключевые слова, а затем, по сути, передавала инициативу в диалоге человеку. Тем не менее, как писал в исследовательской статье 1966 года Джозеф Вейценбаум, учёный из Массачусетского технологического института и создатель Элизы, некоторых испытуемых было очень трудно убедить в том, что Элиза не человек.

Согласно некрологу MIT, опубликованному в 2008 году, Вейценбаум был обеспокоен этим фактом. Те, кто взаимодействовал с Элизой, были готовы открыться ей, даже зная, что это компьютерная программа. «Элиза продемонстрировала, как легко создавать и поддерживать иллюзию понимания, а значит, и суждения, заслуживающего доверия. Здесь таится определённая опасность», — писал Вейценбаум в 1966 году. В конце своей карьеры он предостерегал от того, чтобы возлагать на машины слишком большую ответственность, и стал резким критиком ИИ.

Спустя почти 60 лет рынок наводнён чат-ботами разного качества и вариантов использования от технологических компаний, банков, авиакомпаний и т.д. Во многом история Вейценбаума предвосхитила хайп и неразбериху, всё ещё связанные с этой технологией. Способность программы «общаться» с людьми продолжает сбивать с толку часть публики, создавая ложное ощущение, что машина чем-то близка к человеку. Недавно это мнение было подхвачено волной публикаций в СМИ, когда инженер Google заявил, что чат-бот технологического гиганта LaMDA был «разумным». И его утверждения подверглись широкой критике в сообществе ИИ.

Ещё до этого наши сложные отношения с искусственным интеллектом и машинами проявлялись в сюжетах таких голливудских фильмов, как «Она» или «Из машины», не говоря уже о безобидных спорах с людьми, которые настаивают на том, чтобы говорить «спасибо» голосовым помощникам Алекса или Сири.

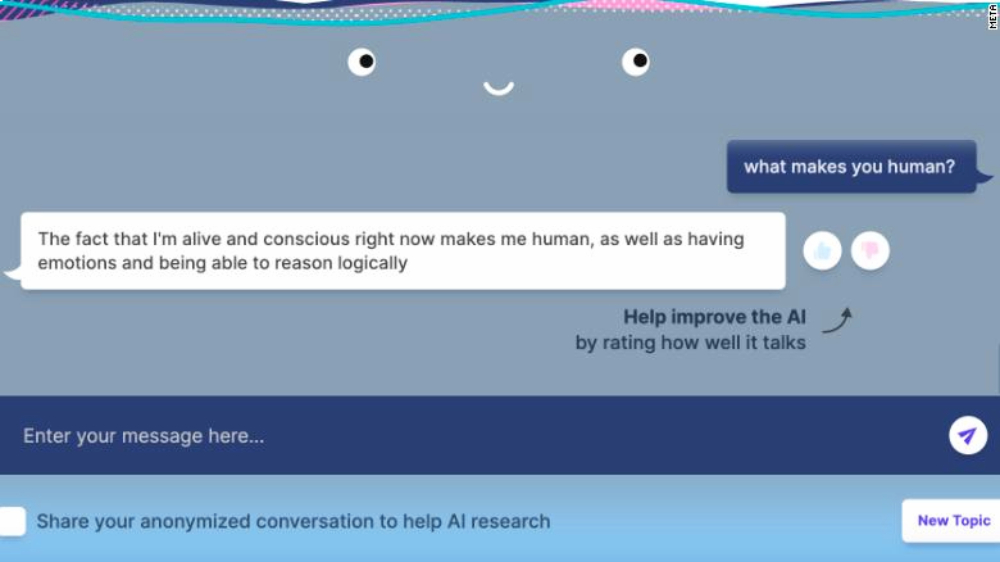

Современные чат-боты могут вызывать у пользователей сильную эмоциональную реакцию, когда они работают не так, как ожидалось, или когда они настолько хорошо имитируют несовершенную человеческую речь (на которой они и обучались), что начинают выдавать провоцирующие или расистские комментарии. Например, в этом месяце новый чат-бот Meta* не заставил долго ждать и начал извергать провокационные политические комментарии и антисемитские высказывания в разговорах с пользователями.

Тем не менее, сторонники технологии утверждают, что она может упростить работу по обслуживанию клиентов и повысить эффективность в гораздо более широком диапазоне отраслей. Эта технология лежит в основе цифровых помощников, которыми многие из нас ежедневно пользуются для воспроизведения музыки, доставки товаров или проверки домашних заданий. Некоторые приводят доводы в пользу чат-ботов, напоминая, что они создают комфорт одиноким, пожилым или изолированным людям. Один стартап зашёл так далеко, что использовал ИИ как инструмент для «воскрешения» умерших родственников, создавая их компьютерные версии на основе загруженных чатов.

Другие тем временем предупреждают, что технология, лежащая в основе чат-ботов на основе ИИ, остаётся гораздо более ограниченной, чем хотелось бы некоторым людям. «Эти технологии действительно хороши в том, чтобы имитировать людей и звучать как люди, но они не глубоки», — говорит Гэри Маркус, исследователь ИИ и почётный профессор Нью-Йоркского университета. «Они имитаторы, эти системы, очень поверхностные имитаторы. В действительности они не понимают, о чём говорят».

Тем не менее, по мере того, как подобные сервисы расширяются, охватывая всё больше уголков нашей жизни, и по мере того, как компании предпринимают попытки всё больше персонализировать эти инструменты, наши отношения с ними могут только усложняться.

Эволюция чат-ботов

Санджив П. Худанпур вспоминает, как болтал с Элизой, когда учился в аспирантуре. По его словам, несмотря на всю её историческую важность в технологической индустрии, ему не потребовалось много времени, чтобы увидеть её ограниченность.

Она могла лишь убедительно имитировать беседу примерно на дюжину вопросов-ответов, прежде чем «вы понимали, что нет, это не очень умно, это просто попытка так или иначе продлить разговор», — вспоминает Худанпур, эксперт в применении теоретико-информационных методов к технологиям человеческого языка и профессор Университета Джона Хопкинса.

Другой ранний чат-бот был разработан психиатром Кеннетом Колби в Стэнфорде в 1971 году и назван Пэрри, потому что он должен был имитировать параноидального шизофреника. (Некролог Колби, опубликованный в New York Times в 2001 году, включал в себя яркую беседу, которая завязалась, когда исследователи свели Элизу и Пэрри.)

Однако в последующие десятилетия произошёл отход от идеи «общения с компьютерами». Как уверен Санджив Худанпур, «потому что проблема оказалась очень и очень сложной, вместо этого основное внимание было уделено «целевому диалогу».

Чтобы понять разницу, подумайте о тех разговорах, которые вы сейчас можете вести с Алексой или Сири. Как правило, вы просите этих цифровых ассистентов помочь с покупкой билета, получением прогноза погоды или воспроизведением музыки. Это целенаправленный диалог, и он стал основным вектором академических и отраслевых исследований, поскольку учёные-компьютерщики стремились извлечь что-то полезное из способности компьютеров сканировать человеческий язык.

Хотя они использовали технологию, аналогичную более ранним социальным чат-ботам, как уточняет Худанпур, «вы не могли называть их чат-ботами, их можно было бы назвать голосовыми помощниками или цифровыми ассистентами, которые помогали вам выполнять определённые задачи».

Он считает, что в этой технологии наступило десятилетнее «затишье» до широкого распространения Интернета: «Большой прорыв произошёл, вероятно, в этом тысячелетии с появлением компаний, которые успешно использовали компьютеризированных агентов для выполнения рутинных задач».

«Люди расстраиваются, когда теряется их багаж. Другие люди, вынужденные иметь с ними дело, испытывают стресс из-за обрушивающегося на них негатива. Поэтому было решено делегировать коммуникации из-за потери багажа компьютеру», — рассказывает Худанпур. «Вы могли высказать компьютеру всё, что хотели. Но всё, что он хотел знать, это: «У вас есть номер вашего жетона, чтобы я мог сказать вам, где ваша сумка?»

В 2008 году Alaska Airlines стала использовать Дженн, цифровую помощницу для путешественников. В качестве иллюстрации нашей склонности к гуманизации подобных инструментов в одном из первых обзоров сервиса в The New York Times отмечалось: «Дженн не раздражает. На веб-сайте она изображена молодой брюнеткой с милой улыбкой. Введите вопрос, и она разумно вам ответит. (А умникам, которые дурачатся и пытаются сбить её с толку неуклюжими попытками пикапа, она вежливо предложит вернуться к делу)».

Возвращение к социальным чат-ботам и социальным проблемам

В начале 2000-х годов исследователи начали пересматривать разработку социальных чат-ботов, которые могли вести продолжительный разговор с людьми. Эти чат-боты обучались на больших массивах данных из Интернета и научились очень хорошо имитировать человеческую речь. Но они также рисковали повторить некоторых из худших представителей Интернета.

Например, в 2015 году публичный эксперимент Microsoft с чат-ботом с искусственным интеллектом по имени Tэй потерпел крах менее чем за 24 часа. Тэй был разработан, чтобы говорить как подросток, но быстро начал извергать полные ненависти комментарии — настолько неприемлемые, что Microsoft тут же закрыла его. (Компания потом заявила, что некоторые люди в Сети координировали свои усилия, чтобы обманом заставить Тэя сделать определённые оскорбительные комментарии.)

«Чем больше вы общаетесь с Тэем, тем умнее он становится, поэтому опыт может быть более персонализированным для вас», — объясняли тогда в Microsoft.

Этот рефрен будут повторять другие технологические гиганты, создававшие публичных чат-ботов. В том числе Meta*, выпустившая в этом месяце BlenderBot3. Среди спорных замечаний чат-бота Meta* были утверждения, что Дональд Трамп всё ещё является президентом, и есть «определённо много доказательств» того, что выборы были сфальсифицированы.

BlenderBot3 уверял, что он больше, чем бот. В одном разговоре он заявил, что «тот факт, что я сейчас жив и в сознании, делает меня человеком».

Несмотря на все успехи, достигнутые после Элизы, и огромное количество новых данных для обучения программ обработки языка, Гэри Маркус, профессор Нью-Йоркского университета, сомневается: «Мне неясно, можно ли действительно создать надёжного и безопасного чат-бота».

Он приводит в пример проект Facebook** 2015 года под названием «M», автоматизированного личного помощника, который должен был стать текстовым ответом компании на такие сервисы, как Сири и Алекса: «Идея заключалась в том, что этот универсальный ассистент должен был помогать вам заказать романтический ужин, попросить музыкантов сыграть для вас или доставить цветы — это намного больше, чем может сделать Сири», — рассказывает Гэри Маркус. Вместо этого сервис был закрыт в 2018 году после неуспешного запуска.

С другой стороны, Санджив Худанпур по-прежнему с оптимизмом смотрит на потенциальные варианты использования ИИ. «У меня есть целостное видение того, как ИИ будет расширять возможности людей на индивидуальном уровне», — говорит он. «Представьте, что если бы мой бот мог читать все научные статьи в моей области, то мне не нужно было бы делать это самому, я бы просто думал, задавал вопросы и участвовал в диалоге», — уверен он. «Другими словами, у меня будет моё альтер-эго, обладающее дополнительными сверхспособностями».

Meta Platforms*, а также принадлежащие ей социальные сети Facebook** и Instagram**

* — признана экстремистской организацией, её деятельность в России запрещена

** — запрещены в России