Привет, Хабр! Меня зовут Сергей Нотевский, я AI Platform Lead в Битрикс24. Моя команда отвечает за модельки под капотом наших AI сервисов.

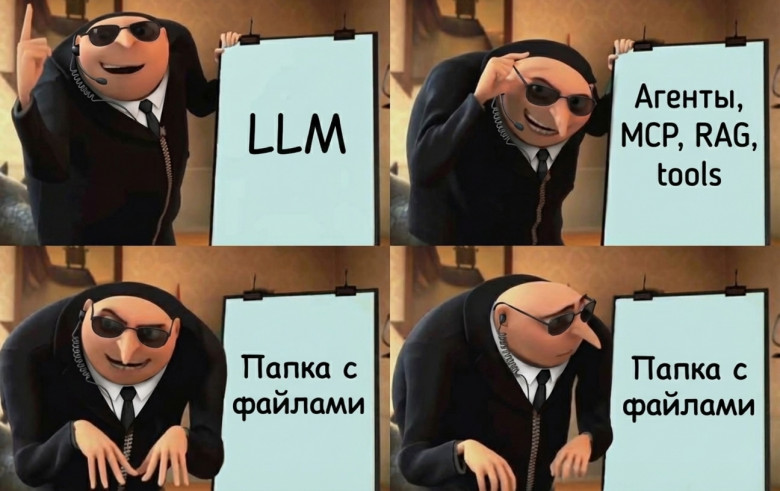

Агенты, агентные системы, agentic AI - эти слова сейчас повсюду. Мы сами делаем своего агента, Марту AI. Но последние пару месяцев я все чаще слышу от коллег и читателей один и тот же вопрос: «Серёж, объясни по-простому - что это такое? Я запустил 100 вызовов LLM подряд, это уже агент? А если добавил RAG? А с поиском?»

В итоге, на нашей внутренней AI-конференции я выступил с докладом на эту тему, и по мотивам родилась эта статья.

На самом деле, сложность начинается с того, что у нас нет общепринятого стандарта: что считать AI-агентом, а что нет. Есть десятки определений, статей и докладов, но многие формулировки порождают больше вопросов, чем ответов.

В этой статье я не буду придумывать ещё одно академическое определение. Вместо этого мы соберём рабочую интуицию: как «просто LLM», «workflow» и «агент» связаны между собой и где проходит граница. А разбираться будем на живом примере всем уже известной функции - Deep Research.

Итак, типичное описание:

AI-агент - это интеллектуальная программа, которая умеет выполнять задачи по заданному сценарию, используя нейросети.

В отличие от чат-ботов, AI-агент «думает» и реагирует на контекст, принимает решения, запускает действия и учится по ходу работы.

Звучит красиво, но мало помогает.