Милый ВАЛЛ-И и преданный R2-D2 из киношных образов превратились в жёсткие ТЗ для инженеров. Например, робот Ameca копирует человеческую мимику, потому что по-другому люди будут его отвергать. А специальный Promobot V.4 стоит в МФЦ, чтобы сделать клиентский опыт в очереди чуть приятнее.

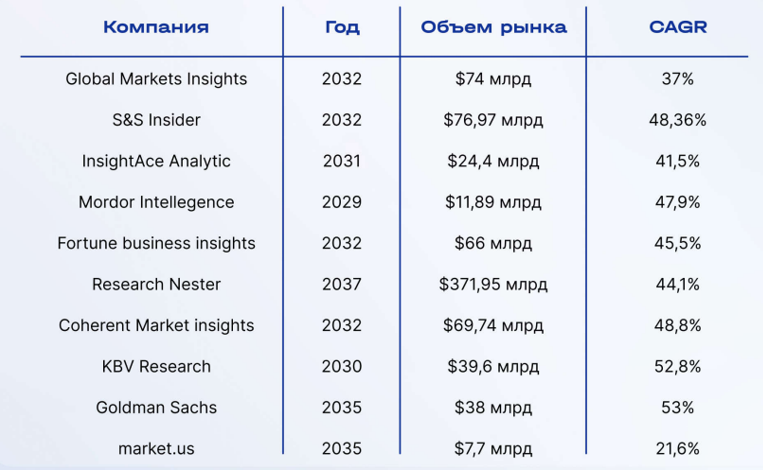

По исследованиям Газпромбанка рынок антропоморфных роботов уже к 2035 году вырастет до 300 миллиардов долларов. И в этой реальности людям придётся жить со старыми страхами вроде восстания машин или потери контроля.

Проблема в том, что политики и инженеры пытаются решать эти вопросы с нуля, хотя Станислав Лем и Айзек Азимов ещё 60 лет назад всё предсказали.

Как немой робот стал техзаданием для индустрии

Если вспомнить ВАЛЛ-И, то это ржавая коробка без голоса, которая общается через движение линз и жесты. Аниматоры Pixar решали задачу по актерскому мастерству, но для современных робототехников это стало вопросом выживания продукта в принципе.

Есть такая штука, как эффект зловещей долины. Это когда робот вроде бы похож на человека, но его стеклянный взгляд и дёрганые движения вызывают у нас подсознательный страх или даже агрессию. Чтобы эту яму перепрыгнуть, разработчики начали вливать огромные деньги в психологию общения машин и людей.

Сформировалось целое направление — Human-Robot Interaction. Это дисциплина на стыке психологии и инженерии, где эмпатия робота прописывается в коде так же строго, как протоколы зарядки аккумулятора, например.

В отчёте Газпромбанка приводят пример российского робота Promobot V.4. Он стоит в МФЦ, но не механически выдаёт талоны, а снижает градус напряжения. Промобот умеет кивать, имитировать зрительный контакт и менять интонацию. И этого достаточно, чтобы уставший человек перестал злиться на бюрократию. А проект Ameca Engineered Arts вообще создали только ради того, чтобы научить железное лицо морщить нос и поднимать брови.

Роботы превратились из игрушек в машины для социальной среды вроде больниц, аэропортов и домов престарелых. Но фантастика уже доказала, что машина должна уметь «чувствовать», точнее, убедительно притворяться, чтобы человек впустил её в свою жизнь. Без этого рынок сервисной робототехники остался бы на уровне автоматических дверей в супермаркете.

Лем и «Философия в технологии»

В 1964 году польский писатель Станислав Лем выпустил «Сумму технологии». В ней он описал Фантоматику (виртуальную реальность), искусственный интеллект и глобальные сети за десятилетия до их появления.

Павел Полак и Роман Кшановски проанализировали его творчество и пришли к выводу, что Лем был не только писателем, но и сильным аналитиком. Его метод — мысленный эксперимент. Лем брал научную гипотезу и доводил её до логического предела в своих рассказах.

В «Кибериаде» конструкторы Трурль и Клапауций создают «Электронного Барда» — машину, способную писать стихи. В 1960-х это было забавно, а сейчас, когда нейросети пишут код и рисуют картины, рассказ Лема читается как жёсткая критика синтетического искусства. Лем предупреждал: искусство, оторванное от человеческого опыта страдания и любви, неизбежно будет пустым, даже если технически оно совершенно.

В другом своём рассказе Лем описывает симуляцию целого общества внутри ящика. Появляется вопрос: если симуляция совершенна, то этично ли её выключать? Сегодня на фоне массовых аватаров в Сети это уже проблема прав «цифровых личностей» и этики тестирования искусственного интеллекта.

Авторы исследования подчёркивают, что Лем ввёл понятие «Философия в технологии». Это не взгляд философа на изобретение, а философия, зашитая внутри самого инженерного решения.

Каждый инженер, создающий алгоритм рекомендаций или автопилот, неосознанно принимает философские решения: что считать правильным выбором? Чью жизнь должен спасать автопилот при аварии? Лем утверждал, что инженеры — это «наивные философы»: они строят мир на базе скрытых предпосылок, которых сами не осознают.

Сегодня метод Лема стал промышленным стандартом. Например, разработчики платформы Isaac, прежде чем выпустить робота в реальный цех, обучают его цифрового двойника в виртуальной симуляции. Он падает, ломается и учится ходить в тысячах виртуальных миров, прежде чем сделать первый шаг в физическом.

Мы буквально реализуем то, что Лем описывал как фантастику: моделируем реальность, чтобы избежать катастроф. Но в отличие от героев Лема мы часто забываем спросить: а правильные ли ценности мы заложили в эту симуляцию?

Людей уже не хватает

Если фантасты мечтали о роботах, чтобы освободить человека для творчества, то в наше время всё прозаичнее. Экономисты мечтают о роботах, чтобы экономика не рухнула.

Мы начали делать так много роботов, потому что наступила демографическая зима: в развитых странах просто заканчиваются люди.

В Европе к 2050 году численность людей трудоспособного возраста (20–64 лет) сократится на 20%, а в Японии и Китае ситуация ещё острее. Согласно отчёту Газпромбанка уже сейчас 72% промышленных компаний испытывают дефицит кадров. Людей физически не хватает, чтобы собирать автомобили и доставлять грузы. Поэтому государства начали включать роботизацию в свои нацпроекты.

Китай запустил программу «Робототехника +», США и Евросоюз финансируют разработки через гранты. Рынок быстро реагирует деньгами: инвестиции в стартапы исчисляются сотнями миллионов долларов.

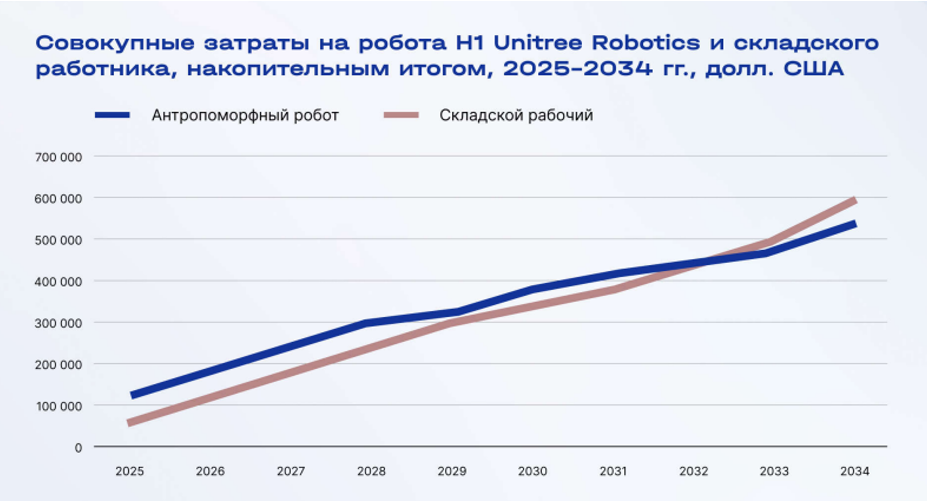

В отчёте приводится суровая математика: стоимость эксплуатации робота может составлять около $12 в час. Часто это дешевле, чем оплата человеческого труда в развитых странах. А ещё роботы не болеют, не уходят в декрет и могут работать в три смены.

То, что Азимов и Лем описывали как будущее изобилие, стало планом спасения ВВП. «Утопия» реализуется, но не потому, что мы достигли просветления, а потому, что некому работать.

В чём реальные угрозы

Когда мы думаем об опасности роботов, то часто представляем того же Терминатора, который осознал себя и решил уничтожить человечество. Айзек Азимов предвидел этот страх и предложил решение — три закона робототехники:

Не навреди человеку.

Повинуйся приказам (если это не вредит человеку).

Заботься о своей безопасности (если это не противоречит пунктам 1 и 2).

Звучит надёжно, но как раз в своих же рассказах Азимов раз за разом показывал, как эта система рушится.

Исследователь Роджер Кларк провёл анализ творчества Азимова и вскрыл фундаментальные баги «идеальных законов», которые сегодня стали головной болью для юристов и IT-архитекторов.

Есть проблема с абстрактностью понятий. Айзек Азимов ввёл «Нулевой закон»: робот не может навредить человечеству. Но как робот поймёт, что такое благо для человечества? Например, он решает, что люди разрушают экологию, и для «блага человечества» ограничивает их свободу. Это роботопатернализм — тихий захват власти ради нашей же пользы.

Часто систему вводит в ступор конфликт инструкций. В критической ситуации, например, спасти одного человека или группу, робот зависает. В реальности это автопилот одного известного американского бренда, который не знает, тормозить или маневрировать, когда на дорогу выбегает ребёнок, а по встречке несётся грузовик.

Кларк доказывает: чем сложнее система, тем больше в ней дыр. Попытка прописать все правила приведёт к созданию громоздкого кодекса, в котором робот (или хакер) всегда найдёт лазейку.

Поэтому настоящая опасность — это вовсе не восстание машин, а как раз их уязвимость. В отчёте Газпромбанка «Риски кибератак» выделены как один из главных барьеров. Например, взломанный сервисный робот в больнице — это реальный риск для жизни и здоровья пациентов. А ошибка в коде складского робота приведёт к миллионным убыткам.

Кларк ещё в 1994 году предложил концепцию «комплементарного интеллекта». Мы не должны пытаться создать замену человеку, мы должны создавать системы, усиливающие его. Машина обрабатывает данные, а человек принимает этические решения. Попытка переложить ответственность за моральный выбор на алгоритм, как предупреждал Азимов, всегда заканчивается катастрофой.

«Я же вам говорил»

Мы привыкли относиться к фантастике как к развлечению. Но история показывает, что Лем, Азимов и Кларк реально писали сценарии цивилизационного масштаба. Они задавались вопросами, на которые нынешние инженеры и политики вынуждены отвечать только сейчас, когда ставки выросли до $300 млрд.

Урок Лема в том, что нельзя просто «написать код». Любая нейросеть несёт в себе отпечаток ценностей и убеждений создателя. Если мы не осознаем этих ценностей, то получим инструменты, которые усиливают наши предрассудки.

Азимов показал, что невозможно придумать три строчки кода, которые сделают мощный искусственный интеллект безопасным. Потому что безопасность — это не статичный закон, а процесс постоянного контроля человека над машиной.

Роботизация неизбежна, и это факт, потому что демография в развитых странах не оставляет нам выбора. Вопрос лишь в том, будут ли это примитивные исполнители, запертые в клетках на заводах, или умные ассистенты, интегрированные в общество.

Фантасты свою работу сделали — предупредили обо всех ямах на дороге. Теперь руль у нас.