Комментарии 12

смутило количество участников, нет так и есть

Да, 1488 человек для BCG - не огромная выборка. Я тоже обратил на это внимание, поэтому и полез в ActivTrak где 163 тысячи сотрудников и замеры а не самоотчет. Паттерн похожий, хотя конечно прямого сравнения этих двух исследований нет

Освоение высокоэффективных инструментов - путь в одну сторону. Обратно возвращаться сложно.

Думаю, что у меня нет такой проблемы с ревью, потому что я работаю над небольшим количеством задач и работаю на архитектурном уровне, каждый файл перечитывая и перепроверяя по 5-10-20 раз. Сказать, что что-то в нем пропущено и "не проверено" - это точно не про мои задачи.

Однако с деградацией навыков согласен полностью. И это не деградация "не практиковать". Такая деградация на важных навыках происходит очень и очень долго. Можно через 10 лет сесть на велосипед - и ты поедешь не задумываясь. Потому что этот навык не обесценивается со временем, он законсервирован и он "ждет своего момента"

В случае с ИИ это не деградация навыков. Тут нужно быть честным с самим собой, так как ответ "немного более страшный". Мы с каждым использованием ИИ осознаем, что старые навыки "не эффективны", это не деградация, а обесценивание. И это, к сожалению, однонаправленный процесс. Можно поддерживать "ручную практику", однако это насилие над собой. Мозг все так же обесценивает их, а мы лишь "держимся за соломинку", надеясь, что ручная работа оставит в нас "старую эффективность".

Мне кажется, что ответ, "разумный выход", тут иной. Если мы считаем, что какая-то часть навыка нам необходима, то важно придумать этому навыку эволюционный путь, как его не "не потерять", а как его "преобразовать" в новый вариант, который подходит под вызовы нового времени.

Это может быть выход на фундаментальный уровень (понять принципы тестирования и ревью) и потом уже переброски их на сферу работы с ИИ. А может разграничение обязанностей и борьба с ленью (вычитка принудительная по 10 раз)

Мое мнение - мы не можем остановить обесценивание навыков. И чтобы оставаться гибким и продуктивным, нужно работу с ИИ превратить в обучение, в развитие прошлых навыков, выход на фундаментально тот, но качественно новый уровень вовлеченности и результативности.

Хорошее разделение - деградация vs обесценивание. Я писал про деградацию в терминах

Bainbridge, но у тебя точнее описано что происходит на практике. Мозг не "забывает" как деплоить - он просто отказывается тратить на это усилия, потому что знает что AI быстрее.

Про насилие над собой при ручной практике - частично соглашусь. Если заставлять себя писать код руками "для тренировки" - да, это бессмысленно. Но у меня немного другая логика: я не практикуюсь специально, а просто не отдаю AI мелочи где объяснять контекст дольше чем сделать самому. И в эти моменты навык поддерживается сам собой, без усилий.

А вот про эволюцию навыков - это то, к чему я пришел но не сформулировал. Навык ревью сейчас

это не "прочитать каждую строку", а "понять что именно AI мог пропустить". Другой скилл, но растёт из того же корня.

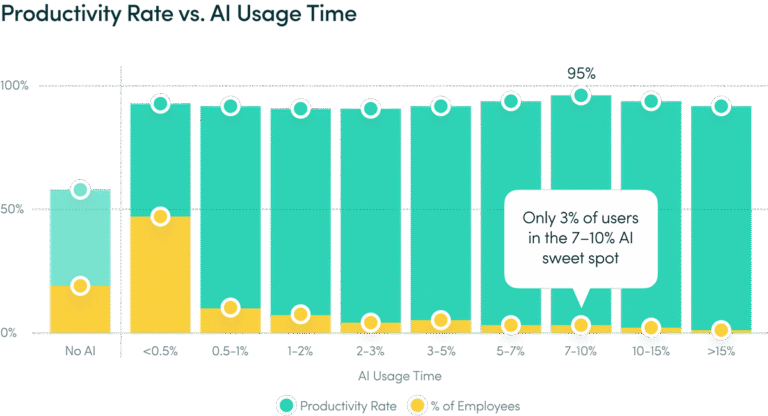

ActivTrak нашли интересную корреляцию: люди, у которых AI-инструменты занимают 7-10% рабочего времени, показывали 95% по шкале продуктивности - лучше всех остальных групп. Это не значит «используй AI ровно 7%» - это корреляция, не рецепт. Но любопытно, что таких людей оказалось всего три процента.

видно, что остальные не так уж отстают и показатели близки к стат-погрешности.

Два инструмента - и это осознанный выбор, а не экономия. Claude Code пишет, Codex ревьюит и проверяет ТЗ. Не два генератора, а генератор + верификатор. По данным BCG, после третьего тула продуктивность проседает - и я это чувствую, когда добавляю что-то ещё в стек.

Вопрос только в том, что считать тулом. Дополнительный MCP в Claude Code, выходит, не тул? А если я не на Claude Code, а на Cursor, где и есть и Claude и GPT модели, сколько у меня тулов?

Справедливый вопрос, граница размытая. Я для себя считаю "тулом" отдельный интерфейс куда ты переключаешься - другое окно, другой контекст, другой флоу. MCP внутри Claude Code это расширение того же инструмента, ты не переключаешь голову. А вот если ты открываешь Cursor в одном окне и ChatGPT в другом и прыгаешь между ними - это два тула, потому что каждый переход стоит когнитивных ресурсов.

По этой логике Cursor с двумя моделями внутри - один тул. Ты работаешь в одном интерфейсе и модель переключается под капотом. Но если ты параллельно ещё открываешь ChatGPT чтобы "перепроверить" - уже два.

Предположу что описанный Brain Fry коррелирует больше с необходимостью частого переключения контекста нежели с AI инструментами. И до LLM можно было словить подобное занимаясь множеством вещей, требующих хорошей концентрации, и постоянно переключаясь между ними. Из позитивного - данный навык немного тренируется (при достаточном количестве отдыха) но все равно - лучше не держать под контролем слишком много вещей одновременно.

Больше AI-инструментов — не всегда больше продуктивности. BCG и ActivTrak объясняют почему