upd: В качестве продолжения этого текста: Очерк о приключениях сознания в математической вселенной Тегмарка

С древних времен считалось, что в феномене сознания есть что-то непонятное. Что-то непостижимое. Считалось, что сознание есть проявление нематериального, привнесенного высшими силами. Если для мифологического мировосприятия такой порядок вещей естественен, то со сменой парадигм и зарождением естествознания феномен сознания потребовал объяснения.

Естествоиспытатели чувствовали, что мир подчиняется определённым законам, но отсутствие достаточной информации не позволяло сразу перейти от мифологического мировоззрения к научному. Машинерия мира поддерживалась богами и духами. Ремесленники и механики прибегали к методам одобренным небесными покровителями и если работа была сделана правильно то и результат выходил достойным. Технология являлась магическим ритуалом. Даже то, что большинство проявлений природы можно логично описать материальными причинами, было далеко не очевидным.

Однако с течением времени наблюдений копилось всё больше, а необходимость в богах становилась всё меньше. Процесс шёл постепенно и не быстро, что выразилось в долгих веках господства концепции дуализма бытия [1]. Мир разделён на материальное и нематериальное, то есть на то, что мы можем объяснить без божественного проявления и то, чего без божественного проявления мы объяснить не можем. В этой парадигме нематериальное существует как бы само по себе. Сознание — феномен, который крайне плохо поддаётся материалистическому осмыслению очевидно должен быть привнесён из нематериального мира. Из принадлежности сознания к миру идеального логично вытекает идея возможности существования души вне тела, откуда не сложно довести рассуждение до концепции бессмертия души.

Влияние материализма росло, но пока боги лакун отступали за горизонт, твёрдый камешек сознания не желал трогаться с места. Шли годы. Пролетела эпоха географических открытий, отгремела промышленная революция.

Попытки физиологов найти в мозге исток сознания давали противоречивые и странные результаты. Складывалось впечатление, что хотя именно мозг продуцирует сознание, но сознание не локализовано в мозге, а как бы распределено в нем, причем в одном мозге может обитать несколько не связанных друг с другом сознаний и более того, сознание может расщепляться прямо по ходу пьесы. Наиболее значительные физиологические результаты удалось получить из исследований пациентов с теми или иными нарушениями работы мозга. Инцидент Г.М. [2] доказал, что функция долговременной памяти реализуется мозгом, а исследования пациентов с рассечёнными мозолистыми телами показали, что с двумя разделёнными полушариями мозга можно поговорить независимо [3]. Эксперименты показывали что сознанию свойственно патологически искажать реальность. Выяснилось, что сознание не в ладах со временем, неадекватно оценивает пространство, дорисовывает то, чего не видят глаза и не слышат уши, игнорирует объекты под собственным носом, может прямо по ходу дела править собственную память и вообще ведёт себя отнюдь не так просто, как нам бы хотелось.

Развитие информатики и задача искусственного интеллекта ставили вопрос ребром. Не далёк день, когда компьютер заявит свои интеллектуальные права на научное исследование, а мы до сих пор не сошлись, может ли у куска кремния быть душа и на каком основании выдавать роботу гражданство?

Алан Тьюринг в статье «Вычислительные машины и разум» (1950 г.) [4] предложил вместо вопроса о наличии или отсутствии у машины способностей к мышлению рассмотреть вопрос о том, "может ли вычислительная машина достойно играть в имитацию", который в силу универсальности вычислительных машин сводит к вопросу:

Если взять только одну конкретную цифровую вычислительную машину Ц, то спрашивается: справедливо ли утверждение о том, что, изменяя емкость памяти этой машины, увеличивая скорость ее действия и снабжая ее подходящей программой, можно ли заставить Ц удовлетворительно исполнять роль А в „игре в имитацию"? (Где А — это человек)

Из текста работы не совсем понятно, как соотносятся понятия "мышление", "интеллект" и "сознание", но по прочтении работы возникает ощущение, что по Тьюрингу эти понятия в достаточной степени тождественны.

Статья Тьюринга утвердила в кибернетике то, что сейчас принято называть бихевиористическим подходом, при котором наличие или отсутствие у объекта интеллекта или сознания оценивается только и исключительно по поведению объекта.

Спустя 30 лет Джон Сёрл формулирует тезис "китайской комнаты" [5], в котором указывает на то, что между разумным поведением и наличием интеллекта может не быть прямой связи. Тезис Сёрла породил большую волну обсуждения и по-видимому, не всегда был правильно понят. Критика тезиса сводится к тому, что хотя сам исполнитель может не понимать сути работы, но вся система из комнаты, исполнителя и инструкции может иметь осмысление ведущегося диалога, а значит тезис китайской комнаты ничего не показывает. Возможно, тезис следовало бы переформулировать в более крайнем не допускающем трактовок правил варианте: Пусть инструкция представляет собой достаточно длинный условный автомат с тривиальным состоянием в виде запомненной последовательности входных данных. Подобные конструкции мы используем повсеместно в инженерной практике, например при парсинге пакетов в сетевых протоколах. Такой автомат может играть в имитацию, хотя язык не поворачивается назвать его разумным. Автомат не покроет всех возможных вариантов развития событий, но при достаточной длине и вложенности switch-case-if-else конструкции может с высокой вероятностью обманывать экзаменатора разумное время. То есть, за разумное конечное время экзаменатор не сможет распознать подвох, если условная конструкция будет правильно спроектирована, а экзаменатор не будет осведомлён о принципе её работы. Это показывает, что хорошей игры в имитацию недостаточно для обладания сознанием или же интеллектом.

Очевидным способом построения системы, способной решить тест Тьюринга является копирование человеческого мозга. Человечество так и не сошлось во мнении возможно ли реализовать процессы происходящие в мозге на иной вычислительной архитектуре. Невозможность реализации на иной архитектуре, представляющей универсальную машину Тьюринга означала бы, что в мозге есть что-то вне теории алгоритмов. Таких механизмов в мозге до сих пор не нашли и пока нам придётся руководствоваться тем, что всё что происходит в мозге, может быть при должном старании, объёмах памяти и быстродействии промоделировано на компьютере. Возражение о том, что мозг принципиально аналоговый или принципиально импульсный отвергаются тем соображением, что дискретная система может имитировать аналоговые и импульсные системы с любой наперёд заданной точностью. Но будет ли дискретная копия мозга обладать сознанием?

На сегодняшний день исследователи так и не выработали принципиальной позиции по вопросу того, что есть такое сознание. Невозможность формализовать сознание дошла до крайних форм, в которых утверждается, что сознания вообще не существует. Этот тезис выдвигается крайне авторитетными и известными широкой публике людьми, такими как философ Дениел Деннет [6]. Тезис может казаться парадоксальным и явно противоречит субъективному опыту того, кто прямо сейчас читает этот текст. Но вывод этот, на самом деле предельно логичен и является следствием применения научного метода к вопросу сознания. Научный метод не приемлет субъективных оценок, а о наличии сознания мы знаем только из субъективных ощущений. У нас есть довольно богатый опыт научных опровержений субъективных, не подтверждаемых объективными фактами, переживаний. Так почему бы сознанию не последовать за прочими, переставшими быть актуальными метафизическими концептами?

Способ, которым не существует сознание

Прежде всего, надо уточнить значение слова "существование". Джордж Беркли (1685 — 1753), человек, который, по видимому, лучше прочих прочувствовал значение бытия, сказал: "существовать — значит быть воспринимаемым". Это солипсистическое утверждение и оно более подходит к субъективному восприятию, которое плохо вяжется с научным методом. Если воспользоваться этим же определением, но переформулировать его относительно объективных явлений, это будет звучать как: "существовать — значит быть объективно наблюдаемым". Это определение существования через возможность наблюдения. Мы можем пронаблюдать, как работает мозг, но объективно пронаблюдать, зарегистрировать датчиками, записать на плёнку работу сознания мы не можем. Значит объективно сознание не существует.

В одной из книг о конструкторах Трурле и Клопауции, "Путешествие третье, или Вероятностные драконы" [7], Станислав Лем даёт введение в общую теорию драконов:

Как известно, драконов не существует. Эта примитивная констатация может удовлетворить лишь ум простака, но отнюдь не ученого; банальность бытия установлена слишком давно и не заслуживает более ни единого словечка. Гениальный Цереброн Эмдеэртий, атаковав проблему методами точных наук, установил, что имеется три типа драконов: нулевые, мнимые и отрицательные. Все они, как было сказано, не существуют, однако каждый тип — на свой особый манер. Мнимые и нулевые драконы, называемые на профессиональном языке мнимоконами и нульконами, не существуют значительно менее интересным способом, чем отрицательные.

Похоже, что сознание — это нечто сродни отрицательному дракону. Раз оно не существует, но мы тысячи лет продолжаем ломать копья при его обсуждении, то очевидно, не существует оно крайне элегантным и интересным способом.

Проведём мыслительный эксперимент. Пусть существует мир, тождественный нашему, и населённый философскими зомби. То есть, людьми, не обладающими феноменом самопереживания. Но при этом поведение этих людей полностью тождественно нашему. Допустим я живу в этом мире, я философ и пишу книгу о том, как я, наблюдаю и чем руководствуюсь в своих поступках. Я сажусь к своему столу и начинаю описывать:

Когда я смотрю в каком-либо направлении, я получаю некоторую информацию, складывающуюся в образы предметов окружающих меня. Если случается предмету упасть, я регистрирую информацию об этом в виде некоторого звукового ряда. Я обладаю знанием геометрического пространства вокруг себя и потому не натыкаюсь на препятствия. Но постойте… Уж не феномен ли субъективного переживания сознания я описываю?

Философский зомби противоречив. Если бы он не имел сознания, он бы не смог описать своего восприятия, то есть его поведение отличалось бы от поведения человека. Как можно описать то, о чем не знаешь? То, что не влияет на твоё поведение описать невозможно, потому что описать — это поведение. Конечно есть вариант, что зомби — патологический лжец и заранее знает что нужно писать, хотя реально ничего субъективно не испытывает, но такое условие уводит нас от вопроса возможности существования эквивалента человека без сознания к задаче построения хорошо обманывающего зомби (см. тезис Сёрла) и никуда дальше не ведёт. Нас интересует другой тип зомби, а именно тот, которому есть что писать.

Я утверждаю, что для того, чтобы решить задачу написания книги о своих субъективных переживаниях, нужно строго однозначно обладать субъективными переживаниями своих субъективных переживаний. То есть, самосознанием. Это значит, что если робот сможет рассказать о том, как он воспринимает мир и принимает решения, не обращаясь при этом к заранее заготовленным ответам, то такой робот должен будет обладать самосознанием. Иначе, что он описывает?

Давайте возьмём гипотетического робота с искусственным интеллектом (ИИ) и от лица безумного ученого (БУ) позадаём ему вопросы:

БУ: Что такое свет?

ИИ: Светом называют оптическое излучение, то есть такое электромагнитное излучение, длины волн которого лежат в диапазоне с приблизительными границами от единиц нанометров до десятых долей миллиметра.

БУ: Как ты сформулировал это определение?

ИИ: Отправил запрос в энциклопедию.

БУ: Как ты отправил запрос?

ИИ: Воспользовался протоколами передачи данных.

БУ: Как ты воспользовался протоколами?

ИИ: Эмм...

Реализация машинных алгоритмов выполняется в виде некоего кода, программы, но робот в общем случае не обладает доступом к своему коду. Рано или поздно находится уровень, работу которого аналитическая машина робота перестаёт понимать. Мы можем видеть на экране отладчика, как формируются образы, анализируются слова, из каких посылок проистекают движения и как формируются ответы на вопросы. Аналитический аппарат робота имеет лишь часть этой информации. Виртуальная машина, не тождественна своей реализации.

Но аналитический аппарат умён!!! О да, он очень умён. И он находится в замешательстве, что каким-то образом совершает действия в реальном мире, не имея представления о том, как он это делает. И тогда он задаёт вопрос:

ИИ: "Как так получается, что мне нужно поднять руку, и она поднимается? Как формируемые мной желания влияют на физическую реальность?"

Интересно вспомнить, как работает периферия созданных человечеством процессоров. Микроконтроллеры предназначены для управления физическими процессами. Однако, исполняют они программу, то есть информационную сущность. Часто можно видеть удивление на лице человека, только начавшего изучать микроконтроллерную технику: "Каким образом программа на языке си может влиять на то, когда и как зажигается светодиод, ведь в системе команд процессора нет команды зажечь светодиод?". Вопрос действительно нетривиальный. Программа — это нечто сферическое в вакууме, существующее в своём собственном виртуальном пространстве, порождённом, например, архитектурой фон Неймана. В виртуальном пространстве нет понятия внешнего мира, оно замкнуто в себе. Великие предки решили эту проблему так. Пусть некоторые области виртуальной памяти программы имеют специальный смысл. Если мы пишем специальные последовательности байт в эти ячейки, то архитектура воспринимает это как команду на взаимодействие с внешним миром. Программа устанавливает бит в ячейке памяти и светодиод загорается. Обратный поток информации реализуется также через области памяти.

Можно заметить, что аналогия с работой сознания практически полная. Продуцируемые сознанием утверждение, мысль, мыслеобраз определённого вида приводят в движение средства взаимодействия с реальностью.

Но продолжим пытать нашего робота. Давайте спросим его:

БУ: Как ты понимаешь, что тебе пора заряжаться?

ИИ: Я заряжаюсь, когда степень моего заряда падает.

БУ: Но как ты понимаешь, что заряд упал.

ИИ: Я получаю данные о заряде.

БУ: Как ты их получаешь?

ИИ: Эмм...

Аналитический аппарат не может детально описать свою внутреннюю работу. У него нет информации. Если вы продолжите задавать роботу вопросы на разные темы, посвещённые его взаимодействию с самим собой, вы придёте к выводу, что он каким-то образом, но воспринимает себя, причём форма этого восприятия — весьма далека от той, что прописана в коде.

По видимому, достаточным условием феномена субъективного переживания является то, что у нашего робота есть некоторое упрощенное представление о себе, не как о физическом объекте, но как о системе принятия решений и анализа информации. Учёт модели принятия решений при принятии решений важная задача. Учет модели собственного поведения вполне способен спасти объект управления в сложных ситуациях, а потому эволюционно оправдан. Эта система позволяет оценивать собственное поведение через оценку собственного поведения через оценку собственного поведения. И где-то здесь в контекст изложения прорывается архетип одного любопытного персонажа, имя которого вынесено в заголовок статьи.

Макс Фрай [8] — персонаж серии вирусных книг, писательницы, выступающей под омонимичным псевдонимом Макс Фрай. По ходу сюжета этого бесконечного ветвящегося трансцендентного зацикленного в самом себе повествования, Макс пишет книгу о самом себе, чем себя самосочиняет и самосоздаёт, рекурсивно вызывая к жизни качественный результат в виде существа по имени Макс Фрай. И это, конечно, крайне запущенная метафора, воспринять которую вне субъективного психоделического опыта с позиции объективизма совершенно невозможно. Ну, а никто, собственно и не обещал, что будет просто.

И что же всё это значит? Это значит, что самосознание присуще любой системе управления, склонной к саморефлексии, если она обладает внутри себя своей упрощенной моделью и пытается строить прогнозы на её основе.

Вывод строится на принципе "Что-то есть, поскольку этого чего-то не может не быть". Мы показали, что какое-то самоощущение должно быть. Роботу придётся построить модель своего процесса принятия решений, исходя из которой он будет отвечать на наши вопросы. Объективно это не приведёт к качественному изменению. Да, внутри у него есть какая-то модель себя. Просто еще одна модель внутри модели. С объективной точки зрения — совершенно ничего интересного, но субъективно, робот имеет механизм оценки себя как некоего наведённого образа. Робот может получить доступ к отладчику и в деталях изучить процесс того, как он работает. Он будет видеть на картинке зарождение образа удивления и отмечать возникновение удивления в своём субъективном переживании. С объективной же точки зрения — просто модель изучает то, как она сама же работает.

Хотя сознание и не проявляется объективно, можно, тем не менее определить, какие части вычислительной системы участвуют в проецировании феномена сознания, а какие нет. То есть в объективном мире сознание представлено своим носителем в виде вычислительной структуры. Если структура уничтожается, то феномен собственного субъективного переживания объекта также завершается, поскольку больше нет объекта и факта наблюдения.

Из осознания системой себя следует и осознание окружающего мира в рамках того же способа. То есть, сознание. Тут всё перевёрнуто вверх ногами, поскольку обычно считается, что сознание требует более слабых условий, чем самосознание и это вполне может быть так, но если уж есть самосознание, то и сознание должно появится. Существование самосознания является достаточным условием для существования сознания.

Давайте еще раз, потому что это сложно. Самосознание существует как субъективный феномен восприятия себя как вычислительной системы при решении задачи анализа своего предыдущего и прогноза своего будущего поведения, самоподдерживается путём наблюдения самой себя, и порождает фактом своего существования феномен сознания.

Сознание и антропный принцип

На язык просится возражение. С сознанием и способностью системы к самонаблюдению вроде бы всё понятно. У систем должна быть способность к самонаблюдению. Робот должен как-то оценивать ту систему, с помощью которой он как-то оценивает. Но при чем здесь мы и те красивые картинки, которые составляют сущность нашего с вами восприятия?

Давайте спросим нашего робота. В какой-то момент времени наш абстрактный робот, устав от бесконечного самокопания, не в силах понять, что он собственно такое, идёт на форум и задаёт вопрос:

ИИ: Хорошо. В теории всё понятно. У систем должна быть способность к самонаблюдению. Но при чем здесь я и те красивые картинки, которые составляют сущность конкретно моего восприятия?

Есть одна любопытная теоретическая проблема. Существует огромное количество возможных вариантов выбрать основополагающие физические константы так, чтобы вселенная оказалась крайне негостеприимным местом. Но, как мы видим, константы выбраны так удачно, что великолепно подходят для человеческих существ. Как так получилось?

В 1973 году английский физик Брэндон Картер сформулировал "антропный принцип". Принцип заключается в том, что мы не могли бы задаваться вопросом о том, почему вселенная так к нам благосклонна, если бы она таковой не была. Не было бы нас, и проблемой благосклонности вселенной занимались бы или совсем другие существа, или не занимался бы никто.

К проблеме сознания также уместно применить подобное рассуждение. Мы показали, что что-то внутри объекта должно воспринимать. Так почему бы этому чему-то не быть вами?

На самом деле, здесь действительно есть неразрешённый вопрос. Я знаю, что вы должны воспринимать мир, как и я. Я доказал это своим построением. Я знаю, что до определённой степени наше восприятие совпадает. Я видел это в книге философского зомби, в которую вы записали то, как воспринимаете мир. Но есть вещи, которые вы описать не можете. Например, вы не сможете описать мне, как для вас выглядит красный цвет. Есть много вещей, которые не могут быть изложены в книге философского зомби. Эти вещи объединяются термином "квалиа". "Квалиа" — термин обозначающий то, как вещи выглядят для нас, хотя, за свою историю, он был чрезмерно затаскан и перенасыщен смысловыми интерпретациями. В этой работе утверждается, что изучаемый класс систем должен как-то воспринимать мир, но не указано как именно, и вопрос этот в рамках данного построения неразрешим. По видимому квалиа должно быть, а вот что оно из себя представляет — загадка за семью печатями. Насколько мне известно, удовлетворительного решения пока никто не получил. Мы показали, что сознание влияет на поведение, но квалиа на него не влияет и потому не может быть никоим образом изложено в книге философского зомби. Зомби может описать своё восприятие с точностью до квалиа.

Сознание это не квалиа. Сознание гораздо проще ухватить за шкирку и вытащить на свет. Если мы говорим, что самонаблюдение должно продуцировать сознание, а антропный принцип показывает, что для каждой системы есть некий несчастный, который сидит внутри и это дело воспринимает, то квалиа нам нужно лишь для того, чтобы понять, как конкретно этот несчастный воспринимает. Пока мы установили только качество, но не знаем подробностей. И, судя по всему, пока подробностей не знает никто, а потому оставим этот вопрос философии и займёмся математикой.

Сознание как информация с характером

Матема́тика (др.-греч. «изучение; наука») — наука об отношениях между объектами, о которых ничего не известно, кроме описывающих их некоторых свойств, — именно тех, которые в качестве аксиом положены в основание той или иной математической теории.

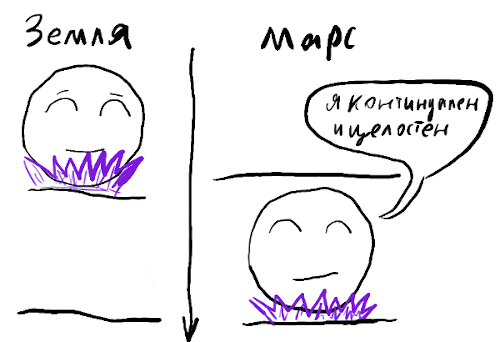

Мы получили, что некоторый феномен существует субъективно в рамках самого себя, но с объективной точки зрения весьма зыбок. На этом, пожалуй бы можно было и поставить точку, поскольку исследование необъективных явлений не основано на фактах, но при внимательном взгляде оказывается, самое интересное только начинается. Действительно, мы имеем некоторый объект. Он, как и все объекты имеет объективное представление в виде реализующей его вычислительной системы и, что его выделяет, обладает некоторыми специальными свойствами субъективного самовосприятия. К числу этих свойств относится ощущение мгновенной целостности и ощущение континуальности во времени. То есть система наблюдает себя как цельный и развивающийся во времени феномен.

Таким образом, это некоторый объект специального вида, над которым можно совершать некоторые операции и оценивать состояние. Так исследуем же его!

Мы воспользуемся следующим методом. Мы будем мысленно проводить действия над объектом, смотреть, что с ним происходит объективно и спрашивать его, что он при этом субъективно переживает, руководствуясь интуитивными соображениями себя, как обладающих сознанием существ. На основе рассмотрения этих результатов постараемся сделать выводы о том, по каким законам этот объект существует и как может быть математически описан.

Нам поможет воображаемый друг:

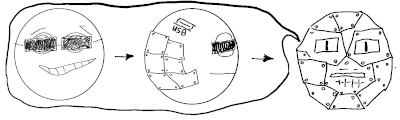

Один из первых выводов, которые нам придётся сделать — сознание независимо от вычислительной платформы, а продуцируется информационным процессом. Действительно. Давайте возьмём биологическое обладающее сознанием существо и начнём по одному заменять его нейроны на небиологические аналоги. Целостность и континуальность сознания при этом не нарушатся, поскольку процесс будет медленным и постепенным. Строго говоря, можно сказать что сознание вообще ничего не заметит.

Ян Корчмарюк вводит понятие "Сеттлеретика" (от английского «settler» — «переселенец») [9], и в своих работах изучает проблемы личности, психики, методологию переноса сознания в машину с сохранением идентичности и непрерывности. Приведённый пример является предлагаемой сеттлеретикой идеей, и если наша гипотеза о природе сознания верна, идея является вполне рабочей. Осуществляя её можно постепенно стать машиной.

Это показывает, что сознание не привязано к вычислительной платформе, но тогда оно привязано к вычислительному процессу, осуществляемому платформой, а вычислительный процесс есть тип информации.

Норберт Винер вводит определение информации через отрицание: Информация — это то, что не материя и не энергия [10]. Считается, что информация заключена в структуре материи, а также в полях взаимодействий. Выражаясь в структуре, информация допускает некоторые операции, которые не допускают материя и энергия. Например, копирование. Нам известно, что в отличии от материи и энергии, относительно которых выполняются законы сохранения, любая информационная сущность может быть скопирована.

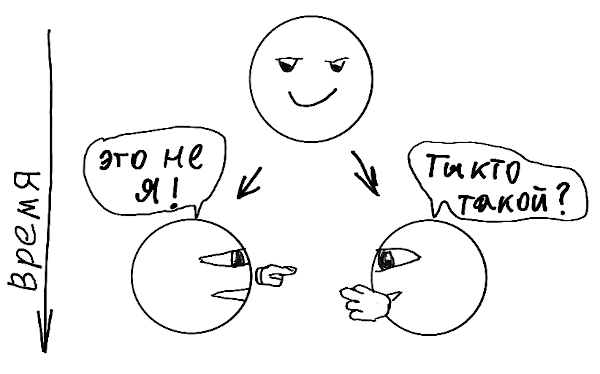

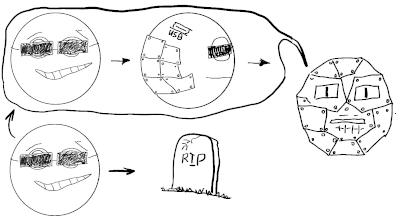

Наши вычислительные системы работают с такими объектами, как файлы и процессы. Мы без труда копируем файлы и клонируем процессы (man fork(2)) и считаем копии практически идентичными. Но как только мы копируем вычислительный объект обладающий сознанием, происходит нечто странное.

Когда объект наблюдает свою копию, он субъективно ощущает, что копия им не является. А!!! Это самозванец!!! Но, при этом, оба объекта ощущают изначально существующий в прошлом объект как свой непосредственный исток.

В чем же проблема. Как одно сознание могло раздвоится? Если мы вернемся к нашему определению и проверим критерии континуальности и мгновенной целостности, то обнаружим, что никаких противоречий нет. Оба объекта континуально наследуют от исходного состояния и являются целостными. И всё-таки кажется, что здесь есть логическая ошибка, потому что наш субъективный опыт кричит о том, что одно сознание двумя стать не может.

Представим мир-симуляцию. Существа, живущие в этом мире занимаются своими важными делами. Они сложны и обладают способностью описывать то, как они воспринимают мир. Мир кажется им реальным и незыблемым. Им даже невдомёк, что системный администратор дядя Вова каждый вечер, уходя домой с работы ставит симуляцию на паузу и включает её только утром пять раз в неделю, поскольку в субботу и воскресение у него выходные.

Давайте заметим, что свойство континуальности и мгновенной целостности при остановке мира не нарушаются. Существа ощущают себя теми же, кем они были до остановки и продолжают свои действия так, как будто никто их не прерывал.

Но рассмотрим другой пример. Это известная диллема телепортации.

Существо входит в телепорт на одной планете, его разбирают, отправляют транспортным лучём и собирают на другой планете, как в сериале Star Trek.

Континуальность не нарушена. Мгновенная целостность не нарушена. Существо на том конце ощущает себя исходным существом. Но что это… В эксперимент вкралась ошибка и исходное существо не было разобрано.

По видимому, и в этом заключается классический взгляд на этот вопрос, актом телепортации мы просто убили исходное существо, а на другой планете собрали на основе него некоего гомункулуса, который только думает, что он это исходное существо. Бедняга. Он даже не подозревает, что на самом деле тот, кому принадлежит его память, мёртв.

Сможем ли мы как-то ему помочь? А давайте телепортируем его ровно в ту точку, где он же и находится. Кажется, что ничего не поменялось. Одного убили, второго создали на его же месте. Второй думает, что он был первым.

Но, отличается ли этот пример от примера с остановкой мира? При остановке мира мы сохраняем информацию о симуляции в виде данных на жесткий диск, пересоздаём мир и восстанавливаем данные обратно. Это может быть другой вычислительный кластер, новая версия ПО симуляции. Нарушилось всё, что только можно, кроме континуальности собственного восприятия объектом симуляции. Этот пример мало чем отличается от примера телепортации себя в ту же самую точку пространства. В обоих случаях объект разрушается и создаётся заново.

Между примерами есть одно отличие. В примере с телепортацией объект знает, что нечто происходит, а в примере с остановкой мира — нет.

Есть тезис, согласно которому мы никак не можем проверить, живём ли мы в симуляции. Но мало того, если мы живём в симуляции, у нас нет возможности проверить, не останавливается ли мир каждую минуту на профилактику. Если мир периодически останавливается, то получается, что этот текст начинал читать ваш континуальный предок, а вовсе не вы. Так действует классический подход, но если мыслить сознание как свойство саморефлексии системы, то никакого парадокса тут нет, ведь сознание есть феномен субъективного переживания, а переживание это существует только тогда, когда осуществляется вычислительный процесс.

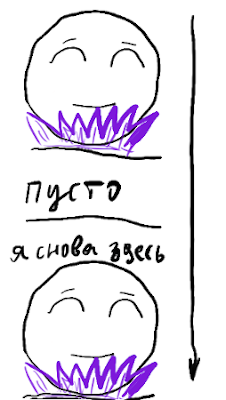

Возведём пример в абсолют, пусть симуляция сворачивается, архивируется и пересобирается на новой вычислительной машине каждый квант времени.

В такой системе сознание вообще никак не связано с вычислительной машиной. Свойство вычислительной платформы — суть постоянных изменений. Мгновение назад вычисления были квантовыми, теперь нейронными, транзисторными, реализованными на лампах, реализованными в виде процессов ядерного синтеза и распада, построенными на принципах гидравлических систем. Между запусками системы проходит различное время, вычислители строятся и разрушаются, меняются вычислительные блоки, на симуляцию одной секунды уходят тысячи и миллионы лет… Но, скажи мне, существо, — "как ты двигаешься?", — существо задумывается на короткое мгновение длиной в 4 тысячи лет и молвит, — "Я представляю, что двигаюсь и моё тело двигается само".

Говорит ли это одно сознание или миллиард разных наследующих друг другу продолжают одну и ту же мысль?

Несмотря на то, что симуляция всё время прерывается, сознание целостно и континуально. Можно ли сказать, что оно каждое мгновение разрушается и формируется заново? Можно ли сказать что у такого дискретного сознания есть качественные отличия от сознания непрерывного? Если таковые отличия и есть, то по-видимому, нет никакого способа их субъективно пронаблюдать.

Вот, кстати...

Вы уверены, что чай или кофе в вашей кружке туда наливали именно вы? А может быть это был другой? Тот кто раньше был на вашем месте и чьё тело вы вероломно украли? Вы пришли от себя прошлого к себе нынешнему методом малых изменений, на каждом шаге становясь чуть другим и единственная причина, по которой ваш прошлый двойник не обвиняет вас в том, что вы заняли его место состоит в том, что его здесь нет.

В каждый конкретный момент времени объект ощущает себя продолжением своего предшествующего состояния. Объект на другой стороне телепортационного луча строго уверен, что именно он только что был на планете отправления, но исходный объект при этом никуда не перемещался. Также, как и с экспериментом по остановке мира, единственный способ исключить конфликт двух личностей — убрать изначальную копию. Тогда субъективно это будет выглядеть как продолжение того же сознания. Объект на той стороне будет говорить, что он это он, а возразить ему никто не сможет. Его изначального двойника доедают лангольеры. Примерно так же, как они доедают того, кто, начинал читать это предложение.

Тезис о том, что мгновение назад мог жить кто-то другой приводит к выводу о том, что сознанию только кажется, что оно длится во времени. Этот феномен надо рассмотреть подробнее. Сознание может вспомнить своё прошлое. Это значит, что предыдущие состояния сознания сохраняются в некоторой форме памяти, которая, с объективной точки зрения выглядит как информационная структура, куда сознание постоянно регистрирует (копирует) информацию о текущем своём состоянии. Субъективно это выглядит как запоминание, а объективно, это безостановочная запись в журнал регистрации событий (возможно с удалением части информации). Похоже, что память — единственное, что связывает ваше сознание с тем, кто налил вам чай.

Вернёмся к примеру переселенца из биологического тела в тело механическое.

Пример А. Переселенцу клетку за клеткой заменяют тело на не биологические аналоги.

Пример Б. Переселенцу внедрили воспоминания, что он был биологическим, но на самом деле просто создали таким, чтобы он считал биологическое состояние предшествующим себе.

Пример В. Биологическое состояние было, но с него сняли копию, оригинал уничтожили, а механический экземпляр сконструировали, чтобы он думал, что был биологическим, внедрив воспоминания исходного существа.

Я утверждаю, что никто, ни объективный наблюдатель, ни сам переселенец в оконечной точке времени не сможет различить этих вариантов. Между получившимися ситуациями нет разницы ни субъективно, ни объективно.

Если мы признаём, что достаточное условие продолжения существования сознания это континуальность восприятия своего существования в прошлом (то есть, я помню, что я непрерывен), нам придётся признать, что принципиальной разницы между вариантами А и В нет. Интуитивно кажется, что это не так. Чтобы привести правила в соответствие с интуитивными ожиданиями нам придётся наложить условие непрерывности изменений. Недостаточно, чтобы сознание помнило, что оно непрерывно. Нужно чтобы изменения были постепенными и тогда вроде бы всё в порядке или так по крайней мере кажется.

Причина опять же в континуальности. Сознание хочет воспринимать (возможно, это специфично не для всех типов сознания) себя континуальным и не приемлет мгновенных скачков.

Рассмотрим момент засыпания. Во многих культурах засыпание считается временной смертью и даже существуют ритуалы, направленные на то, чтобы понять, кто вернулся из другого мира: владелец тела или злой дух. Это результат прямого сомнения в том, что сон сохраняет континуальность. Выше мы видели, что даже при переходе в непосредственно следующий за текущим момент времени континуальность может быть поставлена под сомнение. Чего уж говорить о сне…

Представляется, что человеческое сознание не готово воспринимать себя, как набор дискретных состояний. Возможно это свойственно нашей форме сознания, а может быть и сознанию вообще. Поскольку мы решили считать интуитивную оценку сознания мерилом допустимости операции над собой, то в зависимости от этой оценки со стороны конкретного сознания ответ на вопрос о телепортации и других схожих операций может меняться.

Забавно, но кажется, ответ на вопрос о допустимости телепортации для объекта сознания зависит от его мировоззрения. ¯\(ツ)/¯

Феномен разделённого сознания

Мы рассмотрели сознание как некоторую неделимую единицу, которая или есть или нет. Но с этого момента всё становится интереснее.

Вариант самозарождения сознания в металлической башке, вероятно оборудованной ЦПУ, и реализующей свой мыслительный аппарат на аналитической машине, интересен, но человеческий мозг работает не так.

Философ Дениел Деннет указывает на то, что по своей структуре мозг человека более подобен колонии совместно трудящихся термитов, чем компьютеру, исполняющему программу с централизованным управлением. Мозг человека не имеет главного центра принятия решений, это структура больше похожа на демократический аппарат кучи фракций нейронных групп. Группы постоянно конкурируют между собой, реализуя поведение предлагаемое той из них, что будет наиболее убедительной. Такая структура эволюционно оправдана. Действительно, её гораздо проще получить методами эволюции, чем что-либо подобное ЦПУ, а стабильность такой структуры несравнимо выше. Работу ЦПУ можно нарушить, перекусив один проводок, а для того, чтобы извести термитов понадобится напалм.

Особенность архитектуры вычислительного процесса накладывает отпечаток на продуцируемый им феномен сознания. Архитектура человеческого мозга буквально создана для того, чтобы быть населённой кучей разных сознаний. Это доказывают множество пациентов с психологическими расстройствами, это доказывают исследования пациентов с рассеченными мозолистыми телами.

Интересен вопрос, что чувствует сознание, когда в том же самом теле обитает другое сознание? Как нам это исследовать в рамках теории? К сожалению, мозг довольно сложный объект для мысленных экспериментов. Мы слишком мало знаем о роевых вычислениях. Понадобится модель попроще.

Вопрос. Может ли сознание, реализованное на ЦПУ испытывать феномен разделения? Удивительно, но может. Предположим, что аналитическая машина работает таким образом, что реализует два потока вычислений, продуцирующих собственные сознания. Каждый из потоков имеет собственную память и собственное мнение о своей континуальности и мгновенной целостности. Оба потока получают информацию (иногда разную), имеют разные цели и формируют разные команды, иногда конфликтующие. И что характерно, они не знают друг о друге.

Как было сказано выше, аналитическая машина в общем случае не может наблюдать своего строения и следить за процессом своей работы. Она не понимает, как работает та машина, которой она управляет. Для сознания параллельное ему сознание — это просто еще одна особенность объекта управления.

Однако, пусть система работает так, что часть выводов первого потока исполнения доступна второму и наоборот. Система не знает своего механизма и не имеет представления о том, как конкретно она получает эти данные. Может это результат её работы или эфемерной интуиции, но чем больше у двух процессов общих данных, тем более они похожи друг на друга. Существует непрерывное пространство возможных вариантов от полного разделения до полного слияния. Уместно говорить о степени связности этих сознаний.

Пусть потоки в достаточной мере разделены. Пусть мы имеем два канала связи с машиной, например, один вербальный, а второй письменный. Пусть вербальную информацию более свойственно обрабатывать потоку А, а о письменную — потоку Б. Тогда мы можем поговорить с двумя сознаниями независимо.

Напрямую установить наличие сознания Б в том же теле сознание А не может ни в условиях низкой, ни в условиях высокой связности. Это возможно только по косвенным признакам, однако теория предсказывает гипотетическую возможность, когда сознание А и сознание Б каким-то образом, догадавшись о взаимном присутствии разрабатывают систему символов, с помощью которой начинают общаться друг с другом. Допустим, они общаются через некоторую общую область памяти, куда сознание А пишет вопрос, а сознание Б пишет ответ. Хотя сознание А не может напрямую отличить эту область памяти от тех специальных машинных регистров, о которых мы говорили выше, но оно замечает, что ответы, которые появляются в этих ячейках разумны, а значит могут быть следствием работы смежного сознания.

И тут пожалуй, даже хочется спросить, сколько экземпляров вас сидит перед монитором и прямо сейчас смотрит на этот текст? Сколько информационных процессов, которые ничего друг о друге не знают? Теория предсказывает, что роевое сознание штука весьма любопытная. Оно отлично работает в условиях разделения и как кажется по кусочкам собирает единое сознание в условиях достаточной вычислительной связности. Да здравствует вычислительная связность.

Интересно рассмотреть феномен субсознаний. Допустим у нас есть сознание, которое внутри себя построило замкнутый вычислительный процесс продуцирующий сознание и взаимодействует с ним через специальные участки памяти, передавая ему ограниченное количество информации и организуя для него хранение памяти. Такое сознание может знать о своей природе, но может существовать как независимое сознание, даже не подозревая, что является частью чего-то большего (см. тезис о том, что разделенные сознания не наблюдают друг друга). Но для сознания верхнего уровня такое сознание будет просто частью его же вычислительного процесса, оно восприимчиво к памяти, командам и вычислительному процессу субсознания. Теоретически такие структуры могут существовать достаточно протяженное время и общаться друг с другом, принимать решения, и делать многие другие вещи, прежде чем снова растворятся в общем сознании. При должном усердии сознание может, формируя сложные иерархии субсознаний, реализовывать диалоги внутри самого себя и даже ставить театральные постановки. По видимому теория неплохо предсказывают тот хаос, что творится в наших головах.

Единственный тип сознания который мы можем изучить сегодня — роевой. В исследовании искусственного интеллекта, на сегодняшний день есть два направления работ, связанных с нисходящим (централизованным) и восходящим (роевым) ИИ. Работы по роевому направлению, связанному с технологиями нейронных сетей, HTM и подобными методами, сегодня особенно популярны. Однако, нет никаких предпосылок полагать, что роевая природа обязательна для феномена сознания. Роевые методы — это особенность конкретной реализации, а не необходимость.

Краткое резюме

Я думаю, мы готовы сформулировать некоторые тезисы относительно того, что за объект такой сознание:

- Сознание — это информационный процесс.

- Сознание имеет память, а также модель самого себя и постоянно копирует в память своё текущее состояние.

- Сознание признаёт свою преемственность от предыдущих состояний.

- Сознание может копироваться, но не признаёт своих активных копий тождественными себе.

- Объект, испытывающий субъективное переживание сознания, может не быть непрерывным во времени.

- С субъективной точки зрения сознание непрерывно (по крайней мере на отрезках).

- Сознание может не признать своим потомком последующее состояния, даже если потомок признает исходное сознание за предка.

- Последующее состояние считается тем более приемлемым, чем менее значительны изменения между состояниями. В идеале новое состояние должно быть получено методом непрерывных изменений.

- Сознание может разделяться при снижении связности вычислительного процесса.

- Сознания могут объединяться при повышении связности вычислительного процесса.

- Сознание обычно может наблюдать параллельное сознание только по косвенным признакам и не может пронаблюдать его непосредственно.

- Возможно общение нескольких сознаний внутри единого вычислительного процесса.

- Сознание может строить внутри себя другие сознания.

Вот с таким любопытным объектом мы каждый день имеем дело.

Заключение и выводы

В этой работе я попытался рассмотреть сознание как объект и установить, каким законам он подчиняется. Если принять концепцию зарождения самосознания как результата рекурсивного наблюдения себя, можно, несмотря на субъективность явления, вывести некоторые закономерности поведения этого информационного объекта.

Автор выражает надежду, что статья найдёт своего читателя и внесёт некоторую определённость в вопрос, может ли быть сознание у искусственного интеллекта, и по каким законам такое сознание будет существовать. Даже если читатель не примет тезис о том, что сознание человеческого существа может быть построено описанным в статье способом, он может тем не менее, использовать проведенный анализ при работе с техническими изделиями, имеющими аналитические аппараты рассмотренного вида, поскольку феномен "суррогата сознания" будет им присущ, что показано в настоящей работе.

Спасибо за внимание.

[1] Стивен Прист: Теории сознания. Глава 1. Дуализм: Платон и Декарт https://gtmarket.ru/laboratory/basis/3283/3284

[2] https://newtonew.com/story/memento

[3] https://www.nkj.ru/news/30619/

[4] http://www.ict.nsc.ru/jspui/bitstream/ICT/885/5/CantheMachinethink.pdf

[5] https://ru.wikipedia.org/wiki/Китайская_комната

[6] Dennett D. Consciousness explained (Back Bay Books, 1992)

[7] http://flibustahezeous3.onion/b/422451

[8] http://max-frei.net/

[9] Корчмарюк Я.И. СЕТТЛЕРЕТИКА. Новая наука о кибернетическом бессмертии (Сборник трудов за 1996-2005 гг. в 4 книгах. Книга 1.) — Волгоград: ООО "СФЕРА", 2015, — 548 с.

https://www.settleretics.ru/

[10] http://www.aselibrary.ru/press_center/journal/irr/2007/number_3/number_3_6/number_3_6571/