Хабр Курсы для всех

РЕКЛАМА

Практикум, Хекслет, SkyPro, авторские курсы — собрали всех и попросили скидки. Осталось выбрать!

помощи морфинга получить «что-то среднее»

быть может, эти представители мира кино просто что-то знают о будущем кинематографаВ будущем актёров, вероятно, вообще не будет, вместо них будет фотореалистичная трёхмерная графика, а актёры будут использоваться лишь для захвата некоторых движений (motion capture), и то — только на первых порах.

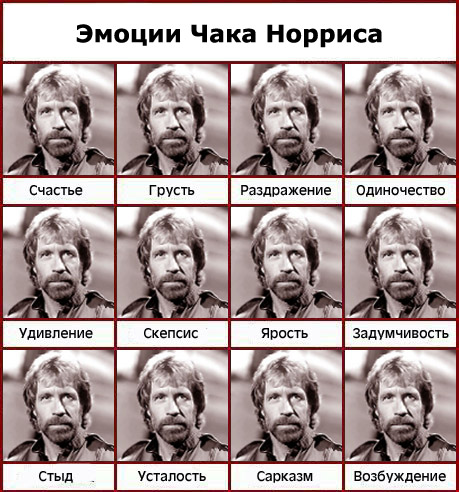

Эмоции актеру не нужны? В Disney научились корректировать выражение лица человека на видео