64K+

Охват за 30 дней

Серверная оптимизация *

Разгружаем сервер

31,45

Рейтинг

Сначала показывать

Порог рейтинга

Уровень сложности

Мейнфрейм IBM как альтернатива облаку

1 мин

19KСовсем недавно появилась информация о том, что IBM планирует выпустить мейнфрейм-серверы под управлением Linux. Кратко об этом под катом.

+20

Твердотельные накопители дали слабину

3 мин

101KТехнологии хранения данных — отдельная тема. Не так давно мы косвенно затрагивали ее в нашем материале об управления дисковым пространством сервера.

Сегодня мы поговорим о том, как команда поискового сервиса Algolia пыталась решить внезапно возникшую проблему с SSD-дисками.

Сегодня мы поговорим о том, как команда поискового сервиса Algolia пыталась решить внезапно возникшую проблему с SSD-дисками.

+103

Горизонтальное масштабирование серверов баз данных для OLTP-систем, или что есть на рынке

5 мин

15KКак правило, в крупных и средних компаниях существуют высоконагруженные транзакционные информационные системы, которые являются важнейшей составляющей бизнеса, их называют OLTP-системами. С ростом бизнеса нагрузка увеличивается очень быстро, поэтому задача увеличения производительности имеющихся ресурсов под серверы баз данных, стоит очень остро. Зачастую для решения задачи увеличения производительности серверов баз данных приобретается более мощное оборудования (так называемое «вертикальное» масштабирование), но этот способ имеет очень существенный минус: компания рано или поздно купит сервер баз данных максимальной производительности по приемлемой цене, и что делать дальше? Дальше перспективы для бизнеса могут быть не такие радужные – во многих случаях речь идет об ухудшении репутации компании, невозможности обслужить клиентов в моменты повышенного спроса, значительной потере прибыли.

+6

Про Intel Hyper-Threading и производительность виртуальных машин

3 мин

27KВсегда относился к Intel Hyper-Threading как к маркетинговому продукту. Но недавно я взглянул на эту технологию под другим углом.

Настал момент, когда лицензия vSphere Standart позволила создавать и запускать виртуальные машины с количеством виртуальных процессоров равных 8. О том, чем это грозит в случае установленного процессора с 4-мя физическими ядрами и поддержкой Hyper-Threading, читайте дальше.

Настал момент, когда лицензия vSphere Standart позволила создавать и запускать виртуальные машины с количеством виртуальных процессоров равных 8. О том, чем это грозит в случае установленного процессора с 4-мя физическими ядрами и поддержкой Hyper-Threading, читайте дальше.

-3

Контроль исправности сервера под управлением гипервизора VMware vSphere ESXi v5

2 мин

64KТуториал

Встала необходимость организовать мониторинг исправной работы контроллеров семейства LSI MegaRAID на серверах, работающих под управлением гипервизора VMware vSphere ESXi v5.5. И соответственно автоматически получать уведомления при наличии какого-либо сбоя, например отказе одного из HDD. В процессе проработки оказалось, что найденное решение не ограничивается только хранилищами данных гипервизора.

+11

mod_performance 0.4 помощь в мониторинге Apache 2.x

6 мин

8.3Kmod_performance – 0.4

Завершающий цикл статей, посвященных модулю apache — mod_performance.

Экскурс в историю

Это обычный модуль Apache 2.x для Linux:

- модуль предназначен для сбора и накопления статистики по использованию ресурсов(CPU и memory, время выполнения скрипта) веб-сервером Apache 2.4/2.2/2.0;

- модуль позволяет производить анализ собранных данных.

+12

Сервер HP ProLiant DL360 Gen9 — обзор, тест и перспективы

13 мин

70KRecovery Mode

Обзор HP ProLiant DL360 Gen9

С появлением процессоров семейства Xeon E5-2600 v3 от Intel, многие поставщики стали выпускать вычислительные платформы, использующие преимущества повышенной производительности новой архитектуры Xeon. DL360 Gen9 является новой серийной вычислительной платформой с форм-фактором 1U в семействе HP ProLiant, и в дополнение к новым процессорам E5-2600 v3 и памяти DDR4 DL360 Gen9 отражает технологические достижения компании HP и общее видение компании по поводу конвергированных центров обработки данных.

0

RDP vs RemoteFX

4 мин

81KВ группе предприятий «Х» используют терминальные сервера.

Начался новый сезон и в одном из представительств загрузка cpu начала достигать 100 процентов, что есть плохо, особенно после того, как пользователи начали жаловаться на скорость работы.

Причина возникновения проблемы была не понятна, количество сотрудников не менялось, софт не менялся… Все представительства в одинаковых условиях.

Собрал тестовый стенд и начал искать решение…

Долго перебирал разные настройки сервера и клиентских мест, это отдельная тема.

В творческом поиске сравнил протоколы RDP и RemoteFX, результаты решил опубликовать.

Начался новый сезон и в одном из представительств загрузка cpu начала достигать 100 процентов, что есть плохо, особенно после того, как пользователи начали жаловаться на скорость работы.

Причина возникновения проблемы была не понятна, количество сотрудников не менялось, софт не менялся… Все представительства в одинаковых условиях.

Собрал тестовый стенд и начал искать решение…

Долго перебирал разные настройки сервера и клиентских мест, это отдельная тема.

В творческом поиске сравнил протоколы RDP и RemoteFX, результаты решил опубликовать.

+12

DELL POWER EDGE VRTX

11 мин

14KRecovery Mode

Перевод

Сервер PowerEdge VRTX — это платформа, с форм-фактором Tower, обеспечивающая хранение данных при помощи 25 накопителей малого форм-фактора (SFF) или 12 накопителей крупного форм-фактора (LFF), а также поддерживающей до четырех серверных узлов с двумя SFF-накопителями в каждом. Вне зависимости от типа узла, Dell PowerEdge M620 или M520s, сервер поддерживает до 64 процессорных ядер (128 логических ядер). M620 демонстрирует максимальную производительность с процессором Intel E5-2680 при 2, 7ГГц, в то время как максимальная производительность M520 с процессором Intel E5-2470 составляет 2,3ГГц. Серверный узел M620 оснащен 24 разъемами для модулей памяти DIMM с поддержкой до 32 ГБ оперативной памяти для каждого, что в общей сложности на четырех серверных узлах составляет 3072 ГБ оперативной памяти. Серверный узел M520 оснащен 12 разъемами для модулей памяти DIMM с поддержкой до 32 ГБ оперативной памяти для каждого разъема. Сервер VRTX с форм-фактором 5U имеет возможность монтажа в стойку, но изначально был разработан для организаций, требующих бесперебойной работы единой системы для простоты управления и уменьшения опорной поверхности аппаратных средств и затрат на информационные технологии. Сервер VRTX является идеальным решением для предприятий малого и среднего бизнеса, а также удаленных офисов и филиалов, избегающих выделять место или средства под обычный стоечный сервер и приветствующих объединение IT-оборудования в единый корпус.

Разъемы PCIe обеспечивают функциональность системы, уникальной чертой Dell PowerEdge VRTX является наличие восьми разъемов PCIe, которые могут присваиваться вычислительным узлам при помощи интерфейса управления для большей гибкости и функциональности. Сервер оснащен тремя разъемами максимальной высоты и максимальной длины с поддержкой платы двойной ширины (225Вт), а также 5 разъемами половинной высоты и половинной длины (75Вт). Данный уровень соединений гарантирует возможность использования существующей в организации IT-инфраструктуры и/или обновить для установки InfiniBand, Ethernet, PCIe SSD или подобных PCIe-устройств. Кроме того, сервер VRTX использует на 86% меньше кабелей для резервных источников питания и внешних подключений, чем четыре отдельных сервера, два внешних сетевых коммутатора и два устройства внешней памяти. Этот факт позволит сэкономить время системных администраторов на организацию и управление кабелями.

Разъемы PCIe обеспечивают функциональность системы, уникальной чертой Dell PowerEdge VRTX является наличие восьми разъемов PCIe, которые могут присваиваться вычислительным узлам при помощи интерфейса управления для большей гибкости и функциональности. Сервер оснащен тремя разъемами максимальной высоты и максимальной длины с поддержкой платы двойной ширины (225Вт), а также 5 разъемами половинной высоты и половинной длины (75Вт). Данный уровень соединений гарантирует возможность использования существующей в организации IT-инфраструктуры и/или обновить для установки InfiniBand, Ethernet, PCIe SSD или подобных PCIe-устройств. Кроме того, сервер VRTX использует на 86% меньше кабелей для резервных источников питания и внешних подключений, чем четыре отдельных сервера, два внешних сетевых коммутатора и два устройства внешней памяти. Этот факт позволит сэкономить время системных администраторов на организацию и управление кабелями.

0

Утилита StorTrends iDATA для интеллектуального анализа узких мест в ИТ инфраструктуре

2 мин

9.2KRecovery Mode

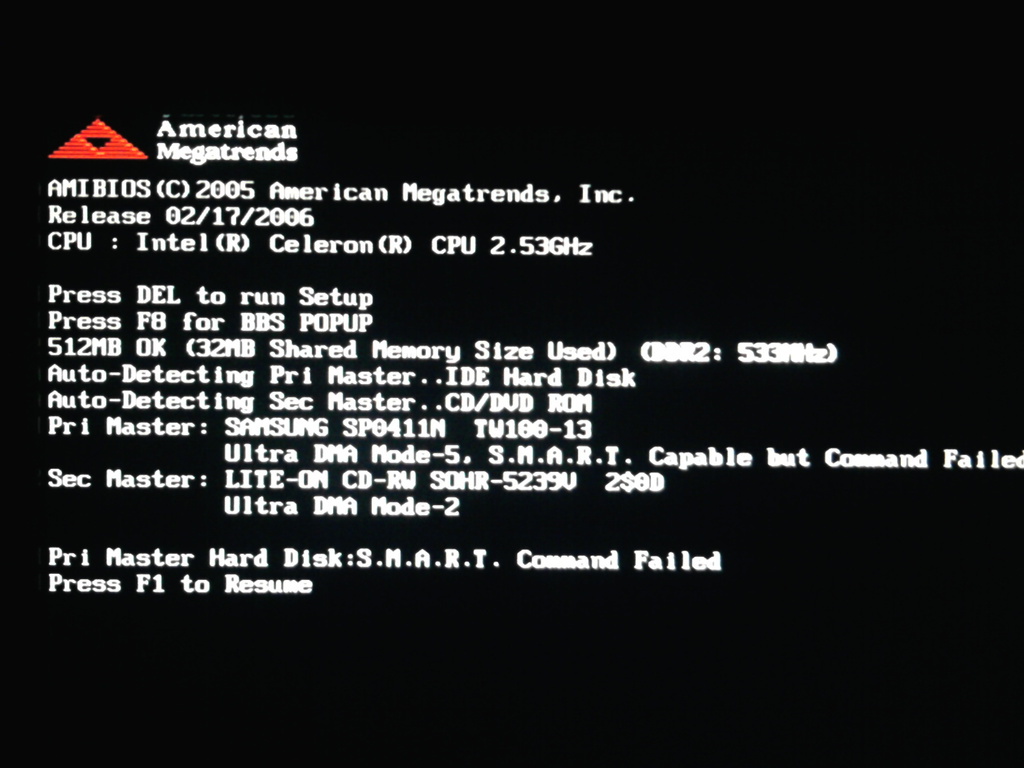

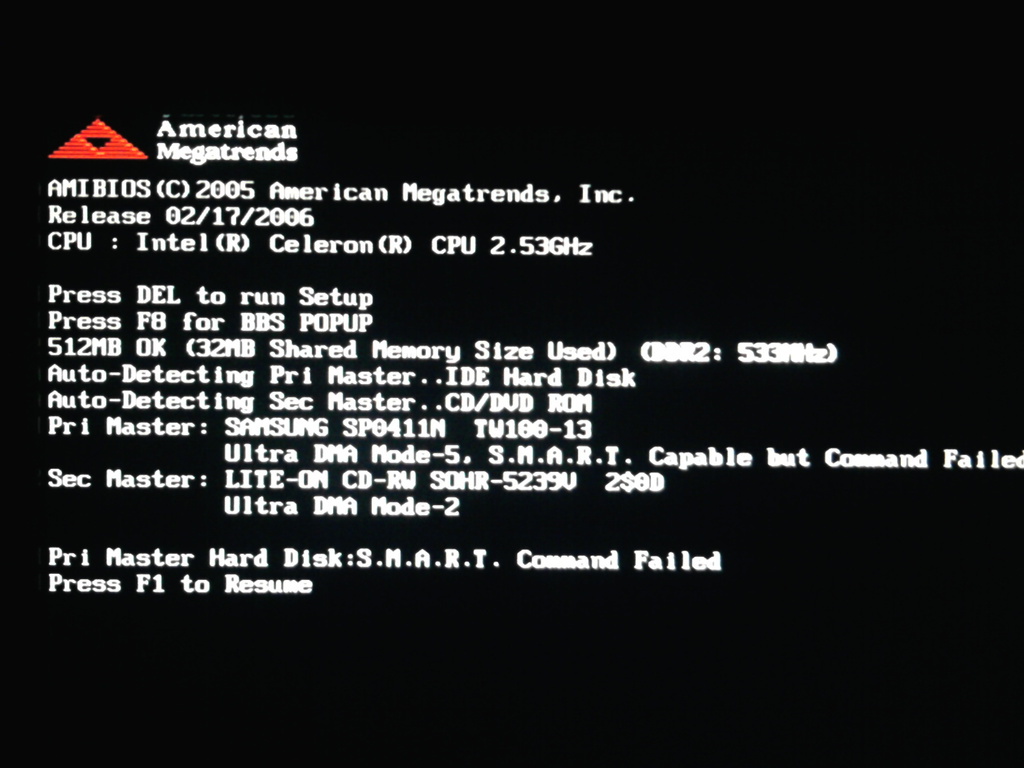

Компания AMI (American Megatrends Inc.) знакомая всем в далеком прошлом и может настоящем времени логотипом в левом верхнем углу монитора при включении компьютера или ноутбука.

Объявила о выпуске утилиты StorTrends IDATA (Intelligent Data Analysis Tracking Application) для интеллектуального анализа узких мест в ИТ инфраструктуре, это бесплатный софтверный инструмент разработанный для определения точной оценки производительности ИТ инфраструктуры, потенциала и требований к пропускной способности. Этот полезный инструмент поможет предупредить болевые точки инфраструктуры, прежде чем они станут головной болью, обеспечив детальные отчеты для принятия необходимых и обоснованных решений из расчета на будущее.

Объявила о выпуске утилиты StorTrends IDATA (Intelligent Data Analysis Tracking Application) для интеллектуального анализа узких мест в ИТ инфраструктуре, это бесплатный софтверный инструмент разработанный для определения точной оценки производительности ИТ инфраструктуры, потенциала и требований к пропускной способности. Этот полезный инструмент поможет предупредить болевые точки инфраструктуры, прежде чем они станут головной болью, обеспечив детальные отчеты для принятия необходимых и обоснованных решений из расчета на будущее.

+2

Gentoo: настройка и подключение через /dev/loop файловой системы с компрессией на примере Reiser4

4 мин

9.8KТуториал

Есть у меня несколько VPS'ок с Gentoo, бегущих под VMWare, для которых я, пожадничав, выделил всего по 7G дискового пространства. Как-то раз, после выхода очередной версии gcc, на одной из них закончилось место. Покопавшись, я обнаружил, что главными потребителями были директории /usr/src и /usr/portage. Тут же родилась мысль переместить их на файловую систему с компрессией (ага, на NTFS) и выбор пал на Reiser4, так как эти данные идеально подходят для неё — очень много файлов и они все маленькие.

Про эту файловую систему в сети имеется множество противоречивой информации (2013), но, пожалуй, стоит почитать статью (2010) ведущего разработчика.

Цитата из статьи:

за последние четыре года я не помню, чтобы кто-то терял данные на reiser4 разделе при исправно работающем железе. Ко мне обращалось несколько человек с жалобой на работу fsck. В конечном итоге все они получали и свои данные и работающий fsck.Не надо её бояться…

+14

Отключение лишних модулей Asterisk

3 мин

43KRecovery Mode

Продолжаю цикл коротких заметок по базовым, но весьма нужным хитростям для популярной АТС.

Asterisk имеет модульную структуру, и содержит в своём составе десятки модулей, отвечающих за те или иные функции, форматы, протоколы и прочее.

В каждом конкретном случае две трети этих модулей бывают не нужны, и для увеличения стабильности и быстродействия системы их следует отключить.

Asterisk имеет модульную структуру, и содержит в своём составе десятки модулей, отвечающих за те или иные функции, форматы, протоколы и прочее.

В каждом конкретном случае две трети этих модулей бывают не нужны, и для увеличения стабильности и быстродействия системы их следует отключить.

+7

Ближайшие события

Девятилетняя оптимизация маршрутизатора

16 мин

43KХочу рассказать историю жизни сервера в кампусной сети Новосибирского университета, которая началась в далеком 2004 году, а так же этапы его оптимизации и даунгрейдинга.

Многие вещи в статье покажутся общеизвестными хотя бы по той причине, что речь пойдет о событиях почти десятилетней давности, хотя на тот момент это были передовые технологии. По той же причине кое что вообще потеряло актуальность, но далеко не все, так как сервер до сих пор живет и обслуживает сетку из 1000 машин.

Многие вещи в статье покажутся общеизвестными хотя бы по той причине, что речь пойдет о событиях почти десятилетней давности, хотя на тот момент это были передовые технологии. По той же причине кое что вообще потеряло актуальность, но далеко не все, так как сервер до сих пор живет и обслуживает сетку из 1000 машин.

+73

Автоматическая настройка FreeBSD

9 мин

9.2KДобрый час, Хабровчане!

Хочу поделиться своим опытом автоматизации процесса установки и настройки FreeBSD с помощью sh (bash). Дело было так:

Однажды в компании возникла необходимость поднять несколько серверов на FreeBSD. Поставив одну, следом за ней вторую и третью ось, мы с коллегой (в штате всего два айтишника) задумались в сторону автоматизации этого процесса путем написания скрипта, выполняющего настройку свежеустановленной ОС. Задача написания легла на мои плечи. Коллега занялся решением вопроса автоматической установки, о чем я расскажу в другом посте. Итак, приступим!

+2

Переход с HP EVA на 3PAR StoreServ 7400. Реальный опыт внедрения

6 мин

15KВсех приветствую!

В данном топике я расскажу о нашем реальном процессе перехода с системы HP EVA P6300 на новую СХД, опишу наши ожидания и что из них было получено, а что — нет. В тексте процесс выбора систем будет очень кратким, хотя процесс выбора занял ОЧЕНЬ много времени. Не привожу никаких данных IOPS дабы не начинатьcockfighting полемику. Не в этом цель статьи. Я просто описываю свой реальный опыт.

В данном топике я расскажу о нашем реальном процессе перехода с системы HP EVA P6300 на новую СХД, опишу наши ожидания и что из них было получено, а что — нет. В тексте процесс выбора систем будет очень кратким, хотя процесс выбора занял ОЧЕНЬ много времени. Не привожу никаких данных IOPS дабы не начинать

+9

Zipkin от Twitter

8 мин

42KПеревод

Zipkin — это система распределенной трассировки, которая помогает нам собирать данные о времени выполнения всех разрозненных служб на Twitter. Он управляет сбором и поиском данных через сервисы Collector и Query. Мы проектировали Zipkin по образцу Google Dapper. Подпишитесь на

Zipkin — это система распределенной трассировки, которая помогает нам собирать данные о времени выполнения всех разрозненных служб на Twitter. Он управляет сбором и поиском данных через сервисы Collector и Query. Мы проектировали Zipkin по образцу Google Dapper. Подпишитесь на @ZipkinProject и следите за развитием событий.И зачем эта распределенная трассировка?

Сбор трассировок помогает разработчикам получить более глубокие знания о том, как определенные запросы выполняются в распределенной системе. Скажем, у нас возникли проблемы с запросами пользователей, допустим, превышение тайм-аута. Мы можем просмотреть трассировки запросов, которые отвалились и показать их в веб-интерфейсе. Мы сможем быстро найти службу, виновную за нежданную прибавку времени на ответ. Если служба была подробно проаннотирована, мы также сможем найти, в каком именно месте сервиса возникла проблема.

+8

Балансировка 2-х и более каналов на FreeBSD с использованием PF + Squid

6 мин

33KRecovery Mode

Доброе время суток, хаброжители!

В связи с тем, что хотя моя предыдущая попытка поделиться мыслями принесла мне инвайт, однако карма ушла в минус,

Итак, о задаче: есть два канала интернет, шлюз на FreeBSD

gate# uname -a

FreeBSD gate 9.0-RELEASE FreeBSD 9.0-RELEASE #0: Thu Nov 1 06:48:52 OMST 2012 root@gate:/usr/obj/usr/src/sys/GATE amd64Не то, чтобы необходимость, но желание создать гибкую систему с балансировкой трафика по каналам и желание получить премию от руководства.

Канал №1: безлимитка, скорость 7 Мб, реальный ip-адрес

Канал №2: безлимитка, скорость до 60Мб, реальный ip-адрес.

Со стороны провайдера были установлены шлюзы, через которые реализую DMZ на «ловушки» для хакеров, поэтому настройки PF и SQUID минимальны

+19

VMware vSphere VAAI — кто он?

2 мин

28KVMware vSphere VAAI — кто он такой?

Это комплекс технологий компании VMware, разработанный в сотрудничестве с различными производителями СХД, предназначенный для передачи некоторых операций виртуальных машин по работе с дисками на сторону массива. В этом случае хост-сервер виртуализации при выполнении стандартных процедур в среде виртуализации при работе ВМ с дисковой подсистемой просто дает команду массиву сделать определенные действия, при этом сам хост не гонит через себя все те данные и команды, которые он раньше был вынужден прогонять. То есть, это — Hardware Offloading операций с СХД.

На этом с теорией заканчиваем.

Недавно в моем парке появился новый дисковый зверек HP P2000 G3 MSA DC.

Система виртуализации построена на решении от VMware. А как многим известно, а начиная с версии 4.1 платформа виртуализации стала поддерживать технологию VMware vSphere VAAI, или другими словами vStorage API for Array Integration.

Немного теории про VAAI:

Это комплекс технологий компании VMware, разработанный в сотрудничестве с различными производителями СХД, предназначенный для передачи некоторых операций виртуальных машин по работе с дисками на сторону массива. В этом случае хост-сервер виртуализации при выполнении стандартных процедур в среде виртуализации при работе ВМ с дисковой подсистемой просто дает команду массиву сделать определенные действия, при этом сам хост не гонит через себя все те данные и команды, которые он раньше был вынужден прогонять. То есть, это — Hardware Offloading операций с СХД.

На этом с теорией заканчиваем.

Практика

Недавно в моем парке появился новый дисковый зверек HP P2000 G3 MSA DC.

Система виртуализации построена на решении от VMware. А как многим известно, а начиная с версии 4.1 платформа виртуализации стала поддерживать технологию VMware vSphere VAAI, или другими словами vStorage API for Array Integration.

+3

Развенчание мифов об x32 ABI

7 мин

19KПеревод

Наверное, некоторые из вас слышали о халяве под названием x32 ABI.

Если вкратце, то это возможность использовать все преимущества 64-битной архитектуры, но при этом сохраняя 32-битные указатели. Потенциально при этом приложение будет расходовать меньше памяти, хоть и не сможет адресовать более 4 ГиБ памяти.

Пример. В своём коде вы определяете массив целых чисел и заполняете его значениями. Сколько при этом вы расходуете памяти? Если очень грубо изобразить, то получится примерно так:

32 бита: Указатель + Счётчик числа элементов + N целых чисел = N+2 32-битных числа

64 бита: Указатель + Счётчик числа элементов + N целых чисел = N+2 64-битных числа = 2N+4 32-битных числа

Вот инженеры и задумались: а что если попробовать использовать 32-битные указатели на 64-битной архитектуре? Архитектура X86-64 имеет систему команд CISC и позволяет это сделать. В этом случае наш массив выше будет расходовать памяти 2N+3 вместо 2N+4. Экономия конечно же незначительная, но дело в том, что в современном коде количество разного рода указателей в структурах нередко доходит до десятка, и использование коротких указателей потенциально позволит экономить до 50% памяти (в идеальном случае).

Для тех кому надо расчёты точнее:

* Насколько большие массивы (и значения) в PHP? (Подсказка: ОЧЕНЬ БОЛЬШИЕ)

* Сколько памяти потребляют объекты в PHP и стоит ли использовать 64-битную версию?

Но как оказалось халявы не будет.

Вкратце о x32 ABI

Если вкратце, то это возможность использовать все преимущества 64-битной архитектуры, но при этом сохраняя 32-битные указатели. Потенциально при этом приложение будет расходовать меньше памяти, хоть и не сможет адресовать более 4 ГиБ памяти.

Пример. В своём коде вы определяете массив целых чисел и заполняете его значениями. Сколько при этом вы расходуете памяти? Если очень грубо изобразить, то получится примерно так:

32 бита: Указатель + Счётчик числа элементов + N целых чисел = N+2 32-битных числа

64 бита: Указатель + Счётчик числа элементов + N целых чисел = N+2 64-битных числа = 2N+4 32-битных числа

Вот инженеры и задумались: а что если попробовать использовать 32-битные указатели на 64-битной архитектуре? Архитектура X86-64 имеет систему команд CISC и позволяет это сделать. В этом случае наш массив выше будет расходовать памяти 2N+3 вместо 2N+4. Экономия конечно же незначительная, но дело в том, что в современном коде количество разного рода указателей в структурах нередко доходит до десятка, и использование коротких указателей потенциально позволит экономить до 50% памяти (в идеальном случае).

Для тех кому надо расчёты точнее:

* Насколько большие массивы (и значения) в PHP? (Подсказка: ОЧЕНЬ БОЛЬШИЕ)

* Сколько памяти потребляют объекты в PHP и стоит ли использовать 64-битную версию?

Но как оказалось халявы не будет.

+25