Comments 83

Сегодня первый раз поставил proxmox. Завелась, работает. Прикольная игрушка.

Там еще есть интересная штука как PBS и бэкапы виртуалок в S3 , а еще менеджер администрирования нескольких нод (не помню точного названия, вроде в бете было еще)

Vsphere как то сдох, в итоге я его даже не стал переустанавливать ради пяти esxi. И так было норм, а то он как не в себя ресурсов хочет. Но аналог для proxmox я бы протестировал конечно.

> не помню точного названия, вроде в бете было еще

Proxmox Datacenter Manager

Неск-ко месяцев как в релизе https://www.proxmox.com/en/downloads/proxmox-datacenter-manager

Стоит также обратить внимание на https://github.com/rcourtman/Pulse

P.s. И сюда заглянуть - может что и пригодится (нужен квн) https://forum.netgate.com/topic/163435/proxmox-ceph-zfs-pfsense-и-все-все-все-часть-2

oVirt попробуйте. Степень приколизма возрастёт, если вы работаете, конечно, в индустрии развлечений. И когда кластер упал - все смеются, шутят, пьют газировку и стреляют хлопушками с конфетти.

Прикольная, пока нагрузка не вырастает и api не начинает пятисотить и четырехсотить.

Траблшутинг весёлый.

Очень в тему и очень по делу. Я встречал как тех, кто пытался продать мега кластер тем, кому хватит самого простенького win server STD с двумя комплектными виртуалками, так и тех, кто красивый кластер с ha, drs и т.д. хочет перевести на proxmox причём желательно на бесплатный.

VMware же ещё выделялась своим компактным гипервизором который был относительно бесплатным и спокойно грузился с флэшки. Ни один из конкурентов и импортозаместителей, так понимаю, такого не может, что очень плохо.

Даже Microsoft попробовала и бросила. Под эту конфигурации в блейдах HP, например, были внутренние USB-порты для флэшек.

Да. Прям Killer Feature.

Ещё начиная с версии 8 они не рекомендовали так делать

С 7-й уже не рекомендовали, да и по факту в породе ни когда не рекомендовали.

У меня до сих пор HP Proliant ML110 Gen9 как тестовый стенд С 6.7 прекрасно с флешки грузится, а для прода конечно не очень решение.

Да, проблема не в загрузке 🙂А в том, что флэшка неожиданно умирает и сервер не грузится.Когда это кластер и есть свободные ресурсы, ситуация одна, а когда отдельностоящий сервер в ЦОД, то другая 🙂

К сожалению, сталкивался с такой ситуацией - когда это был NAS под FreeBSD, это доставило боли мало (ну, ACL слетели, но их удалось довольно просто восстановить, благо NAS'ом пользовалось человек 10 всего), а вот когда слегла одна нода Citrix в кластере виртуализации с локальными soft-RAID массивами (которые настраивал не я) - это была адская боль.

Опасная фича. У меня за 5 лет две флешки сгорели физически, прямо оплавились. Одна торчала в сервере, вторая в тридэ-принтере... Даже именитые бренды в наше время флешки делают подвальным способом из чего попало.

Времена хороших флешек на slc с нормально просчитаной электроникой давно прошли.

Насчет работы с флешки уже нет. Что правильно.

А как насчет morpheus и vm essential от hpe?

Я тут с одну тачку (ВМ) с этого ср...гo VMWare перенести не могу а тут сотни.... Капец. Работает не трож..... Знал бы я тогда что будут такие проблемы сразу бы сел на KVM. Вообще у меня как мелкого юзера нет проблем, зачем сложности.... KVM лучшее решение для виртуализации для глупых юзеров типа меня))

Легаси на VMware, новые проекты на альтернативах. Гибрид сложнее в управлении, зато снижает зависимость

Всё так. Текущая инфраструктура на VMware без поддержки и патчей имеет запас прочности в 5-10 лет. Эксплуатируйте и радуйтесь, а рядом стройте велосипедик.

Мигрировать только на велосипедик без острой нужды - удовольствие ниже среднего, с новыми нагрузками проще.

Инфра без поддержки имеет запас прочности, а вот без патчей все работает до тех пор пока вас не взломали. А сейчас с таким подходом это скорее вопрос времени. Вот прекрасная статья с примером того, что представляют из себя тулкиты по взлому VMware на текущий момент https://www.huntress.com/blog/esxi-vm-escape-exploit

Чисто с прльзовательского опыта на домашнем ПК: раньше (N лет назад) VMWare Workstation была ощутимо шустрее VirtualBox на одном и том же железе под Windows. Но в последнее время использую именно VB, потому что... Потому

Ничего шустрее, чем Hyper-V вы на домашнем ПК не увидите. А его можно поставить даже в клиентской винде.

VB и WS будут примерно одинаковы и заметно медленнее. И не потому что я не люблю кого то там, а попросту потому что ВМ в гипервизоре первого типа всегда быстрее, чем второго.

А как вы отличаете гипервизор первого типа, от второго. В случае Hyper-v на домашнем компе у вас хвостовая ОС где работает? А ввод вывод через что обеспечивается?

Смотря про какую ОС идёт речь, что-то просто не заработает.

Хорошая программа

Жаль, не сравнили с XEN (и его бесплатным форком XCP-ng).

Вот как надо делать рекламу! Круто) Иридиум явно выделен на фоне всех остальных, но и почитать статью в целом было интересно и по делу.

Пожалуйста, поправьте графики, которые вам LLM нарисовала руками или попросите ее нарисовать их через tools.

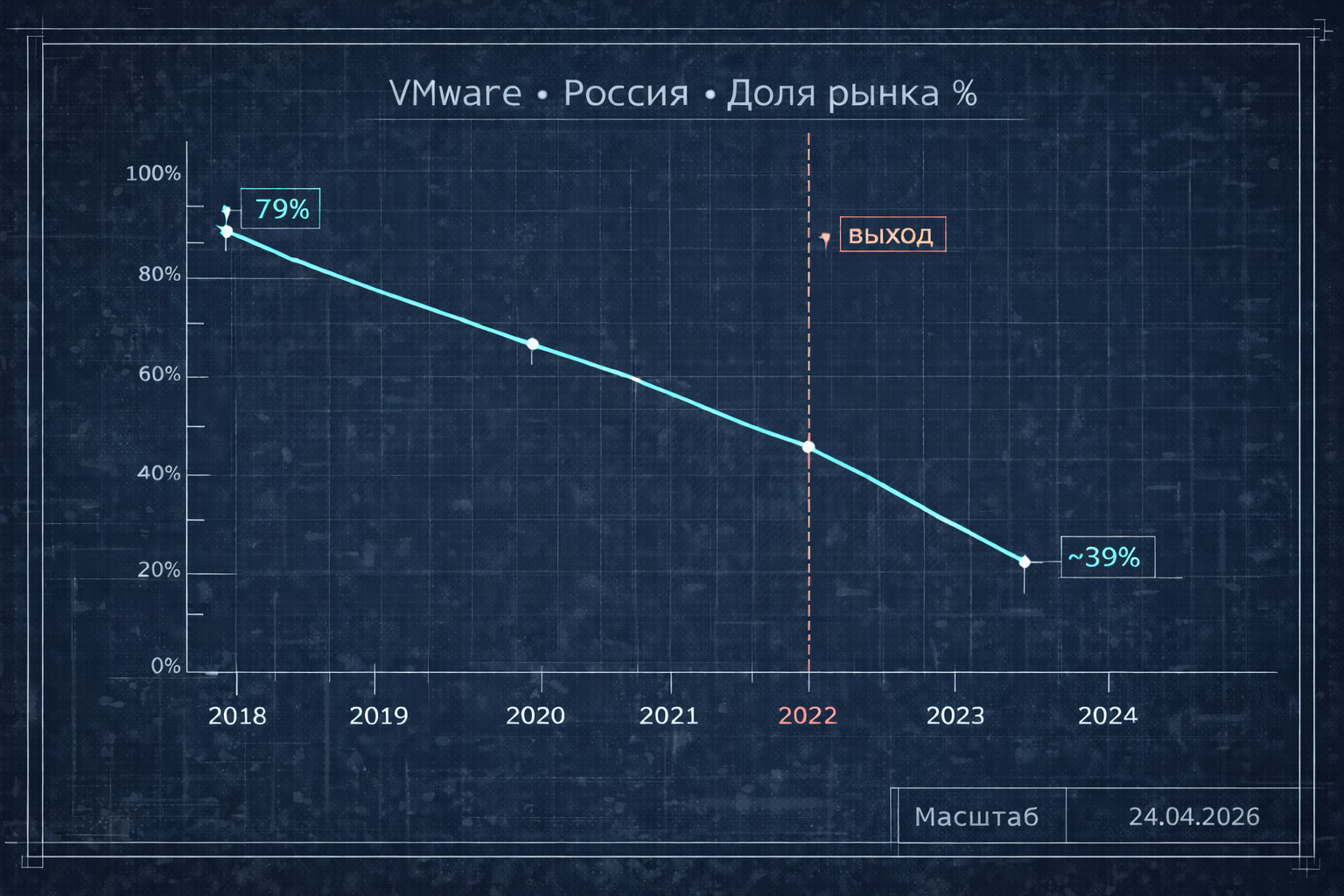

1.) У вас по какой-то неведомой причине, доля VMware в РФ упала с 79% в 2018 до 45% к 2022, а после 2022 до середины 2023 упала только на 6% до 39%, хотя вы пишите в тексте, что 39% "за 3 года после 2022", т.е 2025

2.) 79% на графике выше 80% и где-то в районе 90-95%

3.) 39% на графике в районе 20%.

4.) Масштаб не измеряется в дате :)

В общем, я понимаю, что LLM пыталась нагнать драматизма, но получилось это так себе. Не надо портить хорошую статью такими графиками.

Интроспекция работает ниже гостевой ОС, малварь не может её отключить, потому что не знает о её существовании.

Да, но.. Guest Introspection не видит, что происходит в RAM и процессах в ВМ. Оно может работать только, когда malware пытается записать себя на диск и тогда AV поймает сигнатуру, но давайте откровенно - сигнатурный анализ для 2026, мягко говоря, недостаточен. Куча malware file-less в принципе, другая компилирует себя на ходу на машине, третья скрывает сигнатуры. Так что агент вам нужен все равно для behavior analysis и там крайне редко используется full disk scan по расписанию в NGAV.

VAAI, VASA, vVols — через них массив «понимает» VM: hardware offload тяжёлых операций, политики хранения на уровне отдельной виртуалки, аппаратные снапшоты

vVols (а вместе с ними и аппаратные снепшоты), к сожалению, так и не получили популярность и теперь официально закопаны. https://knowledge.broadcom.com/external/article?articleId=401070 Осталось VAAI по большому счету.

Horizon (Omnissa) + NVIDIA vGPU — обкатанный стек для графических рабочих мест, сертификации NVIDIA для Proxmox не существует, и без неё вы в серой зоне: NVIDIA кивает на Proxmox, Proxmox на NVIDIA.

Существует. И vGPU на Proxmox официально поддерживается NVIDIA. https://docs.nvidia.com/vgpu/19.0/product-support-matrix/index.html И наоброт https://pve.proxmox.com/wiki/NVIDIA_vGPU_on_Proxmox_VE

Но вы меняете одну зависимость от вендора на другую, с поправкой на то что Nutanix ещё и привязывает к своему железу.

Это не так. Nutanix много лет уже продает софт, а не железо. Точнее железо от SMC они в отдельных случаях перепоставить могут, но это даже в revenue не учитывается (точнее учитывается как "Other non-subscription product revenue"). Nutanix в основном, как и VMware, продается как софт или appliance от OEM вендоров (Dell, HPE, Cisco, Lenovo, etc). Продажи железа ВМЕСТЕ с проф. сервисами меньше 5% revenue. https://www.globenewswire.com/news-release/2026/02/25/3244961/0/en/Nutanix-Reports-Second-Quarter-Fiscal-2026-Financial-Results.html

Storage-интеграции (VAAI)

Своя SDS

По мимо свой SDS, Nutanix поддерживает и внешние стораджа от Dell PowerStore/PowerFlex и Pure.

Даже Red Hat с её ресурсами и KVM-экспертизой не одолела VMware на её поле и ушла в контейнеры. Kubernetes хорош для cloud-native, но legacy не контейнеризируется по щелчку, и люди, которые пытаются запихнуть Oracle DB в pod, знают это лучше всех.

Ну.. Kubevirt, в который пошла RedHat с OS Virtualization - это все же не контейнеры. А виртуализация на QEMU/KVM, гдe Control Plane от K8s. Но с точки зрения полезной нагрузки - она живет вполне себе в нормальной/обычной ВМ.

По UI и пользовательскому опыту — целенаправленное воспроизведение VMware: те же паттерны, та же логика, тот же «мышечный» опыт.

В смысле "взяли" vCenter UI as-is, не поправили даже кнопки типа VMC on AWS? Или уже поправили ко второй версии? :)

ИМХО, это еще хуже. Люди видят интерфейс VMware (для тех кто не видел - там прямо 1:1 стыренный интерфейс, а не "по мотивам" или "списывай, но не в точь-точь"), кнопки VMware, workflow VMware и ожидают, что оно будет себя всегда ровно так же вести. А оно не будет.

Более того, многие вещи в интерфейсе VMware - не образец для подражания, а результат "наследства/legacy" + колоссальной сложности/гибкости, которой нет в "альтернативных" продуктах. Кстати, Nutanix в свое время как раз показал, как надо делать UI/UX и это было его преимуществом (правда потом там все тоже стало хуже по мере развития продукта)

Начну с честного признания: часть фактов в статье я писал из чертогов разума, не перепроверяя. В следующий раз буду тщательнее. Ну а далее разберу по пунктам.

Guest Introspection. Принимаю. Формулировка в статье создаёт впечатление, что agentless закрывает все сценарии. На практике Guest Introspection снимает AV storm и централизует сигнатурное сканирование на уровне файловой системы. Но fileless malware, memory-resident и поведенческий анализ — только агент. В 2026-м NGAV без behavior analysis — не защита. Стоило написать точнее.

vVols. Не уследил, спасибо за ссылку. Часть экосистемы хоронит сама VMware — ирония для статьи про то, как тяжело эту экосистему заменить. VAAI остаётся.

NVIDIA vGPU на Proxmox. В моих чертогах памяти была другая картина — проверил, в матрице 19.0 Proxmox есть. Ошибка моя.

Nutanix и железо. Каюсь, формулировка устарела. Nutanix давно продаёт софт, OEM-модель с Dell/HPE/Lenovo — основной канал. Lock-in у Nutanix другого рода — привязка к AOS/Prism как платформе, но не к железу. Про внешние storage (PowerStore, Pure) — тоже принимаю, в таблице стоило отразить.

KubeVirt. Технически вы правы — OpenShift Virtualization через KubeVirt запускает полноценные VM на QEMU/KVM, K8s только как control plane. Но для заказчика, который двадцать лет работал с vSphere, «VM внутри K8s-кластера» — всё равно принципиально другая парадигма. Red Hat ушла не в контейнеры буквально, но ушла от standalone hypervisor. Формулировка в статье упрощает, согласен.

Иридиум и UI. Ребята идут своим путём. Может что-то забыли убрать, может оставили осознанно для первых версий — не мне судить их приоритеты. Скажу что знаю: те кнопки, которые я нажимал, вели куда нужно. Но моё испытание не показатель — нужны другие нагрузки, другие масштабы, другие сценарии. Понятно, что всего enterprise-функционала пока нет и они его пилят. Ваше замечание про ожидания — сильное: если люди видят интерфейс VMware, они ждут поведение VMware, и любое расхождение бьёт больнее. Думаю, ребята из Иридиума увидят этот комментарий — обратная связь ценная.

Спасибо за качественный разбор!

Вы говорите что Redhat не одолела VMware в ее поле, но ovirt, пожалуй, самое популярное решение для построения виртуализации в России и это неспроста.

Я бы поспорил, что это VMware не одолела Redhat в ее поле и релиз Tanzu был сделан для того, чтобы сломать парадигму, когда внезапно в организациях стали появляться кластера Openshift и на них начали запускать нагрузки, а VMware как виртуализация становилась просто инфраструктурным слоем, который хорошо работает, но который не так уж сложно заменить. И в качестве догоняющего игрока оказалось, что Tanzu не так уж и хорош, потому что он фактически дает только KAAS, и с большим скрипом решает проблемы мониторинга, аудита, микросегментации, для новых типов нагрузок, которые работают вместе с ВМ.

И как раз подход Redhat, где для управления ВМ используется кубер, чтобы получить все преимущества cloud-native выглядит более современным, так как позволяет управлять как ВМ так и контейнерам в одном контрол-плейне. Это не серебрянная пуля и конечно есть нюансы и смена парадигмы, но зато дает стратегическое преимущество на горизонте нескольких лет

Интересный разворот. Если вопрос не «кто заменит VMware как гипервизор», а «кто определит следующую операционную модель» — Red Hat с KubeVirt выглядит сильнее. Tanzu как ответ действительно получился догоняющим.

Про oVirt уточню: популярен в России не потому что одолел VMware, а потому что бесплатен и доступен после санкций. Red Hat сама его похоронила в пользу OpenShift Virtualization.

По сути мы про одно: VM никуда не денутся на 5–7 лет, но control plane будущего — K8s. Вопрос — кто из заказчиков готов к смене парадигмы сегодня. По моему опыту — единицы. Но баланс сдвинется, и тут ваш аргумент сработает.

Так как позволяет управлять как ВМ так и контейнерам в одном контрол-плейне.

Мне кажется вот тут ключевой момент. Если у вас есть сильная K8s команда, которой нужна виртуализация, а главное этот самый ЕДИНЫЙ Control-plane, то kubevirt выглядит хорошо и здраво.

Но вот очень часто, далеко не всё в компании на K8s. Есть целая гора legacy, которой нужно управлять и совсем не так, как это привыкли делать DevOps (оставим за скобками срач на тему, а как лучше и нужнее). Во-вторых, часто есть разделение на инфраструктурную/платформенную команду и Cloud Native команду. Т.е. люди, которые занимаются bare-metal нагрузками (а таких не мало), обычными ВМ, СХД, etc - не лезут особо в K8s, а специалисты по K8s - не лезут в особо в платформу. И вот тут этот самый "Control Plane" и не должен быть единым + подходы K8s внедрять в legacy местами больно и не очень нужно. И тогда kubervirt выглядит менее подходящим решением.

Несколько лет назад тестировали Proxmox. Отказались из-за того, что community версия не такая стабильная, как подписочная, а с закупками подписки и ТП в РФ сейчас непросто.

В итоге перевезли половину VMs - не самых критичных и нагруженных: часть на RHEL (Alma) + libvirt + pacemaker + OCFS2/GFS2, и часть - на RHEL (Alma) + libvirt + pacemaker + CephFS.

Тонкая настройка ceph и pacemaker для тюнинга нагрузки - отдельная головная боль. Veeam не подключить, бэкапы переехавших VMs теперь только полные. Вывод я сделал такой - переезжать можно, но нужно заранее решить вопрос с бэкапами VMs, и заложить много time and human ресурсов на предварительные тесты.

На первый взгляд это апология VMware (и реклама кое-чего ещё), но секунд через десять после прочтения, и явно вопреки воле автора, явственно начинает проступать настоящий бенефициар текста… — Kubernetes.

Потому что почти все перечисленные «уникальные преимущества VMware» — это на самом деле симптомы конца VM как операционной модели, а не её триумфа.

Если это неочевидно, то вы застряли где-то в районе CentOS 7 — в лучшем случае. ;)

В долгосрочной перспективе K8s съест значительную часть, это правда. Но это не два года и не пять. Улыбнуло, спасибо за экспертное мнение.

А кубер гоняют не на VM как будто в on premise. На голом железе при хороших объемах это делают только аристократы и дегенераты отчаянные и крутые кмк.

Куберу не нужна половина этих фишек, что в статье описано. Сдохла нода — ну и хрен с ней, новая поднимется.

У вас кубернетесы на железе крутятся чтоли? Дорогое удовольствие, особенно в крупных энтерпрайзах с сотнями изолированных ИС.

Почти везде кластеры k8s ставятся на ВМ, которые в свою очередь, должны где-то исполняться.

Блин, да при чём тут «на железе» или нет(?) \@

кластеры k8s ставятся на ВМ, которые в свою очередь, должны где-то исполняться.

— если запуск кубера требует виртуализации почему-то (у которой есть свой overhead, не надо забывать — сетевой например часто весьма заметен), то для этого не нужно ничего кроме qemu-kvm или xcp-ng — да хоть headless VirtualBox, если хочется, хоть на FreeBSD с bhyve — магии VMware тут не требуется вообще, достаточно просто автоматизировать deploy. Вы же не размышляете, что там где-то ниже ещё BIOS нужен, чтобы это вообще загружалось. Слой вирты становится тут ровно тем же, по значимости, BIOS'ом — он может и нужен, но никто не строит вокруг него свою операционную модель, все давно мыслят уровнями выше.

А кроме виртуализации, кстати говоря, есть вещи типа https://github.com/loft-sh/vcluster.

НО. Суть вообще не в этом. Суть в том, где находится control plane, перешли ли вы на cattle vs pets и делаете ли вы разделение данные отдельно, а их disposable-обработчики — отдельно.

если запуск кубера требует виртуализации почему-то

Самый простой пример зачем может быть виртуализация под K8s - мультитенатность. Разделение на namespaces, в большинстве случаев, не считается достаточной изоляцией.

При этом да, мультитенатсность можно обеспечивать на уровне bare-metal нод, но тут две проблемы - размер сервера нынче достаточно большой и выдавать, минимум, 3 сервера (у нас ведь HA, кворумы и вот это все) на каждую задачу смысла не имеет + управлять bare-metal (например, удалять данные при decommissioning, конфигурировать ОС, etc) на bare-metal сложнее, чем в случае с ВМ

то для этого не нужно ничего кроме qemu-kvm или xcp-ng — да хоть headless VirtualBox, если хочется, хоть на FreeBSD с bhyve — магии VMware тут не требуется вообще,

Это сильно зависит от нагрузки и задачи. Под средний, не нагруженный сервис в K8s -да. Но например под AI, к сожалению, так просто не выйдет взять "первый попавшийся гипервизор". Там нужна магия, хоть и не та, что написана в посте выше.

а OpenNebula - кал ?

Не кал, но и не замена VMware. Легче OpenStack, неплохо для провайдеров и edge. Но если мерить линейкой из статьи — нет DRS, нет аналога NSX, storage-интеграции минимальные, DR руками, enterprise backup через сторонние костыли. Для своей ниши — нормально. Как альтернатива vSphere для enterprise с тысячами VM — пока нет. Поэтому и не попал в обзор, статья и большая.

С проверенного ПО переходить прям больно. И это касается не только виртуализации. Сейчас только ленивый Вася NGFW не выпустил – у всех, как под копирку, под капотом сквид и обвязка из бесплатного ПО. И работают эти творения криво да косо. Но в рекламных буклетиках всё красиво и мощчно -).

последним тестили NGFW ИКС - я про такой и не слышал до недавнего времени. Оказался на удивление адекватным -).

zVirt, SpaceVM. vStack... чего Basis.Dynamix не упомянули? Хотелось бы по нему тоже мнение.

У нас активно используется vmware, но как будто бы просто по привычке из каких то древних времен. Потому что виртуализация вообще не нужна, всё на линуксе и можно было бы запустить кластер k8s прямо на серверах (железо своё).

Зашёл, чтобы отметиться: клиентом на Flash пользовался, перестали вот буквально в прошлом году с переездом на Aria. А так у нас была аж специальная виртуалка, на которой были запрещены обновления и стоял IE 6 с флэшем - чтобы как раз таки в божественную консоль можно было заходить)

К вопросу о рынке - если не путаю, почти неизбежными его последствиями через некоторое время будут:

Консолидация и олигополизация рынка виртуализации в России. Выживут не все, и те, кто поставил не на ту компанию и систему - получат вторую порцию боли в подарок.

Большие проблемы с конкурентоспособностью импортозамещённых решений в случае, если / когда российский рынок откроется. Да, там где регулятор обязывает, они останутся без вариантов (возможно с ещё бОльшей консолидацией рынка). Но эффект масштаба говорит, что чтобы выжить в этот момент, необходимо заранее занимать и растить долю на международном рынке, а с этим сейчас сложно.

Выживут те, кто сможет предложить решение, которое не пытается стать только заменой VMware. Тут выше уже говорили про Kubernetes и он уже становится стандартом для запуска приложений, также как и ВМ в свое время стали текущим стандартом. Но даже с развитием микросервисов, ВМ никуда не денутся и задача сквозного управления ВМ и контейнерами становится суперактуальна. И боль будет там, где об этом не думают прямо сейчас

С точки зрения инженеров, возвращение VMware с которой они привыкли работать - это голубая мечта, которая понятна. Но здесь упускается один момент, что это удобство и стабильность работы были далеко не бесплатны. И мало какой здравомыслящий бизнес, который один раз уже "кинули" без предупреждения и возврата денег за лицензии и поддержку, будет готов покупать VMware, если/когда российский рынок откроется. Ну и подписки, повышение цен и прочие "радости" от Broadcom, который в рамках своей политики работы с очень крупными заказчиками может даже не смотреть на Россию, как на потенциальный рынок, тоже не добавляют вероятности такого сценария

Пока ProxMox смотрится перспективнее. Hyper-V куда же без него, в планах с него на прокс переезжать.

Vmware крутые конечно, вопросов нет. Но я решил, что лучше слезу с этой иглы в 22ом и выберу более безопасное решение среди наших св. тестил много всего, по итогу выбрал вмменеджер и доволен этим выборов спустя 3 года. Продукт стабильный, сильно прокачался за это время и поддержка быстрая

Можно узнать, как вы составляли список? Это ваш личный опыт использования? По выручке он не очень бьется с публичными данными, как минимум Базис и РЕД не упомянуты. Ну и про cloud-native решения ни слова. Опенсорсный Cozystack и наиболее близкая к "привычной" виртуализации DVP от Флант, например.

На поверхности — успех. Если копнуть — сложнее. Большинство российских платформ построены на KVM/QEMU с разной степенью кастомизации. Некоторые пошли заметно дальше, чем «KVM с логотипом».

Список — личный опыт, не рейтинг и не претензия на полноту. В раздел попали платформы, которые показались мне интересными с архитектурной точки зрения — нестандартный подход, собственный стек, необычная стратегия. Basis и РЕД архитектурно ближе к мейнстриму KVM-платформ, поэтому отдельно не выделял. Это не оценка качества — это фокус статьи.

Про cloud-native — сознательно не включал. Статья про боль миграции с VMware, а это в 95% случаев классические VM-нагрузки. Cozystack и DVP от Флант — интересные проекты, но другая парадигма и другая аудитория. Заслуживают отдельного разбора.

Было бы здорово услышать ваше мнение по cloud-native.

C точки зрения выбора продукта мы уже выше обсудили что этот подход выглядит стратегическим решением, и стоит задумываться об этом прямо сейчас, чтобы смигрировав на импортозамещенную классическую платформу не оказаться через пару лет перед задачей мигрировать еще раз.

При этом DVP дает максимальный паритет с "классической виртуализацией", управление через веб-интерфейс и возможность мигрировать ВМ с VMware

@lapinsa42 как считаете какой гипервизор наиболее стабильный и имеет больше преимуществ в сравнение с перечисленным ? (Альт Виртуализация 11 PVE \ Иридиум \ zVirt) ?

На вкус и цвет все фломастеры разные

25 ЛЕТ НА ИГЛЕ VMWARE: Почему ломка длится дольше, чем вы думаете