Comments 18

Забыл добавить ссылку whitepapper по DSAC на https://www.webformula.pro/upload/DSAC-Whitepapper-2026-Webformula.pdf

Подробно описал эволюцию с 2016 года до наших дней :)

А сколько ушло на апи клода?

Он включен в 150к "работы" или 30к с фрипиком?

Расход на api был <1$, через open router настроена работа связки deep seek + Claude

клод читал пдф, а deep seek писал текст?

за $1 можно 33к токенов обработать

получается 246 токенов на файл, это получается 2.5 небольших абзаца текста

Совсем не понял математику с использованием ИИ)

и главное роль дипсика, о нем ничего нет в статье

И то, я не учел, что платформа через которую вы работали с апи, берет 5.5% комиссии, т.е. это получается еще дороже, чем взять нативный апи клода

+ сказано меньше $1

Получается, следуя вашей математике 1 пдф файл у вас содержит не более 2 небольших абзацев текста?

Сейчас дам расклад, 1$ у нас ушел на анализ и python:

PDF-Каталог был на 140+ страниц (мы оставили часть схем защиты растений для обучения и использования в. следующих задачах), весил он при этом 65мб.

Токены чисто в Claude:

Всего использовано: 720,207 токенов

Входных: 429,191

Выходных: 291,016

Общая стоимость: $5.65 (537₽)

По этапам:

Анализ каталога: $0.82

Валидация: $0.31

Маппинг: $2.02

Региональная адаптация: $0.57

Документация: $0.96

deep seek использовали для парсера данных и скриптов, он значительно дешевле обходится.

В трех словах, что сделали то?

это что-то про seo c помощью нейросетей :)

На будущее учту - сделаю больше графики, чтобы было понятно без слов.

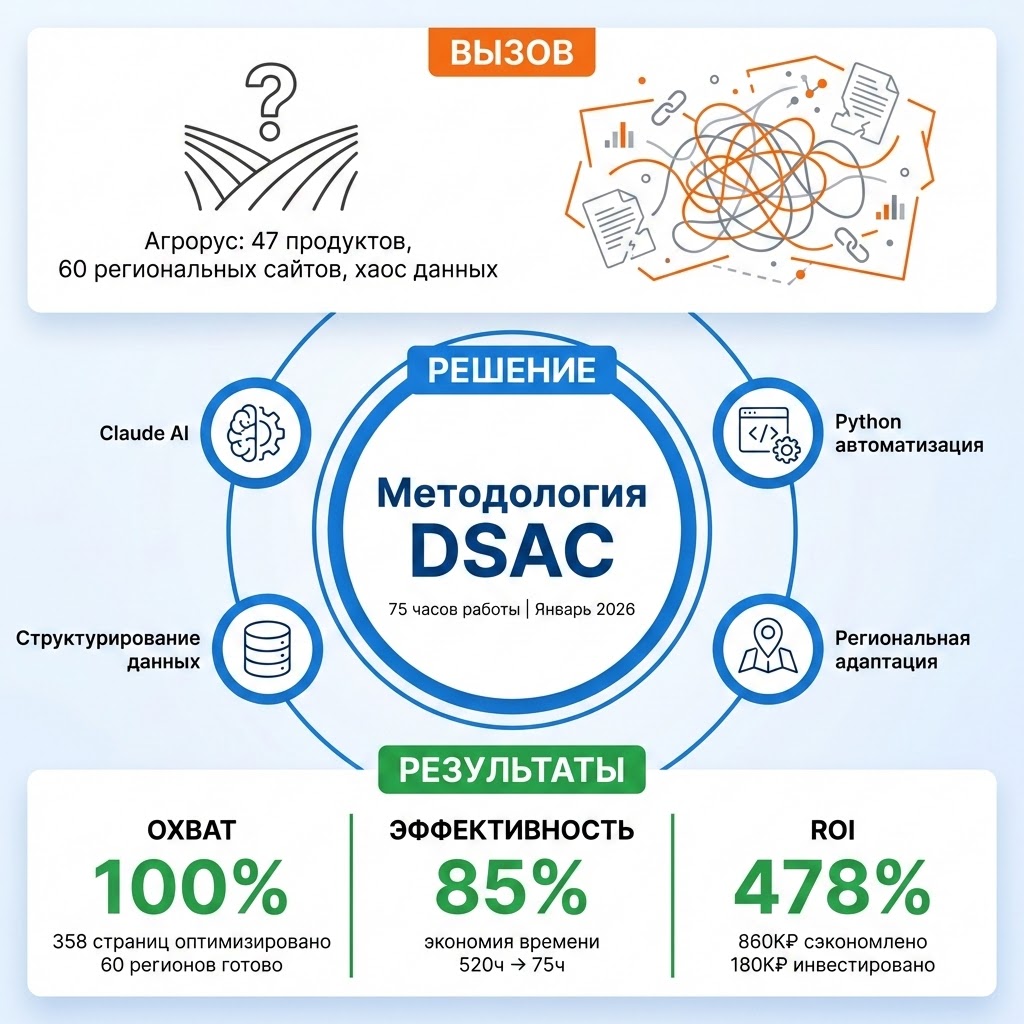

LSS: Компания обработала 134 PDF-страницы каталога агропродукции и создала 358 SEO-оптимизированных страниц, полностью автоматизировав процесс с помощью Claude AI и Python.

🎯 Ключевые моменты:

1. Задача:

Из неструктурированных PDF-каталогов (134 страницы) создать SEO-дружественные страницы для 360 вредных объектов (болезни, вредители, сорняки).

Обеспечить 100% покрытие препаратами и региональную адаптацию для 60 поддоменов.

Сделать это быстро, точно и недорого.

2. Технологический стек:

Claude AI (Anthropic API) — для извлечения структурированных данных из PDF

Python 3.11 + pandas — для обработки данных и маппинга

1С-Битрикс — платформа сайта

3. Архитектура решения:

Извлечение данных из PDF через Claude AI

Нормализация и маппинг (препараты ↔ вредные объекты)

Региональная адаптация (4 региона × 12 месяцев × культуры)

SEO-оптимизация (метатеги, внутренние ссылки, микроразметка)

GEO-оптимизация для нейросетевых поисковиков (ChatGPT, Perplexity)

Автоматизация обновлений

4. Результаты:

✅ 358 страниц вместо 134 (увеличение в 2.7×)

✅ 100% покрытие препаратами

✅ 75 часов работы вместо 500+ (экономия 85% времени)

✅ Экономия 860 тыс. рублей (ROI 478%)

✅ 99.4% точность данных

Матричная структура данных для региональной адаптации:

Регион × Месяц × Культура × Фенофаза × Проблема → Препарат.База: 47 препаратов → 358 вредных объектов → 477 региональных комбинаций

Потенциал: 21 480 уникальных страниц (358 × 60 региональных поддоменов)

Региональная специфика — конкурентное преимущество: единый контент для всех регионов даёт лишь 20% эффективности.

Каталог гербициды в Новосибирске от завода Агрорус. Актуально: контрактация и закупка препаратов (Февраль).

На каком поддомене можно посмотреть результат - страницы? Есть ли или будет ли к ним доступ по ссылкам в меню?

В Новосибирске доступны screaming frog 422 страницы, никаких комбинированных страниц - только crops products substances.

Автоматизация автоматизацией, но иногда надо и ручками)

Средства защиты растений в Saransk — завод Агрорус: каталог и цены

Страницы сейчас отключены, ждем согласования. Все будет! Ж)

Кто прочитал, признавайтесь, бандиты?

Складывается ощущение, что цифровизация в апк идет быстрее, чем в других сферах реального сектора

Автоматизация SEO для агросайта: от 134 страниц каталога до 358 SEO-страниц с ИИ. Технический разбор