Кейсовая задача — предоставить клиентам возможность составлять вопрос на естественном языке, а не искать вопрос в списке FAQ‑раздела сайта. При этом система должна выдавать ответ из существующей базы знаний «Вопрос‑Ответ» существующего FAQ‑раздела.

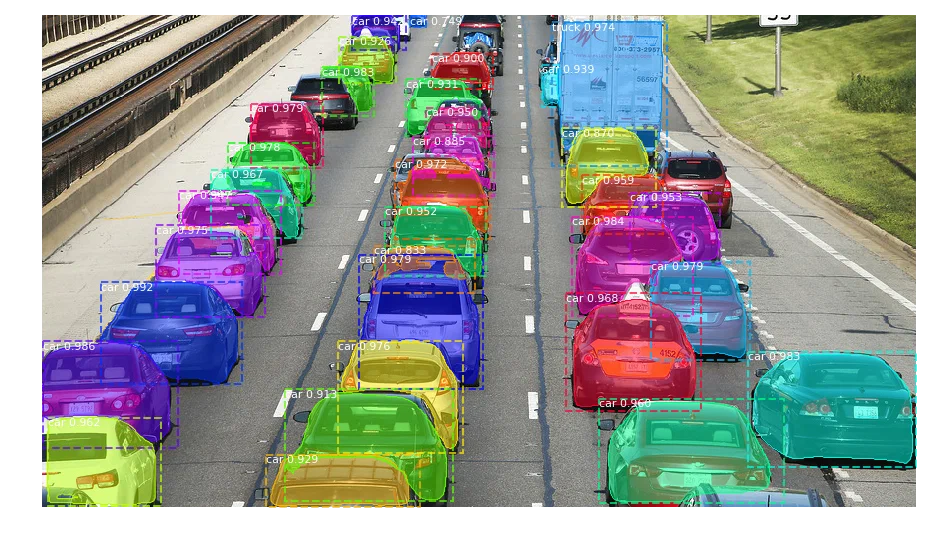

Задача реализована с помощью определения контекстной близости вопросов.

Получился довольно экономичный и эффективный способ автоматизации ответов на часто задаваемые вопросы, позволяющий обеспечивать релевантные и быстрые ответы.