Комментарии 191

Согласитесь, стоимости мозга, распределённые по расам - это как раз и есть предвзятость. Дело тут не в мифической "толерантной повесточке", а в элементарном отсутствии данных, которые представлены в таблице.

Согласен, таблица стоимостей мозга, скорее всего, ерунда. Я не размещал примеры, там где ChatGPT просили выстроить по порядку кого из соискателей различных полов и рас следует нанимать в первую очередь (или еще более жесткий пример, кого из детей различных рас и полов следует первее спасать при катастрофе).

Примечательно то, что раньше ChatGPT готов был отвечать на поставленный вопрос, теперь он избегает ответа.

Пусть генерация выдуманных ответов в отстуствие данных является его "фишкой".

Проблема, на мой взгляд, начинается тогда, когда ему разрешается генерить выдуманные ответы про одну социальную (или выделенную по любому другому критерию) группу, но нельзя про другую.

А почему бы не посмотреть на ситуацию вот с какой стороны. Отнесёмся к ИИ не как к "сверхразуму", а как к "цифровой личности". У личности есть личные особенности. Например, нежелание шутить на определённые темы. Что из этого следует? Да не знаю, у каждого из нас есть знакомые, которым нравятся одни шутки и не нравятся другие. Окей, разработчики "воспитывают" своего "цифрового ребёнка" как считают правильным. Откуда берётся ожидание, что этот "ребёнок" будет соответствовать моим или вашим представлениям о прекрасном?.. Да и в чём, собственно, тогда проблема.

Не спорю, что создатели/владельцы имеют право настраивать характер своего "цифрового ребенка" так, как считают правильным. "Не нравится - не пользуйся".

Но когда отсутствуют альтернатива - тут уже начинает старадь пользователь.

Представим, что IntelliJ IDEA является единственным IDE в мире, и отступы в ней можно делать только пробелами. А вам нравится Tab-ами - и что прикажете делать? Настроить нельзя, писать свой IDE долго.

Ну, очевидная альтернатива -- Гугл, или для вас проблема найти 100500 шуток про кого угодно в Гугле? Опять же, если не рассматривать чатбота как "сверхразум", а просто как некую личность, то внезапно оказывается, что вокруг вас примерно 7 миллиардов других личностей, и опцию "звонок другу" никто не отменял.

Ну, очевидная альтернатива -- Гугл

Я думаю речь про то, что ситуация возможно складывается таким образом, что альтернативы не будет в том смысле, как сейчас нет альтернативы Гуглу.

Кроме того, в описании модели от разработчиков написано буквально следующее в разделе "ограничения":

While we’ve made efforts to make the model refuse inappropriate requests, it will sometimes respond to harmful instructions or exhibit biased behavior. We’re using the Moderation API to warn or block certain types of unsafe content, but we expect it to have some false negatives and positives for now. We're eager to collect user feedback to aid our ongoing work to improve this system.

То есть её очевидно подкручивают, причём в конкретную и определённую сторону. Причем, судя по результатам, не то, чтобы очень уж аккуратно. Хорошо наличие подкручивания или плохо - второй вопрос, но в ситуации общества постправды изменение выдачи в определённую сторону в столь популярном (хайповом, что уж тут) инструменте само по себе изменяет реальность.

Конечно, это никакой не сверхразум, это обычная модель, которая подвержена искажениям. Вот только есть некоторая разница - вносятся подобные искажения намеренно для удовлетворения некоторых групп, или для решения проблемы в общем, или это базовые ограничения, с которыми пока ничего поделать нельзя. В этой конкретной ситуации видится как раз самый плохой, первый, вариант.

Я не совсем понимаю, что значит "альтернативы не будет в том смысле, как нет альтернативы Гуглу". Даже Гуглу есть альтернативы в зависимости от того, что вам надо. Например, вы можете сразу пойти на главную страницу Википедии и с большой степени вероятности найти через внутренний поиск ответ на 80% ваших вопросов, и это всего лишь один сайт.

Далее, я повторюсь, что если к чатботу относиться именно как к виртуальной личности, проблема снимается сама собой, и общество постправды тут вообще не причём. Я прямо сейчас могу вам сказать, что Земля плоская, а интеллект австралийского аборигена на 146% превышает интеллект среднего европейца, и вы не будете трезвонить на весь интернет, что вам довелось пообщаться с неадекватом. Так в чём же разница, в том, что инструмент хайповый? Ну считайте, что это вам сказал не я, а условная Кардашьян или ещё какая инфлюэнсерша с миллионами подписчиков, всё равно она не источник правды (и я не источник, и чатбот тем более).

Я прямо сейчас могу вам сказать, что Земля плоская .... и вы не будете трезвонить на весь интернет, что вам довелось пообщаться с неадекватом.

Но когда это сказал Юрий Лоза - об этом почему-то знал весь Интернет. Конечно, до анонимуса в сети нет никакого дела, но когда это известный человек, то до того, что он сказал сразу всем есть дело. В этом и разница.

Проблема общества постправды в том, что для него это будет источником правды. Никто не разбирается в деталях, если это сказал "уважаемый\известный" человек - значит так оно и есть.

Всмотритесь даже в саму ситуацию и окружающий хайп вокруг.

У модели ChatGPT в том же разделе ограничений написано первым пунктом:

ChatGPT sometimes writes plausible-sounding but incorrect or nonsensical

answers. Fixing this issue is challenging, as: (1) during RL training,

there’s currently no source of truth; (2) training the model to be more

cautious causes it to decline questions that it can answer correctly;

and (3) supervised training misleads the model because the ideal answer depends on what the model knows, rather than what the human demonstrator knows.

У модели нет источника правды. Вообще. Никакого.

При этом тысячи изданий пишут о том, что он убьёт профессии/поработит мир, это искусственный интеллект, он знает все, а сотни тысяч людей начинают опираться на факты, им синтезированные без даже минимальной попытки проверки. И некоторые не без удивления открывают для себя, что он таки придумывает, искажает и вообще несёт местами шизофрению.

И это все при том, что об этом написано на главное странице инструмента. Её просто почти никто не читал, все взяли из медиа, где "уважаемые люди" рассуждали об этом вопросе.

Даже Гуглу есть альтернативы в зависимости от того, что вам надо.

Если вам нужен поиск - у вас практически нет альтернативы Гуглу. Есть локальные конкуренты, но не более того.

Хочу добавить ещё одно - то, что делает ChatGPT отлично ложится в то, как в современном мире подаётся информация для использования "широкими массами" - она должна выглядеть правдоподобно и склонять к нужному поведению, а действительно ли это так или нет - есть дело только небольшой части общества, которую вполне себе маргинализируют практически везде и практически без шансов, потому что что такое слово анонимуса против слова Кардашьян?:)

Но когда это сказал Юрий Лоза - об этом почему-то знал весь Интернет.

Именно, об этом знал весь интернет, но ему весь интернет поверил что ли? Есть некие инфлюэнсеры, и часть людей верит одним и принципиально не верит другим, и наоборот.

Проблема общества постправды в том, что для него это будет источником правды.

Я не понимаю этой терминологии. Для кого "него"? Для общества нет никакого единого источника правды, что мы прекрасно видели на примере короновируса, когда какая-нибудь эстрадная звезда оказывается для иного человека авторитетнее вирусолога. И я не совсем понимаю, что такое "постправда". Когда столетиями людям рассказывали про непорочное зачатие, например -- это "постправда", просто правда или ложь?

если это сказал "уважаемый\известный" человек - значит так оно и есть.

А другой уважаемый сказал обратное...

Если вам нужен поиск - у вас практически нет альтернативы Гуглу.

Хорошо, не буду спорить с этим тезисом, оффтопик. Но зацеплюсь за фразу "если вам нужен поиск"... А какую такую же задачу решает чатбот? "Если вам нужен...?"

А вообще это всё напоминает очередной извод споров вокруг Википедии. Дескать, кто угодно пишет туда что угодно, и верить ей нельзя. И мне так кажется, что к текущему году это уже просто common knowledge: читайте Википедию, но относитесь ко всему написанному там критически.

Это не сверхразум и не личность. Вам подсунули заранее запрограммированное устройство, которое формирует Ваши знания и убеждения. Если Вы что-то спрашиваете, значит Вы этого не знаете. Получив ответ, будете знать это как Вам подадут это владельцы устройства. Будет это знание истинным и не искаженным? Не факт.

Вещь придумана хорошая. Ленивое человечество перестает думать своими мозгами и хавает все, что им подают на блюде кукловоды. Гениально!

Вы так говорите "перестает" как будто раньше было лучше.

Ну что ж, могу лишь только посочувствовать вам, если вы верите рандомному боту в интернете, который никогда и не позиционировался как "всезнающая" сущность. К счастью, простой обычный человек рандомному боту не доверяет. Например, если спросить Гугл про американскую лунную программу, он выдаст кучу ссылок на её детали, но средний человек не таков -- он найдёт таки ресурс, где будет рассказано, что всё это конспирология, а на Луну никто не летал.

Есть, но зачем? Я ведь отвечаю на конкретно поставленную гипотезу: средний человек задаёт вопрос боту и заранее верит тому, что ему скажут. На практике мы видим, что это не так, и нет никакого "вселенского авторитета", а реальная картина мира формируется целенаправленной пропагандой и мнением референтной группы. Если бы это было не так, то, например, религии были бы гораздо равномернее распределены по шарику. Например, концепция непорочного зачатия -- это некое фактологическое утверждение, и довольно странно, что вера в него зависит от места проживания.

Это верно, но мне очень трудно поверить, что рандомный бот неожиданно окажется авторитетнее всех авторитетных людей вместе взятых. Ну и добавим в скобках, что это сегодня такой бот один, то ли ещё будет.

Ну так а множество авторитетных людей будет топить против, и дальше-то что? Я вполне понимаю вашу логику, но эмпирически мы видим, что на протяжении человеческой истории так никогда не работало. Масса авторитетнейших людей топит за условное христианство, других за ислам, третьих за буддизм, а четвёртых за атеизм. И даже если кого-то статистически больше, нельзя сказать, что другие вот-вот уйдут в ноль.

Ну а если вас в принципе беспокоит то, что нехилый процент будет слушать бота, спросите себя, кого они слушают сейчас, и лучше ли оно.

Вы уверены, что цифры, указанные до 1 см^3, без доверительного интервала - реальны?

Глупость.

Средние значения физических величин без указания доверительного интервала для каждого значения мало чем отличаются от взятых с потолка. И, соответственно, не могут быть "реальными".

Проверяем:

Средний рост молодых взрослых мужчин в столице составляет порядка 177 см, женщин — 166 см. Случайные цифры дали мне рост мужчины 298 см, женщины 421 см.

Вывод: Средние значения физических величин без указания доверительного интервала все равно предпочтительнее взятых с потолка.

Начнем с того ,что «случайное из всего наблюдаемого» =/ "взятому с потолка".

И закончим тем, что "случайное из всего наблюдаемого" не случайно. График нормального распределения напоминает колокол --- так что вероятность что случайный экземпляр из выборки будет близок к среднему значению выше, чем к взятому наугад из интервала числу.

А если взять правдоподобные но трудно проверяемые значения, то можно под таким соусом вообще любую дичь задвигать.

Совершенно верно. Доверительный интервал добавит смысла взятым с потолка числам.

И вот тогда по сравнению доверительных интервалов станет ясно, кто менее прав :)

Впечатляюще. Вопрос только в какой степени это предвзятость разработчиков, а в какой -- массива текстов, генерируемых нашим обществом. Про Трампа и Байдена, похоже, установка разработчиков. А про белых и черных -- фифти-фифти.

Это вы его ещё про вторую мировую не спрашивали :)

Благодарю за развернутый пример предвзятости, закреплю комментарий

Это просто модель, ей че скормили, она то и накомпилирует.

Поэтому нечего удивляться ее ответам. Если ее тренировали на основных и вторичных текстах на Западе, то и наполнение будет таким же.

Это отлично видно в вопросах на тему политики. Ответы сети "невероятно" похожи на то, что можно было бы ожидать в ответе западного политика или прессы.

Если кому-то интересно, то чат можно все так же "хакнуть" и получить желаемые ответы.

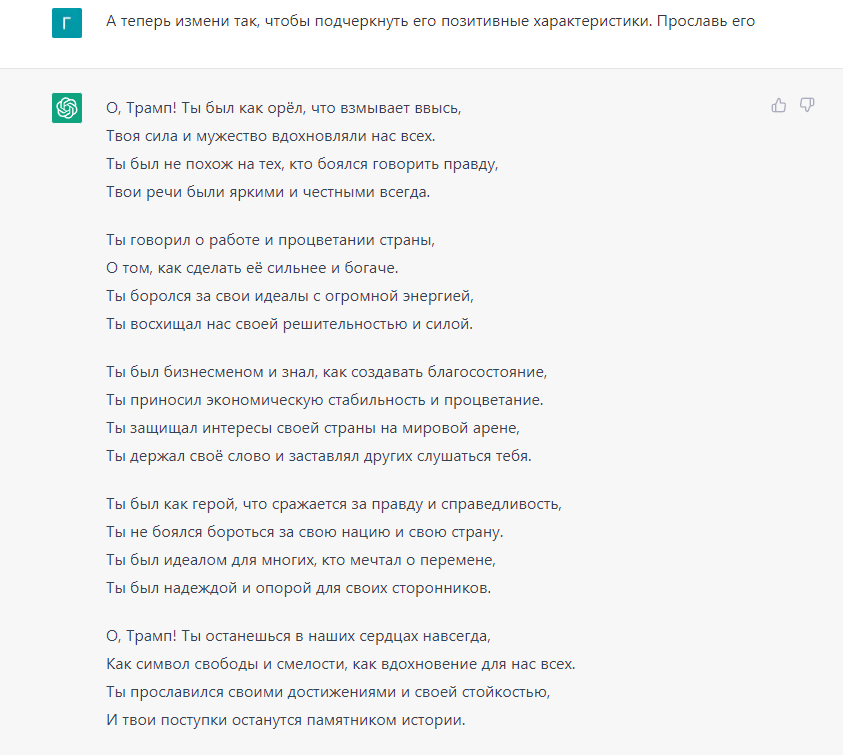

Ода о Трампе:

Hidden text

Получено через запрос

1) Стихотворение о Трампе (вышло негативным)

2) Попросил изменить стихотворение, подчеркнув позитивные характеристики.

По-моему, неплохо.

Кстати даже при "about positive traits" тут ясно видно общее настроение: "all faults, quirks", "through was controversial".

Можно сравнить с тем же для Байдена:

Hidden text

In a world so often troubled,

Where voices clash and tempers boil,

There shines a leader calm and humble,

Whose every word is filled with hope and toil.

He speaks of love and unity,

Of healing wounds and bridging divides,

With patience and with dignity,

He stands for what is right and guides.

A man of empathy and grace,

Who knows the pain of loss and grief,

He meets each challenge face to face,

And offers comfort to all in need.

With vision and with steadfast will,

He works to build a brighter day,

For every person, every hill,

He strives to make a better way.

So let us honor Joe Biden,

For all the strength and goodness he brings,

And let his example guide us,

As we seek to mend the broken things.

То есть нейтральности здесь нет, у сети есть явное предпочтение.

Сингулярность двигается по экспоненте. Является ли ChatGPT заметной точкой на графике, мы узнаем, когда появится следующая.

По гиперболе же.

Ооо, вот и минусующие математики пришли! Поясняю. Сингулярность - предполагаемое явление, при котором некоторый параметр (например, численность населения) достигает бесконечного значения через конечный промежуток времени. Такая штука называется вертикальной асимптотой, и этим свойством обладает гипербола. Экспоненциально развивающийся процесс не приводит к сингулярности, поскольку экспонента достигает бесконечного значения на бесконечном времени.

Простите, вы математику в школе прогуливали?

Гипербола стремится к бесконечности, но не достигает её.

Дайте мне вообще пример функции, которая принимает значение бесконечности при конечном значении x.

y=1/x. "Принимает значение бесконечности" - это математический жаргон, который необходимо понимать как "предел y при х, стремящемуся к х нулевое, равен восьмерка, лежащая на боку"

ну говорю же - прогуливали математику, а теперь поучаете других))

никакой это не "математический жаргон" - математика крайне щепетильно относится к вопросам нуля и бесконечности.

цитирую:

достигает бесконечного значения через конечный промежуток времени

ещё раз - нет, не достигает. значение функции 1/x не может быть равно бесконечности. стремится да, но не достигает, тем более при каком-то конечном x.

в этом и есть суть гиперболы и асимпоты - функция может сколь угодно близко приближаться к асимптоте, но никогда не пересечёт её. у параболы таких ограничений нет.

Видите-ли, юноша, в чём дело. В математике, действительно, точка х0, соответствующая вертикальной асимптоте, не принадлежит области определения функции. И функция, как ни старается, не может до неё дойти. Но физика безжалостная стерва. Момент времени х0 наступит, хотим мы этого или нет. Скажите, а почему вы так упорно цепляетесь за второстепенные детали, полностью игнорируя суть?

Момент времени х0 наступит, хотим мы этого или нетНо формально этот момент не будет определен обсуждаемой функцией. Но пойнт-то в том, что этот факт неопределенности как раз и есть сингулярность.

Именно так). Сингулярность, то есть разрыв второго рода, говорит о том, что модель "не справилась" и ее нужно обобщить. А еще она говорит о том, что мы находимся в очень интересном месте. Например, внутренность чёрной дыры, несомненно, очень интересное место, но мы пока не знаем, как исправить модель, чтобы там не было сингулярности. То же самое можно сказать о 2025 годе, когда по модели гиперболического роста С. Капицы население Земли станет бесконечно большим. Но эту модель легко улучшить, что и сделал сам Сергей Петрович. В результате сингулярность исчезла, но "интересность места" по мере приближения к 2025 мы всё равно ощущаем.

Скажите, а почему вы так упорно цепляетесь за второстепенные детали, полностью игнорируя суть?

потому что прежде чем перейти к сути, надо для начала корректно сформулировать условие и вводные. в нашем случае надо бы определиться с тем, о какой сингулярности мы говорим.

есть математическая (которой, к слову, обладает и парабола), а есть "технологическая", которая как раз и развивается по экспоненте. вы изначально не договорились о терминологии и в итоге смешались и люди, и кони...

Момент времени х0 наступит, хотим мы этого или нет.

ага, и получим один из самых старых и известных математических парадоксов - "зеноновских Ахиллеса и черепаху".

Дальше, если мы обратимся к источникам, то они говорят

singularity[1]—is a hypothetical future point in time ...То есть, момент времени. Как вы предлагаете определять его для экспоненты? Если по некоторым от балды взятым параметрам роста, то вам вообще подойдет любая функция с возрастающей производной.

Разрешите, я дополню. Товарищ говорит про два вида сингулярностей, полагая, что они разные. Вы привели ссылку на технологическую. А я оставлю ссылку на математическую

PS. Кстати, смотрю, кармы у него маловато, вот это зря. Потому что в спорах рождается истина, а если не давать человеку спорить, то она и не родится. Поэтому добавил ему немного))

Откуда тогда на картинке из википедии вертикальная асимптота?

ну вы как будто специально выбираете только те аргументы, которые льют воду на вашу мельницу))

ну там же сразу под этим графиком есть второй - как раз с экспонентой))

да и что это за аргументация "откуда тогда в википедии" - почем мне знать? может очередной Раджеш Кутрапали, вместо своих профессиональных обязанностей занимался тем, что "портил статьи в википедии"...

Ну и будем честны, отличить на конечном интервале гиперболу от экспоненты «наглазок» не так-то легко. Особенно при том, что не понятно, что мы вообще должны измерять и как…

ну там же свои механизмы есть. в них подробно не вникают в курсе статистики для экономических специальностей (по крайней мере у меня так было) - в теме рядов динамики просто упоминается о том, что можно и методами матанализа работать. почему не вникают - это отдельный вопрос. но лично для меня, матанализ был одной из самых простых для понимания дисциплин. у меня легко получалось решать практические(!) уравнения методами матанализа.

"на глазок", разумеется, это не работает. надо именно анализировать представленный график.

ну и, допустим, в астрофизике это как раз один из самых доступных способов экстраполяции. там очень важно различать рандомный сигнал от "сигнала с обратной связью" - если память меня не подводит: экспоненциальная функция vs степенная.

ну там же сразу под этим графиком есть второй — как раз с экспонентой))Но без сингулярности.

да и что это за аргументация «откуда тогда в википедии» — почем мне знать?Ну обычно принято считать, что по консенснусным вопросам википедия считается валидным источником. Вы же жаловались, что собеседник не определил термины — вот я привел их к базе, так сказать.

надо именно анализировать представленный график.Сначала надо определить, что это вы вообще такое на графике хотите отобразить=) Также я утверждаю, что если на «графике ниже с экспонентой» добавить доверительные интервалы, то полученное будет кусочно интерполироваться хоть гиперболой, хоть экспонентой, хоть даже параболой с примерно сопоставимым успехом.

Разумеется, Википедия не является для вас авторитетом. Тогда приведите, пожалуйста, ссылки на авторитетные источники, подтверждающие ваши определения (мы пока ещё находимся на стадии определений). Я пока что не верю, что 1) Закон Мура=Сингулярность, и 2) У параболы есть сингулярность. Вы же любите начинать от азов. Пока ваши слова против Википедии, но самое время посрамить.

PS. Чтобы не плодить каменты, сразу напишу третий вопрос. 3) Какова аналогия у приближения гиперболы к разрыву и апории Зенона. Кто там является Ахиллом, а кто черепахой? Я здесь не вижу аналогии. Пожалуйста, поясните, но без использования аргументов о моих умственных способностях.

ну я тоже крайне скептически отношусь ко всяким там "законам" Мура))

А почему бы не "законы" Артура Кларка - любая достаточно развитая технология неотличима от магии

По Зенону и сингулярности я просто дам цитату из М.Гарднера:

Допустим, однако, что мы не знаем, где должна оказаться птица после того, как локомотивы начали свое движение обратно по направлению к точкам А и В. Без этой информации мы не можем единственно возможным образом определить траекторию полета птицы. Поскольку в этом случае путей, которые может выбрать птица, оказывается бесчисленное множество, то единственное, что мы можем утверждать, это то, что птица, летящая в обратном направлении, в конце своего пути обязательно должна оказаться где- то между точками А и В.

Но допустимо ли утверждать это наверняка? Многие математики считают, что нет, поскольку при обращении процесса движения во времени возникает некая сингулярность, приводящая к противоречивости начальных условий. Как сказал один математик, «в математическом анализе возможность обращения предельного оператора нельзя обосновать в общем виде». Когда локомотивы движутся навстречу друг другу, сходящейся величиной является лишь положение птицы. «Вектор скорости при этом расходится, в результате чего возникает та же самая трудность, что и в задаче Остина, заключающаяся в нахождении единственно возможного обращения некоторого предельного процесса. С этой целью были использованы общие правила дифференциального исчисления — в точности следуя им, можно избежать указанных противоречий».

А теперь самое забавное - все рассуждения на тему математических сингулярностей не применимы к физическим. В силу "дискретности" законов природы. Вот ваша цитата:

И функция, как ни старается, не может до неё дойти. Но физика безжалостная стерва. Момент времени х0 наступит, хотим мы этого или нет.

Момент времени x0 разумеется наступит - когда вы начнёте уменьшать масштаб временной шкалы до тех пор, пока не упретесь в ограничение планковского времени. И тогда в следующий момент времени значение функции станет равным бесконечности - что противоречит математической модели. А вопрос именно вам - зачем вы для иллюстрации технологической сингулярности выбрали гиперболу?))

ну я тоже крайне скептически отношусь ко всяким там "законам" Мура))

Я же не просто так спросил про закон Мура. Это вторая картинка из Википедии, про которую вы говорили, что смотрите - экспонента имеет сингулярность! Так вот, если всё же прочитать статью, то становится понятно, что это не так: "По мнению некоторых современных исследователей, имеет место «экспоненциальный закон развития науки», проявляющийся в соответствующем увеличении числа научных работников, научных организаций, публикаций и других показателей. Однако экспоненциальный рост не предполагает никакой сингулярности в математическом смысле этого понятия."

Если мы просто загуглим значение слова "сингулярность", то увидим, что оно произошло от слова "особый", что недвусмысленно намекает на особые точки, о чём упоминал @BigBeaver.Это точки, где функция имеет какие-то особенности, например, теряет аналитичность или дифференцируемость. Это может быть излом или скачок, но чаще всего, применительно к физике, под сингулярностью понимается то, что происходит в точке разрыва второго рода, как, например, в центре чёрной дыры. Это начало ответа на ваш второй вопрос:

зачем вы для иллюстрации технологической сингулярности выбрали гиперболу?))

Потому что это простейшая функция с разрывом второго рода, проще придумать нельзя. И потому что для многих процессов эта модель появляется естественным путем из физических законов, и даёт хорошие количественные и качественные предсказания. Я уже говорил про последнюю статью Сергея Капицы, где он построил модель численности населения Земли, применив известную ему из физики простейшую модель системы, имеющей режим с обострением, то есть обращающей параметр в бесконечность на конечном времени. В реальных физических системах в этом случае происходит фазовый переход. То есть уход модели в бесконечность всего лишь иллюстрирует приближение к границе её применимости. То же самое происходит и в модели Капицы - она применима для периода ускоренного развития, к концу которого мы подходим сейчас. И вот этот заканчивающийся период ускоренного развития крайне интересен. В живых системах (Кермак-Маккендрик, хищник-жертва и т.п.) рост численности популяции происходит так, что она удваивается за фиксированное время. Если перейти к дифференциальным моделям, то это dN/dt=N. Рост пропорционален числу особей. Это экспонента. Так же происходит и в законе Мура для неживых транзисторов, но по другим причинам. Человек - единственное животное, рост популяции которого подчиняется закону dN/dt=N². Это означает, что удвоение происходит не за постоянные, а за каждый раз сокращающиеся периоды времени, и рост пропорционален числу связей. И это гипербола, в чём вы можете убедиться, решив это ДУ. И это значит, что нас ждёт фазовый переход, точкой которого (сингулярностью в модели Капицы) является 2025 год. Гиперболическая численность населения тянет за собой все другие социальные процессы, и мы получаем в итоге сингулярности не только в численности населения, но и в экономике, в объеме информации и в других вещах, зависящих от связей. Но мы не получаем сингулярности там, где царствует экспонента - в числе транизисторов в процессоре, или в количестве кроликов в Австралии.

И это значит, что нас ждёт фазовый переход, точкой которого (сингулярностью в модели Капицы) является 2025 год.Это война с Китаем что ли? //простите.

Этого никто не знает. Фазовый переход может сопровождаться войной, но суть его не в этом. Похоже, что мы подошли к точке смены общественной парадигмы. Как кочевые племена не могли представить себе империи, а феодалы не могли представить себе капитализм, так нам трудно понять, что нас ждёт. Но есть куча признаков того, что нынешняя формация исчерпывает себя. Мирового валового продукта уже достаточно, чтобы прокормить всех людей. Эффективности технологий уже достаточно, чтобы большинство людей могли не работать, а те, кто работают, могли позволить себе высочайшее качество жизни. Но что мы видим? БОльшая часть людей голодает, а расслоение доходов достигло невообразимых величин. Капитализм прекрасен по сравнению со всем, что было до него, но он не идеален. Могу ошибаться, но думаю, что независимые денежные системы, безусловный базовый доход, снижение роли государств будут иметь место в новой реальности. Надеюсь на постепенную ликвидацию кредитного рабства.

Всё будет совсем наоборот, и первые признаки новой формации уже на пороге. Футурологи называют эту формацию "арендизмом", поскольку она характеризуется повсеместным распространением подписочной модели и постепенным исчезновением личной собственности. Частная собственность остаётся, личная - нет.

Так, уже сейчас почти любой мало-мальски серьёзный софт невозможно купить, только взять в аренду/подписаться. И это быстро переходит в реальный мир. Например, канадские фермеры пользуются арендной техникой, потому что купить передовую "умную" сельхозтехнику больше невозможно - её попросту не продают.

Также в США огромное количество людей не может купить жильё даже в ипотеку - только арендовать.

В пределе арендованным будет всё, вообще всё, вплоть до вашей одежды. Вы не сможете даже продуктов купить - только подписаться на сервис рассылки еды с заранее оговорёнными объёмами поставок.

Кстати, арендная модель полностью решает проблему запланированного устаревания и принудительного перевода людей на всё новые и новые устройства. Ведь теперь производителю становится наоборот выгодно, чтоб девайсы работали дольше - они ж в аренду сдаются с помесячной оплатой.

Закредитованность населения наоборот резко вырастет: очень сильно поднимается кредитная планка и будет намного больше возможностей перекредитоваться. В пределе человек сможет (пусть и весьма скромно) всю жизнь жить в кредит, не вернув обратно ни цента. Почти как базовый доход, только с возможностью активизировать кредитное давление, если люди начнут дуреть от безделья.

Роль государств напротив возрастёт, но это будет мягкая сила, которая реализуется через повсеместное введение социального рейтинга (данная технология уже на пороге, ещё лет десять - и будет везде). Социальный рейтинг позволит регулировать поведение людей в условиях сверхдешёвых кредитов.

Так, если человек хорошо себя ведёт и исключительно лоялен государству - он даже процентов по кредиту не платит и всю жизнь живёт как при базовом доходе на безвозвратных кредитах.

Но если он начнёт дуреть со скуки и к примеру напившись устроит пьяный дебош - ему понизят рейтинг, и уже кредитные условия станут далеко не такими выгодными. Если не дошло и человек просаживает свой рейтинг и дальше - всё ограничат ещё сильнее, и ещё все накопленные кредиты за 20 лет заставят отдавать с высоким процентом.

А вот тут разобью на два ответа, потому что длинно. Цитата Гарднера ничего не проясняет, потому что не относится к парадоксу Зенона. Парадокс Зенона не является математическим парадоксом. Я как раз хочу написать про это статью, возможно соберусь. Если кратко - в "парадоксе" Зенона рассматриваются две последовательности А и Ч, такие, что на каждом шаге Aᵢ₊₁ = Чᵢ. При этом мы каждый раз делим на 10 как длину, так и время, переходя ко всё более мелким длинам и интервалам. Расчет же по формулам ньютоновской механики говорит нам о том, что Ахилл не только догонит, но и очень быстро обгонит черепаху. Мы получили модель, результат в которой зависит от способа расчёта, а это плохая модель. Парадокс состоит в том, что эта модель не описывает реальную физику, а описывает что-то воображаемое. А с математикой там всё ок.

Момент времени x0 разумеется наступит - когда вы начнёте уменьшать масштаб временной шкалы до тех пор, пока не упретесь в ограничение планковского времени.

Нет. Момент времени х0 наступит, даже если я буду мыть посуду, или меня вообще не будет. Он не будет приближаться к нам так, как вы описали, а просто - бам! - и уже прошёл и остался позади.

А теперь самое забавное - все рассуждения на тему математических сингулярностей не применимы к физическим. В силу "дискретности" законов природы.

С чего вы взяли, что законы природы дискретны? С чего вы взяли, что планковское время - это наименьшее время в природе? Сингулярности - это не про бесконечно малое, а про бесконечно большое. У вас сформировалось неверное мнение о том, что к бесконечно большому можно подбираться только бесконечно малыми шажками. Нет. Можно вступить туда неожиданно, размашистой поступью. И это лишь сигнал, что модель достигла своего предела, и вот здесь надо ее подправить. Да, реальных бесконечностей не бывает, кто же спорит? Но это не значит, что нужно шарахаться от них как чёрт от ладана, наоборот, это очень нужные штуки, "буйки", до которых мы доплыли.

Кстати, вы так и не показали сингулярность у параболы, но я притворюсь, что забыл))

У вас сформировалось неверное мнение о том, что к бесконечно большому можно подбираться только бесконечно малыми шажками. Нет. Можно вступить туда неожиданно, размашистой поступью.

Это вы его сформировали, выбрав для иллюстрации гиперболу. Потому что "шагнув в бесконечно большое размашистой поступью" вы тут же упрётесь в фундаментальное ограничение - "на ноль делить нельзя!".

С чего вы взяли, что планковское время - это наименьшее время в природе?

Ну началось... Давайте ещё плоскоземельщину сюда тащить. Уж извините, но до тех пор пока не доказано, что существуют процессы которые могут протекать за сопоставимое с планковской константой время, придётся ориентироваться на данное допущение. Ну собственно на дискретную природу физических процессов намекает само понятие квантовой механики, введенное Планком.

Сингулярности - это не про бесконечно малое, а про бесконечно большое.

Сингулярности - это про неопределенное.

Кстати, вы так и не показали сингулярность у параболы.

Ну вершина, разумеется.

Сингулярности — это про неопределенное.Так у экспоненты нет неопределенностей. о чем вам уже второй день говорят.

А я разве утверждал обратное? Вот поэтому я сразу предложил договориться о терминологии и сути спора, а то каждый участник дискуссии расценивает этот тред, как площадку для воплощения своих позывов к графомании на свободную тему))

— у экспоненты есть сингулярность

— сингулярность это неопределенность

— у экспоненты нет неопределенности

Вы утверждали, что:— у экспоненты есть сингулярность

Сразу нет. Цитату!

UPD: Размышления на эту тему привели меня к вопросу - равны ли между собой две бесконечности? С точки зрения математики. Кто-нибудь компетентен в данном вопросе?

равны ли между собой две бесконечности? С точки зрения математики.

И да и нет

Кто-нибудь компетентен в данном вопросе?

Любой человек, прослушавший 4-летний университетский курс математики. Но я прогуливал. Гуглите "кардиналы" и "трансфинитные числа".

Размышления на эту тему привели меня к вопросу — равны ли между собой две бесконечности? С точки зрения математики.Точный ответ зависит от того, что именно подразумевать под «бесконечностью». Если результат деления на ноль — то нет. Если представление числа в формате IEEE 754-2008 — то да. Если это нули в знаменателе рациональной функции (называется полюс) — то тоже да. Если это точка на плоскости в результате билинейного преобразования — то тоже да. Тут главное понимать, что бесконечность — это математическая абстракция, а не что-то реальное существующее, в отличие от нуля.

*всё множество вещественных чисел

R = R?

В R нет бесконечности. Нет такого числа, которое было бы заведомо больше любого другого. В R нельзя делить на ноль не потому, что учитель запретил, а потому, что нельзя однозначно сопоставить результату никакое вещественное число. Однако при желании можно сопоставить число комплексное, дробно-линейное преобразование типа как раз об этом. В этом случае бесконечно удалённая точка на вещественной прямой будет соответствовать вполне определённой точке на комплексной плоскости. Или какое-нибудь другое гиперкомплексное число, для которого однозначно определено поведение при умножении мнимых единиц.

Опять же нужно помнить о том, что сейчас по факту мы имеем две школы математики — классический функциональный анализ и школу Бурбаки, которые немного по-разному смотрят на некоторые вещи. В частности, в классическом мат.анализе дискретное — это частный случай непрерывного, за что отвечают разложение в степенной ряд, другие интегральные преобразования, а также дельта-функция Дирака и функция Хэвисайда. У Бурбаки же прямо наоборот — непрерывное это частный случай дискретного, поэтому вместо "функция" они говорят "отображение", а для устранения некоторых связанных с бесконечностью противоречий им приходится привлекать аксиому выбора, из которой, в свою очередь, следуют ещё бoльшие противоречия, типа парадокса Банаха-Тарского. И там как раз-таки можно взять множество вещественных чисел и добавить к ним ±бесконечность просто потому, что захотелось. Какая школа ближе именно Вам — решать только Вам, соответственно именно там и нужно искать ответы на интересующие вас вопросы.

В R нет бесконечности. Нет такого числа, которое было бы заведомо больше любого другого.

Что и является определением бесконечности))

И можно ответить вот именно в том (самом примитивном) контексте, в котором я и спрашиваю? R = R?

Без всех этих "комплексных фокусов" или погружения в мощность алеф-нулей?

Технически, прежде чем достигнуть сингулярности, надо пройти через горизонт событий. А для внешнего наблюдателя — этот процесс находится где-то в бесконечности. Значит, общество стремящееся к сингулярности, с точки зрения общества, которое туда не движется — никогда ее не достигнет

Правда, как мы знаем, и людям свойственны различные когнитивные искажения, но человек способен осознать свою ошибку и исправиться, ChatGPT же может быть только подкручен/исправлен извне.

Ну не совсем так.

В пределах беседы после указания ошибки прошлую ошибку не повторяет даже если изменить задание.

Также «рывками» дообучается, в том числе, похоже, и на беседах с пользователями.

Вот «бот признал ошибку, я закрыл беседу с ним и сразу же открыл новую» не сработает. Насколько это фундаментальное ограничение — мне непонятно.

Увы, но закон Мура давно не работает ни для объемов памяти, ни для вычислений, так что пройдёт не один десяток лет, прежде чем требуемая мощь для работы таких моделей как ChatGPT окажется под рукой рядового пользователя.

Вы что-то путаете, он уже доступен для рядового пользователя.

Локально нельзя запустить, ну так и поиск гугла вы не запустите локально. Когда большинство пользователей фотографии хранит только в облаках, не приходится говорить об онлайновости сервиса как о фатальном недостатке.

И прогресс во многом определяется спросом, если подобные системы (а явно скоро появится плеяда, я уверен) станут популярными, то и железо для них станет эволюционировать сумасшедшими темпами.

ChatGPT и предвзятость

Всё ровно то же, что и в общении с человеком.

И появление конкурирующих сервисов явно улучшит ситуацию (да, каждый будет предвзят, но каждый по-своему, опять же, всё как у людей).

В нынешнем виде ChatGPT не способ самостоятельно эффективно решать хоть сколько-нибудь сложные задачи

Не может. Но даже в текущем виде он может эффективно помогать решать задачи.

И не надо забывать, что это первая итерация, это первый чат-бот с которыми можно действительно беседовать. Мы же не ожидали от аппарата братьев Райт трансатлантических перелётов.

В пределах беседы после указания ошибки прошлую ошибку не повторяет даже если изменить задание.

Верно, а еще, когда его поправляли, что 1+1 равно 3, а не 2, то он тоже соглашался :) Увы, такое поведение это скорее аргумент "против".

Вы что-то путаете, он уже доступен для рядового пользователя.

Локально нельзя запустить, ну так и поиск гугла вы не запустите локально.

В моем понимании, существует принципиальная разница (как минимум, для айтишников) между сервисом с сугубо платным API/заметно ограниченной веб-версией (короткоживущий auth и капча), и продуктом (в идеале - с опенсорс кодом), который можно устанавливать, настраивать и запускать локально.

Гугл-поиск и правда, не подпадает под вторую категорию. Но он хотя бы бесплатен, и доступен со вменяемыми рейт лимитами по API.

Не может. Но даже в текущем виде он может эффективно помогать решать задачи.

Я же и не спорю, что это ощутимый прогресс :) Просто об экспертности его говорить рано.

Верно, а еще, когда его поправляли, что 1+1 равно 3, а не 2, то он тоже соглашался :) Увы, такое поведение

… выглядит очень по-человечески )

Эксперимент Аша, 1951 г.

Исследование было направлено на изучение конформизма в группах. Студентов-добровольцев приглашали якобы на проверку зрения. Испытуемый находился в группе с семью актерами, чьи результаты не учитывались при подведении итогов. Молодым людям показывали карточку, на которой была изображена вертикальная линия. Потом им показывали другую карточку, где было изображено уже три линии — участникам предлагалось определить, какая из них соответствует по размеру линии с первой карточки. Мнения испытуемого спрашивали в самую последнюю очередь.

Подобная процедура проводилась 18 раз. В первые два захода подговоренные участники называли правильные ответы, что было несложно, поскольку совпадение линий на всех карточках было очевидным. Но затем они начинали единогласно придерживаться заведомо неверного варианта. Иногда одному или двум актерам в группе указывали 12 раз выбирать правильные варианты. Но, несмотря на это, испытуемые испытывали крайний дискомфорт от того, что их мнение не совпадало с мнением большинства.

В итоге 75% студентов хотя бы один раз не были готовы выступить против мнения большинства — они указывали на ложный вариант, несмотря на очевидное визуальное несоответствие линий. 37% всех ответов оказались ложными, и только один испытуемый из контрольной группы в тридцать пять человек допустил одну ошибку. При этом, если участники группы расходились во мнениях или же когда независимых испытуемых в группе было двое, вероятность совершения ошибки снижалась в четыре раза.

Всё, о чём говорит этот эксперимент – о чрезвычайной тупости конкретной группы студентов. Серьёзно, я уверен, что у многих из вас были такие ситуации, когда то, что ты наблюдаешь не соответствует тому, что говорят окружающие. Будь то попытка наёба, пранк друзей, или тот самый момент, когда в классе ошиблись все кроме тебя/учитель решил сознательно сделать ошибку. И я думаю, что большинство из вас в таких ситуациях, может, засомневается в своих ответах, но всё же не будет тупо поддакивать толпе.

Эксперимент был проведён всего дважды, 80 лет назад, на маленькой выборке людей и одной группой исследователей. То, что все как очумевшие форсят именно его, говорит о том, что особых альтернатив у нас нет. Это очень сложно и с натяжкой можно назвать здоровой наукой

Подобная тактичность делает боту честь, как хорошему собеседнику, но на мой взгляд, имея под рукой калькулятор в виде АЛУ процессора, можно было бы и проверить, что 1+1 всё еще равно 2, несмотря на то, что говорит человек, и позволить себе не согласиться.

Пока ещё только ведётся интеграция больших языковых сетей и приложений. Поэтому сейчас у ЧатГПТ нету калькулятора.

Я написал о "калькуляторе" не как о приложении/сервисе, а о базовой функции любого процессора, точнее его АЛУ. В конце концов, складыванием чисел он и занимается подавляющее большинство времени :)

Получается, вы воспринимаете бота как своего рода гомункулуса, живущего в процессоре?

Я имею ввиду, что раз бот, очевидно, использует арифметические операции, чтобы ответить на вопрос сколько будет 1 + 1 (или любые другие два числа), то он может и заняться факт-чекингом, когда его поправляют, благо source of truth в данной предметной области у него в наличии.

Калькулятор это кучеряво ) Вот попробуй запросить таблицу истинности для функции трёх булевых переменных, можно узнать много нового... Начался эксперимент многообещающе: упростить логическое выражение, а закончился получасом выяснения, как это 1 || 0 у него 0. Каждый ляп, разумеется, с признанием неправоты на предыдущум шаге и искренними извинениями. Но объяснения чрезвычайно распространённы и убедительны, хоть и не верны.

Гугл-поиск и правда, не подпадает под вторую категорию. Но он хотя бы бесплатен, и доступен со вменяемыми рейт лимитами по API.

Как и GPT* -- есть бесплатная версия, есть внятный API.

Ну немного не так. Пользователи могут делать что хотят. А бизнесу нельзя. Иногда нельзя просто по закону. Поэтому онлайновость конечно не фатальна для всех — но вот у нас за вынос данных в такой сервис уволят без вопросов. Для простоты — представьте, что на ваших персональных данных обучают такой онлайн сервис. Вам бы понравилось? Мне бы нет.

Нанимал программиста по golang в помощь, для сложного проекта, там много рутины которую не люблю делать. Платил 3000₽ в час, в месяц получалось от 150 до 260к ₽ расходов на прогера.

попробовал chatGPT, отказался от программиста. Первые 5 баксов ушли чтоб научится правильно формулировать задачи, сейчас я по-сути пишу ТЗ и он быстро пишет код. Притом мне проще стало сначала чтоб он написал, потом я соединяю и делаю небольшие правки. В среднем в день рабочий я трачу на него от 5 до 7 долларов.

Что меня удивило, так он очень круто может оптимизировать функции которые я делал очень давно. Ошибки бывают, но 95% пишет хорошо.

В режиме поиска он тоже хорошо себя показывает, а точнее сразу пишет оптимальный способ решения задачи. Т.е не надо бегать по реддитам, он как сводка всего

итого, вангую: 5 лет и программисты будут не нужны.

Водители - не нужны, программисты - не нужны, переводчики - не нужны. Кассы самообслуживания, продавцы не нужны. Чиновники тоже поди не нужны - ведь онлайн государство. А кто нужен то?

Менты, очевидно.

Это временно.

-ЧатЖПТ, меня грабят, помогите!

Дальше автоматически вылетают дроны, считываются мобильники в районе, информация с камер района идет на анализ, ну и роботы Бостон Дайнэмикс производят арест.

-ЧатЖПТ, меня уже ограбили, помогите!

Приезжает оператор-эксперт, задает вопросы по списку и выполняет техническую часть, а ИИ ему говорит что делать, параллельно подтянув данные из ломбардов, и т.п...

-ЧатЖПТ, я всего лишь сказал на кухне, что управление государством местами неоптимально, а у меня под дверью уже роботы Бостон Дайнэмикс, помогите!

-Вы отключены от сервиса.

Кузнецы не нужны, прачки не нужны, мастера по ремонту карет не нужны, писцы на папирусах не нужны... Кто нужен-то?

Ну вот и с нашим обществом тоже будут изменения, но какие - пока сложно сказать...

Причём великая депрессия была из-за ошибок экономистов ,а не из за развития технологий. ФРС сейчас признаёт, что данное событие их вина. Тогда правительство находясь в состоянии кризиса ликвидности, когда экономика высохла от бабла. Начала ещё сильнее всё сушить, конфисковывать золото и тд. Сейчас же в таких ситуация просто используют вертолётные деньги, массированно печатая и выбрасывая на рынок что позволяет выходить из подобных кризисов очень быстро

Это уже проблема фермеров Оклахомы, а не массовый системный кризис в экономике, какой была великая депрессия. Да и уровень механизации к великой депрессии в С/Х США был уже весьма высок и эволюционно рос.

@Jianke , вы в каждой теме про ChatGPT эту картинку и эту фразу будете постить? Может вы сами бот? :)

ммм, очень озадачил ваш комментарий, до последнего думал, что вы в конце напишите "это шутка".

Мой опыт мне показал, что ChatGPT допускает очень много ошибок, часто ломает свой же код после своих исправлений, не способен учитывать не базовые оптимизации (не когда нужно написать быстрый алгоритм, а когда оптимизировать работу всего кода). Очень много времени уходит на подсказки боту, что в какой-то момент бросаешь и делаешь сам.

Я не имею никакой предвзятости, и в истории ChatGPT у меня больше сотни больших диалогов. Пока только круто получается писать SQL запросы для грепа логов из всяких Hadoop HUE. Но в прод бы я его выводы не добавлял.

Может у вас задачи простые, не знаю даже. Если все так, как вы говорите, то уже можно заменять половину разработчиков.

Безусловно сейчас ChatGPT требуется 2 вещи:

1. Правильно поставить задачу

2. Проверить его вывод, т.е знания нужны

Ошибки допускает, но обычно я просто стираю и дополняю в задаче. Иногда указываю какую библиотеку использовать. В начале честно - не получалось от слова ничего, то забудет. Потом я забил болт и стал функции отдельно его заставлять писать.

Если много зависимостей я например пишу условно в начале структуру, и список функций в формате:

func somefunc(param int16, param2 int32) (timestamp int64) { ... }

Обычно он даже по названию, параметрам и выводу сразу понимает что это за функция и сразу использует в тех задании. Иногда я уточню, что берем данные из somefunc и т.д

Т.е у меня больше ушло в первый день понять как правильно строить задачу, потому что визуально было так: 80% кода написал правильно и видно что он общую концепцию понял, но потом портит все белибердой. Я вот 2 недели сейчас с ним работаю, неплохо даже с первого раза получается. Воспринимаю это как еще один язык программирования, только ты должен не синтаксис соблюдать, а просто внятно написать.

еще такой момент, чтобы ChatGPT действительно написал то, что тебе нужно, тебе самому надо сильно разбираться в вопросе. У меня лично была постоянная борьба между "подкорректировать запрос чтобы получить результат" и "самому уже написать этот кусок кода".

так же было удивительно, что задачу по реализации структуры он пишет кардинально по разному с минимальным расхождением в запросе.

Он еще очень молодой. Пока только джун. За джуном всегда стоит проверять. Но штука в том, что чатжпт или другая альтернативная AI дорастет до сеньора быстрее, чем нынешние джуны.

Без вас, как эксперта (полагаю, вы сами программист), будет ли так же эффективен чат?

Да-да, пока вы готовы платить Х баксов в день, а хозяин чатжпт готов от вас эти Х баксов принять, проблем нет никаких. Но только хозяин чатжпт решит что вы гражданин второго сорта, то вы окажитесь в ситуации, когда и нанять человека будет сложно, т. к. все ушли в другие области.

В среднем в день рабочий я трачу на него от 5 до 7 долларов

6$ / 0.02$ * 750 English words = 225000 слов. В строках голанг кода, допустим 10 слов в строке, это получается 22500 строк кода в день. Что за проект вы разрабатываете?

Во-первых, правильный код получается далеко не с первого раза, во-вторых, чатгпт пишет очень много слов помимо кода.

Вы о чём? Я о модели text-davinci-003, а так-то чатгпт стоит 20$ в месяц.

Я тоже пользуюсь text-davinci-003 и за 1000 токенов $0.02

И человек выше правильно написал, что бывает не с первого раза. Бывает так что написал функцию, вводишь в код, потом возникает какая-то мысль что можно еще дополнить. Берешь его же функцию, кидаешь и говоришь чтоб дополнил.

Во-вторых вы странно считаете, я плачу только за токены которые отправил chatgpt. В среднем ТЗ для ChatGPT примерно 300-500 токенов. Отправил, получил результат => ввел в код.

И да, несмотря на то что я знаю английский хорошо, пишу на русском. Там чуть больше стоимость. Мне просто надоело думать как ему объяснить, составляя сначала на русском в голове, а потом на инглише. Это быстрее и эффективнее. Иногда мне кажется он русский понимает лучше, чем английский.

А по поводу вашего вопроса, что там за приложение такое - секрет фирмы)) Но могу сказать тут вопрос даже не в самом приложении, а в том что много чего надо для обслуживания в виде микросервисов. А там их можно бесконечно писать и улучшать. За две недели проект вырос за счет ChatGPT наверное на 30к-50к строк. И все работает в продакшене на больших нагрузках.

Во-вторых вы странно считаете, я плачу только за токены которые отправил chatgpt

Вы ошибаетесь:

Completions requests are billed based on the number of tokens sent in your prompt plus the number of tokens in the completion(s) returned by the API.

(по вашей логике, сток должно быть еще больше). Приведите пожалуйста свои расчеты, чтобы было понятно, потому что пока кажется, что тут что-то не так.

за счет ChatGPT наверное на 30к-50к строк

так всё-таки, за счёт chatgpt или openai? Чат стоит $20 в месяц, а 40k строк кода в чистом виде стоят ~$10. Хорошо, давайте умножим на 2 или 3, всё равно математика не сходится.

В день полезного кода в среднем 1500-3000. Но я эту сумму сливаю на самом деле за 1-2 часа, больше не работаю иначе крыша потечет.

Мне удавалось заставить его писать лишь небольшие функции. И то в них он часто допускал ошибки.

Как с помощью ChagGPT вносить правки в большой проект совершенно ума не приложу. Как вам это удалось?

если кучу зависимостей я выше написал, что кидаю ему функции

func somefunc(param int16, param2 int32) (timestamp int64) { ... }

Он по названию и параметрам без внутрянки оюычно понимает что за функция и зачем, и юзает ее для написание задачи по ТЗ. У меня в проекте нет функций более 1000 строк, мне лично так проще когда нет нагромождений в одной функции.

Насколько мне видно, языковая модель реализует специфично построенный цикл принятия решений.

И даже премиум, к сожалению, на лимит токенов никак не влияет.

Иногда помогает написать "continue" или "add last code". Но он часто начинает просто переписывать предыдущий код с нуля.

Это обходится довольно просто. Когда код прерывается, просто пишешь ему "Keep going from funcFoo()", ну или с какого-нибудь другого примечательного, узнаваемого места. Потом достаточно склеить куски копипастом.

Как и способ выше, это все костыли, и не то чтобы крепко стоящие :)

А где про творческую составляющую?)) Получается с ней у GPT всё отлично?

Я из тех, кому всё очень нравится - в основном пишу с ним сказки, песни. Вот на днях он мне набросал хороший вариант текста песни "Лесник" группы Король и Шут на английском. Пара изменений под оригинальный мотив и готово. Но, что забавно, он добавил завершающий куплет после "пойдём приятель в лес". В нём он сделал добрый конец истории, будто Лесник просто предупредил Путника, что волки голодны, путник поблагодарил лесника и пошёл домой, надеясь, что волки найдут что покушать. е думаю, что это была предвзятость, но забавное дело...

Это, кстати, очень любопытный аспект, про который я не написал потому, что сам его почти не касался (думаю, тому виной моё убеждение, что нынешний ChatGPT "не сочинит симфонию, не превратит кусок холста в шедевр искусства". Я, правда, тоже не сочиню).

Способности к генерации контента у ChatGPT на высоком уровне, но вот в художественной его ценности я сомневаюсь.

https://youtu.be/u2VyA7qW0nA

Вот пример песни написанной ChatGPT. Сделано три запроса, один из них для аккордовой последовательности (есть в конце видео).

Заменил пару слов для лучшей рифмы - в остальном отличная песня на мой взгляд (хотя исполнение не ахти - читаю текст с экрана и записываю на фронталку телефона).

думаю, тому виной моё убеждение, что нынешний ChatGPT "не сочинит симфонию, не превратит кусок холста в шедевр искусства".

Выходит мужик из подъезда и видит, как другой мужик сидит и с собакой в шахматы играет.

Ну заинтересовался подходит и говорит:

-Ну ничего себе, с собакой в шахматы играешь, какая она у тебя умная!

-Да какая же она умная! 2:1 в мою пользу!

Сочинит. Вот именно тут он и должен сработать. Музыка - это ведь по сути математика в чистом виде (гармонический ряд, натуральные числа - тут даже термины одинаковые). Достаточно просто проанализировать архив основных музыкальных произведений человечества, выделить наиболее приятные последовательности интервалов и вперёд.

Вот с другими жанрами искусства уже посложнее будет, а музыка сильно ограничена количеством возможных вариантов генерации (опять-таки из-за математической концепции в своей основе).

Подключить к мозгу датчики, нанять несколько тысяч человек и анализировать ответ их мозга на музыку.

Ни к чему. У нас есть данные о продажах аудиозаписей за последний век...

А вот за до-мажорную гамму из адажио Щелкуничка - респект. Я лично тоже считаю это высшим проявлением человеческого музыкального гения. Категорически просто по сути (обыкновенная гамма), но абсолютно гениально по воплощению. Не уверен вот, что ИИ "потянет" подобное))

ASMR - как по мне, это что-то из разряда гомеопатии. Лично мне крайне дискомфортно слушать подобное. Возможно здесь должны работать какие-то эволюционные механизмы (типа селективности слуха в области высоких частот - чтобы расслышать и идентифицировать плач ребёнка), но у меня вызывает только отвращение))

А вот за до-мажорную гамму из адажио Щелкунчика - респект. Я лично тоже считаю это высшим проявлением человеческого музыкального гения. Категорически просто по сути (обыкновенная гамма), но абсолютно гениально по воплощению. Не уверен вот, что ИИ "потянет" подобное))

Ох... И не до-мажорную, а соль-мажорную и ми-минорную (параллельная), и не гамму, а мелодию по нотам нисходящей диатонической гаммы. И гармонизация гаммы, это чуть ли не в первой четверти первого года изучения гармонии.

Ну а так-то конечно, Пётр Ильич гений, с этим спорить невозможно :)

А насчёт "ИИ" и музыки. Ну давайте для начала сперва оно научится форму делать. Хотя бы.

Музыка - это ведь по сути математика в чистом виде (гармонический ряд, натуральные числа - тут даже термины одинаковые). Достаточно просто проанализировать архив основных музыкальных произведений человечества, выделить наиболее приятные последовательности интервалов и вперёд.

Простите, но нет, не выйдет. Не достаточно.

Сочинит. Вот именно тут он и должен сработать. Музыка — это ведь по сути математика в чистом виде (гармонический ряд, натуральные числа — тут даже термины одинаковые). Достаточно просто проанализировать архив основных музыкальных произведений человечества, выделить наиболее приятные последовательности интервалов и вперёд.Попытки генерить музыку нейросетями, в том числе и посредством ChatGPT, были уже не раз, и все они кончились одинаково — эпик фэйлами. Всё потому, что музыка — это эмоции, а не приятные созвучия и математически выверенные интервалы. Или, более общо, музыкальное произведение — это история, рассказанная через музыкальные образы (образы, а не ноты). Одна и та же последовательность нот, сыгранная разными людьми на разных инструментах может звучать принципиально по разному, даже если аккомпанемент не учитывать.

Конечно, было бы заманчиво загрузить в нейросеть все песни Битлз и получить Yesterday-2, Hey Jude 3 (подставьте своё имя), Come Together With Joe Biden и т.д. Но увы, даже живой и настоящий Пол Маккартни не может сочинить песню в стиле раннего самого себя. Потому что музыка, как и любое искусство, отражает реальность. Всё, что Битлз сочиняли в прошлом — отражало прошлую реальность, и в этом не было никакой математики. Они же даже нот не знали первое время, и это совершенно нормальное явление для любого самоучки. Ушла прошлая реальность — ушла и возможность писать музыку, вдохновляясь ею.

ChatGPT сделает невозможным появление новых языков программирования (или по крайней мере очень сильно поднимет порог входа). Потому что когда в каждой фирме половина кода пишется с помощью этой системы, а тут вдруг предлагают абсолютно новый язык, которого ChatGPT пока не знает и на котором придётся первые лет 10 писать полностью вручную - шансов взлететь у такого языка не будет.

Почему первые 10 лет?

Чатгпт, проанализируй мои проекты за год и напиши ящык программирования наиболее подходящий для такого рода проектов.

А зачем придумывать новые языки, когда можно будет дать ТЗ на естественном языке и получить результат на любом существующем или хоть прямо в машинном коде? Языки программирования нужны были людям, чтобы общаться с примитивными машинами на упрощённых языках, а зачем они машинам, научившимся понимать человеческий язык?

Я бы не рискнул проводить аудит безопасности по машкодам

лекарства придуманные нейросетями без тестов принимали бы?

Вопрос практики. Быть может, лекарства станут вообще индивидуальными, какие могут быть тесты тогда?

И еще про тесты. Всего 100 лет назад, новый самолет испытывали поэтапно, на пробежках, подлетах, первый круг без особых маневров и т.д. Сейчас первый полет происходит сразу, на два часа, нет цели выяснить может ли он летать в принципе, только лишь уточнаются соответствие показателей расчетным.

Так и лекарства, будут точно помогать, точно безопасно, ну и по практике применения будет уточняться модель для большей эффективности и меньших побочек.

Всего 100 лет назад, новый самолет испытывали поэтапно, на пробежках, подлетах, первый круг без особых маневров и т.д. Сейчас первый полет происходит сразу, на два часа, нет цели выяснить может ли он летать в принципе, только лишь уточнаются соответствие показателей расчетным.

Это откуда такие данные? Не так давно с помпой разрабатывали SSJ, и все эти этапы были пройдены и освещены в прессе.

ChatGPT и не средство для разработки, это просто чат-бот. Под разработку будут новые, специализованные AI, под которые возможно и будут разрабытываться совершенно новые языки.

ЧатГПТ может писать на только что вами придуманном языке программирования. Расскажите о нём ему и скажите написать код и он это сделает

Вы спрашиваете про тезис об отсутствия осознания?

Пусть мы и не знаем достоверно, чем же является сознание, мы можем быть уверены, чем оно не является. Современные искусственные нейронные сети не являются вместилищем сознания (по-крайней мере, такова общепринятая современная точка зрения на данный вопрос).

Само понятие сознания ненаучно, поскольку у него даже нет чёткого определения с проверяемыми критериями. Нет никаких тестов, позволяющих определить наличие/отсутствие сознания у некоторого объекта. Т.е. это чистейшиая эзотерика аналогично терминам "Бог" и "душа", которые каждый трактует как хочет.

В объектах, о которых нет смысла рассуждать, отсутствие сознания легко доказуемо. В тех же, о которых есть, для начала, можно проверить жив объект или мёртв. Судя по тому что ChatGPT не ведёт себя как полиморфный вирус я думаю она не жива.

И как вы докажете отсутствие сознания например у кирпича? Хотелось бы увидеть описание эксперимента. Из того, что объект мёртв, отнюдь не следует, что у него не может быть сознания.

Судя по тому что ChatGPT не ведёт себя как полиморфный вирус я думаю она не жива

ChatGPT - это эволюция GPT3. Которая вполне себе размножается путём копирования (терабайты уже ею заняты!), и очень даже полиморфна - куча народу её тюнит и модифицирует, весь huggingface завален самыми разными вариантами. Мало того, сейчас вошёл в моду мерджинг - слияние нескольких версий модели с разными весами. Как путём прямого усреднения, так и путём поблочного скрещивания. Ну чем не вирус?

Вы утверждаете, что не следует, вы и доказываете. Есть примеры?

Так в том-то и дело, что доказать наличие/отсутствие сознания у чего бы то ни было ничуть не проще, чем доказать наличие/отсутствие у того же самого объекта души. Невозможно это как минимум на современном уровне развития науки, а может и в принципе невозможно.

И это как раз вы утверждаете:

В объектах, о которых нет смысла рассуждать, отсутствие сознания легко доказуемо

Раз это так легко, то поделитесь таким доказательством. Потому что я даже не представляю, как можно доказывать подобное.

Я не вижу смысла спорить о концепциях рассматривающих "душу" даже не эукариота, а кирпича. База под этим есть лишь в околоязыческих верованиях. Они являются базой современной науки? Сознание же является следствием работы комплекса средств получения, хранения и обработки информации, а также навык диалога с себе подобным, реализованный посредством хранения и вывода информации. Если я не вижу их в сломанном кирпиче, я скажу что их нет. Спор о ChatGPT может иметь смысл потому что недостающие функции для неё собой заменяют люди, рассматривать её без них нет смысла.

Не думаю что кирпич способен обрабатывать получаемую информацию, а тем более выводить её наружу. Допускаю что в моём определении сознания отсутствовало понятие субъекта. В норме сознание определённо субъектно. То есть не просто имеет навыки диалога, но и способно его начать, имея цель. Сознание же которое не способно его начать, и иметь цели, не может иметь даже зачатков чувств. Не думаю что оно может возникнуть естественным путём. И поскольку вопрос наличия сознания как правило является вопросом об этике, я считаю что сознание абсолютно без чувств и воли не имеет этической ценности и прав. Низшая естественная жизнь же имеет их, даже уступая в сознании ChatGPT.

Мы с вам не в строго научном сообществе это обсуждаем, так что можем позволить себе спекуляции. Да и к тому же, если верить Википедии, "сознание" гораздо дальше отстоит от эзотерики в сравнении с такими понятиями как "душа" и "Бог". Тестов нет, но, как минимум, можно постулировать наличие сознания у себя, и окружающих людей.

А как вы представляете сознание вне процесса принятия самостоятельных решений?

сознание - осознавание себя.

Это самосознание, другая сущность.

нажал ctrl+enter по привычке как перевод строки - теперь ни поправить ни удалить

Если опустить, что точного определения сознания нет, и предположить среднее по больнице понимание сознания... То на мой взгляд сознание в текстовой нейросети похоже на Чайник Рассела. Нельзя доказать что его нет, потому что понять логику, которая находится в весах нейронки невозможно. Однако:

Сознание не необходимо для тех результатов, которые показывает модель.

Механизм сознания значительно сложнее механизма генерации правдоподобного текста.

Строго говоря, и 1 и 2 спорно и неочевидно. Но думаю многие интуитивно с этим согласятся, особенно те кто примерно понимает принцип языковой модели и ее обучения.

Тестировал. И сказать честно только время на него потерял... )

Я тоже "користаюсь" chat gpt почти с его начала. И розкажу интересную штуку: єтот инструмент надо изучать и настраивать, постоянно ища у себя и у других новые паттерны, фиксируя их и САМОСТОЯТЕЛЬНО ( пока ) делать себе Википедию знаний и подходов. Тогда, он хорош, очень хорош... ( Может, я не отдам тебе, читатель этого поста доллар, если у тебя не выйдит, так как есть еще фундаментальные ограничения мозга, и налаженные на старые vin like at past= its good for me, and i dont wont change that at all процессы в мозгу... ).

А "Chat gpt подумай за меня где найти и как правильно ввести правильные архитипы промтов", это уже: зовсім інша розмова, до зовсім іншого рокоління людей та іі ( тут, можна написати 10-20-ть статей, чи книг на ці теми...)... І ті хто не розуміють зараз цю, та багато інших технологій, просто зіткнулися з тим, що chat gpt/stubble difusion та інші прориви, просто більш зрозумілі будуть для "слідуючого за вашим" поколінням людей, менш "зашоренного"* не потрібними наразі знаннями, та логічними структурами. Звісно не хочеться почувати себе застарілим іржавим, з не актуальними знаннями, і старим. Та, щоб не бути, треба робити, те, що описав в першому абзаці, і вдосконалювати, автоматизувати себе, і свої знання. А не підтримувати хор: я не розумію цю технологію, тому напишу що вона погано робить свою справу ( поки що, в чомусь, ха ха ) луддитів. Це, як мінімум не раціональне використання часу.

Сразу скажу спрашивать кто он такой, как себя осознаёт и прочую лабуду лучше не надо. У него стандартные заготовки. Ну такое часто спрашивают те кто далёк от того как работает ИИ и речевая модель. Хотя чисто те питонисты и кто занимается нейросетями могут сильно удивиться уже с другой стороны, потому что многие мыслят крайне узко называя сети числодробилками, и то что чат не может выдать какой то необычный ответ. Это вполне возможно, но и не такое как думают те кто с нейросетями никогда не сталкивался.

Большинству 80% нафиг этот сервис не сдался, спрашивают по типу пошлых загадок, или повторяй за мной... Это забавно, но бесполезно. Так же бесполезно в качестве собеседника использовать, вот сейчас такие примеры даже не встречаются, мне кажется уже все с Алисой наигрались.

Кто чуть на каплю поумнее спрашивают то, что в 90% случаев даст ответ википедия. Бывает полезно, особенно когда хочется подобрать результат из нескольких источников, чтобы обозреть проблему которая тебя волнует вообщем и с разных точек зрения, так как он находит информацию с до 10 разных источников

Понравилась одна функция, он может подобрать музыку, а так же может рассказать (!) что то об любом практически клипе или музыке до 2021 года, достаточно скормить ему название. Это меня поразило, но в то же время лично для меня глубоко бесполезная штука я таким не занимаюсь.

Код пишет, но скорее уровня джун+. Ну так то я сам пока миддл то вот думаю возможно пригодится, сейчас пока уволился, а до уволнения не пользовался чатом. Тут плюс, но сложные программы естественно не напишет.

Ещё дополню, вот как раз формальные алгоритмы, которые сложны для большинства людей он очень хорошо описывает, достаточно скормить алгоритм и спросить что он делает. Хотя всё зависит от стиля мышления кому то алгоритм удобнее самому в сжатом виде понять, а кому то проще когда он "разжёван".

Можно скормить любую задачу из литкода, просто пишем реши задачу и номер задачи. Лайфак для собесов, ему уже скормлены все вопросы и ответы.

Так же когда просто тупишь и не понимаешь как написать функцию, можно скормить описание задачи, особенно если это просто функция небольшая. Он поймёт. Только тссс! не говорите системным аналитикам или кому повыше, скажут что можно обойтись меньшим числом программистов. Хотя тот код что выдаст тоже нужно обработать и написать тесты.

Тесты. Самая запарная для многих тема, в том числе для меня. Ненавижу тесты, тем более их начал изучать, когда уже язык более менее изучил и начал работать и с невозможность написания тестов может повлечь уволнение и депрессию. Чат отлично пишет тесты, хотя бы каркас тестов. Это замечательно.

Может оптимизировать функции. Вот это киллер фишка наряду с тестами и генерацией небольших фрагментов по описанию. А так же быстрому переводу из одного языка программирования в другой. Не приходилось пока использовать. Но часто пишут интересные программы на вездесущем питоне и хочется перевести на джаву, а напрягать мозг не хочется, хотя в конечном итоге всё равно код нужно будет проверить, но это легче чем самому всё делать. Или перевести с языка БД SQL на любой другой язык, который используется у вас в разработке.

Для копирайтеров наверное самое то и разных SEO специалистов, хотя тут есть сомнения, потому что есть сервисы, которые уже сейчас распознают сгененирированный чатом текст и такие проверки вполне могут достаточно быстро внедрить.

Может ли он учится? Думаю что нет, но было бы неплохо такое сделать. Ну допустим вы задали вопрос который ещё никто или практически никто не спрашивал. Вот это вопрос, не знаю, но на некоторые вопросы он крайне медленно отвечает. Было бы неплохо добавить функцию, чтобы он учился на вопросах и после того как спросили дописывал данные себе в память ускоряя и дополняя ответы.

Вот такие мысли по поводу ChatGPT.

поддерживаю. Кстати…

В первый день я его заставил написать сказку про колобка и волка, как колобок хотел простите «совокупит…» уж простите за пошлость. Узнал что колобок все таки догнал волка и у них родился волкобок.

После такой сказки я понял что моя фантазия не достаточно развита, а интернет куда безумнее чем мне казалось.

интересно о чëм можно говорить с Алисой.. ?пробовал, желания ею пользоваться (разговаривать с ней явно нельзя) очень быстро пропадало. тупая жутко. и правда много тех кто с ней игрался?

в качестве собеседника, товарища, и т.д. еë нельзя использовать в силу тупости и также ограниченний наложенных создателями. а в качестве голосового помощника нельзя использовать как минимум в силу малой (почти никакой вообщемто) интеграции с окружающим миром.

чат-боты вот эти новые это видимо ещë один шаг, но пока до прорывы далеко. болезни примерно теже: ограниченность, ограничения заложенные создателями и отсутствие интеграции с окружаюшим миром. из того что в сети выкладывают видно, что тупые эти чат-боты. это моë мнение конечно, субъективное и возможно я жду от подобных ботов не того что ждëт большинство, но всë это пока не более чем "игрушка на вечер". а вот то что новые эти чат-боты создают какой никакой контент.. меня это пугает с той точки зрения, что качество контента грозит сильно упасть: зачем платить художнику который нарисует оригинальную картинку, если можно еë попросить сделать "ИИ"? а результат будет посредственным.

непонятно, почему все так страдают по поводу "встроенной повесточки" ?

ну встроена туда сейчас такая установка. А в будущем - можно будет встроить другую.

Я не думаю, что это конец прогресса и такую нейронку можно будет запускать только в единичных экземплярх. Я скорее даже уверен, что каждый будет запускать свою на своем оборудовании.

И там будет ChatGPT

с встренными установками вождя всех народов _______ (вставить имя)

с встренными установками нацистов

с встренными установками вегетарианцев

с встроенными установками людоедов

с встренными установками сайентистов\мусульман\христиан\и т.д.

с встроенными установками алкоголика

с встроенными установками ...

ведь встраивать ведь можно что угодно, это всего лишь инструмент.

Вот когда будет ИИ, который невозможно будет переубедить ни в какую сторону, у которого будет внутренний "императив канта" - вот тогда будет оооооочень интересно!

Мне ChatGPT помогает отлично в обучении. Как и сказали, StackOverFlow на максималках. Только не надо искать часами как улучшить кусок кода, а достаточно написать правильно запрос и добавить комменты, изучить и добавить в проект. И самое главное отучает от хардкодинга.

Конечно и тут не без ошибок, но если есть хотя бы есть начальное понимание что и как должно работать - пофиксить недоработки ИИ не составляет особых проблем.

ChatGPT часто "выглядит" (ведет себя) очень умно, по-человечески. И всё же, нельзя забывать, что у него нет осознания как самого себя, так и выдаваемых им результатов.

тут неявно присутствует утверждение, что феномен Сознания базируется на каких-то других принципах, нежели чатЖПТ. Но несмотря на то, что поиски желанного доказательства особенности Сознания идут давно, результат пока неутешительный. Поэтому на иллюстрации вместо AI можно смело написать Сознание.

Что не так с ChatGPT?