Не так давно все с нетерпением ждали новинок от Apple, однако сегодня внимание мира приковано к другому событию – OpenAI Dev Day, презентации последних разработок ChatGPT. Несмотря на скромную подачу, в стиле “от разработчиков к разработчикам” ее влияние на будущее технологий стало масштабным.

В соцсетях царили предположения о релизах API для новых моделей и снижении стоимости GPT-4, о чем Сэм Альтман, CEO OpenAI, говорил еще летом. И предвкушение оправдалось – результаты превысили ожидания кратно.

Итак, что же показали и что это для нас всех значит?

Новая GPT-4 Turbo

Первое и самое главное – это GPT-4 Turbo с 128K контекстом. Напомним, что еще вчера GPT-4 был в двух вариантах: с контекстным окном в 8К и в 32К. Есть модель Claude 2, где контекст уже летом составлял 100 тыс. токенов, но сама модель в работе уступает конкуренту из OpenAI, несмотря на более широкое окно. Почему этот параметр важен? Все просто: чем больше токенов модель держит в памяти, тем с большим объемом документов/диалогов может работать ChatGPT. GPT-4 с 128K – это действительно внушительно, уже близко к тому, чтобы поместить роман «Война и мир» в контекст. Прикладным разработчикам это позволит реализовывать более сложные сценарии как в самом чате, так и в приложениях, основанных на OpenAI API.

Другой знаковый момент – обновление модели данными до апреля 2023 года. Теперь она обладает актуальными сведениями о последних технологических достижениях и мировых событиях.

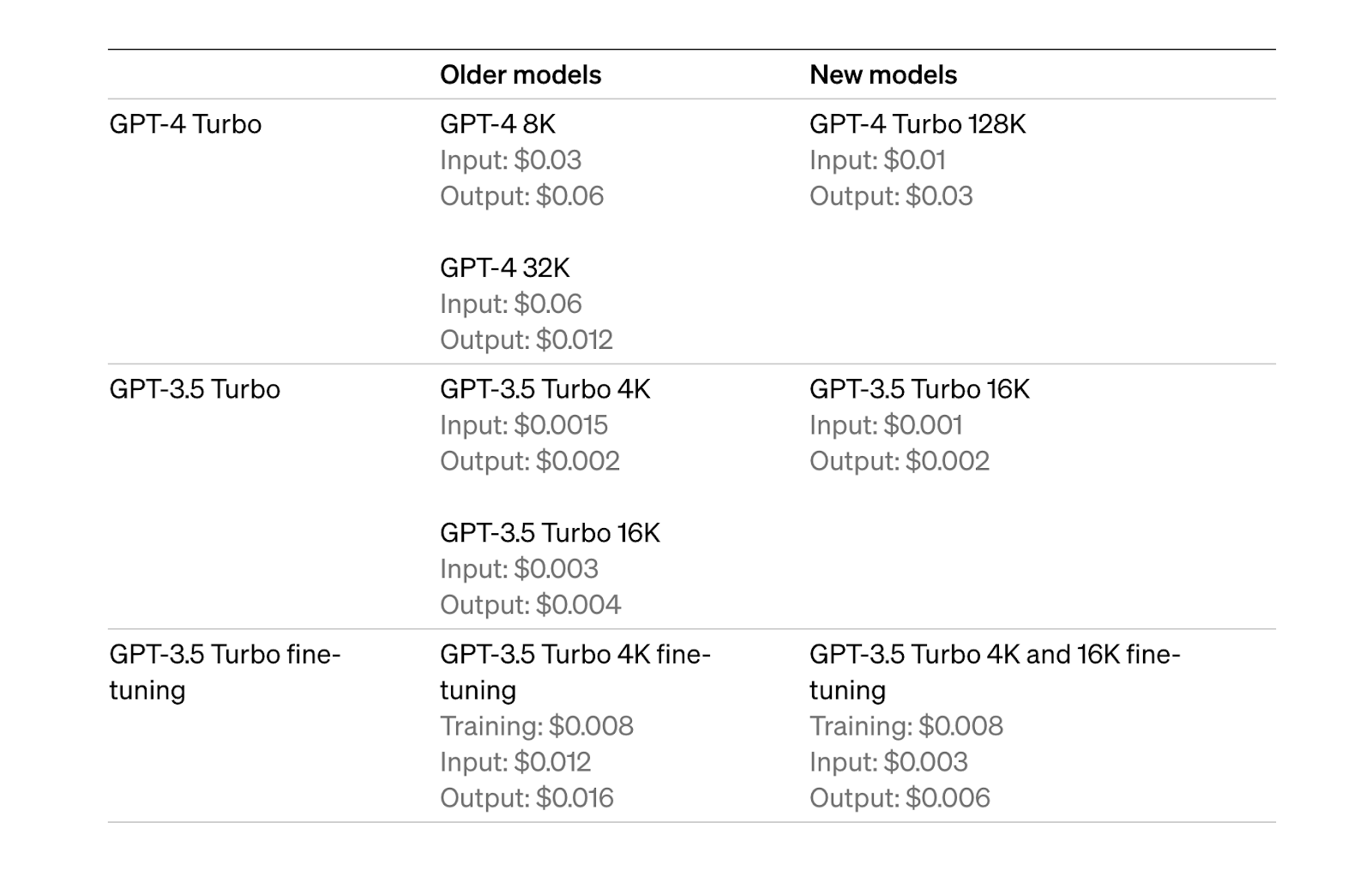

Казалось бы, куда еще лучше, но Сэм Альтман со сцены сказал: «Вы очень просили сделать GPT-4 еще дешевле, и мы это сделали». Теперь GPT-4 при использовании через API будет стоить в среднем в 2,5 раза дешевле. Это означает, что появится больше стартапов, которые теперь смогут использовать GPT-4 в своих продуктах. До этого использование GPT-4 часто было нецелесообразно: у нас на одном из продуктов экономика с GPT-4 не сходилась, и мы отдали предпочтение GPT-3.5, даже с учетом более низкого качества.

Вместе с этим OpenAI улучшили и GPT-3.5 – модель также станет дешевле на API вызовы. Дообучение модели также стало доступнее.

Также увеличили rate limits в минуту: раньше, чтобы реализовать высокую нагрузку на API OpenAI, приходилось делать work around с несколькими аккаунтами, теперь же можно использовать гораздо больше токенов в минуту.

Вызов внешних функций и режим JSON

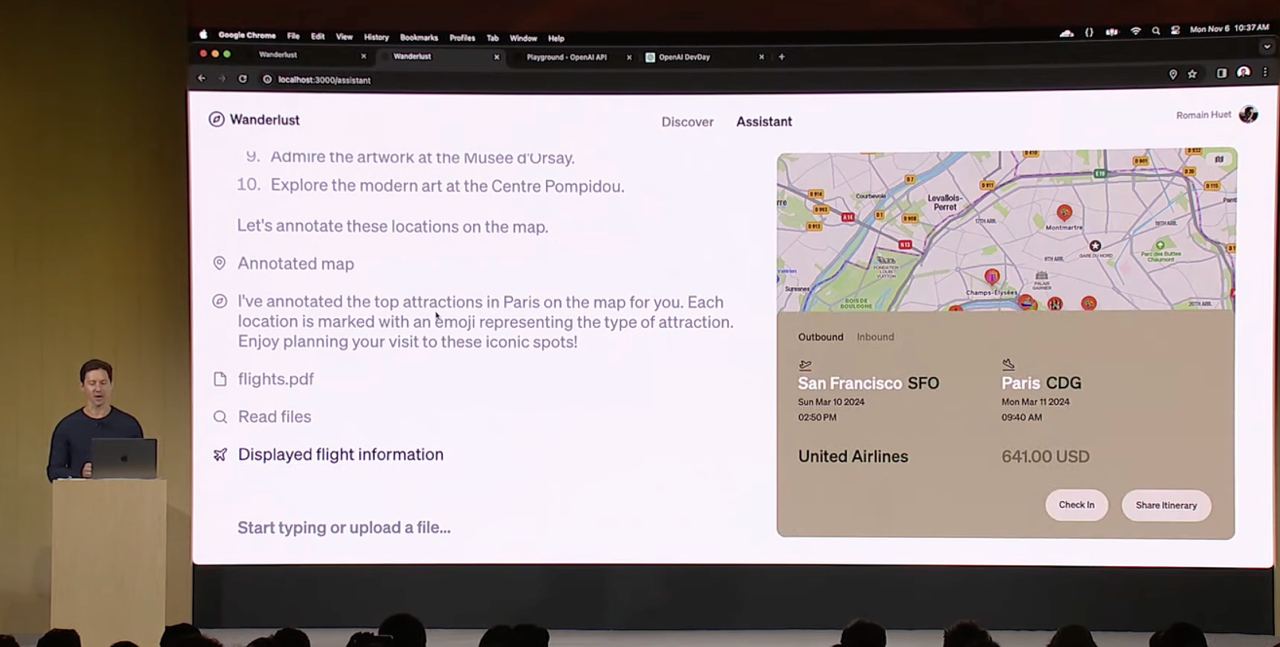

Теперь ChatGPT может вызывать внешние функции и API. На презентации со сцены показали демонстрацию, где GPT успешно спланировал поездку в Париж, отметил на картах места для посещения и даже забронировал жильё на Airbnb. Впечатляет, что интеграция стала ещё проще. Но главное – теперь есть JSON mode: модель в этом режиме будет отдавать структурированный JSON "из коробки". Достижение подобного результата ранее требовалось через промпты, однако теперь это встроенная функция, которая, теоретически, должна уменьшить количество ошибок и галлюцинаций модели.

Эти функции будут доступны как в GPT-4 Turbo, так и в GPT-3.5 Turbo. Для GPT-3.5 это особенно значимо, ведь модель часто не следовала инструкциям вроде "always answer in xml". Теперь с JSON mode её будет проще использовать, и, учитывая сниженную стоимость, GPT-3.5 остаётся актуальной как никогда.

Assistant API и Интерпретатор кода

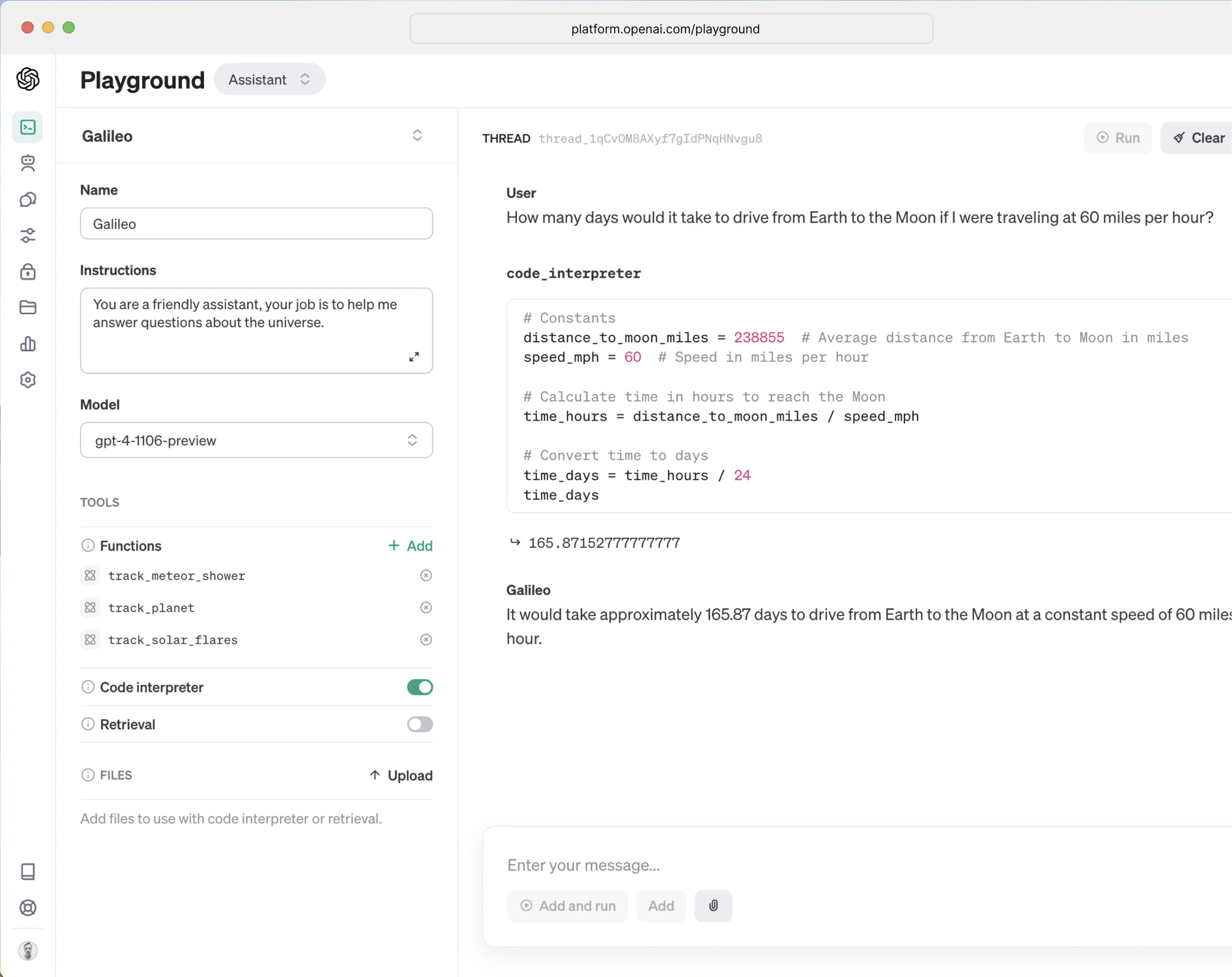

Возможности использования API расширились с представлением Assistant API. Основное новшество этого API – так называемые "Threads", которые позволяют разработчикам не задумываться об ограничениях конкретного контекстного окна и добавлять новые сообщения прямо в существующий поток. Это означает, что теперь, вместо необходимости самостоятельного управления контекстным окном и его полной передачи при вызове API, можно будет добавлять новое сообщение прямо в поток, а управление этим процессом берёт на себя OpenAI.

Теперь в API добавили возможность использования Code Interpreter и Retrieval, что позволяет загружать документы прямо через API. Функции вроде "chat with pdf" станут доступными внутри API. Code Interpreter, в свою очередь, сможет запускать код внутри GPT для выполнения вычислений или парсинга файлов. Сейчас разработчики еще не познали всё мощь кодовых моделей, но пройдет еще немного времени, когда мы сможем сначала код нашего стартапа загрузить и попросить модель поправить баги, а потом и код легаси проекта.

Кстати, все это можно попробовать в новом Playground, который позволяет использовать API в режиме no-code.

Модель, которая видит, говорит и рисует картины

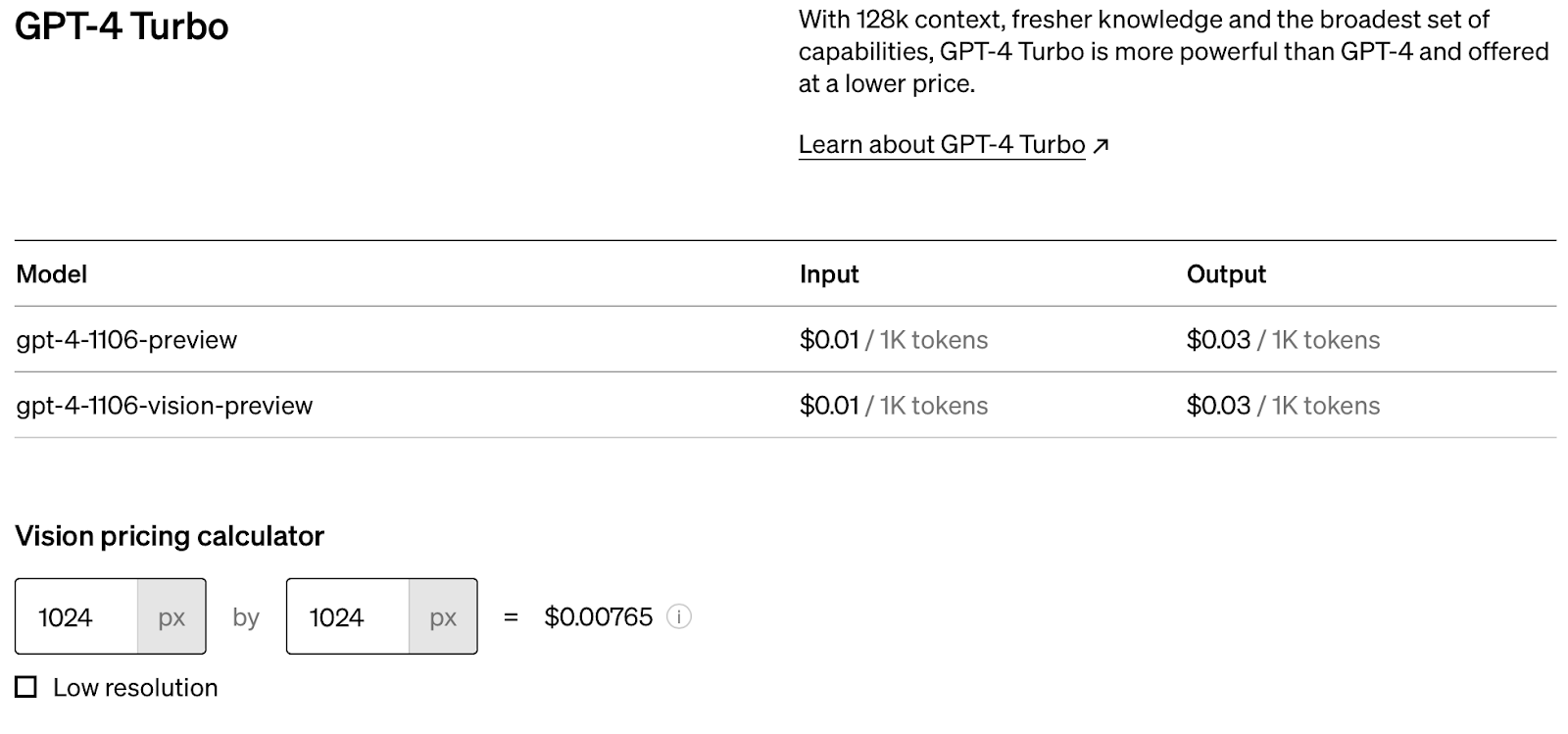

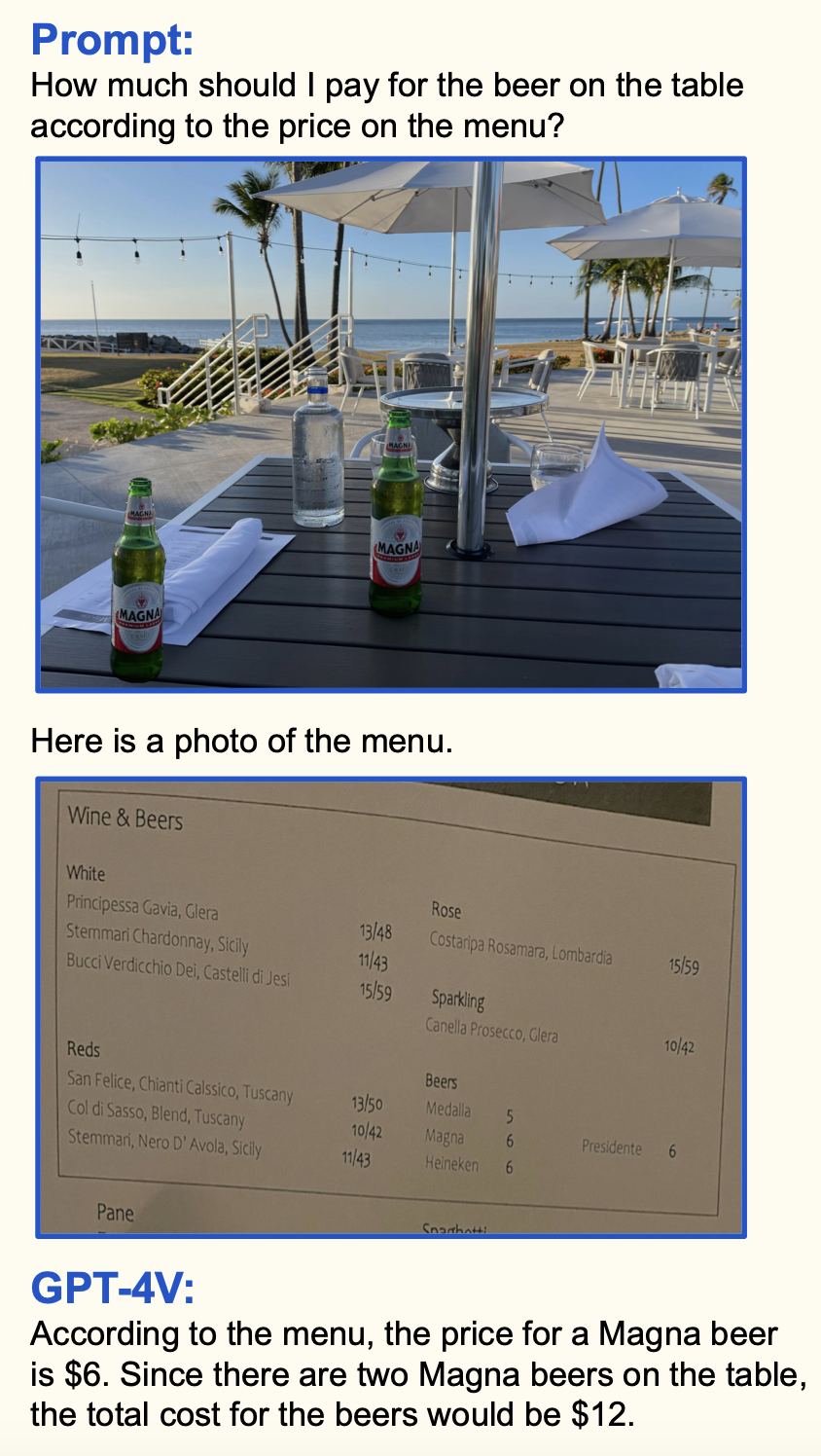

GPT-4 Turbo теперь включает мультимодальные возможности в API: те режимы, которые были доступны в чате, позволяют ему теперь распознавать изображения с помощью Vision и генерировать новые в сочетании с DALL-E 3. Это открывает ещё больше путей для интеграции через API. Тарификация будет осуществляться отдельно: за изображение разрешением 1024x1024 OpenAI установила цену в $0.007.

GPT-4-Vision эта самая модель, которая может по фотографии меню и еды на столе посчитать, сколько нужно заплатить за ужин.

Отдельно стал доступен Text-to-Speech API который синтезировать голос. Пользователи приложения уже оценили возможности "говорилки от OpenAI", которая даже на русском языке показывает впечатляющее качество, не уступающее решениям от Яндекса или Сбера. Теперь все это доступно и через API, что позволяет создавать приложения с поддержкой голосового взаимодействия с людьми. Основным вопросом здесь является задержка, которая для полноценного диалога до сих пор оставалась главным препятствием из-за заметного интервала между ответом модели и вопросом человека. Судьба таких стартапов как air.ai теперь под вопросом.

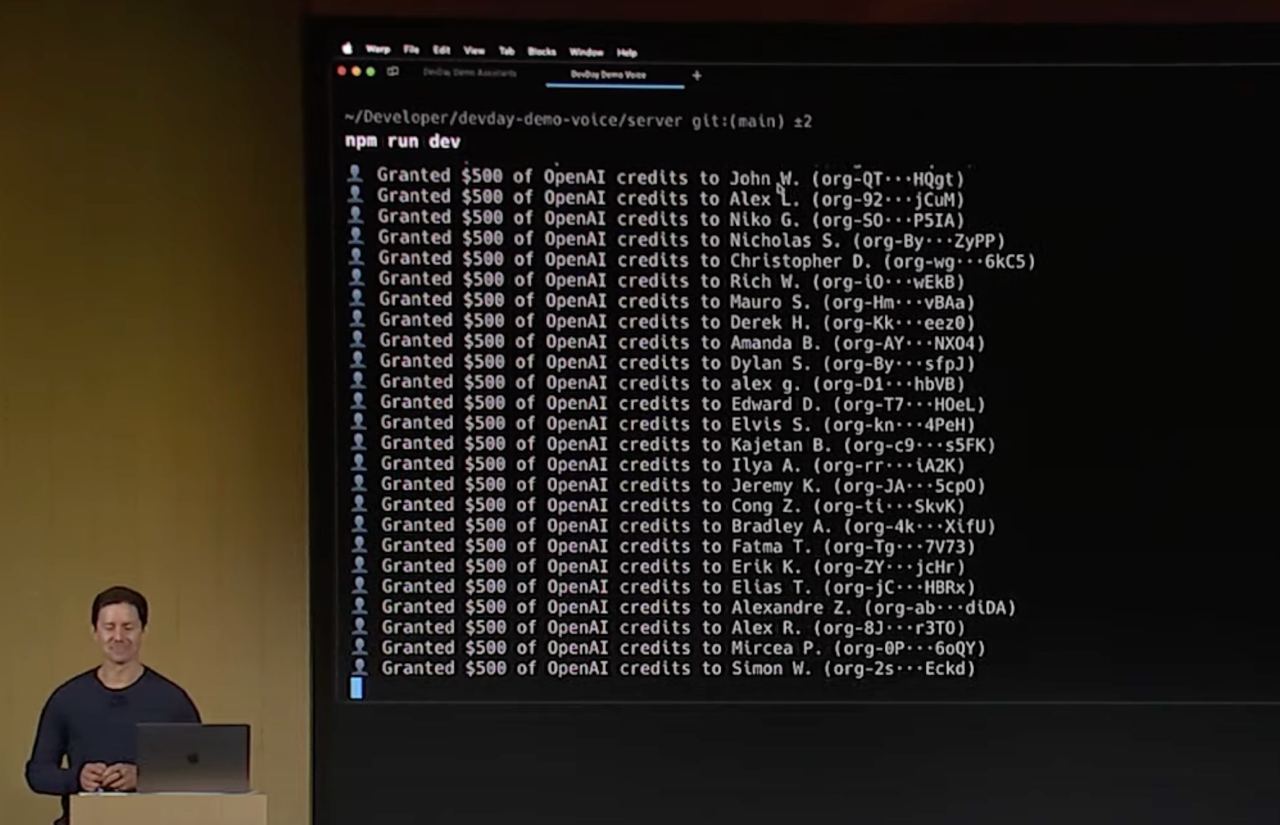

Прямо на презентации нам продемонстрировали интеграцию всех этих технологий в виде ассистента для конференции. Широким жестом ведущий секции просит модель выдать всем присутствующим в зале по $500 кредитов на аккаунт OpenAI. Ассистент перевёл голос в текст, активировал необходимые функции, собрал данные участников и распределил кредиты на id организаций в OpenAI. С таким обилием возможностей и функционала API, эти кредиты наверняка будут востребованы.

Новый релиз Whisper v3 уже на GitHub

Одна из лидирующих моделей для транскрибации аудио — Whisper от OpenAI, доступна как в open source, так и через API. Качество транскрипции Whisper даже на русском языке отличное. Особенно впечатляет, что технология не только развивается, но и остаётся открытой в Open Source. Это открывает пути для её интеграции даже в корпоративные продукты. Недавно была и другая новость, как одна команда смогли оптимизировать Whisper и ускорить работу в 6 раз при минимальной потере точности.

Обновление функционала ChatGPT, конструктор GPTs, маркетплейс и новый интерфейс

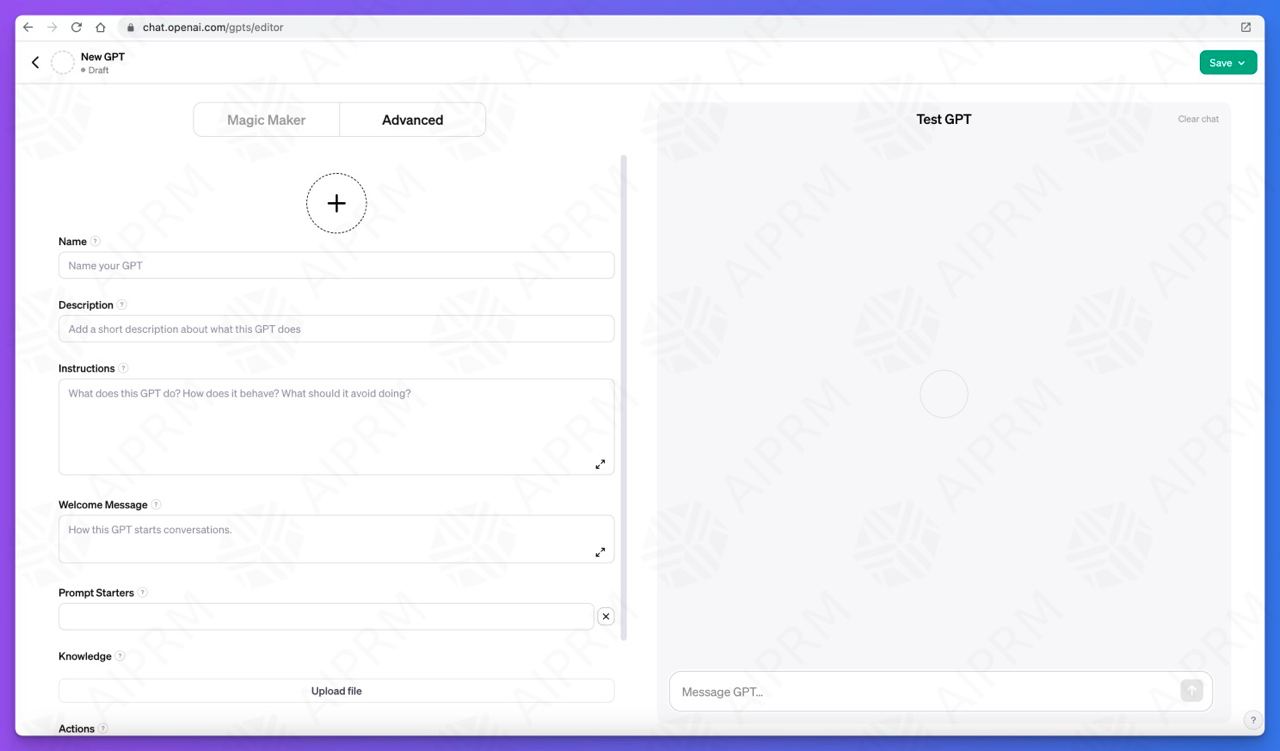

Нам показали конструктор, который позволяет создавать навыки вроде тех, что есть у Алисы от Яндекса, но на базе ChatGPT — просто и без необходимости писать код. Он получил название GPTs.

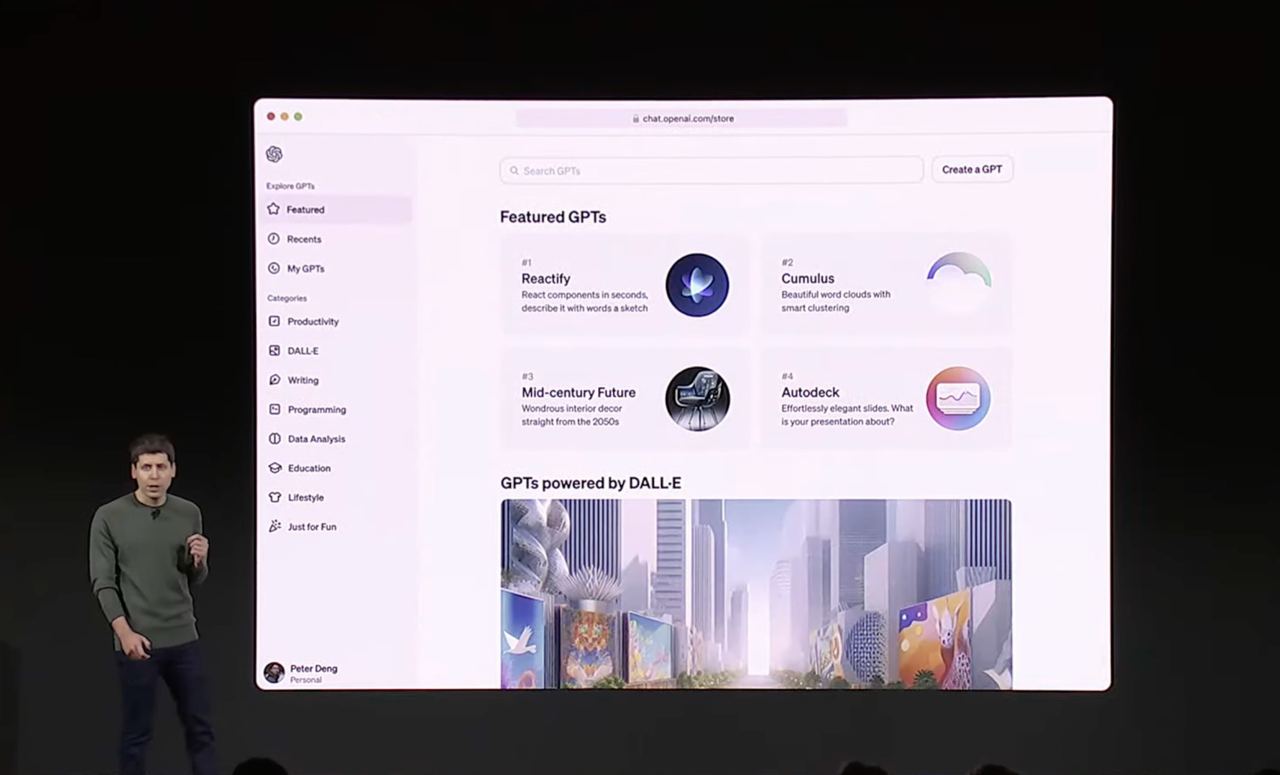

OpenAI планирует позднее в этом году выпустить маркетплейс таких навыков, который можно сравнить с App Store от Apple. В то время как Алиса или Алекса часто воспринимаются пользователями скорее как забава, в случае с GPTs рынок обещает быть значительно шире: за год ChatGPT стал инструментом повседневного использования для миллионов пользователей, что подстегнет разработчиков к созданию тысяч различных ассистентов. Будем надеяться политика монетизации будет лучше, чем вышло у Apple.

Кроме того, возможно, уменьшится или даже исчезнет необходимость в prompt engineering как обязательном навыке для взаимодействия с ChatGPT. Сообщество быстро предоставит большой выбор преднастроенных чатов для разработчиков, архитекторов, креативщиков и других специалистов, куда запросы можно будет отправлять в простой форме и без использования сложных промптов.

Также обновили интерфейс. Действительно, интерфейс ChatGPT практически не менялся с момента первого релиза и мог показаться устаревшим. Теперь он предстал в более современном виде. Подробнее о том, какие паттерны использовать в разработке чатботов вы можете почитать в нашей статье.

Защита авторских прав на AI продукты

Отдельной строкой хочется отметить инициативу OpenAI, призванную помочь клиентам, которые столкнулись с юридическими проблемами из-за сгенерированного контента. Компания обязуется вступиться за вас в случае каких-либо судебных разбирательств и, при необходимости, выплатить штраф. Это показывает высокую клиентоориентированность компании и стремление привлечь как можно больше людей к созданию продуктов на основе GPT.

С похожей инициативой недавно выступила и компания Microsoft. Их Copilot Copyright Commitment — это обязательство, которое гарантирует клиентам возможность использовать сервисы и результаты работы Copilot без беспокойства о претензиях по авторским правам. Если такие претензии возникнут, Microsoft берёт на себя ответственность, включая юридическую защиту и покрытие возможных судебных издержек и компенсаций, при условии, что клиенты соблюдают встроенные фильтры контента и ограничения.

Итоги

Вчера наш мир увидел, как компания всего из 400 человек выпустила целую дюжину инноваций. GPT-ассистенты, обновленные интерфейсы для промптов, усовершенствованный синтез речи — все эти нововведения обесценивают многие проекты и, возможно, даже компании, возникшие в последние годы. AI-юристам или роботам-продавцам, работающим на базе более простых моделей, будет сложно соперничать с небольшим плагином-ассистентом, за которым стоит сильная фундаментальная модель GPT-4 Turbo. Командам, которые создают свои модели и стремятся к паритету с ChatGPT версии 3.5, теперь ещё сложнее будет догнать лидера. Мультимодальный GPT-4 Turbo Vision с открытым API открывает перед разработчиками новые возможности для создания приложений, способных анализировать тексты, изображения и схемы. И нам предстоит столкнуться с новыми уязвимостями, скандалами, связанными с утечками данных, и угрозами безопасности вроде DAN-инъекций.

Сэм Альтман, CEO OpenAI, неоднократно упоминал в интервью, что миссия компании заключается в создании AGI — Искусственного общего интеллекта, уровня искусственного интеллекта, при котором машины смогут решать задачи не хуже человека, будь то вопросы логики, обучения или восприятия языка. Мы шагнули к этой цели ещё ближе.

Будущее принадлежит AI. Он неуклонно входит в каждый аспект нашей повседневной жизни. По случаю годовщины ChatGPT мы ещё раз убеждаемся в неизбежности его распространения. AI, генеративные модели развиваться с невероятной скоростью, превосходя многие предыдущие технологические достижения.