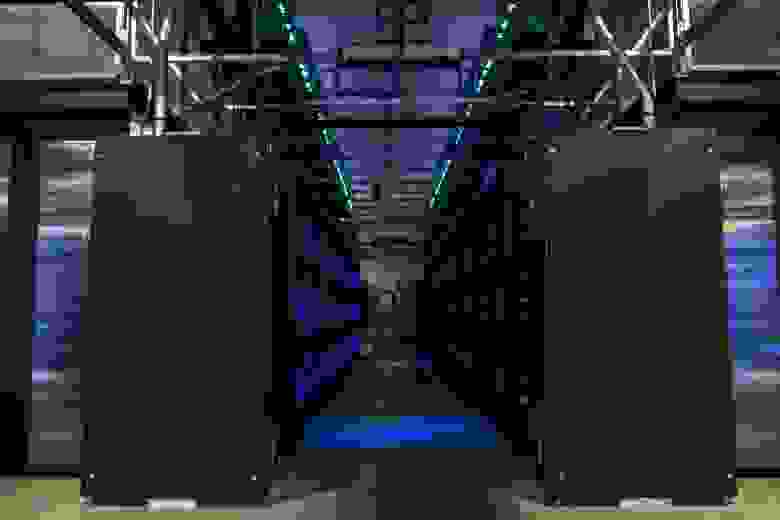

В последнее время штат Айова стал весьма популярным местом среди операторов дата центров. Компания Facebook официально объявила об открытии первого здания своего новейшего модульного ЦОД с воздушным охлаждением в городе Алтуна. Представители соцсети также сообщили, что этот дата центр станет самым длинным во всем мире.

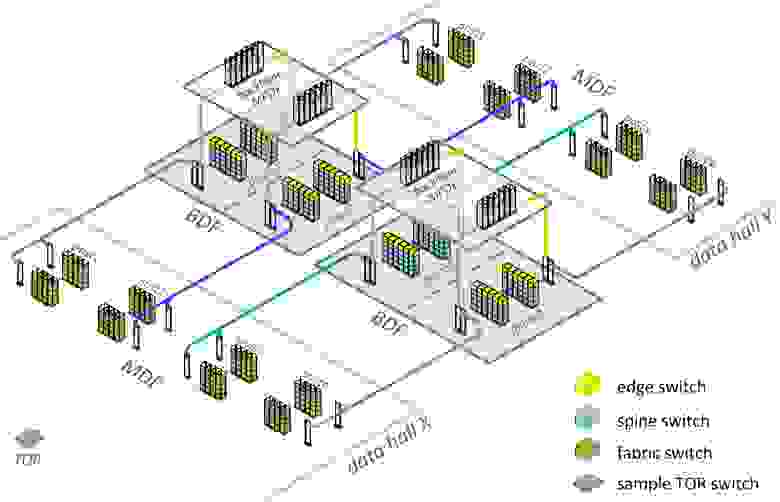

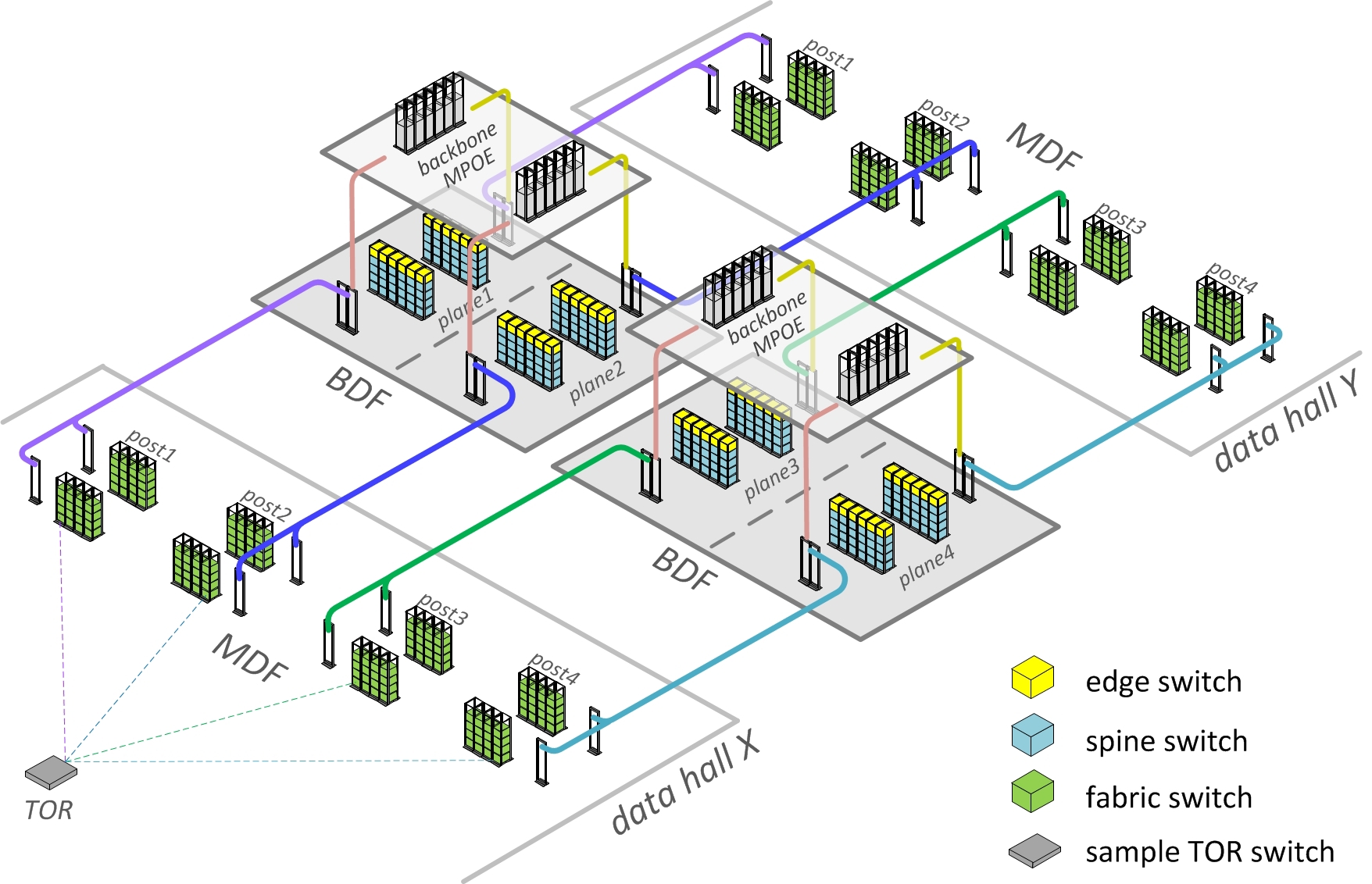

Это первый ЦОД Facebook, который на 100% будет питаться с помощью электроэнергии вырабатываемой на ветровой электростанции (ВЭС). При строительстве дата центр было применено то, что Facebook называет «data center fabric» – проектирование третьего поколения на основе единой высокопроизводительной сети, которая заменит традиционные кластеры.

«Это одно из самых быстрых процессов строительства среди всех наших объектов, и этим мы в первую очередь должны быть благодарны местному населению Айовы», – заявил Брайс Таунс, руководитель строительных работ в Алтуне. Facebook уже начал строительство второго здания для ЦОД, предполагаемая дата завершения и ввода в эксплуатацию – конец 2015 года.

Еще в апреле 2013 года компания планировала вложить около $300 млн. в строительство первой очереди. Она включает в себя ЦОД площадью в 44,2 тыс. кв. м., который состоит из 4-х зданий хранения данных. Электропитание будет поступать от ВЭС вблизи города Уэллсберг. Данная ветровая электростанция планирует вырабатывать порядка 140 МВт энергии, что более чем достаточно для покрытия возможного роста в будущем.

Для привлечения компании Facebook, власти город Алтуна освободили ее от всех налогов на недвижимость на срок в 20 лет. Этот дата центр станет первым, где введут в эксплуатацию новую архитектуру сети. Сети Facebook были ранее построены с использованием кластеров, но компания заявила, что такой метод не подходит для хорошей работы «мега ЦОД».

Сетевой инженер Алексей Андреев объясняет, что размер кластера ограничен плотностью порта коммутатора. «Они имеют собственные внутренние архитектуры, которые требуют более обширных знаний в области программного и аппаратного обеспечения. Учитывая большую площадь дата центра, влияние аппаратных и программных сбоев может быть довольно таки существенным», – сказал Андреев.

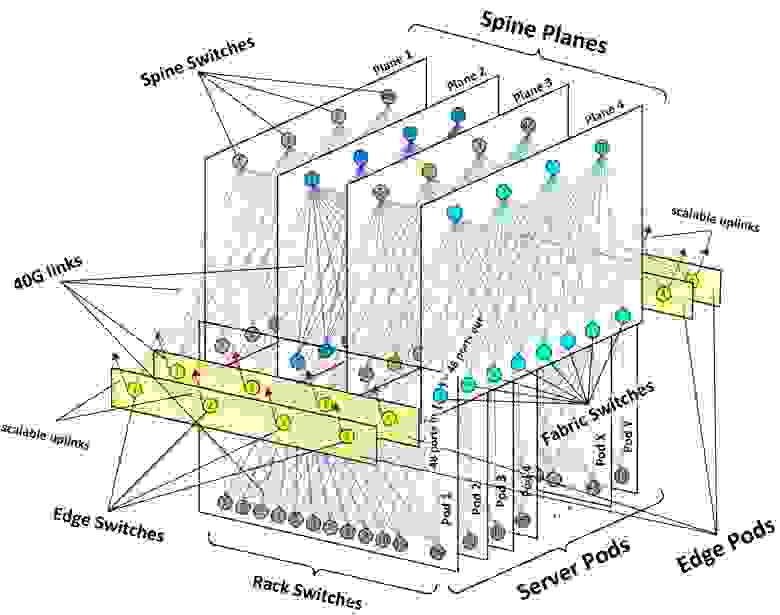

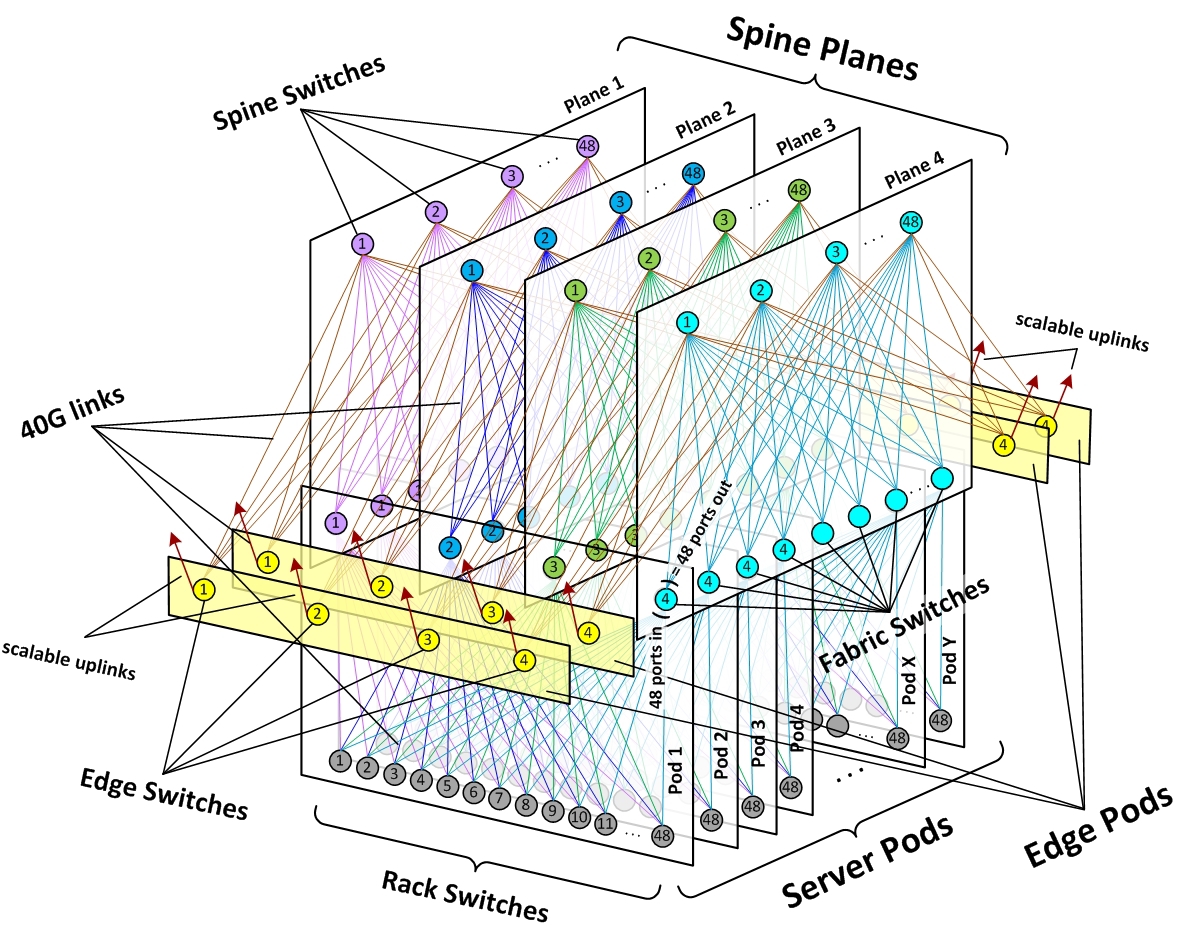

Развертывание небольших кластеров «pods», так их назвала компания Facebook, и использование децентрализованной (пиринговой) архитектуры сети, где каждый pod-кластер может «разговаривать» с другим pod-кластером, исключает необходимость использовании коммутаторов с высокой плотностью.

Кластер pod состоит из 4 устройств – «fabric switches» и 48 обычных коммутаторов, каждый из которых соединен с «fabric switches» посредством канала в 40 Гбит. Серверы в стойке подключены к TOR коммутатору с помощью 10 Гбит канала, общая пропускная способность каждой стойки – 160 Гбит.

Система полностью автоматизирована, и инженерам никогда не придётся настраивать отдельно взятое устройства вручную. Если устройство выходить из строя, оно заменяется и автоматически настраивается с помощью программного обеспечения.

Отныне все свои дата центры Facebook собирается строить используя новую сетевую архитектуру, а уже существующие объекты будут переходить на нее постепенно.

Это первый ЦОД Facebook, который на 100% будет питаться с помощью электроэнергии вырабатываемой на ветровой электростанции (ВЭС). При строительстве дата центр было применено то, что Facebook называет «data center fabric» – проектирование третьего поколения на основе единой высокопроизводительной сети, которая заменит традиционные кластеры.

«Это одно из самых быстрых процессов строительства среди всех наших объектов, и этим мы в первую очередь должны быть благодарны местному населению Айовы», – заявил Брайс Таунс, руководитель строительных работ в Алтуне. Facebook уже начал строительство второго здания для ЦОД, предполагаемая дата завершения и ввода в эксплуатацию – конец 2015 года.

Еще в апреле 2013 года компания планировала вложить около $300 млн. в строительство первой очереди. Она включает в себя ЦОД площадью в 44,2 тыс. кв. м., который состоит из 4-х зданий хранения данных. Электропитание будет поступать от ВЭС вблизи города Уэллсберг. Данная ветровая электростанция планирует вырабатывать порядка 140 МВт энергии, что более чем достаточно для покрытия возможного роста в будущем.

Новый вид архитектуры сети

Для привлечения компании Facebook, власти город Алтуна освободили ее от всех налогов на недвижимость на срок в 20 лет. Этот дата центр станет первым, где введут в эксплуатацию новую архитектуру сети. Сети Facebook были ранее построены с использованием кластеров, но компания заявила, что такой метод не подходит для хорошей работы «мега ЦОД».

Сетевой инженер Алексей Андреев объясняет, что размер кластера ограничен плотностью порта коммутатора. «Они имеют собственные внутренние архитектуры, которые требуют более обширных знаний в области программного и аппаратного обеспечения. Учитывая большую площадь дата центра, влияние аппаратных и программных сбоев может быть довольно таки существенным», – сказал Андреев.

Развертывание небольших кластеров «pods», так их назвала компания Facebook, и использование децентрализованной (пиринговой) архитектуры сети, где каждый pod-кластер может «разговаривать» с другим pod-кластером, исключает необходимость использовании коммутаторов с высокой плотностью.

Кластер pod состоит из 4 устройств – «fabric switches» и 48 обычных коммутаторов, каждый из которых соединен с «fabric switches» посредством канала в 40 Гбит. Серверы в стойке подключены к TOR коммутатору с помощью 10 Гбит канала, общая пропускная способность каждой стойки – 160 Гбит.

Система полностью автоматизирована, и инженерам никогда не придётся настраивать отдельно взятое устройства вручную. Если устройство выходить из строя, оно заменяется и автоматически настраивается с помощью программного обеспечения.

Отныне все свои дата центры Facebook собирается строить используя новую сетевую архитектуру, а уже существующие объекты будут переходить на нее постепенно.