Данная статья представляет собой вольный пересказ https://arxiv.org/abs/2103.05247

Аннотация

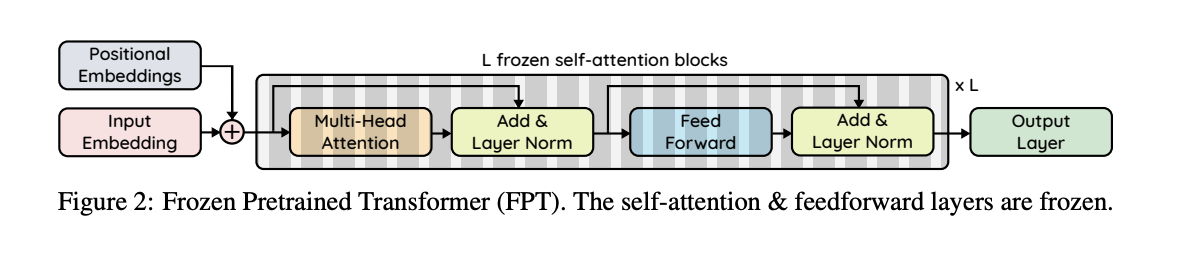

Данная статья является разбором свежей статьи от исследователей из университета Беркли "Pretrained Transformers As Universal Computation Engines". В статье решается задача дообучения трансформеров на новые виды информации, такие как: изображения, битовые операции, математические выражения и последовательности белков.

Архитектура трансформер стала основой существующих успехов глубокого обучения, породив череду моделей обработки естественного языка таких как GPT, BERT или T5, которые сейчас представлены в зоопарке русскоязычных моделей сбера. Впоследствии архитектура трансформера стала применяться и в задачах задачах компьютерного зрения (CLIP, ImageGPT, Dall·E).

Идея данной статьи происходит из того, что гигантские языковые модели обучаются на больших массивах данных, в том числе, Википедии, Reddit и т. д. Поэтому модели обладают широкими фактологическим знаниями, например, о годах рождения известных личностей.