Facebook задействует технологию на ИИ, чтобы ввести более подробные описания фотографий. Соцсеть задействовала ИИ для пользователей с ослабленным зрением.

Новая версия автоматического альтернативного текста (AAT) не полагается на строго контролируемое обучение искусственного интеллекта, а учится на «миллиардах» фотографий и хэштегов из Instagram.

Этот метод позволил Facebook получить более 1200 описаний, в том числе различных рецептов и памятников. Это в 10 раз больше, чем у исходной модели.

Метод также более инклюзивен с точки зрения культуры — например, он позволяет распознавать снимки свадеб, на которых нет невесты в белом свадебном платье.

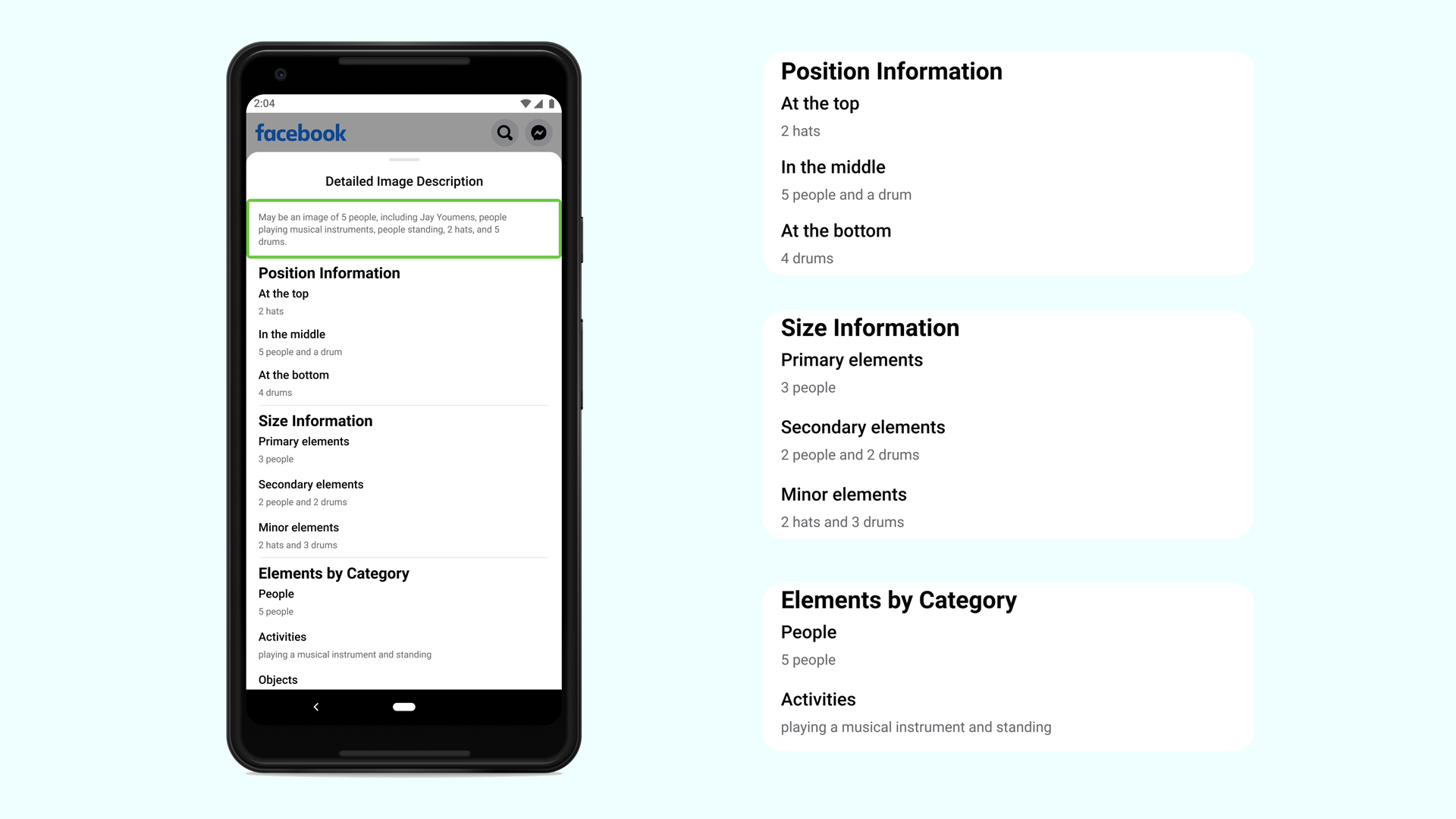

Новая система обнаружения объектов видит, где находятся люди в кадре, а также их количество. Чтобы получить более подробную информацию, такую как положение и число объектов, исследователи обучили двухэтапный детектор объектов Faster R-CNN, используя Detectron2, платформу с открытым исходным кодом от Facebook AI Research.

У пользователей появится возможность выбрать подробное описание снимка, в котором будут указаны местоположение, размер и характер объектов. Подробные описания включают простую позиционную информацию — вверху/посередине/внизу или слева/в центре/справа — и сравнение относительной значимости объектов, описываемых как «первичные», «вторичные» или «второстепенные».

Facebook подчеркивает, что пока система допускает ошибки и не может распознать некоторые сцены и объекты. Однако это большой шаг в сторону доступности соцсети для людей с ослабленным зрением. Пока модель доступна на 45 различных языках.

В декабре группа исследователей из Института медицинских исследований им. Файнштейна сообщила о создании алгоритма, дающего возможность идентифицировать отклонения у пользователей Facebook, используя отправленные ими сообщения и фотографии. Анализ показал, что частое употребление нецензурных слов может характеризовать людей с психическим заболеванием, а использование холодных голубоватых оттенков на фотографиях может быть связано с нарушением эмоционального состояния.