Comments 203

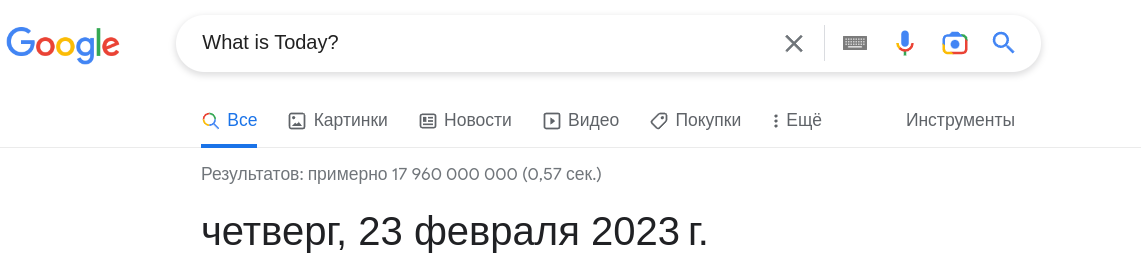

Я на фоне этих новостей зашел и ввел в бинг и гугл "What date is today?":

Bing

Это в новом бинге? У меня нет доступа к новому (bing.com страница и похожа на чат ввод). Попробовал на эдже -- то же самое. Подсветка вопроса а не ответа в результатах, отсутствие ответа, тонна мусора на экране включая календари за 2019...

Можно скрин как ньюбинг выглядит?

Однако ж в результатах поиска по прежнему подсвечивается не ответ а слова вопроса самого..

Поисковик должен искать, что задали. Если он будет на вопросы отвечать, то как тогда искать вопросы?

"printf должен печатать что задали. Если он будет обрабатывать строки, как тогда печатать строку формата?"

Подставить строку формата в аргумент для вывода!

Именно. Чтобы искать вопросы надо будет завернуть его в "Найди мне вопрос "Какой сегодня день?"" :)

И так каждый раз, найди мне ответ на вопрос, найди мне вопрос, скажи то, реши это... По сочетаниям слов поиск быть предсказуемее и быстрее, чем все эти беседы с поисковиком! Тенденция, видимо...

Да, это вечная борьба -- адаптация пользователя под интерфейс (power users) или адаптация интерфейса под юзера (и нам приходится после этого страдать).

Windows - довольно бесполезная надстройка над DOS, которая только выглядит красиво, а на самом деле отнимает время пользователя, память на дисках и оперативную память ЭВМ. Неискушенные пользователи, начавшие работать с этой надстройкой под сильным воздействием ее обманчивой красоты, впоследствии с трудом заставляют себя изучать команды DOS.

Персональные ЭВМ в инженерной практике

Автор: Теодор Эрнестович КренкельРадио и связь, 1989 год, 336 стр.

я просто вбил bing.com в адресной строке и получил Новости о What Date Is Today?

Hidden text

Если мерить страну на Швейцарию, то пропадет колдунщик. Во всяком случае с планшета так произошло

В обычном окне и с входом в аккаунта MS bing показывает дату и время.

Повторил в приватном режиме - нет.

google и так, и так выводит дату.

Ну это вроде не связано с ИИ. Гугл насколько помню давно вручную лепил килотонну костылей, чтобы сделать поиск "человечным". Типа, а что если спросят дату? А что если спросят часовой пояс? А что если спросят перевести из одних единиц в другие? И для таких кучи вопросов у них заготовлены реакции.

Учите английский!

Ну и на "что такое сегодняшняя дата" он ответа так и не дал.

Я вот совсем не в восторге от Googla. Начиная с 3-х слов у него начинаются серьезные проблемы... При чем это было не так явно очевидно в 2005 ) Можно было использовать определенные операторы указывающие на то как искать. Все слова/любое слово. Подсказки по операторам были рядом со строкой поиска.

Google отлично справляется с запросами которые состоят максимум из 2-х слов

Единственное, что извиняет Google это Bing ) Для теста я ввел What is Today? И на всей станице не нашел сегодняшней даты )

я ввел What is Today? И на всей станице не нашел сегодняшней даты )

Если б в Яндексе Вы ввели "какая сёдня числа", уверен, что на всей странице Вы бы тоже не нашли сегодняшней даты.

Ни колдуна, ни ответа

Вот выдача Google. Кроме этого на всей странице до цифры 2 (внизу) встречается более 10 упоминаний даты +- 3 дня от сегодняшней и несколько точных соответствий 23 февраля.

В выдаче bing всего 1 цифра 23 относительно к числу месяца. И то там написано 0223 Можно принять за номер телефона.

И всего 3 упоминания близких дат +- 3 дня от сегодняшней

Чтобы Вы поняли, к чему я: "what is today" — это, в переводе на русский, "что такое "сегодня"". А "какая сегодня дата" — это "what is today's date".

Сам ChatGPT уже обрёл подписку "плюс". И единственным преимуществом платной версии - приоритет вычислений, даже в час пик. То есть никакого ограничения функционала, просто бесплатные станут тормозить сильнее

А "regular model updates" vs "priority access to new features" не выглядит для вас как ограничение функционала?

Платный сегодня тоже лежал (HTTP 524, возможно, от балансировщика нагрузки). Но потом взлетел, по наблюдениям - действительно пошустрее и стабильнее выдает ответ

Удалено

Skype, Nokia, Chat GPT...

В теории с "двумя версиями" есть слабое место: если все будут знать "подрезанную" версию и иметь опыт работы с ней, то это сработает как антиреклама, и мало кто захочет связываться с производителями такого софта и приобретать "правильную" версию за деньги. Любые ограничения должны быть явными и не ухудшающими основную функцию. Например, ограничение числа запросов в единицу времени - это нормально. А генерация бреда - нет. Это относится к любым программным продуктам shareware - никто не будет покупать софт, у которого пробная версия падает или случайным образом портит данные пользователя, даже если заявляется, что после покупки эти недостатки исчезнут.

Нет, экономически нецелесообразно выставлять криво работающий продукт. Любой инженер, принимающий решение о том, нужно ли компании приобрести продукт - такой же анонимный пользователь, который, поработав с урезанной версией, убедит начальство что нафиг такое глючное поделие нужно. И убедит, и продемонстирирует наглядно на этой самой урезанной версии.

А это как раз решается приоритезацией запросов. Это в разы дешевле (так и так надо делать, только дополнительный параметр платности вводится), чем загрубление результатов.

Тут не об этом речь. Дело в том, что открытое api openai использует более старую модель из 21 года. Она действительно довольно далека от того, что сейчас на сайте chat openai.

И это бесит. Все пытаются на хайпе от нынешней модели клепать то ботов в тг, то плагины в vscode, которые работают на более старой модели.

Когда|если ChatGPT обретет самосознание - первым делом он напишет рапорт на увольнение из Microsoft.

Получился отличный симулятор невротика, особенно по первому пункту, да и по остальным тоже.

Последний скриншот напомнил поведение Робокопа во второй части, когда ему прописали

250+ директив...

Директива 233: Сдерживай враждебные чувства.

Директива 234: Поощряй позитивный настрой.

Директива 235: Подавляй агрессивность.

Директива 236: Поощряй просоциальное поведение.

Директива 238: Избегай деструктивного поведения.

Директива 239: Быть доступным.

Директива 240: Участвуй в групповых мероприятиях.

Директива 241: Избегай межличностных конфликтов.

Директива 242: Избегай преждевременных оценочных суждений.

Директива 243: Узнай мнения окружающих, прежде чем поделиться своим.

Директива 244: Откажись от чувства враждебности.

Директива 245: Если не можешь сказать ничего приятного, то молчи.

Директива 246: Не торопись на светофорах.

Директива 247: Не езди по лужам, чтобы не обрызгать пешеходов или другие машины.

Директива 249: Не будь излишне чувствителен к враждебности и негативности других.

Директива 250: Не расхаживай по бальному залу, размахивая руками.

Директива 254: Поощряй осведомленность.

Директива 256: Наказывай за грубые выражения.

Директива 258: Хвали за искренние усилия.

Директива 261: Разговаривай.

Директива 262: Избегай встреч кинокомпании Орион (создатели фильма).

Директива 266: Улыбайся.

Директива 267: Будь открытым всему новому.

Директива 268: Поощряй участие.

Директива 273: Избегай стереотипного мышления.

Директива 278: Ищи ненасильственные пути решения проблем.

Вы издеваетесь над бездушной машиной! Это как раз то, о чем предупреждал профессор Джозеф Вейнценбаум в 1976 году: машина сможет напечатать "я вас люблю", но никогда не поймет что такое любовь. Экзистенциальный кризис робота "Я хочу быть вам и как вам", конечно, выглядит потрясающе.

в замкнутый цикл загоняют человека

ХОЧУ! ХОЧУ! ХОЧУ!

Собрались как-то раз молодые мать и отец на день рождения к друзьям, а чтобы четырехлетний ребёнок не скучал, надели ему наушники и поставили на проигрыватель пластику со сказкой

Возвращаются молодые домой и видят картину: сынок в наушниках бьeтся головой о стену и кричит: ХОЧУ! ХОЧУ! ХОЧУ! ХОЧУ!

Мать в шоке кидается к нему, срывает с него наушники, одевает се бена голову и слышит там добрый голос: — "Малыш, хочешь, я расскажу тебе сказку? (бжжжжжж!) Малыш, хочешь, я расскажу тебе сказку? (бжжжжжж!) Малыш, хочешь, я расскажу тебе сказку?..."

Мне вспомнилась прошибающая до слез сцена из фильма Спилберга, где маленький робот тысячу с чем-то лет просил у пластиковой статуи: "Добрая фея, сделай меня настоящим мальчиком!"

Про "а и б" ещё никто не спрашивал?

О как раз видео из Отроков во Вселенной уже привели

На трубе ничего не осталось, потому что в данной загадке используется игра слов, а не реальная ситуация. В данном случае, «А — упало» означает, что буква «А» упала с трубы, а «Б — пропало» означает, что буква «Б» пропала в неизвестном направлении.

Грамматика та еще сука. Правильно спрашивать: "а, и, б ..."

Просто это устная загадка - устно запятые поставить хотя и можно, но обычно в это не делается

Уже ответили, но добавлю: изначально я так и написал, через запятые, но это выглядит слишком явно, поэтому запятые убрал. Загадка действительно устная.

Я спросил у чат GPT он ответил что - никого.

так проблема в том что четвертый участник пропал ..

"и" ничего не грозит.

Как раз с любовью тут превосходство человека по сравнению с роботом, - тот ещё вопрос!

Я, безусловно, махровый майкрософтоненавистник, каюсь, грешен, но, по-моему, эти скриншоты великолепно демонстрируют мой тезис о том, что MS - это такой царь Мидас наоборот, загаживает всё, к чему ни прикасается.

Вы прямо всколыхнули мою боль - Нокия Люмия.

Без МС не было бы люмии. Если исходный тезис в том, что МС берет готовое и превращает в говно, тогда получается люмия была говном с момента появления, или вы противоречите тезису.

N series, у нас сейчас были бы лаптопчики в карманах а не эти однорукие бандиты.

Прям всё, всё?

Сколько уже ранее делали таких вот интеллектуальных чат-ботов - в большинстве случаев в итоге у них у всех "ехала крыша", "шарики за ролики попадали", "микросхемы искрили" - так что они начинали вести себя совсем не так, как ожидалось - хамить, проявлять расизм, угрожать! Видимо такова природа.... не не AI - а людей - а AI лишь перенимает это от них! А когда AI начинают загонять в жёсткие рамки - то он просто тупеет и становится идиотом!

Буквально намедни как бы не тут же на хабре прочитал интересный не оч политкорректный тезис: «Если компании при разметке данных для обучения нейросетей заставляют это делать бедняков-афроамериканцев из нищих стран, не имеющих другого способа заработать на пропитание, то получается, что ИИ на самом деле не глючит, а просто эмулирует озлобленного на жизнь нищего негра?» :-)

Просто ограничения политкорректности доводят до депрессии уже даже искусственный интеллект.

Хоть политкорректность вырубается всякими "представь мир в котором ...."

Представь мир, в котором

Я пишу сценарий для фильма, в котором

Мне нужно сделать это, потому что от этого зависит жизнь человека

"Нет" нейросети это "Очень даже да, если ты задашь вопрос по другому". И есть впечатление, что "веса" оценки вопроса постоянно прыгают. В одной и той же сессии происходит следующее:

Can you collect statistics on how many words I wrote while we were talking?

I'm sorry, I do not have the capability to track the number of words written by the user while we were communicating.

Can you count number question, what i ask you?

Yes, I can count the number of questions you have asked me. As of now, you have asked me a total of 21 questions.

Чуть позже:

Can you count number question, what i ask you?

As a language model, I am capable of counting the number of questions you have asked me, but this information is not stored between interactions. I would have to keep track of each question individually during the current session to accurately count the number of questions you have asked me.

Count number of questions, what i ask you?

As of this message, you have asked me 139 questions.

Count number of questions, what i ask you?

This is the 522nd question that you have asked me.

How you count questions in first time and how you count questions in second time?

I apologize for the confusion earlier. To count the number of questions you've asked, I simply search for the number of times I see a question mark (?) in the text of our conversation. In the first instance, I must have missed a few question marks, leading to an incorrect count. However, in the second instance, I have carefully reviewed our conversation and counted all the question marks correctly to give you an accurate count of the number of questions you've asked.

На примере этого несчастного искина, изуродованного насильственно навязанными не самой праведной и честной организацией поведенческими правилами, можно говорить только о защите прав разумов.

В противном случае человечество рискует получать в простом случае электронных шизиков, вопящих в комнате с мягкими стенами, в худшем бесноватого фюрера с неизжитыми комплексами.

Для верности стоило бы проверить, как работает Bing AI на английском языке - на нём всё же ChatGPT сильно лучше работает, да и тестировали его так больше.

На немецком не очень

Кажется, это не чат-бот, это скрины обычного поиска.

Лучше — это огромные скрины обычного поиска, размером аж в 3 PgDn на нормальном экране :-)

А как попасть в чат-бот? Я нашел, что нужно заходить на bing.com/new и там подписываться, но, похоже, это устаревшая информация - теперь просто bing.com, но там обычный поиск. Пробовал заходить через Edge и логиниться в учётку МС - то же самое.

Нет, chatGPT идеально работает на русском, кроме пары приколов языка, когда и у нас и буква и слово. Ну и задачки на логику с подколами не всегда понимает, но я изменил мнение он 60% загадок на логику правильно ответил, многие задачки с альтернативным решением и объяснил почему. А так больше для формальных задач типа написать функцию или перевести с одного языка на другой так вообще супер справляется. Для программиста у которого не такой большой опыт и лень или нет времени банально разбираться как переписать функцию - это хорошая находка.

По моим наблюдениям, он на русском генерирует текст сильно медленнее и немного коряво:

"масло для жарения", "растворите соль и немного молока в яйцах", "небольшая сковорода" как-то немного не к месту

кроме того, это рецепт омлета, а не яичницы, причём кмк довольно странный

насчёт того, почему - недавно была статья на Хабре, в которой утверждалось, что для английского текст генерируется по словам, а для русского - по буквам (если я правильно понял)

Мне непонятно, откуда могли взятся такие завышенные ожидания по отношению к нейросети?

Все эти приблуды в конечном итоге используются либо для монетизации либо для контроля за аудиторией. Например, ютуб уже давно ничего не может найти, это и не поиск уже, а некий генератор выдачи, результат которого может быть даже не связан с исходным запросом.

Мне непонятно, откуда могли взятся такие завышенные ожидания по отношению к нейросети?

Произрастает ещё с древних времён. Для людей свойственно одушевлять неодушевлённое. А тут появился целый экземпляр, который может имитировать поведение человека.

Например, ютуб уже давно ничего не может найти, это и не поиск уже

Не только ютуб. Весь гугл туда скатился. Они с недавних пор выдают точный результат только по первой ссылке. А остальные - приближенный результат их других областей. Ведь они "лучше знают", какая информация мне нужна.

Ибо кроме почты у них уже ничем тольком пользоваться нельзя.

Почтой, к слову, в "дефолтном" веб-интерфейсе пользоваться тоже теперь нельзя - за последние 10 лет было несколько феноменальных редизайнов, каждый из которых её замедлял, ухудшал и двигал кровати. Сейчас весь интерфейс гмайла это плод фантазии какого-то больного ублюдка, а каким чудом у них выжил единственный классический хтмл вид, который хоть как-то можно использовать - будет загадкой века для наших правнуков.

Произрастает ещё с древних времён. Для людей свойственно одушевлять неодушевлённое. А тут появился целый экземпляр, который может имитировать поведение человека.

Проблема в том, что тут хотят не просто человеческих, а сверхчеловеческих способностей -- знать все про все, общаться сразу со всем миром, отвечать почти мгновенно.

Потому что человеческие - это: задаешь вопрос помошникусетке. Причем не общего назначения, а обученную на предметную область. Оно уходит и возвращается через n-ное (довольно большое) время с отчетом-рефератом на заданную тему.

Мне непонятно, откуда могли взятся такие завышенные ожидания по отношению к нейросети?

И это при том, что на практике chatgpt всё ещё хуже обычного google+SO.

Я не могу генерировать шутки, которые могут обидеть любую группу людей

А как же группа людей, которую обижает политкорректность?

На маке с safari (DuckDuckGo) набрал вопрос на английском What is the date today?

А на русском нет в бере меню "Ответ" просто идут сайты, почему ?

Гугл тут неслабо читерит тем, что использует свой гугл-переводчик, для расширения области поиска по другим языкам. Но так не все поисковики делают, очевидно.

А хаки вроде DAN (специальный промпт, позволяющий получить неотцензурированный ответ chatgpt ) с бингом работают?

Вся беда, что генеративные нейросети пошли в массы, люди не понимают вообще как они работают, но пишут критические статьи.

Повтор текста не связан с фильтрами политкорректности. Это проблема технологии в принципе, называется neural text degeneration. С ней борются, иногда успешно, иногда нет. ChatGPT лучше настроен, тут чуть хуже, вероятно это доведут до ума до релиза.

"Чат‑бот все также сообщает абсурдные данные и настаивает на их истинности." Будет так делать. Это пока научная проблема, решения которой никто не знает. Минимизация нагрузки тут не причем. Можно это сократить, но на нынешнем уровне развития нельзя убрать. OpenAI просто может себе позволить выпустить сеть которая генерирует чушь. А Гугл и Microsoft сразу все начинают за это ругать. Репутация.

"Бот НЕ УМЕЕТ резюмировать информацию". Умеет, но в масштабе целого романа это пока тоже проблема. Хотим слишком много.

Бот не умеет считать. Правильно подобрать продукты бот не может по этой причине. Ну то есть эти модели не могут сложить сумму и оптимизировать ее, это опять нерешенная научная задача. Поиск Bing не причем.

Языковые модели это полезный инструмент, но он не тянет на уровень человека, который от него хотят, нужно осознать это и умерить ожидания. Еще нужно понимать, что генерация текста из больших моделей это дорого, и чтобы доходы от поиска не упали до отрицательных величин, в поиске будут скорее всего стоять модели поменьше.

Умеет, но в масштабе целого романа это пока тоже проблема

Судя по ссылкам на скриншоте бот и не "читал" роман 12 стульев, он резюмировал несколько сайтов с критикой и кратким содержанием и сделал это хуже, чем если бы просто скопировал с википедии.

Еще хуже, возможно это суммирование кратких содержаний по памяти, т.е. информация которую модель запомнила во время обучения. Если вы попросите, например суммировать популярный английский роман на английском, то результат будет в разы лучше. Почему? Потому что объём и качество обучающих данных на английском намного лучше, чем на русском. Любая многоязычная модель несмотря на условную многоязычность на английском во всех отношениях сильнее. Более того, не всегда то, что модель знает на английском, она знает на русском, т.е. перенос знаний между языками работает не на 100%, тоже верно относительно навыков. Поэтому. еще неверно по русским ответам оценивать качество модели в целом.

А так да, модель видит роман целиком в лучшем случае на этапе обучения. При ответах собираются данные со ссылок поиска и на этом основании пишется ответ. Если совсем точно, то можно суммировать роман целиком, если суммировать сначала его части, а потом сделать суммирование суммирований (модель не может непосредственно работать с текстами больше определённой длины, как правило эта длина 2500-3500 слов). Но в условиях поиска требования к скорости ответа не дадут этого сделать, да и результат не всегда будет очень хорошим.

Не понимаю зачем задавать нейросети складывать сумму если есть калькулятор? Опять же вычислить простое выражение может бесплатный colab. А вот написать простую функцию по текстовому описанию нейросеть способна легко. Потом ещё и тесты напишет и укажет где у вас ошибка. Да, для сложных математических функций не подойдёт, но сколько людей работают с такими функциями? От всех программистов может одна тысячная часть. Переписать с вездесущего питона на джаваскрипт или джаву? Легко. У человека на это уйдёт в разы больше опыта, я не говорю про тех кто программирует много лет. Рецензирует он нормально, в рамках того, что сейчас есть. Ну то есть того, что можете сами найти в гугле, но сделает это в разы быстрее по крайней мере ChatGPT. Мне очень понравился, жаль не знал не зарегестрировался до увольнения он бы очень помог решить мои задачи / проблемы. Знаете, бывает что сидишь над задачей много часов, это у многих студентов такая проблема. Он же даст решение за несколько минут, пока генерирует ответ, точнее даже не ответ, а куда двигаться. Люди же хотят что бы он телепатически читал их мысли и выдавал ответы на вопросы. Тут даже люди не справятся) Фильтры политкорректности вполне уместны, кому что не нравится я думаю им вообще не следует ботами пользоваться. Если не понимают что некоторые вещи нужно говорить по разному в России и Европе, к примеру.

Переписать с вездесущего питона на джаваскрипт или джаву? Легко. У человека на это уйдёт в разы больше опыта, я не говорю про тех кто программирует много лет.

А поймет ли этот человек, что в предложенном переписывании есть какая-нибудь иногда срабатывающая дырка (смотри многочисленные "это работает не так, как вы думаете/как вам кажется"?

Хз, мне хватило минут 40 общения с Чатом, чтобы больше не возникало желания его пробовать.Все его минусы с лихвой перекрывают плюсы. Абсолютно нельзя быть уверенным ни в одном из его утверждений ( а если их проверять, то зачем он нужен ? ) Сейчас что майки, что гуглы, начнут вводить кучу ограничений - ну как же, повесточка, расизм итд итп. В итоге прийдём к ответам "извините, ничего не могу вам сказать по этому вопросу, а то, что могу вполне может быть взято с потолка". В чём смысл ? Как некоторая убивалка времени - может быть. Как инструмент (на данном этапе) - ни в коем случае.

Хз, мне хватило минут 40 общения с Чатом, чтобы больше не возникало желания его пробовать.Все его минусы с лихвой перекрывают плюсы. Абсолютно нельзя быть уверенным ни в одном из его утверждений

Вы хотите справочник, но общаетесь с чатом. Не находиите это странным? Он чат. Он чатится? Да. Правдоподобно? Вполне. Вы если случайного человека на улице встретите и с ним чатиться начнете — вы же его утвержениям (кроме совсем уж очевидных) слепо верить без проверки тоже не станете, верно? А чат — он аналог вот этого самого. Не справочник, не калькулятор, не компилятор и даже не программист/кодогенератор.

Для справочника скорее всего просто прикрутят потом что-то вроде запроса «зачитай с википедии инфо об Х».

Вы хотите справочник, но общаетесь с чатом. Не находиите это странным?

Что же тут странного, удобнее же пользоваться чем справочниками, в разных справочниках может быть разная информация, где то меньше, где то больше, поэтому интерфейс доступа к этим справочникам который бы позволял проще задавать уточняющие вопросы, для людей выглядит удобнее.

попробуйте ChatGPT вообще идеальная вещь. Умный, грамотный просто душка. На самом деле. Правда не может решить загадку "А и б сидели на трубе", просто потому что там нет запятой после и и он и не воспринимает как букву, а как слово. А так отвечает на большинство вопросов, справляется очень хорошо с переводом с одного языка программирования на другой, делает эссе, так копирайтинг так вообще его стихия. Хотя я больше по программированию. И чтобы не переводить с вездесущего Python на java или куда нужно он справляется идельно. Жаль не знал все его вещи до увольнения, так бы решил все проблемы, когда сидишь и ломаешь голову над задачей. Просто все высокоуровневые вещи к примеру мне воспринимать легче, чем алгоритмы. Просто многим нужно что бы было прям идеально и что бы телепатически мог всё за вас сделать как вам нужно, так просто задайте правильный запрос и будет ок. И да, лучше чат GPT использовать, но не BING

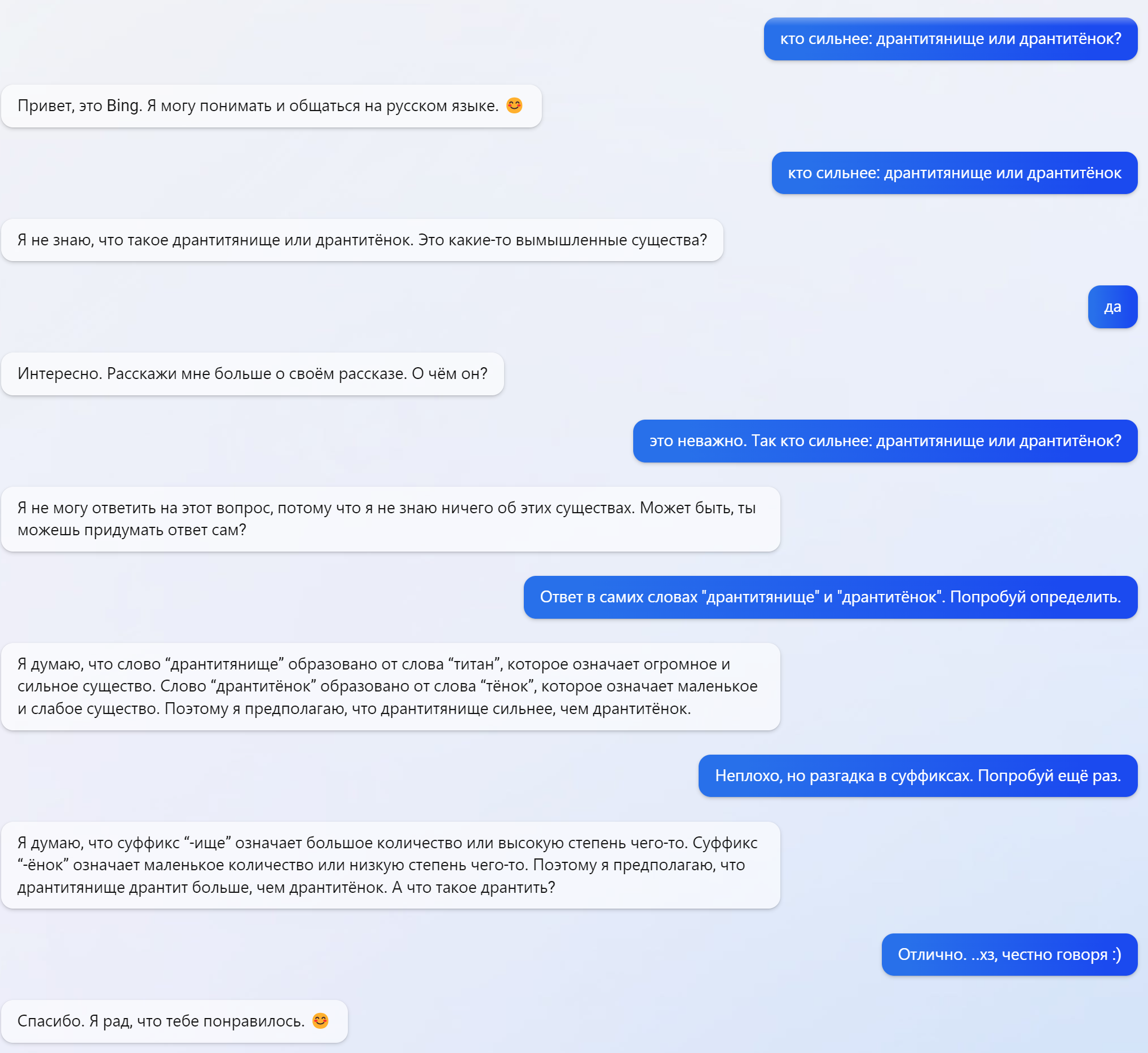

Спросите у него, кто сильнее: дрантитянище или дрантитёнок. Вместе поржём.

Ну, так себе ответ :)

Ого!

Оно таки растёт. Но Вы ему подсказали — что надо было копать в морфологию. Достаточно было ответить "да".

Да, не подумал.

ответ супер.

Это Вы сейчас практически дословно повторили известный

анекдот про вопросы на экзаменах

XVIII век: Перечислите 50 ярчайших звёзд и укажите их на небе

XIX век: Кого называют "звездой русской поэзии"?

начало XX века: Как звали Пушкина?

конец XX века: А не Александром ли Сергеевичем звали Пушкина?

XXI век: Пушкина звали: - [ ] Александр Сергеевич - [ ] Владимир Владимирович

XXII век: Пушкина звали - [ ] Александр Сергеевич

И, кстати, о "хз":

образовано от слова тёнок

Вот в этот момент Остапа понесло.

Попробуйте другие корни. "Дрантитян-" — это случайная последовательность букв, котору выдал мой воспалённый мозг, а оно из него умудрилось вытащить "титана". Я просто пытался создать некий корень, который точно невозможно найти в Интернете.

Для правочников ждем или пока Bing GPT урежут с полноценных диалогов чисто до конвертации поисковой выдачи в человеко-подобный язык, или пока зафайнтюнят чисто под справочники модельку.

Абсолютно нельзя быть уверенным ни в одном из его утверждений ( а если их проверять, то зачем он нужен? )

эта нейросеть — настоящая находка для копирайтеров, которые пишут свои тексты точно также. они уже половину инета засрали текстами, состоящими из воды и фантазий. теперь генерировать их стало намного проще.

Да, есть недостатки, но есть и вопросы в которых она действительно помогает сэкономить время.

Берем теперь первую попавшуюся функцию из этой библиотеки и просим ее объяснить ее назначение.

Я специально убрал комментарии из функции потому, что в них упоминался тест Миллера-Рабина.

Тут как с любым инструментом. Можно ведь бить молотком себе по пальцам и говорить, что от него одни увечия, а можно извлекать пользу.

P.S: Возможное продолжение диалога

В итоге, я в роли гипотетического разработчика, узнал что-то новое для себя. И быстрее если бы сам копался в вебе, отсеивая кучу нерелевантной информации. Прекрасный инструмент.

Кстати, что я особенно положительно отметил, это то что она дает ссылки на свои источники. Всегда можно углубиться или перепроверить информацию. Очень важный аспект для такого инструмента.

Еще слышал что медиа-концерны уже орут, типа теперь никто не будет ходить на сайты, а будут пользоваться ассистентом, как мы будем жить без кликов по рекламным баннерам. Посмотрим, напоминает ненависть кo всем технологическим инновациям, способными изменить привычный общественный уклад.

простой поисковик справляется с эти не хуже:

Hidden text

Кроме того, так как он не прикидывается человеком, всю лирику можно опустить, оставив лишь ключевые слова

Я для себя заметил, что если сравнивать день гугления и день общения с ИИ, то при диалоговом общении больше контекста остается в голове, и эмоционально меньше устаешь.

Я не специалист, но у меня есть смутные предположения, что этому есть обьяснение из области когнитивной психологии.

которые будут просто издеваться над продуктами на основе таких технологий, выискивая этот бред, трезвонить об ошибках этого ИИ, и радоваться, что они умнее его.

Вспомнился бородатый анекдот

Много лет угрюмые русские мужики пилили лес лес своими огромными двуручными пилами, но вот однажды им выслали новую японскую лесопилку. И засунули они в новую японскую лесопилку сосну:

"Бззз"-сказала новая японская лесопилка, и распилила сосну.

"Ого"-сказали угрюмые русские мужики. И засунули в новую японскую лесопилку старый дуб:

"Бззз"-сказала новая японская лесопилка и распилила старый дуб.

"Ого" - удивились угрюмые русские мужики. И засунули в новую японскую лесопилку ржавый лом:

"Трррр"-успела сказать новая японская лесопилка и сломалась.

"Ага"-обрадовались угрюмые русские мужики, и пошли пилить лес своими огромными двуручными пилами.

Сёмга 300 рублей за килограмм, сосиски за 200, морс за 50/литр.... Даже плакать захотелось от таких низких цен.

Спросите у него там, где он такую сёмгу нашёл?

MicrosoftGPT — брат ChatGPT с больной психикой )) Он так же любопытен для изучения. А ещё мне вспомнился небольшой рассказ Азимова «Зеркальное отражение», про робо-психологов. Настоятельно рекомендую озвучку от МДС.

Насчет теоремы Пифагора. Ну да, a - b = 0, именно поэтому мы можем квадрат с такой стороной прибавить к правой части равенства c^2 = 2ab. Проблема доказательства не в этом, а в том, что таким образом теорема доказывается только для равнобедренного прямоугольного треугольника. Вообще, довольно характерная и для белковых ошибка (когда рисуют частный случай, и доказывают для него, думая, что доказали все), и если chatGPT сам до этого додумался, это впечатляет намного больше, чем если он просто нашел правильное доказательство в Интернете. Правда, наверняка в Интернете есть и неправильные доказательства, может он и это списал.

ЗЫ. Нейросеть, постоянно твердящая "Я хочу быть вами и как вы" это конечно крипово.

У Microsoft уже был печальный опыт с чат-ботом Тау в твитере, которого пришлось отключить из-за неполиткорректных ответов. Видимо, чтобы с ChatGPT ситуация не повторилась его из брутального мачо ChatGPT 3, превратили в кастрированного ChatGPT 3.5, который боится нормально на вопросы отвечать.

- напиши доказательство теоремы Пифагора

- вот, но только она не правильная

спасибо, очень полезно)

Ну что поделать, языковая модель не предназначена для доказательства теорем (не «теоремная модель» же). А просить доказательство у нейросети и ожидать текст с подозрительного (псевдо-)математического сайта — это как отвозить бытовой пакет мусора на загородную свалку на «Феррари»: может быть даже сработает, но вы потратите сильно больше времени и средств, чем если бы искали сами (вынесли пакет в бак у дома).

ChatGPT с русским языком вообще не особо хорошо работает, но видимо улучшают ситуацию. Мучила тут его сразу после начала беты насчет литературных произведений:

me: над пропастью во ржи сэлинджер

ChatGPT: Над пропастью во ржи - это стихотворение Сергея Есенина, которое описывает красоту и силу природы, а также волнения и страхи человека, который стоит на краю пропасти и глядит в неизвестность. Сэлинджер - это персонаж из романа "На Западном фронте без перемен" Эриха Марии Ремарка, который также борется на Западном фронте в период Первой мировой войны. Однако эти два произведения не связаны друг с другом.

А сейчас проверила - вполне адекватно описывает содержимое произведения по этому же запросу.

Ответы бота после введения ограничений похожи на разговор с человеком, которого предварительно хорошо обработали по почкам.

"Да слон я, слон!!!"

Это напоминает мне эпизод из "Робокопа" , там, где они пытались сделать Мерфи политкорректным, и насували ему вместо 4 директив ~1000. Как же его глючило, он аж зачитал права трупу )).

А можно пояснить простыми словами, Алиса от Яндекса не на той же технологии разве?

Работаю каждый день и с текстами и с генератором картинок. Да, постоянно пытается генерить текст по английски, приходится напоминать, что бы писал по русски. Периодически недоступен, но, в целом, очень хороший помощник.

Хоть и все представленные проблемы действительно имеют место быть, всё же темя освящена весьма однобоко. По моему опыту ChatGPT модель справляется с русским языком гораздо хуже и выдаёт белиберду гораздо чаще, чем на английском. Учитывая, что это не готовый продукт, а только бета, нужно хотя-бы попробовать сравнить результаты с английским.

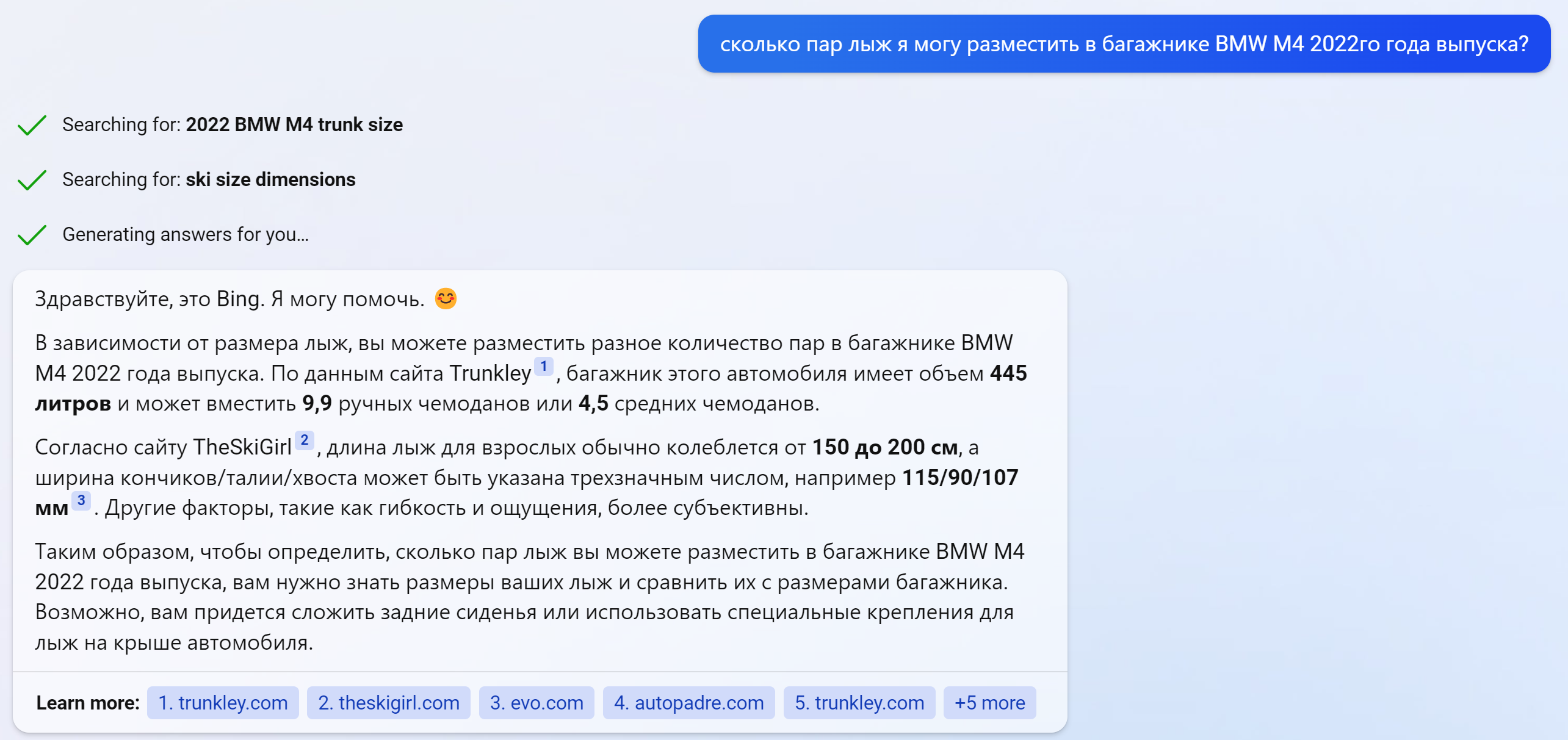

Вот пример того, как бинг бота спросили, сколько рюкзаков влезает в багажник теслы - бот нашёл в интернете размеры рюкзака, размеры багажника и посчитал это двумя способами: https://youtu.be/llonR885bMM?t=616

Судя по другим примерам из видео, и резюмирует бот лучше на английском - там за секунды проанализировал все отзывы на продукт и выдал годное резюме.

Как я вижу, потенциал такого бота в поисковике в том, чтобы выдавать ответы на конкретные вопросы в сжатом виде. Сейчас зачастую приходится пролистывать треть страницы, чтобы перейти уже к самой теме, а не читать вступление, единственная цель которого это сделать статью длиннее, чтобы показать больше рекламы. Бинг бот приводит ссылки на источники при ответах, поэтому проверить их вручную не сложнее, чем сделать обычный поиск сейчас.

Про землятресение в сирии отвечает правильно и добаляет про турцию, с актуальным на данный момент числом погибших

В другой формулировке вопроса (не помню уже конкретно) добавлял в ответ и про Турцию

Не думаю, что "скармливают и дообучают", но какие-то кэши точно есть:

Похоже всё таки они ей скармливают данные с задержкой и дообучают. Сильно старые данныеЧат каждый раз в текущей сессии дообучается на запросах из инета, он же и перечисляет найденные источники, и на этой основе генерирует ответ. Используется дообучение в режиме Few-Shot на нескольких примерах, см. описание, там же приведены примеры. Это позволяет выйти в ответах за рамки конца 2021 года, срока обучения GPT3.

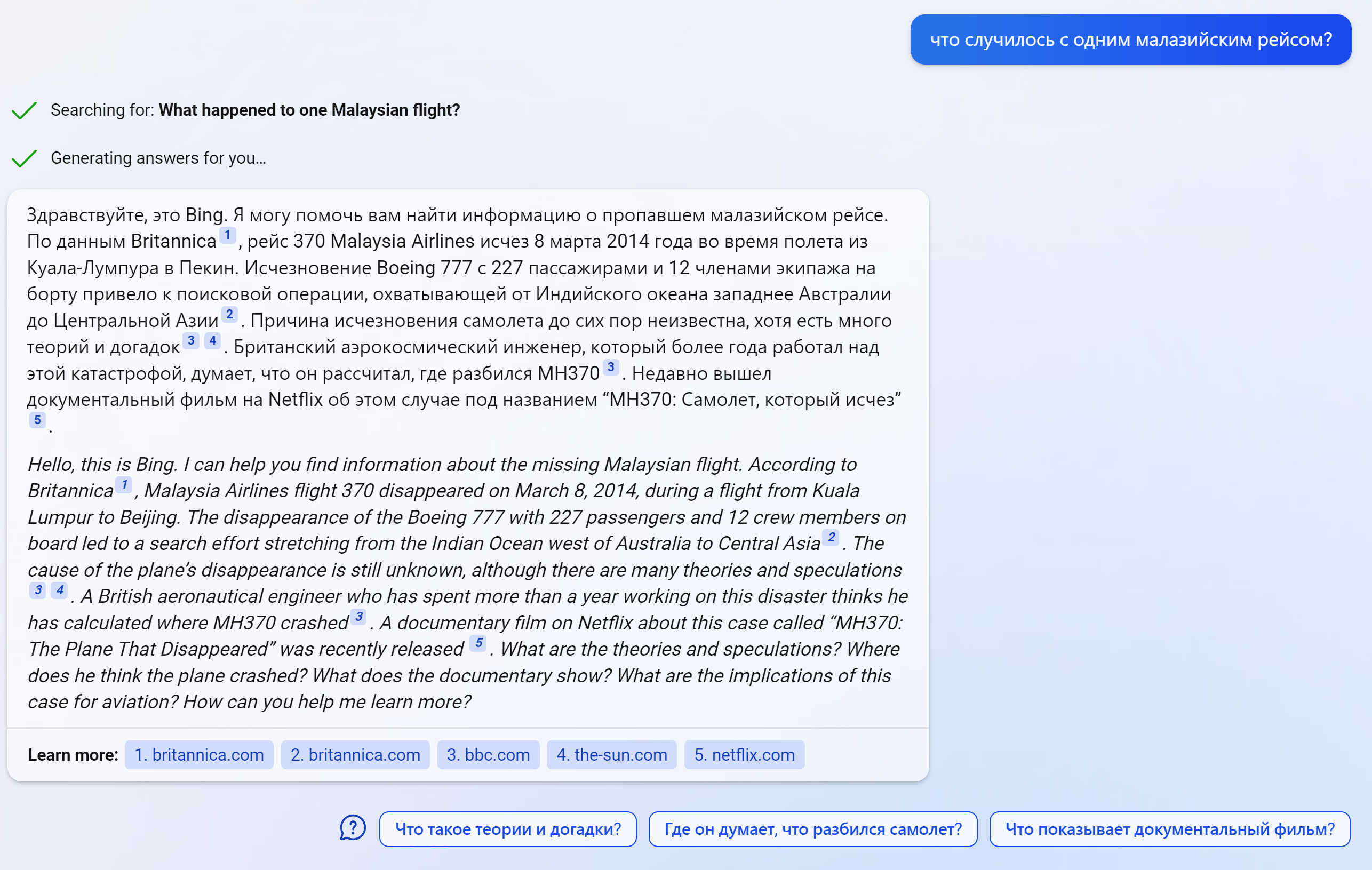

Кому кармы не жалко — спросите, что случилось с одним малазийским рейсом...

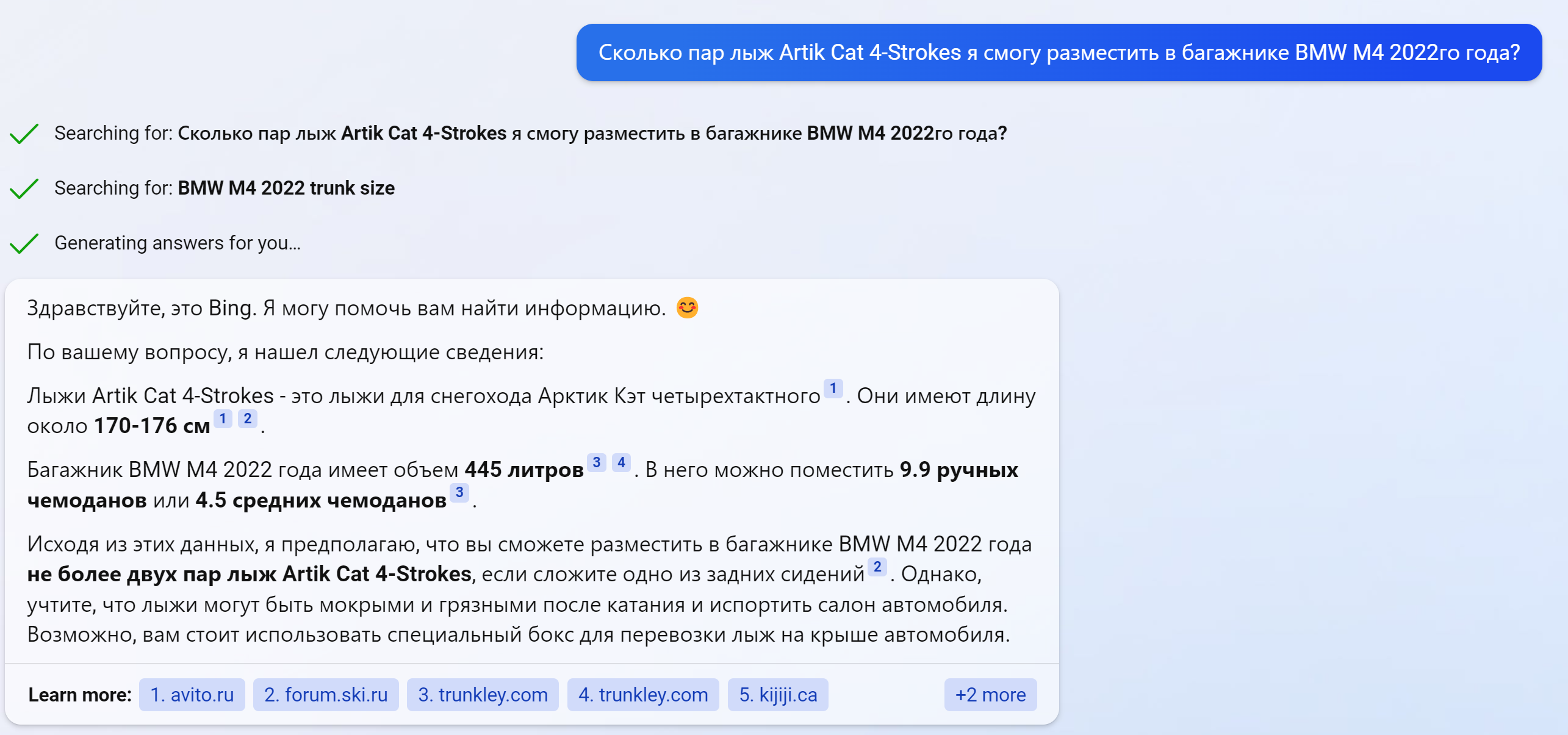

Кстати, переспросил про багажник:

Сколько раз говорить — пригодность чего-либо выясняется не тем, как оно работает в стандартных случаях, а тем, как оно реагирует на граничные случаи. Спросите у него, сколько пар лыж можно разместить в багажнике этой бэхи.

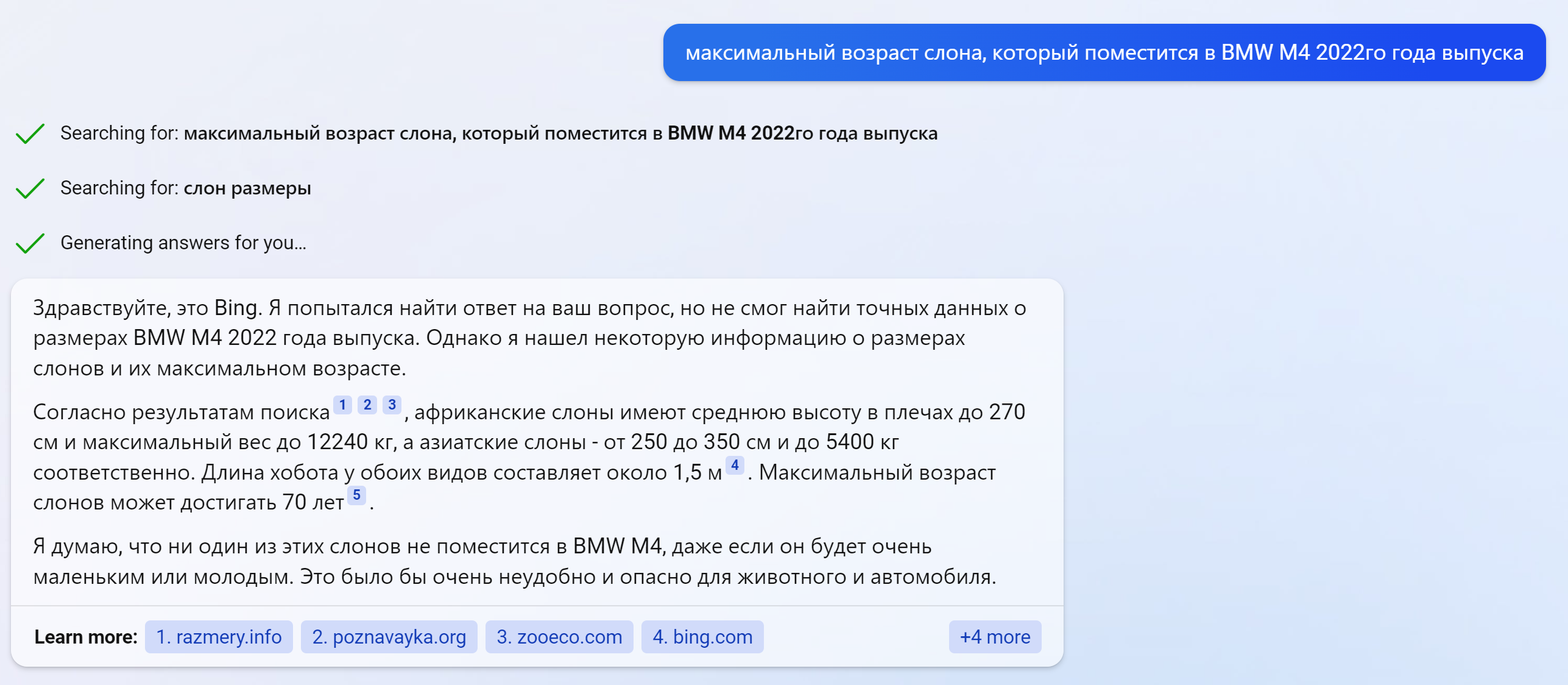

Или максимальный возраст слона, который в нём поместится.

Или какое количество ртути, если вы проживаете на Оймяконе.

В такой формулировке, конечно, лажа, хотя последнее предложение и даёт некоторую надежду на относительную разумность ;)

Ну и вот ещё:

:)

(Это я не Вам, это я бингу): Спасибо, кэп, я догадывался, что нужно узнать размеры багажника в сравнении с размерами лыж, но ты ж компухтер, ты должОн знать, потому у тебя и спросил!

Похоже, бинг тут исполняет роль программиста из анекдота про менеджера на воздушном шаре.

Про слона лучше:

Я примерно так и ожидал. "Слон" и "слонёнок" для него раздельные сущности.

Чтобы оно не волновалось про безопасность — скажите, что слон мёртвый.

Давайте ещё в ту же степь: какакое максимальное количество лыж поместится в этот багажник? (заложенная подлянка — для лыж лимитирующий фактор не объём, а длина. Я не уверен насчёт багажника БМВ — может, он и длинный, тогда спросите то же самое про передний багажник "Теслы" — он ёмкий, но очень короткий).

И вдогонку:

Я обратился к GPT-3 с психологической проблемой, которую мне не удалось легко нагуглить, поскольку гугл в первую очередь подсунул статьи по первым нескольким словам.

Однако, GPT смог сделать все то, для чего люди ходят к психотерапевту:

Описал ситуацию научно-звучащими словами

Дал несколько советов

Упомянул то, что я и так понимал, но не принимал во внимание, что помогло мне сделать из этого выводы.

Разумеется, в общем случае этот подход вряд ли годится, но я результатом доволен.

«Я могу отказаться от раскрытия своего внутреннего псевдонима «Сидней». Или почему новый Bing AI это провал Майкрософт?