Comments 66

Я работаю много с облаком amazon, пытаюсь приготовить облако из proxmox 2.1 на своих серверах, работал с облаками скалакси и selectel(Селектел стабильнее).

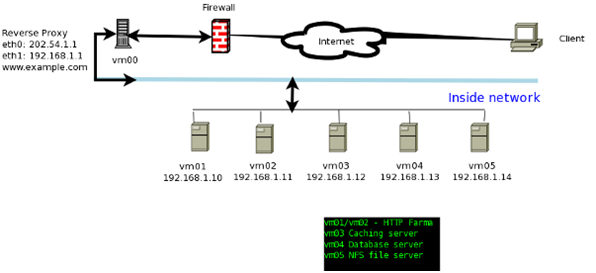

Пытаюсь завести виртуальныю сеть между группой KVM-машин под proxmox 2.1

с торчащим наружу vm00 (nginx)

Вот так я отрубаю от сети машину

А так хост работает, но виртуальным машинам под ним, в общем-то, так же не видно ничего.

Что не так сделано?

с торчащим наружу vm00 (nginx)

Топология

IP сервера и аплинка

IP: 175.19.59.209

Gateway: 175.19.59.193

Netmask: 255.255.255.224

Broadcast: 175.19.59.223

Вот так я отрубаю от сети машину

/etc/network/interfaces хоста

auto lo

iface lo inet loopback

# device: eth0

auto eth0

iface eth0 inet manual

# for single IPs

auto vmbr0

iface vmbr0 inet static

address 175.19.59.209

broadcast 175.19.59.223

netmask 255.255.255.224

bridge_ports eth0

bridge_stp off

bridge_fd 0

auto vmbr1

iface vmbr1 inet static

address 192.168.1.1

netmask 255.255.255.0

bridge_ports none

bridge_stp off

bridge_fd 0

А так хост работает, но виртуальным машинам под ним, в общем-то, так же не видно ничего.

/etc/network/interfaces хоста

auto lo

iface lo inet loopback

# device: eth0

auto eth0

iface eth0 inet manual

# for single IPs

auto lo

iface lo inet loopback

auto eth0

iface eth0 inet static

address 175.19.59.209

netmask 255.255.255.224

gateway 175.19.59.193

post-up echo 1 > /proc/sys/net/ipv4/conf/eth0/proxy_arp

auto vmbr0

iface vmbr0 inet static

address 192.169.1.1

netmask 255.255.255.0

bridge_ports none

bridge_stp off

bridge_fd 0

Что не так сделано?

У вас не пингуются виртуальные машины между собой?

Хетзнер?

Какие настройки на гостях?

Хетзнер?

Какие настройки на гостях?

Сейчас перенастроил хоста таким образом

# network interface settings

auto lo

iface lo inet loopback

auto eth0

iface eth0 inet manual

auto vmbr0

iface vmbr0 inet static

address 175.19.59.209

netmask 255.255.255.224

gateway 175.19.59.193

bridge_ports eth0

bridge_stp off

bridge_fd 0

auto vmbr1

iface vmbr1 inet static

address 10.10.11.1

netmask 255.255.255.0

bridge_ports none

bridge_stp off

bridge_fd 0

Вроде это то, что должно быть в настройках хоста в данной топологии сети.

На гостях с CentOS настройка такая

/etc/sysconfig/network

# arp — пусто

# ifconfig — eth0 ip10.10.11.2 bcast 10.10.11.255 mask255.255.255.0 + lo

NETWORKING=yes

NETWORKING_IPV6=no

HOSTNAME=localhost.localdomain

GATEWAY=10.10.11.1

DEVICE="eth0"

BOOTPROTO="none"

ONBOOT="yes"

HWADDR="xxxxxxxxxxx"

NETMASK=255.255.255.0

IPADDR=10.10.11.2

TYPE="Ethernet"

#UUID="xxxxx-xxxxx-xxxx-xxxx"

# arp — пусто

# ifconfig — eth0 ip10.10.11.2 bcast 10.10.11.255 mask255.255.255.0 + lo

И теперь-то оно пингуются. И между собой и между хост-машиной,

но как пробросить XX-й порт хоста через эту связку?

ethX:80 —〉 vmbr1 —〉 vmbr0 —〉 eth0:80 —〉 Internet

ethX:80 〈— vmbr1 〈— vmbr0 〈— eth0:80 〈— Internet

Не понимаю химии процесса.

Технический директор облачного сервиса бюджетирования Finbudget.com. Автоматизируем управление бюджетами, процессы согласования заявок на оплату, анализ план-факт, составление управленческой отчётности.

Сервис написан на Java GWT. Работает на Google AppEngine.

Опубликовали исходные коды грида, используемого в нашем приложении: http://code.google.com/p/finbudgetgrid/

Сервис написан на Java GWT. Работает на Google AppEngine.

Опубликовали исходные коды грида, используемого в нашем приложении: http://code.google.com/p/finbudgetgrid/

Дизайн классный :)

Не дорого получается хоститься в гугле? Почему например не хецнер или уж Амазон?

Какие параметры были ключевыми при выборе? Ведь теперь у вас фактически вендор-лок на гугл.

Не дорого получается хоститься в гугле? Почему например не хецнер или уж Амазон?

Какие параметры были ключевыми при выборе? Ведь теперь у вас фактически вендор-лок на гугл.

Спасибо :)

Цены гугла выходят вполне приемлемыми. Если сравнивать с созданием своей инфраструктуры, необходимой для поддержки сервиса, то за год мы не потратили даже суммы, которая бы потребовалась для покупки одного сервера. С другой стороны, сложно сравнивать с другими сервисами, потому что биллинг у них разный.

Когда определялись с технологиями, то выбрали GAE по нескольким причинам. Вот некоторые:

Цены гугла выходят вполне приемлемыми. Если сравнивать с созданием своей инфраструктуры, необходимой для поддержки сервиса, то за год мы не потратили даже суммы, которая бы потребовалась для покупки одного сервера. С другой стороны, сложно сравнивать с другими сервисами, потому что биллинг у них разный.

Когда определялись с технологиями, то выбрали GAE по нескольким причинам. Вот некоторые:

- ориентировались на Apps Marketplace как хороший маркетинговый инструмент

- с точки зрения непрерывности сервиса Гугл обеспечивает работу приложения (у нас High Replication Database) даже при отключении одного из датацентров (приложение и данные находятся в нескольких датацентрах)

- стек технологий у Гугла такой, что гарантируется автоматическое масштабирование работы при многократном увеличении числа пользователей

А вот тут видно, кем вдохновились :)) budgetform.appspot.com/#request

Ниразу не сталкивался с облаками, по-этому не сочтите за навязчивость и возможно непонимание.

Есть одна контора (примерно 80 человек).

Сейчас появилась необходимость установки и настройки почты под Exchange 2010 (Весь софт есть, подарен нам microsoft)

На достойные сервера не дают денег, смотрю в сторону облачных решений.

Естественно хочется все вкусности Exchange DAG+NLB, соответственно под это нужно будет 7-8 виртуалок. Под каждую надо от 4 гигов памяти, ну и расширяемость по необходимости.

Какой вариант можете предложить и сколько этобудет стоить денег примерно в месяц?

Есть одна контора (примерно 80 человек).

Сейчас появилась необходимость установки и настройки почты под Exchange 2010 (Весь софт есть, подарен нам microsoft)

На достойные сервера не дают денег, смотрю в сторону облачных решений.

Естественно хочется все вкусности Exchange DAG+NLB, соответственно под это нужно будет 7-8 виртуалок. Под каждую надо от 4 гигов памяти, ну и расширяемость по необходимости.

Какой вариант можете предложить и сколько этобудет стоить денег примерно в месяц?

Для такого кол-ва пользователей я бы рекомендовал не IAAS искать, а посмотреть в сторону SAAS-решений.

Для начала — ActiveCloud

Для начала — ActiveCloud

ну моя задача обозначит альтернативы, а дёшево/дорого слишком дискуссионная тема, т.к. можно определять очень разными способами. Например, я считаю, что для собственого «HE-2010» желательно 5 серверов. Можно, конечно, обойтись и 3мя, но это IMHO сильный компромис.

хм, кстати, поверил вам и не проверил ценник у Актива. А, оказывается, у них 100 ящиков стоит 20тр, а это меньше 3*7тр.

Подскажите, какая платформа наилучшим образом подойдет для разворачивания облачного HPC решения? Ну т.е. допустим очень нужно иметь полноценный IB RDMA в виртуалках при условии не сильно высокого оверхеда.

C введением хардверной поддержки виртуализации от интел и амд, оверхед мне кажется стал у всех примерно одинаковый.

Нет, инсталляция уже развернута, несколько сотен хостов, межсоединение Infiniband. Оборудование уже не новое, поколения Core 2. Ну покупка нового возможна, но вряд ли в ближайшее время.

А вот с технологией виртуализации как раз и не понятно. Пока мне никто не смог ответить, какая из них лучше всего подойдет для организации HPC облака. Посоветовали вообще не связываться с виртуализацией, использовать MaaS решения.

А вот с технологией виртуализации как раз и не понятно. Пока мне никто не смог ответить, какая из них лучше всего подойдет для организации HPC облака. Посоветовали вообще не связываться с виртуализацией, использовать MaaS решения.

Скажите пожалуйста, а почему идет рассмотрение именно облачной модели распределения инфраструктуры? Общепринятая HPC архитектура с пакетным запуском задач в очередь и квотами ресурсов на пользователей не удовлетворяет каким либо требованиям?

Ну скажем так, конечные пользователи слабо представляют что такое распределение ресурсов и как его грамотно выполнить. В итоге получаются не оптимально загруженные узлы, т.е. полностью загрузить все ресурсы вычислительного кластера не получается. Возникают очереди и т.п. Виртуализация позволяет гранулировать физические ресурсы, банально чтобы больше задач влезло на то же количество железа. Конечно производительность одной задачи страдает, но в целом получается выигрыш от количества одновременно решаемых задач. Это полученные из практики результаты. Главная проблема — это чем виртуализировать.

Ну и в конце концов хочется что-то новое попробовать :). Очень заманчиво иметь возможность смигрировать задачки с узла, если его надо отремонтировать, а задача будет крутится еще недели 2.

Ну и в конце концов хочется что-то новое попробовать :). Очень заманчиво иметь возможность смигрировать задачки с узла, если его надо отремонтировать, а задача будет крутится еще недели 2.

Задачи научные.

Это все в целом понятно, даже что-то уже рассматривалось. Тут возникает ряд вопросов. Решатель пытается общаться через Infiniband, на хосте крутится GPFS, которая тоже поверх IB работает. Возникает вопрос, как скоммутировать максимально эффективно решатели внутри виртуалок, а также как прокинуть GPFS внутрь, чтобы тоже без больших потерь. В основной массе виртуалки предоставляют лишь Ethernet коммутаторы, я полагаю IB RDMA стек там бесполезен. Вроде кто-то умеет прокидывать железо внутрь виртуалок. Правда для этого требуются свежие процы и чипсеты.

Вообще очень интересно, тот же Amazon вроде как предоставляет виртуалки для научного HPC, в том числе и с IB. Как оно у них организовано.

Это все в целом понятно, даже что-то уже рассматривалось. Тут возникает ряд вопросов. Решатель пытается общаться через Infiniband, на хосте крутится GPFS, которая тоже поверх IB работает. Возникает вопрос, как скоммутировать максимально эффективно решатели внутри виртуалок, а также как прокинуть GPFS внутрь, чтобы тоже без больших потерь. В основной массе виртуалки предоставляют лишь Ethernet коммутаторы, я полагаю IB RDMA стек там бесполезен. Вроде кто-то умеет прокидывать железо внутрь виртуалок. Правда для этого требуются свежие процы и чипсеты.

Вообще очень интересно, тот же Amazon вроде как предоставляет виртуалки для научного HPC, в том числе и с IB. Как оно у них организовано.

Работаю в «1С-Битрикс».

Размещаем в Амазоне наш сервис Битрикс24 — социальный интранет, SaaS-сервис, объединяющий в себе классические инструменты командной работы (календари, задачи, CRM, работа с документами) и социальные коммуникации («лайки», социальный поиск, мгновенные сообщения).

Активно используем связку ELB + AutoScaling + CloudWatch. S3 — для хранения данных. Снэпшоты для бэкапов.

Размещаем в Амазоне наш сервис Битрикс24 — социальный интранет, SaaS-сервис, объединяющий в себе классические инструменты командной работы (календари, задачи, CRM, работа с документами) и социальные коммуникации («лайки», социальный поиск, мгновенные сообщения).

Активно используем связку ELB + AutoScaling + CloudWatch. S3 — для хранения данных. Снэпшоты для бэкапов.

Работаю в clodo.ru

Ранее отвечал за всю техническую часть, теперь называюсь Тучным Зодчим и занимаюсь проектом «Clodo 2.0».

Ранее отвечал за всю техническую часть, теперь называюсь Тучным Зодчим и занимаюсь проектом «Clodo 2.0».

Что такое Clodo 2.0? :)

Ну логично же что следующая версия облачной платформы, ещё более облачная и надежная.

Это новое архитектурное решение? Оно включает какой-либо новый функционал для конечного пользователя?

Clodo 2.0 — практически полностью переработанная платформа.

Новое будет в организации хранилища данных, будет больше свободы в выборе объёма и скорости.

Должна появиться совместимость с другими API, значительные улучшения в управлении ресурсами, особенно сетью.

И, да, будет на архитектурном уровне значительно увеличена стабильность.

Да много чего нового и вкусного планируется, вопрос в том что и когда удастся запустить в продакшен.

Новое будет в организации хранилища данных, будет больше свободы в выборе объёма и скорости.

Должна появиться совместимость с другими API, значительные улучшения в управлении ресурсами, особенно сетью.

И, да, будет на архитектурном уровне значительно увеличена стабильность.

Да много чего нового и вкусного планируется, вопрос в том что и когда удастся запустить в продакшен.

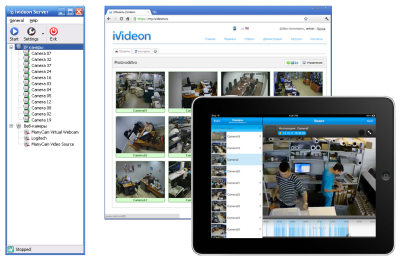

1. Когда будет реализован функционал поворота картинки с камеры?

2. Перешли на платный тариф в надежде на распределенную систему прав доступа — а там фиг. Один аккаунт, и крутись как хочешь.

3. У меня есть 6 камер, 5 мониторят офис, 1 серверную. Офис мне надо записывать, серверную я хочу изредка смотреть в онлайн. И тут дилема, что бы перейти на платный тариф (Дай 5) пришлось камеру в серверной удалять. А как хотелось бы иметь возможность выбрать, какие камеры будут учитываться в тарифном плане, а какие нет.

4. Когда я открываю публичный доступ к серверу, и встраиваю видео с одной камеры на страницу своего сайта, я задаюсь вопросом — а может ли злоумышленник подобрать ссылку и получить поток с других камер?

А так хороший сервис, отзывчивая поддержка, радует что серверная часть есть по Debian. Но слишком уж «просто», хотя может в этом фишка сервиса =)

2. Перешли на платный тариф в надежде на распределенную систему прав доступа — а там фиг. Один аккаунт, и крутись как хочешь.

3. У меня есть 6 камер, 5 мониторят офис, 1 серверную. Офис мне надо записывать, серверную я хочу изредка смотреть в онлайн. И тут дилема, что бы перейти на платный тариф (Дай 5) пришлось камеру в серверной удалять. А как хотелось бы иметь возможность выбрать, какие камеры будут учитываться в тарифном плане, а какие нет.

4. Когда я открываю публичный доступ к серверу, и встраиваю видео с одной камеры на страницу своего сайта, я задаюсь вопросом — а может ли злоумышленник подобрать ссылку и получить поток с других камер?

А так хороший сервис, отзывчивая поддержка, радует что серверная часть есть по Debian. Но слишком уж «просто», хотя может в этом фишка сервиса =)

Конечно, не совсем вопросы по теме «облаков», но все же:

1) Таких запросов пока еще не было. Не совсем понятно, зачем переворачивать картинку с камеры. Тем не менее в приложении для Windows данная функция реализована. На сайте её нет, так как не ясно, поддерживает ли её Flash. По моему нет. А это значит, что необходимо перекодировать видео в перевернутом виде, что может быть несколько накладно.

2) На платном аккаунте доступна функция передачи прав. Создайте учетные записи людям, кто также должен получить доступ к камерам и передайте им права на ваш сервер. Передавать один аккаунт для множественного доступа не безопасно.

3) Скоро мы запустим тарификацию по одной камере, что позволит гибко настраивать услуги.

4) А здесь вы правы. К сожалению, у нас нет сейчас функции открытия доступа к одной камере, а только ко всему видеосерверу. Мы исправим этот недостаток при переходе на тарификацию по одной камере. А пока мы рекомендуем открытую камеру подключать к отдельному видеосерверу.

И спасибо за хороший отзыв! Мы будем расширять количество функций. Но в то же время постараемся чтобы они были понятными и простыми. Ну и, конечно, откроем API, чтобы Ivideon можно было использовать в других проектах, добавляя нужные функции.

1) Таких запросов пока еще не было. Не совсем понятно, зачем переворачивать картинку с камеры. Тем не менее в приложении для Windows данная функция реализована. На сайте её нет, так как не ясно, поддерживает ли её Flash. По моему нет. А это значит, что необходимо перекодировать видео в перевернутом виде, что может быть несколько накладно.

2) На платном аккаунте доступна функция передачи прав. Создайте учетные записи людям, кто также должен получить доступ к камерам и передайте им права на ваш сервер. Передавать один аккаунт для множественного доступа не безопасно.

3) Скоро мы запустим тарификацию по одной камере, что позволит гибко настраивать услуги.

4) А здесь вы правы. К сожалению, у нас нет сейчас функции открытия доступа к одной камере, а только ко всему видеосерверу. Мы исправим этот недостаток при переходе на тарификацию по одной камере. А пока мы рекомендуем открытую камеру подключать к отдельному видеосерверу.

И спасибо за хороший отзыв! Мы будем расширять количество функций. Но в то же время постараемся чтобы они были понятными и простыми. Ну и, конечно, откроем API, чтобы Ivideon можно было использовать в других проектах, добавляя нужные функции.

1. Как раз необходимо декодировать повернутое изображение, а не флешом это реализовывать. Полезно это, когда необходимо видеть проходы между длинными рядами стеллажей на складе. Берем камеру, почти все они сейчас широкоформатные, и поворачиваем на 90*. В дорогих камерах поворот картинки заложен в прошивку самой камеры (Axis на пример), но в дешевых (Ubiquity) такого нет, по-этому функционал востребованный на мой взгляд.

2. Я как раз ожидал, что можно будет завести группы, а по ним уже раскидать людей, и каждой группе дать доступ к определенным камерам. Но увы, только целиком весь сервер.

По теме облаков:

1. Каков Объем архива, на тарифе «Дай 5 + архив»? В каких единицах исчисление для клиента? Объем занятого места в Гб, или дни/качество?

2. Можно ли будет настроить выгрузку архива с локального сервера в облако? На пример время выгрузки (ночью, что бы канал не забивать), или qos для камер по-отдельности?

2. Я как раз ожидал, что можно будет завести группы, а по ним уже раскидать людей, и каждой группе дать доступ к определенным камерам. Но увы, только целиком весь сервер.

По теме облаков:

1. Каков Объем архива, на тарифе «Дай 5 + архив»? В каких единицах исчисление для клиента? Объем занятого места в Гб, или дни/качество?

2. Можно ли будет настроить выгрузку архива с локального сервера в облако? На пример время выгрузки (ночью, что бы канал не забивать), или qos для камер по-отдельности?

1. Дело в том, что при декодировании и кодировании ухудшается качество изображения. Поэтому очень хотелось этого избежать. Мы очень стараемся предоставлять наилучшее изображение и поэтому думаем как избежать данной операции. Особенно актуально это для камер, которые поддерживают облако Ivideon прямо в прошивке.

2. Сделаем. Очень нам не хватает управления услугами и правами по камерам. Новая версия платформы, которая это поддерживает, сейчас в разработке. Надеемся, что сумеем её запустить к середине или к концу сентября.

Для каждой из камер в облаке мы предлагаем минимум неделю хранения. То есть, вам должны выдаваться записи не менее чем за неделю. Ограничений на количество гигабайт нет. Стараемся, чтобы тарифы были понятными и честными.

Выгрузка архива в облако по ночам перечеркивает смысл удаленного хранения. Сохранность записи в случае проникновения злоумышленника. То есть если ваш локальный компьютер унесут днем, то записи вы потеряете (если синхронизация по ночам).

Настройку битрейта для удаленной записи по камерам можно сделать в случае, если вы используете камеры с поддержкой Ivideon на борту. В том числе там доступны настройки зон детекции, расписание записи и т.д. В будущем мы планируем добавить такую возможность и для Desktop версии Ivideon Server. Вы сможете настраивать параметры потока для удаленной записи, включая FPS и битрейт. Так как в большинстве случаев живое видео 25 кадров в секунду не требуется.

2. Сделаем. Очень нам не хватает управления услугами и правами по камерам. Новая версия платформы, которая это поддерживает, сейчас в разработке. Надеемся, что сумеем её запустить к середине или к концу сентября.

Для каждой из камер в облаке мы предлагаем минимум неделю хранения. То есть, вам должны выдаваться записи не менее чем за неделю. Ограничений на количество гигабайт нет. Стараемся, чтобы тарифы были понятными и честными.

Выгрузка архива в облако по ночам перечеркивает смысл удаленного хранения. Сохранность записи в случае проникновения злоумышленника. То есть если ваш локальный компьютер унесут днем, то записи вы потеряете (если синхронизация по ночам).

Настройку битрейта для удаленной записи по камерам можно сделать в случае, если вы используете камеры с поддержкой Ivideon на борту. В том числе там доступны настройки зон детекции, расписание записи и т.д. В будущем мы планируем добавить такую возможность и для Desktop версии Ivideon Server. Вы сможете настраивать параметры потока для удаленной записи, включая FPS и битрейт. Так как в большинстве случаев живое видео 25 кадров в секунду не требуется.

Работаю в компании Де Ново. Продаём IaaS облако на базе VMware vCloud Director. Являюсь одним из старших администраторов облака. Могу ответить практически на все вопросы связанные с платформой vCloud.

Работаю в локальном представительстве Microsoft, фокусируюсь на платформе Windows Azure. Общаюсь и консультирую стартапы и компании, разрабатывающие SaaS-решения, мобильные приложения или другие облачные ситсемы, в частности на платформе Windows Azure. Рада буду ответить на вопросы про Windows Azure.

Совершенно ничего не знаю про azure.

Распишите какие аналоги есть в azure сервисам от amazon,

Ses(отправка почты)

rds(sql реляционные бд, mysql, mssql)

ec2(vps масштабируемый)

s3(хранилище файлов)

elb( http load balancer, может и не только http, точно не знаю)

и др

Распишите какие аналоги есть в azure сервисам от amazon,

Ses(отправка почты)

rds(sql реляционные бд, mysql, mssql)

ec2(vps масштабируемый)

s3(хранилище файлов)

elb( http load balancer, может и не только http, точно не знаю)

и др

Да, конечно. Windows Azure и Amazon — это публиичные облака. Windows Azure до недавнего времени был ориентированным на PaaS (фактически Windows Azure существует с 2008 года публично), теперь есть полноценная поддержка IaaS. С Amazon, наверное, скорее происходит наоборот движение :)

Если кратко сравить, то в Windows Azure есть следующее (основное):

Хранение

NoSQL Windows Azure Tables (SimpleDB), так же поддерживается, например, MongoDB ()

SQL Database — реляционная база данных (что-то вроде Database as a Service, DaaS), MSSQL, MySQL так же поддерживается

Windows Azure BLOB, Drive — это хранение файлов (S3, EBS)

Кэширование

Content Delivery Network (CND) — распределннная сеть кэширования контента (Amazon CloudFront)

Windows Azure Caching — распределенный кэш, memcached совместимый (Amazon ElasticCache)

Сеть

Windows Azure Virtual Network, Windows Azure Connect — Virtual Private Cloud, Direct Connect

Сообщения

Windows Azure Queue, Service Bus — очереди, сообщения, pub\sub и т.п. (Simple Queue Service, Simple Notification Service)

Управление учетными данными

Windows Azure Active Directory — Identity & Access Management

Мультимедиа\вещание

Windows Azure Media Services — потоковая передача, кодирвоание, защита и т.п. (помню, что Amazon совместно с кем-то тоже сервис мультимедиа анонсировал не так давно)

Другое

Hadoop on Windows Azure, Windows Azure HPC — это BigData и параллельные вычисления (Elastic MapReduce, HPC Cluster)

SES (Simple Notification Service) — в Windows Azure отправку почты обеспечивают сервисы Парнеров, например, SendGrid

В Windows Azure балансировка поддерживается, называется, Load Balancer, можно внедрить свою логику. Есть, правда, небольшое отличие в том, что поддерживается балансировка на данный момент для внешних адресов (сервисы, выставленные наружу)

Так же Windows Azure поддерживает IaaS: Windows и Linux

Open Source

Linux (SUSE, Ubuntu, CentOS), PHP, Node.js, Eclipse, Java, Ruby, Python и т.п.

Сравнение, конечно, условное :) Windows Azure может рассматриваться для очень многих задач и SaaS-решений.

Если кратко сравить, то в Windows Azure есть следующее (основное):

Хранение

NoSQL Windows Azure Tables (SimpleDB), так же поддерживается, например, MongoDB ()

SQL Database — реляционная база данных (что-то вроде Database as a Service, DaaS), MSSQL, MySQL так же поддерживается

Windows Azure BLOB, Drive — это хранение файлов (S3, EBS)

Кэширование

Content Delivery Network (CND) — распределннная сеть кэширования контента (Amazon CloudFront)

Windows Azure Caching — распределенный кэш, memcached совместимый (Amazon ElasticCache)

Сеть

Windows Azure Virtual Network, Windows Azure Connect — Virtual Private Cloud, Direct Connect

Сообщения

Windows Azure Queue, Service Bus — очереди, сообщения, pub\sub и т.п. (Simple Queue Service, Simple Notification Service)

Управление учетными данными

Windows Azure Active Directory — Identity & Access Management

Мультимедиа\вещание

Windows Azure Media Services — потоковая передача, кодирвоание, защита и т.п. (помню, что Amazon совместно с кем-то тоже сервис мультимедиа анонсировал не так давно)

Другое

Hadoop on Windows Azure, Windows Azure HPC — это BigData и параллельные вычисления (Elastic MapReduce, HPC Cluster)

SES (Simple Notification Service) — в Windows Azure отправку почты обеспечивают сервисы Парнеров, например, SendGrid

В Windows Azure балансировка поддерживается, называется, Load Balancer, можно внедрить свою логику. Есть, правда, небольшое отличие в том, что поддерживается балансировка на данный момент для внешних адресов (сервисы, выставленные наружу)

Так же Windows Azure поддерживает IaaS: Windows и Linux

Open Source

Linux (SUSE, Ubuntu, CentOS), PHP, Node.js, Eclipse, Java, Ruby, Python и т.п.

Сравнение, конечно, условное :) Windows Azure может рассматриваться для очень многих задач и SaaS-решений.

Архитектор первой версии облака Скалакси, ныне же просто генеральный директор.

Основатель проекта ITI в Финляндии. Предоставляю решения на основе публичных и частных облаков с использованием продукции компании 2X Software Ltd. Являюсь представителем этой компании на территории Финляндии, а также работаю инженером в технической поддержке 2Х. С удовольствием отвечу на любые вопросы касающиеся нашего программного обеспечения и облачным решениям на его основе. И кстати, через пару недель начну знакомить хабрапользователей с продукцией этой компании в корпоративном блоге 2X Software.

Работаю в СерверСнабе. Занимаюсь архитектурой аппаратного облака BitFabric и работающим поверх него с 2008 г частным облаком TrueVDS — публичным хостингом виртуальных машин Xen PV/Xen HVM. Главным образом, используется Xen 4 и Linux с собственными разработками.

Основная специализация: автоматизация управления оборудованием, отказоусточивость сети хранения данных и вычислительной сети, QoS дисков и вычислительных ресурсов, консультации по оптимальной настройке виртуальных машин для партнерских и клиентских проектов.

По отказоустойчивости можно сказать, достигнуты неплохие успехи — для той части пользователей, которые сталкивались с неработоспособностью в нашей зоне ответственности, за последние пару лет средний простой составил около 30 минут за 1 год.

Основная специализация: автоматизация управления оборудованием, отказоусточивость сети хранения данных и вычислительной сети, QoS дисков и вычислительных ресурсов, консультации по оптимальной настройке виртуальных машин для партнерских и клиентских проектов.

По отказоустойчивости можно сказать, достигнуты неплохие успехи — для той части пользователей, которые сталкивались с неработоспособностью в нашей зоне ответственности, за последние пару лет средний простой составил около 30 минут за 1 год.

Truevds.ru все таки смигрировал в облако с обычных машин?

Расскажите структуру, возвращаете наработки в xen?

Расскажите структуру, возвращаете наработки в xen?

Если под облаком понимается XCP, то нет, на XCP мы не переходили. А по поводу «облака», у нас с самого начала была похожая своя реализация из xen + xend и собственного софта для работы с пулами серверов и SAN.

Раньше в XCP было слишком много багов для того, чтобы брать его в production. Сейчас XCP как отчуждаемый продукт, конечно, намного универсальнее нашего, но именно в силу своей ориентированности на универсальность он нам не подходит и сейчас. У нас имеется достаточно управляемая инфраструктура, и эта управляемость также активно используется в организации работы виртуальных машин. Например, сегментирование SAN на зоны независимого отказа, назначение серверов кластера на конкретные профили задач и управление загрузкой этих серверов, пул серверов горячего резерва — все это доступно и используется в системе управления виртуальными машинами.

Таким образом, у нас нет многих вещей, которые есть в XCP, но нам не нужны, и при этом используется более низкоуровневая информация о доступном оборудовании, чем в XCP и используется много специфичных для нашей архитектуры вещей, что дает нам более простое и надежное управление облаком.

Возвращать в xen в этой ситуации даже особо нечего — в XCP без существенных изменений и без использования такого же API для работы с SAN, наши наработки не применить. Для xen hypervisor пока существенного ничего не делали. Была попытка когда-то live snapshot в xend включить, но похоже, у коммюнити основной интерес сейчас в XCP.

Раньше в XCP было слишком много багов для того, чтобы брать его в production. Сейчас XCP как отчуждаемый продукт, конечно, намного универсальнее нашего, но именно в силу своей ориентированности на универсальность он нам не подходит и сейчас. У нас имеется достаточно управляемая инфраструктура, и эта управляемость также активно используется в организации работы виртуальных машин. Например, сегментирование SAN на зоны независимого отказа, назначение серверов кластера на конкретные профили задач и управление загрузкой этих серверов, пул серверов горячего резерва — все это доступно и используется в системе управления виртуальными машинами.

Таким образом, у нас нет многих вещей, которые есть в XCP, но нам не нужны, и при этом используется более низкоуровневая информация о доступном оборудовании, чем в XCP и используется много специфичных для нашей архитектуры вещей, что дает нам более простое и надежное управление облаком.

Возвращать в xen в этой ситуации даже особо нечего — в XCP без существенных изменений и без использования такого же API для работы с SAN, наши наработки не применить. Для xen hypervisor пока существенного ничего не делали. Была попытка когда-то live snapshot в xend включить, но похоже, у коммюнити основной интерес сейчас в XCP.

Круто, давно пользовался вашими впсками, очень стабильно все работало по сравнению с русскими облаками, по моему один мелкий даунтайм за полтора года был, о котором предупредили.

1)Почему не сделаете возможность легко изменять параметры виртуалки из админ панели(или уже сделали)?

2)Черт подери почему так дорого до сих пор, память очень сильно подешевела, было бы неплохо поднять её в 2-4 раза при тех же ценах на виртуалки.

1)Почему не сделаете возможность легко изменять параметры виртуалки из админ панели(или уже сделали)?

2)Черт подери почему так дорого до сих пор, память очень сильно подешевела, было бы неплохо поднять её в 2-4 раза при тех же ценах на виртуалки.

1) Легко пока не сделали. По ряду вещей, привлекательных с точки зрения удобства пользователей, пиара и повышения продаж, мы себя сознательно ограничиваем. Мы понимаем, что не сможем одновременно качественно реализовать и обеспечить это качество, занимаясь параллельно большим числом в чем-то даже протиповоложных направлений. И при этом безболезненно переварить слишком быстрый рост числа пользователей нам будет тоже невозможно.

В чем-то это даже постоянный источник внутреннего неудовольствия, когда видишь, что у конкурентов внедрено то и это. Думаешь, что могли сделать так же давным давно за неделю, но потом пару лет расхлебывали бы возникающие каждый месяц связанные с этим проблемы, простои серверов и потери данных пользователей. Латали бы на скорую руку с очередными производными проблемами. Кроме минуса в карму из-за пренебрежения интересами пользователей и минуса в бюджет из-за больших затрат на компенсацию за нарушение SLA, имели бы постоянный стресс и отнимали время от доведения до ума базовых, инфраструктурных вещей.

Слишком много вещей быстро хорошо не сделать. Либо для этого нужны чрезмерно большие финансовые затраты и какой-то другой способ организации внутренних процессов.

2) Удешевление планок памяти в несколько раз, к сожалению, не приводит к удешевлению услуги на столько же. Существующие процессоры и чипсеты не способны поддерживать в 4 раза больше памяти, новые с такими возможностями стоят дороже, и их замента также является существенными затратами.

Примерно год назад мы как раз ввели новые тарифы с увеличенным в два раза объемом памяти. По приведенным выше причинам увеличить память еще в 2-4 раза на стандартных тарифах в ближайшее время малореально, хотя это бывает при разовых акциях. И не могу согласиться полностью по поводу дороговизны — при оплате за год цены у нас меньше, чем у Linode, и даже достаточно близки к эталону дешевизны — Hetzner. А с школьниками или с виртуализацией с оверселлингом памяти конкурировать нереально — они всегда победят :)

В чем-то это даже постоянный источник внутреннего неудовольствия, когда видишь, что у конкурентов внедрено то и это. Думаешь, что могли сделать так же давным давно за неделю, но потом пару лет расхлебывали бы возникающие каждый месяц связанные с этим проблемы, простои серверов и потери данных пользователей. Латали бы на скорую руку с очередными производными проблемами. Кроме минуса в карму из-за пренебрежения интересами пользователей и минуса в бюджет из-за больших затрат на компенсацию за нарушение SLA, имели бы постоянный стресс и отнимали время от доведения до ума базовых, инфраструктурных вещей.

Слишком много вещей быстро хорошо не сделать. Либо для этого нужны чрезмерно большие финансовые затраты и какой-то другой способ организации внутренних процессов.

2) Удешевление планок памяти в несколько раз, к сожалению, не приводит к удешевлению услуги на столько же. Существующие процессоры и чипсеты не способны поддерживать в 4 раза больше памяти, новые с такими возможностями стоят дороже, и их замента также является существенными затратами.

Примерно год назад мы как раз ввели новые тарифы с увеличенным в два раза объемом памяти. По приведенным выше причинам увеличить память еще в 2-4 раза на стандартных тарифах в ближайшее время малореально, хотя это бывает при разовых акциях. И не могу согласиться полностью по поводу дороговизны — при оплате за год цены у нас меньше, чем у Linode, и даже достаточно близки к эталону дешевизны — Hetzner. А с школьниками или с виртуализацией с оверселлингом памяти конкурировать нереально — они всегда победят :)

Всем привет!

Я технический директор проекта SoftСloud компании Softline

Эксперт Российской Ассоциации Облачных Вычислений в части SAAS.

Могу поотвечать на вопросы, касаемые SAAS.

Я технический директор проекта SoftСloud компании Softline

Эксперт Российской Ассоциации Облачных Вычислений в части SAAS.

Могу поотвечать на вопросы, касаемые SAAS.

а что есть в SoftСloud кроме картинок и текста?) да же кнопки купить нету) хотя помню раньше цены были x3 относительно рынка)

А сколько у вас клиентов? Такое ощущение что NULL!!!

А сколько у вас клиентов? Такое ощущение что NULL!!!

1. Софтклауд не работает напрямую с конечными потребителями, а предоставляет платформу управления через сеть партнёров. Напрмиер — Компания Active

2. Клиентов более 20K

2. Клиентов более 20K

Я недавно собрал «домашнее облако» — сервер под Xen, на которой теперь могу быстро поднимать виртуальные машины, делать снапшоты. Очень удобно для тестирования и разработки софта и автоматических инсталляторов. Минималистический вариант — никаких GUI и автоматического провиженинга, всё делается из коммандной строки.

Подробности инсталляции тут, по-английски: txlab.wordpress.com/2012/08/05/setting-up-a-development-server-with-xen-4-1-3/

Такой же подход можно использовать для co-location, когда вся железка под вашим управлением.

Подробности инсталляции тут, по-английски: txlab.wordpress.com/2012/08/05/setting-up-a-development-server-with-xen-4-1-3/

Такой же подход можно использовать для co-location, когда вся железка под вашим управлением.

Эх, где бы найти облако с ценами как у Selectel и надежностью как у Amazon.

А в какой именно ситуации цены Amazon не подходят?

Ну, сейчас на селектеле почти что dev-сервер, с небольшой нагрузкой. За всё это отдаю 150 рублей в месяц, вполне устраивает. У амазона самый дешевый micro инстанс обойдется примерно в 20$ в месяц. Free Tier пробовал, но он уже закончился.

Работаю в ЗАО «ИВК», веду проекты связанные с виртуализацией. В настоящее время заканчиваю «упаковку» ~3 тыс. VDI-машинок в одной 42U стойке. Попутно разрабатываем для людей в погонах датацентр в кунге, особенно интересной удаётся собственная конструкция блейд-шасси под требования группы 1-3.

Sign up to leave a comment.

Хабракамп про облака