Как легко понять логистическую регрессию

Machine Learning Researcher

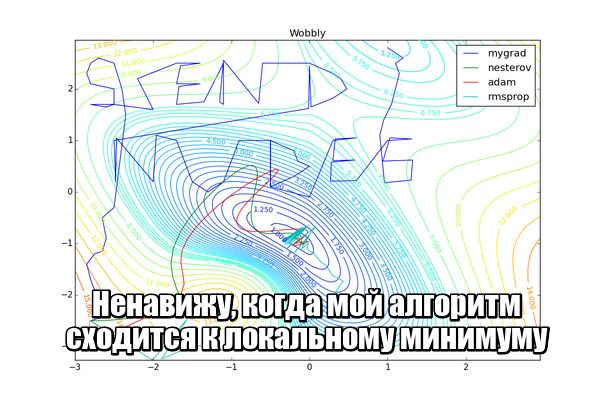

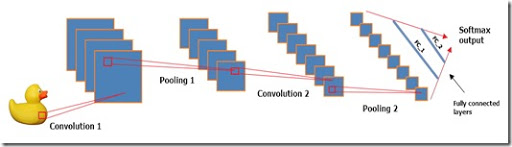

В подавляющем большинстве источников информации о нейронных сетях под «а теперь давайте обучим нашу сеть» понимается «скормим целевую функцию оптимизатору» лишь с минимальной настройкой скорости обучения. Иногда говорится, что обновлять веса сети можно не только стохастическим градиентным спуском, но безо всякого объяснения, чем же примечательны другие алгоритмы и что означают загадочные и

в их параметрах. Даже преподаватели на курсах машинного обучения зачастую не заостряют на этом внимание. Я бы хотел исправить недостаток информации в рунете о различных оптимизаторах, которые могут встретиться вам в современных пакетах машинного обучения. Надеюсь, моя статья будет полезна людям, которые хотят углубить своё понимание машинного обучения или даже изобрести что-то своё.

Под катом много картинок, в том числе анимированных gif.

Признак того, что объект не должен быть классом — если в нём всего 2 метода, и один из них — инициализация, __init__. Каждый раз видя это, подумайте: «наверное, мне нужна просто одна функция».

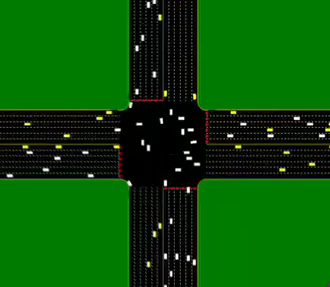

Признак того, что объект не должен быть классом — если в нём всего 2 метода, и один из них — инициализация, __init__. Каждый раз видя это, подумайте: «наверное, мне нужна просто одна функция». Питер Стоун — доцент Техасского университета в Остине, специалист по искусственному интеллекту и многоагентным системам занимается моделированием дорожного движения с учетом широкого распространения автомобилей под управлением компьютера. Стоун считает, что машины-роботы способны сделать транспортную систему намного более эффективной. “Каждым перекрёстком — говорит Стоун — должен управлять автономный интеллектуальный агент, регулирующий режим движения каждого автомобиля индивидуально, а не светофор, запрещающий или разрешающий движение всего потока”.

Питер Стоун — доцент Техасского университета в Остине, специалист по искусственному интеллекту и многоагентным системам занимается моделированием дорожного движения с учетом широкого распространения автомобилей под управлением компьютера. Стоун считает, что машины-роботы способны сделать транспортную систему намного более эффективной. “Каждым перекрёстком — говорит Стоун — должен управлять автономный интеллектуальный агент, регулирующий режим движения каждого автомобиля индивидуально, а не светофор, запрещающий или разрешающий движение всего потока”. Если менеджеру попытаться разобраться в этой области и получить конкретные бизнес-ответы, то, скорее всего, страшно заболит голова и екнет сердце от ощущения ежеминутно упускаемой выгоды.

"AlphaGo обыграл чемпиона по Go" впервые за всю историю человечества, скоро наши улицы заполонят беспилотные автомобили, распознавание лиц и голоса теперь в порядке вещей, а в квартиру к нам завтра постучатся AI-секс-куклы с грудью наивысшего размера с шампанским под мышкой и настраиваемым уровнем интенсивности и продолжительности оргазма.

Все оно так, но что делать-то прямо сейчас. Как на этом заработать в краткосрочной перспективе? Как заложить прочный фундамент на будущее?

Постараюсь дать исчерпывающие ответы на все мучающие вас вопросы, «вскрыть» подводные камни и, главное — здраво оценить риски в AI и научиться ими правильно управлять. Ведь то, что не понимаем, то и не “танцуем”.

В соавторстве с Анной Перовой

Каждый день человечество создает, использует и хранит огромные объемы данных. Каждая статья, пост в блоге или instagram, каждый лайк да и вообще каждый факт коммуникации — данные, которые, будучи обработанными становятся ценными, приносят прибыль и предостерегают от рисков того кто ими владеет и умеет извлекать соответствующую информацию.

С ростом возможностей анализа данных и осознания полезности имеющихся архивов повышается и потребность в экспертах по Data Science, машинного обучения и искусственного интеллекта (AI), способных работать с данными и создавать на их основе полезные модели, а также, системы самостоятельно обрабатывающие данные и заставляющие их работать.

Почему тем, кто набирает команды в этой сфере необходимо задуматься о новых методах рекрутинга?

Как еще в 2015 году писали на TechCrunch, по мнению Mckinsey, которые, надо признать оказались не далеко от истины, 490 000 специалистов потребуется в этой области к 2018 году.

Привет, Хабр!

В задачах машинного обучения для оценки качества моделей и сравнения различных алгоритмов используются метрики, а их выбор и анализ — непременная часть работы датасатаниста.

В этой статье мы рассмотрим некоторые критерии качества в задачах классификации, обсудим, что является важным при выборе метрики и что может пойти не так.

, где

, где  — псевдообратная матрица. Это решение наглядное, точное и короткое. Но есть проблема, которую можно решить численно. Градиентный спуск — метод численной оптимизации, который может быть использован во многих алгоритмах, где требуется найти экстремум функции — нейронные сети, SVM, k-средних, регрессии. Однако проще его воспринять в чистом виде (и проще модифицировать).

— псевдообратная матрица. Это решение наглядное, точное и короткое. Но есть проблема, которую можно решить численно. Градиентный спуск — метод численной оптимизации, который может быть использован во многих алгоритмах, где требуется найти экстремум функции — нейронные сети, SVM, k-средних, регрессии. Однако проще его воспринять в чистом виде (и проще модифицировать).