- Глава 1: использование нейросетей для распознавания рукописных цифр

- Глава 2: как работает алгоритм обратного распространения

- Глава 3:

- Глава 4: визуальное доказательство того, что нейросети способны вычислить любую функцию

- Глава 5: почему глубокие нейросети так сложно обучать?

- Глава 6:

- Послесловие: существует ли простой алгоритм для создания интеллекта?

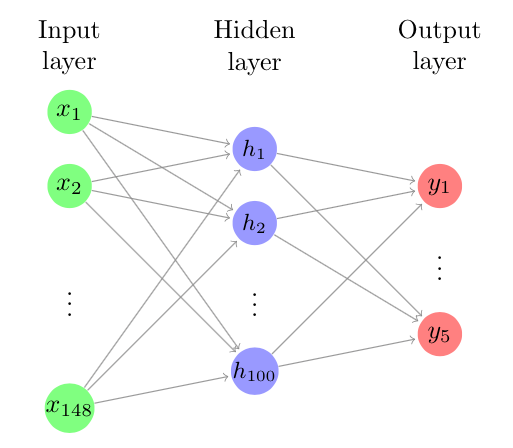

В прошлой главе мы видели, как нейросети могут самостоятельно обучаться весам и смещениям с использованием алгоритма градиентного спуска. Однако в нашем объяснении имелся пробел: мы не обсуждали подсчёт градиента функции стоимости. А это приличный пробел! В этой главе я расскажу быстрый алгоритм для вычисления подобных градиентов, известный, как обратное распространение.

Впервые алгоритм обратного распространения придумали в 1970-х, но его важность не была до конца осознана вплоть до знаменитой работы 1986 года, которую написали Дэвид Румельхарт, Джоффри Хинтон и Рональд Уильямс. В работе описано несколько нейросетей, в которых обратное распространение работает гораздо быстрее, чем в более ранних подходах к обучению, из-за чего с тех пор можно было использовать нейросеть для решения ранее неразрешимых проблем. Сегодня алгоритм обратного распространения – рабочая лошадка обучения нейросети.