Мы русифицировали Mistral и он работает лучше(по бенчмаркам) чем закрытые русскоязычные LLM. Как мы это сделали, ссылки на модели и бенчмарки - в статье.

Roleplay молодого DS

Мы русифицировали Mistral и он работает лучше(по бенчмаркам) чем закрытые русскоязычные LLM. Как мы это сделали, ссылки на модели и бенчмарки - в статье.

Вероятно лучшая опенсурс модель для Captioning, VQA, QA и прочих задач требующих ответить на вопросы опираясь на изображения. От читателя ожидается что он знает чем отличается alpaca от vicuna и почему VIT это круто.

Привет, Хабр!

Сегодня мы, команда Sber AI, расскажем про бейзлайн генерации сказок с озвучкой и картинками, который мы предложили в рамках трека по Creative AI международного соревнования для школьников Artificial Intelligence International Junior Contest (AIIJC): рассмотрим аспекты обучения conditional ruGPT-3, генерацию музыки, генерацию изображения по текстовой строке, а также обсудим некоторые проблемы, с которыми пришлось столкнуться во время обучения и дообучения моделей.

В этом посте мы хотим разобрать (и разобраться сами), как можно использовать и объединять генеративные (и не только) модели для решения одной большой задачи — генерации контента. Мы подобрали большое количество материалов про каждую конкретную модель, чтобы ими можно было пользоваться сразу.

Данная статья представляет собой вольный пересказ https://arxiv.org/abs/2103.05247

Аннотация

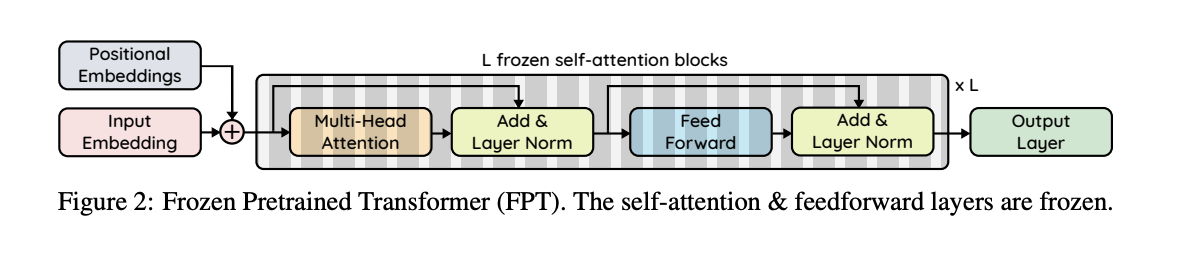

Данная статья является разбором свежей статьи от исследователей из университета Беркли "Pretrained Transformers As Universal Computation Engines". В статье решается задача дообучения трансформеров на новые виды информации, такие как: изображения, битовые операции, математические выражения и последовательности белков.

Архитектура трансформер стала основой существующих успехов глубокого обучения, породив череду моделей обработки естественного языка таких как GPT, BERT или T5, которые сейчас представлены в зоопарке русскоязычных моделей сбера. Впоследствии архитектура трансформера стала применяться и в задачах задачах компьютерного зрения (CLIP, ImageGPT, Dall·E).

Идея данной статьи происходит из того, что гигантские языковые модели обучаются на больших массивах данных, в том числе, Википедии, Reddit и т. д. Поэтому модели обладают широкими фактологическим знаниями, например, о годах рождения известных личностей.

Дисклеймер: автор хотел повеселить себя вечером и не придумал ничего лучше, как:

В качестве корпуса для "обучения" цепи я буду использовать текст песен группы Кис Кис.

Пикча выше иллюстрирует то как работает цепь Маркова. А вот неплохая статья.