Comments 56

Пиксель-арт прекрасен

Кажется, я знаю, как буду иллюстрировать корпоративную Wiki

Опять та же фигня. Не вижу где посмотреть видеокарту

Гугл в зависимости от загруженности может разные карты подсовывать. Можно еще оформить Colab Pro подписку, тогда будет карты помощнее давать.

Мы точно про один и тот же блокнот?

https://colab.research.google.com/drive/1MDin_3_XE21f7XcnFw_alc1YZIuKkD15#scrollTo=qQOvOhnKQ-Tu

https://colab.research.google.com/drive/1B6FLBZmHCSZmCI-kmQRzPqy0PeicO0PG

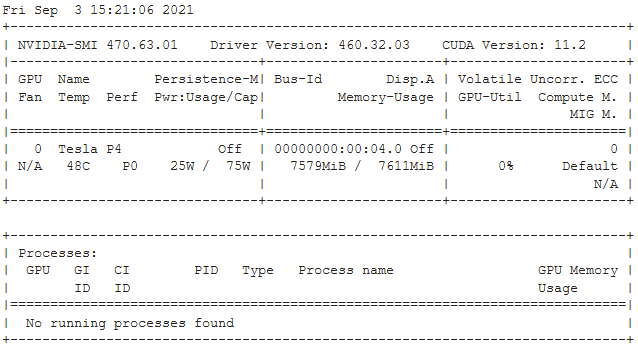

Добавьте в вашем блокноте ячейку и выполните в ней !nvidia-smi, покажет текущую видеокарту.

Отдает всегда Tesla K80

Если все время k80 дает, то надо подождать, значит нет свободных. Вообще должен в итоге хотя бы P4 выдать.

Либо же раскошелиться на подписку.

Видимо нет. Я раз 20 пересоздавал машину.

Проблема в том, что синтез пиксель арта здесь основан на diffvg, который придётся собирать из исходников на локальной машине, что не вполне тривиально.

Если у вас что-то вроде Debian или Ubuntu с установленными драйверами NVIDIA, CUDA Toolkit 10.2, и Python 3.7+, то могу написать небольшой гайд, как запустить эту нейронку локально. А вот под винду так даже и не соображу, что и как настраивать.

stackoverflow.com/questions/60240863/i-am-from-pakistan-can-i-buy-google-colab-pro-for-experiments

Так.

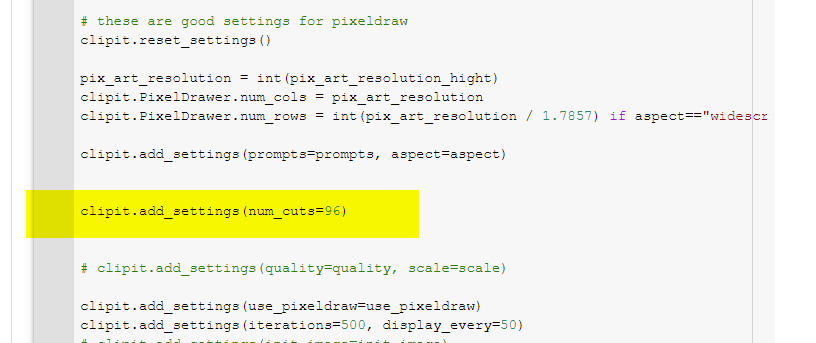

Oops: runtime error: CUDA out of memory. Tried to allocate 48.00 MiB (GPU 0; 7.43 GiB total capacity; 5.83 GiB already allocated; 32.81 MiB free; 5.95 GiB reserved in total by PyTorch) Try reducing --num-cuts to save memory

Сколько ему надо ресурсов? Никак зарезать нельзя?

В Colab'е очень часто выделяют меньше VRAM, чем есть на GPU. Издержки облака…

Можете попробовать в ячейке "III. Generate images" нажать на «Show code» и там, где задаются параметры, скажем после строчки

clipit.add_settings(use_pixeldraw=use_pixeldraw)clipit.add_settings(num_cuts=9)Отлично, спасибо. Жаль опять Tesla K80 теперь только выпадает. На ней этот код вообще почему-то не взлетает. Даже медленно.

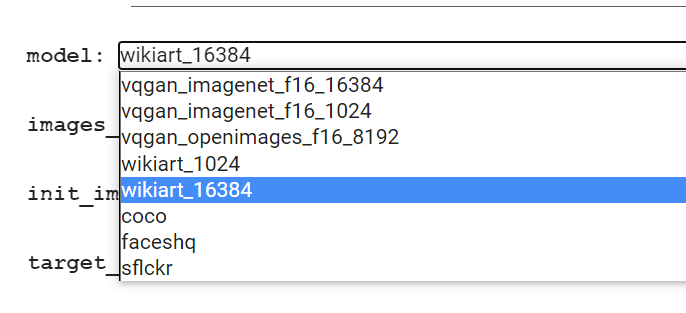

Для этого можно, к примеру, воспользоваться этим Colab'ом. Там после установки всего нужного и перезапуска runtime'а:

1. Устанавливаем scale в 1.

2. Снимаем галочку use_pixeldraw (теперь у нас вместо diffvg будет vqgan).

3. Показать код (Show code) в этой ячейке и там:

clipit.add_settings(prompts=prompts, aspect=aspect)clipit.add_settings(prompts=prompts)clipit.add_settings(size=(256,256))

clipit.add_settings(num_cuts=9)

Всё, можно запускать, не забывая указывать в запросе тип рендеринга (скажем, #Unreal Engine или #pixelart):

clipit.add_settings(quality="better", scale=scale)Спасибо. Я уже думаю, что проще на своей RTX 2060S завести.

А из PyPi не получится более корректную версию PyTorch вытащить в процессе сетапа?

clipit.add_settings(num_cuts=96)

Добавил в код:

import tensorflow as tf

device_name = tf.test.gpu_device_name()

print(device_name)Выдал:

/device:GPU:0

Большое спасибо за статью! И за ссылки на блокноты отдельно. Вроде бы только недавно синтез изображения по текстовой подсказке был чем-то недосягаемым. Теперь же все делается в 2 клика. Страшно представить, к чему это придет через 10 лет. Синтез фильма по краткому описанию сюжета?

Вот например

Модель «не понимает», что в пещере деревья обычно не растут, да и пожелание сделать планировку пещеры в форме указанного музыкального инструмента реализовать не удалось даже после нескольких модификаций текста запроса.

В общем, разного рода фоновые вещи. Людей, особенно крупным планом, оно обрабатывает так себе (в pixelart-варианте это не слишком видно, но если делать FullHD, то ужас-ужас).

И совсем паршиво обрабатываются мифические животные, например гарпии, грифоны, драконы или (особенно) русалки. Сгенерировать нормальный русалочий хвост в FullHD так и не удалось. Похоже, нужно тюнить модель или использовать её как feature extractor, набросив сверху два дополнительных слоя, чтобы генерировать мифических животных.

Но вот, действительно, точного выполнения от них не получается. Лица в принципе генерируются, но страшненькие. Вот картины довольно неплохо заходят.

Не силён в ноутбуках... Что-то у меня упорно не находит модуль pixeldrawer :(

Ну, и если запускать локально, то там намного больше возможностей и параметров для настройки. Я использовал такой вариант запуска:

python generate.py -p "the door into autumn #pixelart" -i 600 -qua "normal" --num_cuts 15 --output "result/output" -s 416 224 -lr 0.1 --save_every 10 --pixelize_every 50 --out_unpix "unpix/output"

Вин Дизель в космосе

Джим Керри

Так что можно взять «выхлоп» CLIP, уменьшить так, чтобы каждый пиксельный кадратик изображения занимал ровно 1 реальный пиксель, после чего увеличить с помощью этой нейронки.

Сделай себе книгу для изучения языка с нейросетевыми иллюстрациями