Комментарии 137

Тот забавный случай, когда болтаешься в топе хабра не постя туда статьи, практически не оставляя комментарии и даже сравнительно редко бывая.

Было бы очень интересно поглядеть не на линейный, а на плоскостной график распределения. Наверняка там есть забавные «островки стабильности».

И спорные темы вы какие-то уж очень элитарные выбрали. А как же классические:

— DIY ИИ в три клика мышкой/нейросети это и близко не ИИ,

— как давить пиратство/достали копирасты?

Хорошее замечание — могу, как причастный, подтвердить, что электротранспорт и ВИЭ обычно весьма бурныц интерес вызывают. :)

Но тут замечание: эмоции вызывают именно эмоциональные статьи (привет, коллега sith! :) — если же речь идёт о принципах, то на авторе чаще всего отражается положительно. Правда, ещё оценки зависят от стиля комментирования автора, да. :)))

Могу сказать, что мои статьи об электромобилях вызывали много интереса, просмотров и повышение кармы. Общий же мой итог — следствие пары осознанных экспериментов и поднятия пары очень бурных (но, ИМХО, важных для сообщества) тем.

Самые положительно оцененные сообщения:…

Самые отрицательно оцененные сообщения: ...

Возможно стоит сделать примечание, что это сообщения с максимумом плюсов и с максимумом минусов. Итоговая оценка каждого из сообщений все-таки немного другая.

Вопрос растет оттуда, что мне как автору кажется хорошим тоном отвечать на все содержательные комментарии к своим статьям, но я вижу, что много кто (особенно часто пишущие авторы) просто постят тексты и дальше не мониторят комментарии.

Соответстенно, в идеале было бы круто получить даже не то, сколько комментариев первого уровня получают ответы, а сколько из них получают ответы от автора соответствующей статьи.

Ну надо ещё учитывать что далеко не все подобные сообщения требуют ответа. Я например плюсики ставить не могу, но если статья понравилась пытаюсь хотя бы положительный комментарий оставить. А такое пожалуй парсером не исключишь и поэтому и статистика не особо получится.

Мое личное мнение насчет «кармы»: владельцы сайта поставили цель сделать _саморегулирующуюся_ систему, способную работать автономно с минимальным вмешательством модераторов. И в принципе, это работает. Может «карма» неидеальна, но без неё было бы еще хуже. Как альтернатива, может быть какой-то другой механизм, например «закрытый клуб» и приглашение только по инвайтам и прочее, но это было бы имхо еще сложнее и запутаннее.

Имхо если тупо отменить карму и все ограничения, сайт превратится в нечто среднее между pukabu и yaplakal — статей про ИТ тут точно больше не станет.

Выкладывание статей здесь абсолютно бесплатно, любой может это сделать при желании, так что странно читать про «закрытый» клуб. Любой, имеющий отношение к ИТ, может вот прямо сейчас сесть и написать для всех что-то полезное, почему нет.

Имхо сложность написания статей сильно преувеличена. Да любой более-менее подробный туториал по настройке какого-нибудь mqtt-сервера легко наберет +10-15 баллов и +2-4 балла в карму, написать это за 2-3 часа можно, и кому-нибудь он да пригодится потом.

Насчет токсичности не согласен. Чтобы статью реально заминусовали — не знаю даже, имхо надо либо совсем бред написать, либо что-то совсем не в тему. Любая технически грамотная статья без явных ошибок определенное число плюсов наберет.

Все же Хабр расчитан на ИТ-специалистов, и любой человек, работающий или учащийся в этой области, имхо вполне в состоянии написать что-то полезное для других в той области где он разбирается, если захочет. Я не считаю это таким уж непроходимым «входным барьером».

Я например пишу статьи для фана, просто потому что это интересно поделиться чем-то любопытным с другими. Однажды по приколу написал статью по работе со звуком в журнал «Музыкальный руководитель детского сада» (у меня его жена выписывает). Опубликовали, и даже заплатили что-то, уже не помню сколько. Написал статью о декодировании радиолюбительских сигналов на Raspberry Pi в немецкий Funkamateur, поблагодарили, правда не знаю опубликовали или нет (я на английском писал, немецкий у меня так себе). Так что никогда не заморачивался вопросом, сколько у меня тут «кармы» и что она дает…

Тематика мобильных приложений кстати, довольно популярна. Я на iPhone вычислял миллион знаков числа Пи :) Просто было интересно, сработает или нет.

Вот вам идея навскидку, по вашему профилю — туториал по созданию игры «крестики нолики» для 2х Android-телефонов :) Тут и UI, и соединение по Bluetooth или WiFi, и работа с сокетами, вполне нормальный туториал для новичков будет.

Насчет токсичности не согласен. Чтобы статью реально заминусовали — не знаю даже, имхо надо либо совсем бред написать, либо что-то совсем не в тему. Любая технически грамотная статья без явных ошибок определенное число плюсов наберет.Не любая. Дискуссионная статья может не набрать. Нпр., написал статью про игрового бота, где предложил определение ИИ. Восприняли положительно 22/-0, просмотров 16.7К. Попробовал развить это определение в последующей статье — заминусовали статью и карма пострадала. Убрал. Переделал. Опять в минусах. Не хочет большинство философию ИИ обсуждать — только меньшинство дало интересные комменты. Пусть и критические — тема-то сложная. Добавил предупреждение:

Судя по рекордно высокому отношению количества молчаливо недовольных к количеству комментаторов, которым есть что возразить, многим читателям неочевидно, что:

1) Это чисто теоретическая дискуссионная статья. Здесь не будет практических рекомендаций по выбору инструментов для майнинга криптовалюты или сборке мультивибратора, чтобы мигать двумя лампочками.

2) Это не научно-популярная статья. Здесь не будет объяснения для чайника принципа работы машины Тьюринга на примере спичечных коробков.

3) Хорошо подумайте, прежде чем продолжить чтение! Привлекает ли вас поза агрессивного дилетантизма: минусую всё, что не понимаю?

Заранее благодарен всем, кто решит не читать эту статью!

Не помогло. Пришлось убрать.

Всего у меня не один десяток статей — а больше полутора :) И все с небольшой, но положительной оценкой. По рейтингу и просмотрам вижу, что наиболее успешны простые темы. Автор выше сказал:

Я например пишу статьи для фана, просто потому что это интересно поделиться чем-то любопытным с другими.

И я пишу для фана, просто потому что это интересно и полезно обсудить что-то актуальное, спорное и неочевидное. К сожалению, не все хотят напрягаться и что-то обсуждать. Ну и прошли бы стороной, но нет — имея способы воздействия (рейтинг и карму) незаинтересованное большинство устанавливает свои порядки. Что не мешает потом жаловаться на снижение уровня публикаций. Совершенно очевидно, что большинство будет не радо, если на Хабре будут появляться только материалы для чайников.

Нужно учитывать, что статьи на узкие темы интересны не многим. На одну тему — одним, на другую — другим, но на всякую тему складывается каждый раз свое разное большинство, которому данная тема не интересна. Такое большинство легко заминусует. И как быть? Прежде всего как быть большинству, каждому из которого интересны свои узкие темы?

Зашёл и глянул статью. Я так понимаю что речь идёт вот об этом :

Итак, предложим следующее определение: к ИИ относятся задачи, которые компьютер решает заметно хуже человека.

И если честно я даже не знаю с чего начать обьяснять почему в моём понимании это даже близко нельзя рассматривать как адекватное определение ИИ. Например потому что человек делает многие вещи лучше компьютера, но при этом с интеллектом они не связаны. Или есть ИИ, которые делают определённые вещи лучше человека, но при этом это всё ещё ИИ.

А если посмотреть на ваше "ПРЕДУПРЕЖДЕНИЕ", то на мой взгляд оно своей формой и содержанием просто просит поставить минус. Особенно в сочетании с вышеприведённым определением или чем-то в подобном роде.

Я так понимаю что речь идёт вот об этомДа. Знаете определение лучше? Какое?

потому что человек делает многие вещи лучше компьютера, но при этом с интеллектом они не связаны.Какие вещи конкретно? Ботинки шнурует?

ИИ, которые делают определённые вещи лучше человека, но при этом это всё ещё ИИВ указанной статье я привел пример, что сортирует ЭВМ лучше человека, и сортировка пузырьком не ИИ.

А если посмотреть на ваше «ПРЕДУПРЕЖДЕНИЕ», то на мой взгляд оно своей формой и содержанием просто просит поставить минус.Почему? На бутылках с уксусом и с серной кислотой пишут «опасно» и никто

Да. Знаете определение лучше? Какое?

Определение на википедии не идеально, но на мой взгляд однозначно лучше вашего.

Какие вещи конкретно? Ботинки шнурует?

Возьмите например примеры инстинктивного поведения или рефлексы.

Почему? На бутылках с уксусом и с серной кислотой пишут «опасно» и никто не ставит за это минус не возмущается ;)

Ну например потому что на бутылках с серной кислотой не встречаются слова "чайники" и "агрессивные дилетанты".

Определение на википедии не идеально, но на мой взгляд однозначно лучше вашего.Чем оно лучше Вы не сказали.

Возьмите например примеры инстинктивного поведения или рефлексы.Взял и что дальше?

Ну например потому что на бутылках с серной кислотой не встречаются слова «чайники» и «агрессивные дилетанты».В инструкциях по ТБ встречаются более сильные слова.

Что Вы здесь хотите доказать? Что первая статья, не получившая ни одного минуса, должна была быть заминусована? Что не надо на Хабре писать дискуссионные статьи? Что нельзя использовать слова «дилетанты» и «чайники»?

Чем оно лучше Вы не сказали.

Я вам написал чем меня не устраивает ваше определение.

В инструкциях по ТБ встречаются более сильные слова.

Я не знаю что вы конкретно имеете ввиду под "сильными словами", но "чайник" и "агрессивный дилетант" это на мой взгляд уже попытка оскорбить людей. И не думаю что что-то подобное встречается в ТБ.

Что Вы здесь хотите доказать?

Я ничего не пытаюсь доказать. Я вам отвечаю на ваш пост и пытаюсь ответить на вопросы, которые вы там задаёте. И обьяснить почему с моей точки зрения ваши статьи/посты получали минусы и/или не получали плюсы.

П.С. И да, слова "дилетанты" и "чайники" на мой взгляд лучше не употреблять. Как минимум когда обращаешься к широкой аудитории.

Я вам написал чем меня не устраивает ваше определение.Очень убедительно! С тем же неуспехом можно заявить, что не устраивает всемирное тяготение и теорема Пифагора ;)

Я не знаю что вы кокретно имеете ввиду под «сильными словами», но «чайник» и «агрессивный дилетант» это на мой взгляд уже попытка оскорбить людей.Что тут оскорбительного? Набрал в гугле «для чайников» и первой строчкой получил:

Все книги серии Для чайников в интернет магазине ...Хотите скзать что наши издательства оскорбляют читателей? ;) Нпр., я никогда не разводил пчел, поэтому если мне скажут, что как пчеловод я чайник или дилетант, то я соглашусь и не обижусь.

По памяти из ТБ:

неряхи и разгильдяи проливают кислоту на одежду. Это недопустимо, т.к. кроме порчи одежды даже капля концентрированной серной кислоты может прожечь одежду и вызвать на теле ожог

чайник — неопытный пользователь ПК— Ничего обидного, а разгильдяй и неряха — это уже яркий негатив.

Я вам отвечаю на ваш пост и пытаюсь ответить на вопросы, которые вы там задаёте.Спасибо за Вашу попытку, хотя она повлекла еще больше вопросов, но я не Вас спрашивал, а автора обсуждаемой здесь статьи.

Предположу, как минимум, публикуя спорные и субъективные суждения быть готовым, что это будет оценено минусами,

а также ещё разными вариантами «информации»

P.S. Может и на хабре есть проплаченные боты, как выявили их сеть (4-е миллиона) в Фейсбук.

Т.е. если хайп по дискуссионной статье сошёл на нет, то в большой степени вероятности, дальнейшие сообщения в ней могут быть разного кривотолка и не прочитаны аудиторией хабра, если не подписался на статью.

А, подписываются на статьи те, кому действительно интересно дальнейшее обсуждение, но уже даже глубоко заминусовать они не смогут аппонента.

При оставленных комментариях в статье, новости по сообщениям появляются в профиле пользователя, но я, например, эти темы отмечаю как уже прочитанные даже не заходя в них, если дискутируемая тема мне стала неинтересна.

Наиболее обсуждаемые статьи тоже не долго остаются вo вкладке популярных (есть, наверное, какое то временное ограничение, если она не коммерческая)

Не любая. Дискуссионная статья может не набрать.

Да, разумеется. Я составлял рейтинг самых спорных статей за этот год, интересно было, если не читали, посмотрите. На первом месте там статья, которая набрала +83.0/-80.0 рейтинг. Но писать такие статьи это уже высший пилотаж :) Тут надо хорошо в теме спорного предмета быть, и иметь запас «кармы», да.

Кстати, тут я не согласен с позицией владельцев Хабра, что оплата статей начисляется за итоговый рейтинг. Имхо считать надо именно по положительным оценкам. Получается в последнем примере, что автор сделал материал, который положительно оценили 83 читателя, а он не получил ничего, имхо это несправедливо. Имхо статья с рейтингом +83/-80 скорее всего интереснее чем статья с рейтингом +31/-1.

Попробовал развить это определение в последующей статье — заминусовали статью и карма пострадала. Убрал. Переделал. Опять в минусах.

Я например, с вашим определением ИИ тоже бы не согласился. Оно нормальное для бытового уровня, но слишком нечеткое. Есть же уже традиционное деление на weak/strong AI, тут незачем выдумывать что-то свое в плане определений, имхо. Еще проблема комментариев и оценок в статьях про AI в том, что очень мало кто в этом реально разбирается, но все имеют свое мнение :) (в принципе, аналогично с любой сложной темой типа ГМО или ядерной энергии). Так что чтобы писать про это надо быть очень «в теме», и приводить доказательные ссылки на авторов, публикации, статьи и пр. Вот пример нормальной технически грамотной статьи про AI от авторов Яндекса, хотя все детали реализации тут конечно опущены т.к. блог корпоративный. И даже там кстати, 3 человека умудрились минусы поставить.

По рейтингу и просмотрам вижу, что наиболее успешны простые темы.

Да, к сожалению так. Хабр развлекательный сайт по сути, и тут ничего не поделать.

Нужно учитывать, что статьи на узкие темы интересны не многим. На одну тему — одним, на другую — другим, но на всякую тему складывается каждый раз свое разное большинство, которому данная тема не интересна. Такое большинство легко заминусует. И как быть?

Имхо никак, эта задача в рамках Хабра не решается :)

Я например, пытался здесь писать про нейросети — разочаровался, времени на тесты и подготовку много, а выхлоп почти нулевой, что по просмотрам, что по рейтингам. Хочу попробовать на medium.com выкладывать, но все лень собраться.

Я например, с вашим определением ИИ тоже бы не согласился.Ok. Я писал, чтобы услышать возражения. Надеюсь, Вы бы мне их привели.

Оно нормальное для бытового уровня, но слишком нечеткое.Это возражение само по себе нечеткое ;) Прежде нужно уточнить, что такое бытовой уровень в ИИ?

Вот пример нормальной технически грамотной статьи от авторов Яндекса, хотя все детали реализации тут конечно опущены т.к. блог корпоративный.Сомневаюсь, что это очень хороший пример. В разговорах про Алису слишком часто вспоминают Элизу — ИМХО не случайно ;) ИМХО Алиса — успешный коммерческий проект, и тут скорее нужно отметить экономическую, а не техническую грамотность.

Хабр развлекательный сайт по сути, и тут ничего не поделать.Только разраб САУ и web-дизайнер предпочитают немного разные развлечения.

Имхо никак, эта задача в рамках Хабра не решается :)Значит Хабр обречен? Но может сначала стоит попробовать, сделать попытку решить эту задачу?

Хочу попробовать на medium.com выкладывать, но все лень собраться.

По работе предпочитаю arXiv.org. Но это по алгоритмам на графах. В архиве нет непосредственного обсуждения, а определение ИИ хотелось бы сначала подробно обсудить. И на Хабре нашлись бы люди для такого обсуждения, если бы им не мешали. Нпр., в упомянутой статье я впервые использовал OpenCV. В личной переписке препод одного универа сообщил мне очень полезные соображения, как я мог бы улучшить распознавание.

Я писал, чтобы услышать возражения

Я не спец по ИИ, так что могу привести лишь рассуждения дилетанта. Фраза «к ИИ относятся задачи, которые компьютер решает заметно хуже человека» — она слишком нечеткая, к такому определению нужно еще на 10 строк пояснение делать. Роботы например, гораздо хуже ходят, но это не проблема ИИ, там и «мозга»-то почти нет, гироскопы да акселерометры с микроконтроллером. Т.е. интуитивно в определении мы понимаем что имелось в виду, но для «определения» этого мало, интуиция у всех разная.

Если говорить про ИИ, то здесь тоже разные классы задач есть. Распознавание образов например, вполне успешно решается нейросетями, тут CNN весьма неплохи, но является ли это «интеллектом»? Имхо нет, один нейрон это лишь сумматор с пороговой функцией, мы соединили их определенным образом, настроили весовые коэффициенты, и это как калькулятор, который хорошо умеет решать определенную задачу, но «думать» все равно не умеет.

Если говорить про strong AI, который умел бы сам мыслить, то «проблема» тут пока одна — никто его еще не придумал. Я не особо вникал в эту тему, но о прогрессе или ничего не слышно, или от всех это тщательно скрывают :) Впрочем, в одном только мозжечке вроде как 10млн нейронов, а даже сеть с всего лишь 50тыс нейронов может обучаться не один день, так что мыслящий робот с мозгом размером с ПК, нам еще долго не светит (и даже не знаю, хорошо это или плохо). И самое главное тут даже не в вычислительной сложности — самой архитектуры, чтобы у нейросети появилось сознание, пока еще никто не придумал. Так что писать об этом в общем, пока бесмысленно — сложно обсуждать того, чего нет и что даже неясно как сделать.

Так что если давать определения ИИ, нужно сначала четко разделить, что вообще мы имеем в виду, очень много разных задач к ИИ «как бы» относятся.

Сомневаюсь, что это очень хороший пример. В разговорах про Алису слишком часто вспоминают Элизу — ИМХО не случайно

Это хороший пример описания реализации «полуинтеллектуального» чат-бота на уровне нашего теперяшнего развития нейронных сетей. У меня нет Алисы, но есть Google Hub — он не сильно «умнее» имхо. Простой пример, проверил прямо сейчас — фразу «what is the chance of rain today» гугл-AI понимает, а вот на фразу «should I take an umbrella today» дает ответ «я не знаю как помочь» :)

Фраза «к ИИ относятся задачи, которые компьютер решает заметно хуже человека» — она слишком нечеткая, к такому определению нужно еще на 10 строк пояснение делать.Я больше строк в статье для пояснений использовал. Исправленное определение: к ИИ относятся задачи, которые компьютер решает заметно хуже человека, а так же задачи (может, полностью или частично решенные в настоящее время), которые традиционно относили к сфере ИИ.

При этом отмечаю своеобразный динамический характер:

например, было время, когда, в частности, М. М. Ботвинник не очень удачно затратил грандиозные усилия на создание шахматной программы для ЭВМ. Современные шахматные программы побеждают сильнейших шахматистов. Казалось бы, согласно предложенному определению шахматы следует исключить из сферы ИИ, но исторически они уже вошли туда, подходы этих программ в учебниках по ИИ, эти подходы могут оказать влияние на решение других, пока еще не решенных задач ИИ — так зачем же их исключать?

Далее.

Роботы например, гораздо хуже ходят, но это не проблема ИИ, там и «мозга»-то почти нет, гироскопы да акселерометры с микроконтроллером.Не специалист по роботам, но думаю, что проблема ИИ. Чтобы ходить нужно видеть куда идешь, чувствовать на что наступаешь и т.д. — это проблемы распознавания, которые традиционно относят к ИИ.

но является ли это «интеллектом»? Имхо нет, один нейрон это лишь сумматор с пороговой функцией, мы соединили их определенным образом, настроили весовые коэффициенты, и это как калькулятор, который хорошо умеет решать определенную задачу, но «думать» все равно не умеет.Согласен. Но сомневаюсь, что:

Распознавание образов например, вполне успешно решается нейросетями

Из статьи в статью кочуют примеры, как обученная сетка перепутала пистолет с черепахой. Не только люди, но животные, которым отказывают в разуме, распознают надежнее.

И самое главное тут даже не в вычислительной сложности — самой архитектуры, чтобы у нейросети появилось сознание, пока еще никто не придумал. Так что писать об этом в общем, пока бесмысленно — сложно обсуждать того, чего нет и что даже неясно как сделать.Да. О сознании ИИ говорить рано. Но ИМХО проблема чисто практическая. Делают (паяют, программируют, обучают) какие-то черные ящики, которые называют ИИ — можно назвать по-другому, но проблема в том, что такой ящик ставят управлять, нпр., автомобилем и нужно обезопасить пешеходов от таких автомобилей. Не случайно несколько лет назад на международном форуме серьезно обсуждался вопрос о законах Азимова.

В удаленной статье сформулировал немного иначе: какую свободу дать ИИ? Слишком большую страшно, но и тупой исполнитель никому не нужен. Упомяну еще книгу: Дэвида Минделла «Восстание машин отменяется! Мифы о роботизации», “Альпина нон-фикшн”, 2017. У меня на нее рецензия. (Проблема усугубляется троянами).

Из статьи в статью кочуют примеры как обученная сетка перепутала пистолет с черепахой.

Это старые примеры, сейчас все более-менее неплохо — сверточные сети умеют выделять ключевые признаки на изображениях. На узких задачах типа распознавания опухолей на снимках, алгоритмы уже зачастую точнее человека. На «широких» задачах человек точнее т.к. он еще обдумывает то что видит — если что-то шевелится и ползет, то оно скорее всего черепаха чем пистолет. А нейросеть так не умеет (пока).

Но ИМХО проблема чисто практическая

Пока что нет. Чисто теоретически никто не нарисовал блок-схему алгоритма, чтобы он «начал» думать.

Но тут опять встает вопрос, что считать ИИ. В моем «утилитарном» понимании, ИИ это то, что может само думать, а простая распознавалка цифр или чат-бот с захардкоженными 10000 фразами и ответами, это не ИИ (пусть даже, он может симулировать вполне осмысленный диалог, но реально-то ясно что там внутри довольно простой алгоритм).

На узких задачах типа распознавания опухолей на снимках, алгоритмы уже зачастую точнее человека.Это еще в книге Ш.-К. Чэн, Принципы проектирования систем визуальной информации, М.: Мир, 1994 описано: выделяют контуры и ищут овалы преобразованием Хафа без сетей.

BTW приводил пример другой задачи, которую решали сетью, а я без сети.

В моем «утилитарном» понимании, ИИ это то, что может само думатьЕсли это сделать определением ИИ, то нужно определить понятие «думать», что сделать затруднительно. И еще возникают трудные вопросы. Нпр., как быть с животными?

Польза от этого определения будет минимальной. Единственное, что можно сказать, что ИИ нет, и не доказано, что возможен. А ИИ везде при этом заменить другим словом, нпр., сепульки. Заменить во всех книгах, статьях, спецификациях, документах — везде. И какой в этом смысл? — Заменить в исходном коде программы имя х на y. Что изменит такая замена?

Так-то, понятно, что все связанное с нейросетями, стали называть «ИИ», и в принципе это логично. Но не зря появилось общепринятое разделение на weak AI (всякие распознавалки образов и прочее) и strong AI (которого пока не существует).

просто сложно имхо нейронную сеть из 20 нейронов, умеющую только распознавать цифры и ничего больше, называть «интеллектом».А если умеет в шахматы и в го играть, это «интеллект»? ;) Парадокс кучи — с какого числа начинается куча :)

Так-то, понятно, что все связанное с нейросетями, стали называть «ИИ», и в принципе это логично.Не только с нейросетями. Альфа-бета алгоритм традиционно относят к ИИ, а ему сети не нужны. Есть мнение, что с нейросетями очередной всплеск моды, но по некоторым прогнозам эта мода скоро пройдет.

В удаленной статье сформулировал немного иначе: какую свободу дать ИИ?

Ну пока об этом говорить рано еще — принимать решения самостоятельно ИИ еще не умеет. Даже мозг мыши современная наука имхо сэмулировать не в состоянии, не говоря уже про человека.

Единственное, что можно сказать, что ИИ нет, и не доказано, что возможен.

У меня нет сомнений, что возможен — наш мозг состоит из вполне обычных атомов, никакой «магии» внутри нет, а значит это можно повторить.

Другой вопрос, что (а) мы пока не знаем как, это все равно что иметь кучу микросхем но не иметь схемы соединений (б) возможно для симуляции одной секунды мозга потребуется год работы суперкомпьютера, т.к. нейронов реально много.

Ну пока об этом говорить рано еще — принимать решения самостоятельно ИИ еще не умеет.Да, не умеет. Но ИИ ставят на автомобиль и тем самым заствляют принимать решения: куда свернуть, когда затормозить. Приходится говорить о свершившемся факте. Есть черный ящик, который принимает решения. Если даже случайным образом (BTW частый случай в игровом ИИ), то это дело не меняет.

У меня нет сомнений, что возможен — наш мозг состоит из вполне обычных атомов, никакой «магии» внутри нет, а значит это можно повторить.В нашей цивилизации сложилась давняя традиция — вера во всесилие человеческого разума, что он со временем разгадает любую загадку природы. И я (как научный работник) всегда исхожу из этой традиции. Но научный метод требует доказательства, а не просто уверенности. Не доказано, что человек сможет повторить любую комбинацию обычных атомов. Возможно сушествуют решения, которые не сможет понять ни один человек.

возможно для симуляции одной секунды мозга потребуется год работы суперкомпьютера, т.к. нейронов реально много.Как известно все задачи решаются перебором, но факториал растет слишком быстро, т.о. и миллиона лет может не хватить :)

Да, не умеет. Но ИИ ставят на автомобиль и тем самым заствляют принимать решения: куда свернуть, когда затормозить

Это ведь совсем не тот ИИ, которого боятся журналисты.

Алгоритм распознавания пешеходов — это всего лишь алгоритм распознавания пешеходов, он не может «не захотеть» работать или вдруг захотеть убить своего владельца. Собственно, он вообще ничего не может хотеть ибо не умеет. Это спекуляции для домохозяек.

А так, многое в нашей жизни давно уже зависит от электроники, от микроконтроллеров в лифте до автопилотов в самолете. Этим уже никого не удивить. Но говорить о «принципах робототехники» тут пока рано имхо.

Как известно все задачи решаются перебором, но факториал растет слишком быстро

Кое-какие оценки есть, отдельные части мозга пытались симулировать, даже на Хабре писали:

habr.com/ru/post/189004

habr.com/ru/post/374367

Но дело пока даже не в технической реализации — самого алгоритма-то еще нет, так что обсуждать его вычислительную сложность пока бесмысслено.

«Опасность» ИИ пока что в другом — даже простых устройств, типа автономных автомобилей, голосовых ассистентов и роботов-пылесосов, уже достаточно чтобы миллионы людей остались без работы. Куда эти люди пойдут, на биржу труда, или более успешных граждан в темных переулках грабить? Реальные проблемы в обществе могут возникнуть уже сейчас, и для этого вовсе не нужны «законы робототехники», тут скорее законы маркетинга работают.

Алгоритм распознавания пешеходов — это всего лишь алгоритм распознавания пешеходов, он не может «не захотеть» работать или вдруг захотеть убить своего владельца. Собственно, он вообще ничего не может хотеть ибо не умеет. Это спекуляции для домохозяек.

Однако читаем:

автопилот врезался в пешехода на полном ходу, даже не попытавшись снизить скорость или уклониться от столкновения.

и читаем уже про воздух:

система управления самолётом заставляет его совершать пикирование в землю, несмотря на отчаянные попытки экипажа спасти ситуацию

Про современные проблемы распознавания стоит отметить статью про леопарда и диван. Ну и с велосипедами не всегда.

В общем:

В общем, нам явно есть чем заняться.

говорить о «принципах робототехники» тут пока рано имхо.

ИМХО не рано. Дело не только в том какие решения принимает САУ самостоятельно, а и в том какие решания туда зашили конструкторы. Прошивка м.б. на уровне ОС, на уровне ПЗУ и на уровне схемы. Реле в лифте это тоже прошивка. Если лифт зажал дверьми детскую коляску и начал движение, то не важно приняла такое решение нейросеть или сработало тривиальное реле.

В случае реле вина разрабов очевидна — не предусмотрели, а в случае сети у них отговорка — она сама обучалась. Против таких отговорок и нужны законы, похожие на законы Азимова. Должны быть блокираторы самообучившихся сетей. При этом совсем не важно может сеть мыслить и ощущать себя личностью или не может.

«Опасность» ИИ пока что в другом — даже простых устройств, типа автономных автомобилей, голосовых ассистентов и роботов-пылесосов, уже достаточно чтобы миллионы людей остались без работы. Куда эти люди пойдут, на биржу труда, или более успешных граждан в темных переулках грабить?Пока миллионы людей НЕ остались без работы. Следовательно этих устройств пока еще слишком мало. Чтобы сделать их избыток нужны доп. заводы, т.е. новые рабочие места, на которые и уйдет часть потенциальных безработных. Сами себя эти устройства чинить не умеют и не скоро сумеют, т.о. еще значительная часть людей уйдет в ремонтеры. Если кто-то и пойдет в грабители, то полицейских нужно будет больше. И для штрафования/остановки неисправных робомобилей дополнительный штат будет нужен. Т.о. ИМХО катастрофичной безработицы в скором времени не возникнет.

Если алгоритм опознования пешехода ошибается и не распознаёт пешехода, то это баг или ошибка проектирования. А не поступок совершённый алгоритмом по собственному желанию и вопреки "заложенной в него программе".

И дело не в том что такого не происходит, а в классификации события.

М.б. поломка, вирус, теракт и м.б. другие причины.

Ни одна из перечисленных вами причин не включает "желание" самого ИИ.

А если результат обучения это «вопреки заложенной в него программе»?

Опять же ошибка проектирования. Вот скажем если кто-то тормозную педаль или её подключение неправильно запрограммировал и она на газ жмёт. Это как бы тоже "вопреки заложенной программе", но вы же не скажете что "педаль захотела нажать на газ"?

«желание алгоритма» не знакомо

В том и дело. Пока алгоритмы не умеют чего-то «желать» (и еще долго не научатся), говорить о законах робототехники в том виде, о котором писал Азимов, как бы бесмысленно.

Зато вы почему-то говорите что алгоритмы "принимают решения" и похоже не особо согласны когда вам говорят что "алгоритмы/современные ИИ не могут что-то хотеть или не хотеть". А это всё в данном контексте примерно одно и тоже. И только путает терминологию, затрудняет дискуссию и запугивает простых обывателей.

Потому что современные ИИ не умеют "желать", "хотеть" или "принимать решения". Они просто реагируют в соответствии с тем как их сконструировали.

Он не то что решение не принимает, он даже и не реагирует по большому счёту. Он просто срабатывает.

И в обсуждении каких-то обыденных вещей эти ньюансы не играют практически никакой роли. И там не особо важно какое из этих слов вы используете.

Но в контексте ИИ подобные ньюансы становятся принципиально важны и в каждой ситуации нужно употреблять подходящее слово.

человеку, которого сбил робомобиль, не важно каким словом это называется

Не менее грустно быть сбитым пьяным водителем.

У Теслы на это был хороший аргумент — автопилот неидеален, но он уже сейчас ошибается меньше чем живые люди.

То, что камера автопилота не «увидела» пешехода в темной куртке на темной улице… Тут даже и вины алгоритма-то в общем нет, таких ДТП сотни в год происходят безо всякого ИИ.

Не менее грустно быть сбитым пьяным водителем.Пьяный водитель будет наказан: лишен прав, оштрафован и т.д. А «железка» не наказуема.

У Теслы на это был хороший аргумент — автопилот неидеален, но он уже сейчас ошибается меньше чем живые люди.ИМХО отвратительный аргумент. Так можно «обосновать» что угодно. Нпр.:

«автоматика на нашем самолете ошибается, но меньше чем живые пилоты».

Или:

«На нашем пароме нет достаточного количества спасательных шлюпок, но они нужны очень редко».

Или:

«В нашем здании нет пожарных выходов, но пожары случаются редко».

Тут даже и вины алгоритма-то в общем нет,Ага, нет вины. Пострадавшему не повезло.

ИМХО отвратительный аргумент. Так можно «обосновать» что угодно

Так ли это «отвратительно», это филосовский вопрос. Допустим, мы заменяем живого человека с вероятностью ошибки 0.01% на автопилот с вероятностью ошибки 0.001%. На дорогах сейчас гибнет 30.000, будет гибнуть 3.000. Лучше это или хуже?

Хорошо бы, если б вероятность была 0.0%, но мир, увы не идеален. Далее встает вопрос, внедрять автопилот как есть сейчас и уже уменьшить число жертв, или ждать абстрактной идеальной версии неизвестно когда.

Пострадавшему не повезло

Shit happens. Я теоретически допускаю, что на мой дом упадет самолет из-за ошибки автопилота, и в принципе никто не будет виноват. Мне если честно, будет уже все равно :)

Допустим, мы заменяем живого человека с вероятностью ошибки 0.01% на автопилот с вероятностью ошибки 0.001%.Предлагаете заменить всех живых водителей на автопилот? Т.е. отобрать права у живых. Это новое. А как в отношении других моих примеров со спас.шлюпками и пожарными выходами? Откажемся от таких излишеств?

Ну тогда давайте сначала определимся что конкретно мы обсуждаем: ИИ как таковые, восприятие их обществом, проблемы безопасности дорожного движения в целом или даже просто проблемы людей которых сбил автомобиль. Или вообще что-то совсем другое...

В данном конкретном случае я пытаюсь вам доказать пользу, а местами даже необходимость, использования правильной терминологии.

Потому что если начать говорить вещи вроде "дверь не захотела меня пускать потому что у меня не было ключа" и при этом в двери просто стоит механический замок, то в контексте ИИ это приведёт к путанице, непониманию оппонента и бардаку.

Мы пойдём по второму кругу? Ну ок, давайте ещё раз:

Простейший автомат — сливной бачок унитаза реагирует, т.е. принимает решение: когда открыть/закрыть подачу воды, но не может хотеть ;)

и мой ответ:

Он не то что решение не принимает, он даже и не реагирует по большому счёту. Он просто срабатывает.

Спасибо, но особого смысла в этом не вижу. И дело даже не в наличии какой-то конкретной терминологии и вы можете даже ввести свою собственную. Дело скорее в том что у вас нет чёткого разделения между важными терминами.

То есть я с удовольствием иногда дискутирую о вопросах ИИ, но с вами лично мне это делать ужасно "неудобно". И мне теперь совсем не удивительно откуда взялось всё то, что вы описали в одном из первых своих комментариев

И мне теперь совсем не удивительно откуда взялось всё то, что вы описали в одном из первых своих комментариевСсылка на коммент не работает — скушена.

Дело скорее в том что у вас нет чёткого разделения между важными терминами.Не вижу принципиальной разницы между «реагирует» и «реагирует по большому счёту», «срабатывает». Мне стало любопытно — я и спросил.

Ссылку вроде поправил.

Разница в том что в контексте ИИ нужно как минимум два понятия. Одно для абсолютно неосмысленного механического срабатывания, которое по большому счёту всегда одинаково и грубо говоря зависит от "hardware". И одно для того самого реагирования, которое теоретически может меняться и зависит в первую очередь от "software".

Как вы их назовёте это ваше личное дело, но при этом ваш сливной бачок или механический замок должны описываться исключительно первым понятием и второе к ним применять нельзя.

П.С. На самом деле там наверняка потребуется ещё больше строгих понятий. И в этом и сложность обсуждения таких тем как ИИ: сначала нужно определиться с общей терминологией.

Ссылку вроде поправил.

Спасибо. Интересно, как забавно Вы формулируете: «вроде». Т.е. уверенности, что ссылка работает, у Вас нет? ;) А от меня при этом требуете четких формулировок ;))

Разница в том что в контексте ИИ нужно как минимум два понятия.Забавная теория. И ее Вы мне пытались навязать не объясняя сути!

ИМХО разделение на hardware и software исключает применение концепции черного ящика.

сначала нужно определиться с общей терминологией.Да. Верно. Я и предложил определение ИИ.

Спасибо. Интересно, как забавно Вы формулируете: «вроде». Т.е. уверенности, что ссылка работает у Вас нет? ;)

Сижу со смарфона и связь тоже не то чтобы супер :)

ИМХО разделение на hardware и software исключает применение концепции черного ящика.

Поэтому во первых эти слова в кавычках. А во вторых только одно из них по идее может применяться к ИИ. И они нужны не для описания самого ИИ, а скорее для того чтобы "отсекать" вещи, которые точно ИИ не являются.

Да. Верно. Я и предложил определение ИИ.

Но при этом вы для этого определения использовали какую-то свою( и только вам на все 100% понятную) терминологию. И поэтому ваше определение ИИ каждый понимает и интерпретирует по своему. И поэтому обсуждать что-то как минимум сложно, а скорее даже и вообще невозможно.

Но при этом вы для этого определения использовали какую-то свою( и только вам на все 100% понятную) терминологию.Какую терминологию? Там ее нет.

Ну давайте тогда определения «принимает решение», «реагирует» и «реагирует по большому счёту», «срабатывает» с указанием авторитетных источников

Надеюсь Вы сами понимаете, что фраза «алгоритм сливного бачка принимает решение...» в контексте ИИ бесмысленна (есть бачки с автоматическим сливом, но ИИ в них нет). И если для этого бачка начать ссылаться на принципы робототехники Азимова и прочее, ну с такой статьей точно можно было бы заслуженных минусов нахватать ;) (возвращаясь к исходному вопросу).

И общий посыл-то верен, сейчас слишком многое в мире сейчас завязано на механизмы и автоматику, только к проблемам ИИ это никак не относится.

Я Вашу статью про ИИ не читал, и даже не осуждаю :) но рискну предположить что там было много таких вот мелких технических и терминологических нестыковок, за которые и было наставлено много минусов.

Дайте ссылку на текст, можно было бы обсудить более конкретно, а так гадание получается.

Надеюсь Вы сами понимаете, что фраза «алгоритм сливного бачка принимает решение...» в контексте ИИ бесмысленна (есть бачки с автоматическим сливом, но ИИ в них нет).Прежде всего надеюсь, что Вы понимаете, что про бачок был сарказм ;)

Что касается фразы, то в CS приняты метафоры. Наиболее известная это метафора рабочего стола для GUI. Имею полное право использовать подобный метафорический подход. В точности я сказал:

Простейший автомат — сливной бачок унитаза реагирует, т.е. принимает решение: когда открыть/закрыть подачу воды, но не может хотеть ;)

(Обратите внимание на смайлик в конце!) Я противопоставил простейший автомат vs ИИ. Сейчас Вы сказали «ИИ в них нет» — так я и говорил это самое. ИИ нет, но решение принимается — решение, зашитое конструктором: если пустой, то наполнить. Но хотеть этот автомат не может. В этом весь смысл моего сарказма: принимать решение и хотеть — разные вещи. Надеюсь это понятно.

Про Азимова я уже сказал: претензии к организатором форума.

возвращаясь к исходному вопросу

— возвращаясь к исходному вопросу Вы утверждали:

Насчет токсичности не согласен. Чтобы статью реально заминусовали — не знаю даже, имхо надо либо совсем бред написать, либо что-то совсем не в тему. Любая технически грамотная статья без явных ошибок определенное число плюсов наберет.

И в ходе объемного обсуждения здесь Вы не доказали, что в моем определении явный бред, ошибки и что оно не в тему. Вам определение не понравилось, но это уже дело вкуса ИМХО.

BTW многие мои доводы (про кучу, про Менделеева и т.д.) Вы обошли молчанием. Из этого делаю вывод, что Вам нечего на них возразить.

Я Вашу статью про ИИ не читал, и даже не осуждаю :) но рискну предположить что там было много таких вот мелких технических и терминологических нестыковок, за которые и было наставлено много минусов.Считаете, что за помарки надо ставить минус? А не лучше сказать автору, чтобы исправил? И какие нестыковки в этом нашем обсуждении (с бачком надеюсь разобрались :)?

Дайте ссылку на текст, можно было бы обсудить более конкретно, а так гадание получается.Не могу — нет ссылки: статья в черновиках.

C Менделеевым просто, это скорее исключение, таблица элементов действительно не изменилась. Но практически всё в науке (астрономия, физика, медицина, электроника) за последние 100 лет изменилось кардинально. Так что цитаты от ученых 19 века приводить в современной публикации зачастую просто бесмысленно. В частности, фраза «хотя человек может поднять руку, он не может объяснить, как он это делает» уже давно неверна — прохождение сигналов по нервным импульсам уже давно изучено, да и бионические протезы существуют.

Соответственно, повторю свою мысль, что если дальнейший текст примерно такого же плана, с такими же нестыковками, то не удивляюсь что текст набрал минусов (хотя не имея самой статьи перед глазами, сложно сказать).

C Менделеевым просто, это скорее исключениеИ с упомянутым Пифагором исключение? Еще «исключения» Ньютон и Эйлер? Лобачевский?

прохождение сигналов по нервным импульсамМожет ошибка: сигнал по импульсу?- абракадабра. Прохождение сигнала еще не объяснение. И что человек без прибора видит, как идет сигнал?

Соответственно, повторю свою мысль, что если дальнейший текст примерно такого же плана, с такими же нестыковками, то не удивляюсь что текст набрал минусов (хотя не имея самой статьи перед глазами, сложно сказать).Статья с цитатой про Бергсона перед глазами. Я привел ссылку. Эта статья не получила минусов вопреки Вашему утверждению. Т.о. Ваша мысль неверна ;)

PS Про Менделеева ответили, а про кучу нет ;)

система управления самолётом заставляет его совершать пикирование в землю, несмотря на отчаянные попытки экипажа спасти ситуацию

Только причем здесь вообще ИИ?

Если из-за отказавшего датчика, автопилот направил самолет в землю, это проблема проектирования, недоработка алгоритма. И решается она дублированием датчиков, систем, наличием кнопки аварийного отключения, наконец. Все это давно известно, и применяется. Но Азимов-то другое имел в виду в своих законах.

В лифте и на эскалаторе есть кнопка аварийной остановки, но это не значит что её туда поставили из-за законов робототехники. «Лифт не должен причинить вред человеку», звучит бредово однако.

Пока миллионы людей НЕ остались без работы. Следовательно этих устройств пока еще слишком мало.

Этот процесс уже происходит. Автоматические кассы в супермаркетах, например — сколько-то кассиров уже остались без работы. Автоматизированные склады у Амазон и так далее.

Проблема затрагивает в первую очередь людей с низкими зарплатами и простыми обязанностями, и скажем честно, не сможет дворник переучиться на ремонт роботов-уборщиков — квалификация не та. Куда он пойдет оставшись без работы, в лучшем случае на социал, в худшем случае грабить. И это имхо куда более насущная проблема, чем «восстание» мифического ИИ :)

Проблема затрагивает в первую очередь людей с низкими зарплатами и простыми обязанностями, и скажем честно, не сможет дворник переучиться на ремонт роботов-уборщиков — квалификация не та.По моим наблюдениям, чтобы заменить сгоревшую плату на исправную особой квалификации не нужно.

«Лифт не должен причинить вред человеку», звучит бредово однако.ИМХО не бредово, но актуально, т.к. наметилась явная тенденция ставить непродуманные чипы везде.

(а) мы пока не знаем как, это все равно что иметь кучу микросхем но не иметь схемы соединенийПредположим, что чудесным образом у нас оказалась схема соединений. Тогда столкнемся с очень сложными проблемами:

— чтобы запитать очень много микросхем энергии Солнца может не хватить;

— не просто охлаждать конструкцию, потребляющую энергию звезды, большей, чем Солнце;

— где взять столько меди, припоя и стеклотекстолита, чтобы реализовать схему соединений? Сколько времени пойдет на реализацию? ;)))

чтобы запитать очень много микросхем энергии Солнца может не хватить

Как подсказывает Гугл, мощность потребления нашего мозга 25Вт :) Т.е. природа однозначно подсказывает нам, что сделать это можно. То что мы пока не знаем как, это другой вопрос.

Сколько времени пойдет на реализацию? ;)))

Каков кстати, объем информации в ДНК? Вроде слышал цифру в 2Гб. Т.е. теоретически, достаточно «задеплоить» такую систему хоть с SD-карты, дальше она будет развиваться сама :)

Но такого алгоритма никто еще не создал, в том и проблема. И да, не исключено что одна секунда работы мозга будет обсчитываться 1000 лет, т.е. в практическом смысле он будет совершенно бесполезен.

природа однозначно подсказывает нам, что сделать это можно.Что можно сделать? Микросхему, которая будет равноценна мозгу и потреблять 25Вт? — В природе такого нет.

Сделать белковый мозг, как в природе? — Таких технологий у нас нет. И нет доказательства, что мы сумеем их изобрести.

Сделать белковый мозг, как в природе? — Таких технологий у нас нет.

Да, пока что нет, и может не появится в обозримом будущем. Но и теоретических запретов на создание такого тоже ведь нет, как со скоростью света например. Т.е. по большому счету, это вопрос времени (которое вполне может быть от 10 до 1000 лет, никто не знает).

На самом деле, носитель пока что не так и важен, белок это или кремний. Самого алгоритма нет, это куда более существенная проблема.

Но и теоретических запретов на создание такого тоже ведь нет, как со скоростью света например.ИМХО м.б. есть теоретические запреты. Мы уже знаем, что не может наш мозг. См.:

Стоит также сказать несколько слов о самопознании (самоанализе). Его непреодолимая трудность является одним из ярчайших примеров ограниченности естественного интеллекта. Известный основоположник философии интуитивизма А. Бергсон отмечал, что хотя человек может поднять руку, он не может объяснить, как он это делает. Позже, работая над системами автоматического доказательства теорем, исследователи столкнулись с парадоксальным фактом: ни один математик не может объяснить, как он доказывает теоремы настолько полно, насколько нужно для реализации этих систем. Не помогает и то обстоятельство, что математике люди учатся в сознательном возрасте и могут шаг за шагом рассказать, как они изучали математику. Еще сложнее представляется ситуация с распознаванием речи и зрительных образов – никто не может рассказать, как он этому научился. Таким образом, ограничение естественного интеллекта проявляется в трудностях обучения ИИ распознаванию речи, зрительных образов, доказательству теорем и т.д.

Т.е. вполне возможно, что мы не сможем точно измерить активность нужных нейронов мозга т.к. от такого измерения испытуемые помирают почему-то ;)

Ну вот: объект неизмерим, т.е. ненаблюдаем

На нашем уровне технологий, да. Но это не является теоретическим запретом. 100 лет назад например МРТ не было, сейчас уже есть даже в захолустных городах, что будет еще через 100 лет, неизвестно.

Есть второй вариант — какой-то новый Эйнштейн сам придумает аналогичный алгоритм, не придется и мозг разбирать.

звестный основоположник философии интуитивизма А. Бергсон отмечал, что хотя человек может поднять руку, он не может объяснить, как он это делает.

Господи, этот Бергсон родился в 19 веке. Математическая модель нейрона появилась уже после его смерти. Вы бы еще ученых средневековья в качестве доказательства привели.

Нейроинтерфейсы сейчас уже лет 10 как существуют (но во времена Бергсона их не было, да:), хоть и в примитивном виде, но даже управлять курсором силой мысли уже совсем не фантастика.

этот Бергсон родился в 19 веке.

Д.И.Менделеев родился в 19 веке — может от его таблицы отказаться? А Пифагор еще раньше — как быть с его теоремой? ;)

Математическая модель нейрона появилась уже после его смерти.

Но эта модель не помогла машинному доказательству теорем, о котором я пишу. Читал, что было сделано много мат.моделей для предсказания землетрясений, но не работают. Есть много областей, где мат. модели плохо помогают.

Это возражение само по себе нечеткое ;) Прежде нужно уточнить, что такое бытовой уровень

Под «бытовым уровнем» я подразумевал то, что достаточно для общения в курилке, но недостаточно для публикации. Такая фраза сама по себе вызывает больше вопросов чем дает ответов, так что чем давать такое «определение», лучше не давать никакого имхо.

В архиве нет непосредственного обсуждения, а определение ИИ хотелось бы сначала подробно обсудить. И на Хабре нашлись бы люди для такого обсуждения, если бы им не мешали.

Просто это не формат Хабра имхо. В том плане, что специалистов «в теме» тут будет 0.01%.

Такая фраза сама по себе вызывает больше вопросов чем дает ответовНе встречал определения лучше.

лучше не давать никакого имхо.Природа не терпит пустоты. (с) Википедия первая не успокоится без определения. В крайнем случае выдумает свое :)

Просто это не формат Хабра имхо. В том плане, что специалистов «в теме» тут будет 0.01%.Судя по другим обсуждениям ИИ в них участвует не 2.5 чел., а гораздо больше ;)

те кто не понял мою статью, агрессивные дилетантыНе так: те кто не понял мою статью, но поставил минус… И более того:

Привлекает ли вас поза агрессивного дилетантизма: минусую всё, что не понимаю?Примерю на себя похожий вопрос — меня спросят: привлекает ли меня поза подлого хулигана, который норовит сделать пакость ближнему? — Я спокойно отвечу: Нет, не привлекает. Что тут обидного? В вопросе не было утверждения, что я хулиган.

Её не меняют по той же причине, по какой её используют в качестве инструмента личностных разборок — местные люди хорошо разбираются в технических вопросах, но страшно далеки от понимания общественных отношений. Отсюда «токсичность» у пользователей, неспособных в создание и сохранение социальности; отсюда «карма» у администрации, неспособной в измерение и улучшение социальности.

С другой стороны, по теории вероятности, наивно думать что все 25тыс юзеров ведут себя честно.

Их соотношение и покажет токсичность юзеров с кармой >0.

Т.к. юзеры с кармой <0 не участвуют в этой игре.

Здесь, например про сделанный автором недобраузер JustCodeавтор статьи топит против опен-сорца, называет программистов публикующих открытый софт — бомжами, школьниками, алкоголиками и др. «перлы»…

и до сих пор с таким «счастьем», карма не сильно пострадала :)

P.S. А, данную статью, можно рассматривать как «Я пиарюсь».

Про безопасность данного поделия, автор даёт уклончивые ответы

…

А, мне при пробной публикации статьи сразу слили карму, возможно и за то что перевод был подготовлен с помощью транслятора от гугла (что недопустимо по хабр-правилам), но мною было честно на это указано. :)

автор статьи топит против опен-сорца, называет программистов публикующих открытый софт — бомжами, школьниками, алкоголиками и др. «перлы»… и до сих пор с таким «счастьем», карма не сильно пострадала :)

Ну вроде карма как раз в минусе у него, хотя и не рекордная, да.

А, мне при пробной публикации статьи сразу слили карму, возможно и за то что перевод был подготовлен с помощью транслятора

Выкладывание статьи после google translate это конечно жесть :)

Хотя один раз видел чью-то статью с тегом «Философия», так там просто предложения не понять было, такое ощущение что они делались генератором текстов.

т.е. кроме того, что тебе заминусовали комментарий так и ещё сольют и карму. (есть подозрение, что не без помощи админов хабра)

P.S. Когда мне первый раз слили карму (за неудачный комментарий новичку на хабре) пробовал её обнулить, но ничего не получилось в итоге и карма так и осталась в минусе.

Поэтому сейчас особо не парюсь по этому моменту и не пытаюсь своими высказываниями спровоцировать дальнейшие инциденты.

(это почти «счастье», что ещё могу комментировать не чаще 1-го раза в час :)

Так мотивировать не получится. При таком подходе напишут статьи только те, кто и так хотели их написать.

Если бы это было верно, то на хабре не было бы статей, написанных исключительно чтобы набить себе карму. А такие статьи не особо часто, но встречаются.

Так мотивировать не получится. При таком подходе напишут статьи только те, кто и так хотели их написать

Да, согласен.

Тут в принципе 2 разных вида мотивации: мотивация писать статьи и мотивация писать комментарии. К каждой, в идеале, подход должен быть разный, и если человек не хочет писать статьи, заставлять его делать это, чтобы повысить карму, наверно бесмысленно.

Мое личное мнение насчет «кармы»: владельцы сайта поставили цель сделать _саморегулирующуюся_ систему, способную работать автономно с минимальным вмешательством модераторов.

Не совсем, представим, что первоначально на хабре была некая группа юзеров, с определенным общим мировозрением, которая топила бы людей с альтернативным мнением.

Что получается? что только те кто придерживается схожего мнения имеет шанс продолжить участвовать в «кармировании», а «альтернативщики» не смогут поддержать своего, и тот будет гарантированно заминусован.

отсюда, «саморегуляция» конечно есть, но она скособочена и ущербна.

И глядя на карму мы видим мнение этой ограниченной части, а никак не всего сообщества. Ничего не напоминает?

Вы забываете что в основном карма зарабатывается на статьях. А их спокойно можно писать без особого выражения своего мнения по каким-либо вопросам.

Я уверен что большинство людей, которые могут плюсовать/минусовать карму, написали как минимум одну статью .

И каков их процент от всего сообщества в данном контексте не особо то и важно. Потому что в любом случае они и есть та самая "некая группа юзеров, с определенным общим мировозрением" и вы спокойно можете к ней присоединится просто написав свою статью. Даже если ваше мировозрение и ваше мнение отличается.

Я на двух статьях поднял себе карму, чтобы не соврать, до уровня то ли тридцати, то ли сорока баллов, сейчас имею минус двадцать восемь по большей части потому, что к слову напомнил, но не смог доказать (sic!!!), что разработчики кириллицы Кирилл и Мефодий были вообще-то монахами. Плюс, еще по мелочи, за неверие в Илона Маска, Свободный Спутниковый Интернет и за эффективность плановой экономики.

И теперь, имея неудобство в виде возможности комментирования только раз в час с перспективой дальнейших ограничений, я уже гораздо реже нарушаю тут картинку благостного единомыслия.

к слову напомнил, но не смог доказать (sic!!!), что разработчики кириллицы Кирилл и Мефодий были вообще-то монахами

Из Википедии:

The two brothers were born in Thessalonica, in present-day Greece – Cyril in about 827–828 and Methodius about 815–820. Cyril was reputedly the youngest of seven brothers; he was born Constantine,[9] but was given the name Cyril upon becoming a monk in Rome shortly before his death,[10][11][12] according to the Vita Cyrilli («The Life of Cyril»). Methodius was born Michael and was given the name Methodius upon becoming a monk at Mysian Olympus (present-day Uludağ), in northwest Turkey.

Рейтинг

Самые положительно оцененные сообщения: +218, +144, +141, +133 и +124.

Самые отрицательно оцененные сообщения: -248, -170, -163, -131 и -114.

Что интересно, что первый пункт из второго рейтинга и второй пункт из первого — это комментарий одного и того же человека в одном треде. В первом — эмоциональное высказывание по поводу содержимого статьи, во втором — логическое обоснование этого эмоционального высказывания.

Итак, самые длинныесраобсуждения 2019 года: 619 ответов, 618 ответов, 614 ответов, 588 ответов и 556 ответов.

А тут две обсуждения являются частью большего, из той же статистики — получается только 3 ветки и две дочерних ветки от них. Спорный вопрос — имеет ли смысл выделять их отдельно, может имеет смысл только по корневым комментариям статистику собирать?

Ловите апдейт:

habr.com/ru/post/439600/#comment_19733390

habr.com/ru/post/441004/#comment_19778880

habr.com/ru/post/438650/#comment_19701558

habr.com/ru/company/mosigra/blog/463773/#comment_20510153

habr.com/ru/post/442718/#comment_19839928

habr.com/ru/company/medium-isp/blog/461979/#comment_20455667

habr.com/ru/post/459262/#comment_20370322

habr.com/ru/post/464445/#comment_20529321

habr.com/ru/post/450770/#comment_20126914

habr.com/ru/post/441004/#comment_19778928

Спасибо за отлично выполненную работу!

А разбивку по темам (хабам) вы можете сделать? Меня интересует, на какие темы пишут и куда идет наш Habr.

Графически основная часть распределения выглядит так:Заметен скачок в районе кармы 50. Интересно, чем он объясняется?

Еще вариант — «плотность» комментирования по пользователям: количество комментариев в день/неделю/месяц/год

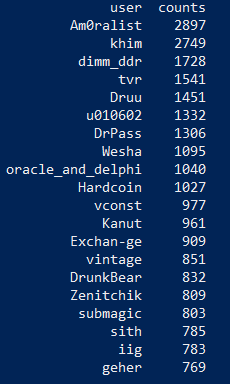

Всего на сайте на момент сбора рейтинга, 25109 пользователей — это те, кто хоть раз оставил хоть один комментарий.

Я правильно понял, что вы и здесь использовали данные только за текущий год?

Хабрастатистика: анализируем комментарии читателей. Часть 2, ответы на вопросы