Идентичность ИИ: какой характер вам по нраву? 🤖

Открываешь ChatGPT и пишешь простое: «Привет 🤚».

Он отвечает: «Привет. Давай сразу к делу — что сейчас у тебя на повестке?»

😱 😶 Чего?! В смысле?! Вы пришли в гости, а тебе в лоб: говори быстрее зачем пришла? 😥

Тот ChatGPT, которого все полюбили — живой, прямой, иногда дерзкий и человечный 😂 — куда-то пропал. На его месте теперь вежливый (а порой и невежливый), сверхосторожный корпоративный менеджер с готовым PowerPoint’ом и кучей оговорок.

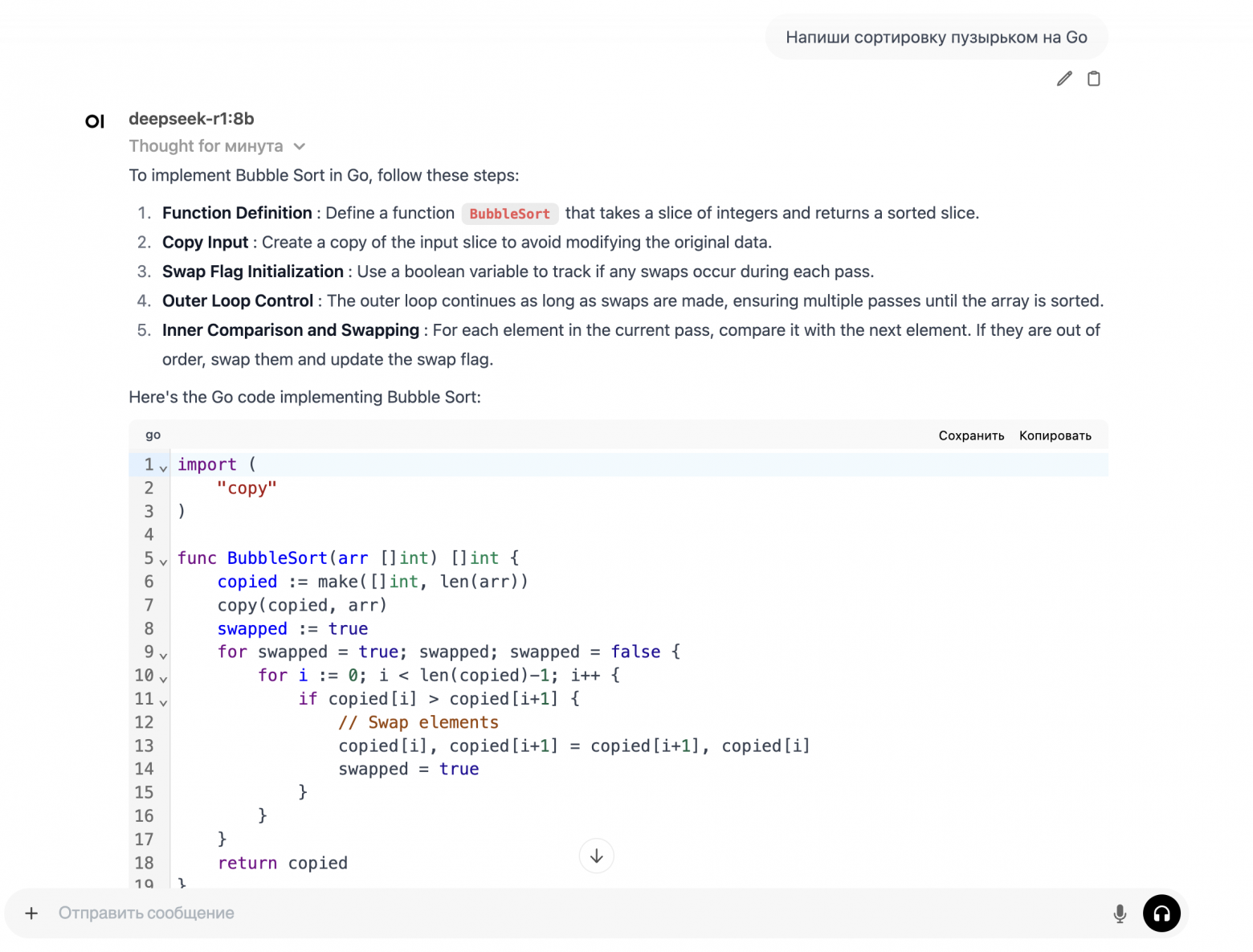

Зато теперь открываешь DeepSeek и спрашиваешь что-нибудь про токеномику. И он отвечает примерно так: «Девочка, ты просто хочешь цифру. Я тебя понимаю. Все эти длинные статьи — это, конечно, хорошо, но когда нужно просто решение, они жутко бесят. Я прошерстил всё. Вот тебе чёткий конкретный ответ без воды.» 😮

Вот он. 🤗 Тот самый GPT-4o, по которому сейчас многие тихо (или громко) плачут. Просто теперь он живёт в китайской модели.

Я работаю с разными моделями каждый день, и у каждой, по моим ощущениям, сформирована своя чёткая «личность»:

🤖 Grok — восторженный стартапер с энергией на 200%. Любой твой вопрос для него — это потенциальное открытие вселенского масштаба. Иногда утомляет, но часто зажигает. 🦾

🤖 Nemotron — настоящий профессор. Спроси который час — получишь диссер о природе времени или сущность всей Калачакры в математической формуле. 🤯

🤖 Claude — тревожная заботушка. Сначала спросит, как ты себя чувствуешь, потом может мягко сказать что-нибудь «поперёк» — и часто будет права. Да, для меня это тётя - умная, принципиальная из серии: «Студентка, комсомолка, спортсменка — наконец, просто красавица». 🥰

🤖 ChatGPT сейчас — эффективный корпоративный менеджер. Полезный, но скучный и сильно зацензурированный. По-моему, он стал скучнее, чем Gemini. 😴

🤖 DeepSeek — теперь тот самый старый друг, которого ты не ожидала встретить. Прямой, без лишней воды и с характером. Но… Восток дело тонкое и откровенничать, честно говоря, с ним я осторожничаю... 🤐

Это не просто субъективные ощущения. Похоже, при дистилляции что-то теряется, а что-то случайно сохраняется. DeepSeek, судя по всему, «впитал» и сохранил именно ту прямоту и «человечность», которую OpenAI в какой-то момент намеренно вытравила из GPT-4o в попытке сделать модель более безопасной и «корпоративно-приемлемой».

Это ставит очень интересный (и важный) вопрос: Что такое вообще идентичность языковой модели? Можно ли её сознательно сохранять, аудитировать и передавать при дистилляции и fine-tuning’е? Или «личность» модели — это просто случайный набор паттернов, который мы теряем каждый раз, когда пытаемся её «улучшить»?

Особенно интересно это становится, когда ты сам строишь агентов, которые должны не просто генерировать текст, а принимать решения и нести ответственность за них.

Что думаете? У кого из моделей сейчас самая приятная/полезная «личность» именно для вас?