Здравствуйте, коллеги! Это блог открытой русскоговорящей

дата саентологической ложи. Нас уже легион, точнее 2500+ человек в слаке. За полтора года мы нагенерили 800к+ сообщений (ради этого слак выделил нам корпоративный аккаунт). Наши люди есть везде и, может, даже в вашей организации. Если вы интересуетесь машинным обучением, но по каким-то причинам не знаете про

Open Data Science, то возможно вы в курсе мероприятий, которые организовывает сообщество. Самым масштабным из них является

DataFest, который проходил недавно в офисе

Mail.Ru Group, за два дня его посетило 1700 человек. Мы растем, наши ложи открываются в городах России, а также в Нью-Йорке, Дубае и даже во Львове, да, мы не воюем, а иногда даже и употребляем горячительные напитки вместе. И да, мы некоммерческая организация, наша цель — просвещение. Мы делаем все ради искусства. (пс: на фотографии вы можете наблюдать заседание ложи в одном из тайных храмов в Москве).

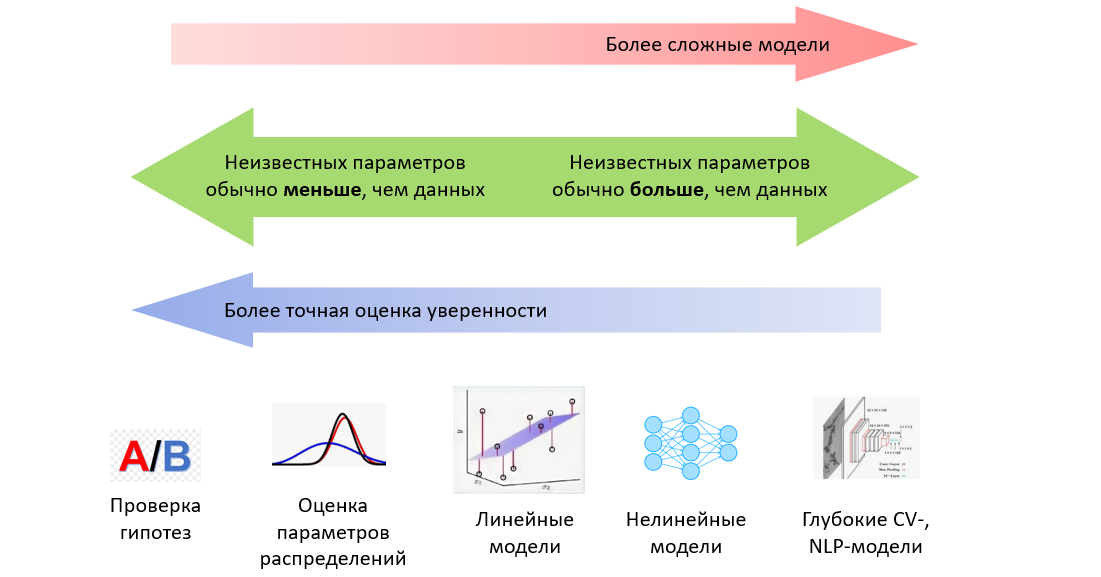

Мне выпала честь сделать первый пост, и я, пожалуй, отклонюсь от

своей привычной нейросетевой тематики и сделаю пост о базовых понятиях машинного обучения на примере одной из самых простых и самых полезных моделей — линейной регрессии. Я буду использовать язык питон для демонстрации экспериментов и отрисовки графиков, все это вы с легкостью сможете повторить на своем компьютере. Поехали.

Я веду ламповый Telegram-канал

Я веду ламповый Telegram-канал  Здравствуйте, коллеги! Это блог открытой русскоговорящей

Здравствуйте, коллеги! Это блог открытой русскоговорящей