Пользователь попросил ИИ сделать расстановку мебели в комнате.

Основа искусственного интеллекта

Фактчек не нужен: мы решили не делать то, что делают все

Мы строим AI-систему для автоматизации рерайта новостей в региональных СМИ. В таких СМИ часто три человека делают работу пятерых, а восемь из десяти материалов в день — это пересказ чужих новостей. Не потому что хотят, просто план, трафик, выживание и тд. Мы забираем эти восемь рерайтов на себя, чтобы у редакции осталось время на журналистику, а не тупизну.

Начали делать модуль фактчека. Через Перплексити сделала исследование, принесла разработчику.

В какой последовательности вообще делается проверка фактов:

1. Сначала нужно понять, что из текста нужно проверить (claim detection), это не всегда так очевидно, как кажется.

2. Классифицируем утверждение — это имя, дата, цифра, гео, цитата?

3. Проверяем каждое утверждение

4. Маркируем факты (причем сначала нужно задать систему, например, бинарную)

5. Редактор выносит вердикт

Красиво, академично и вообще не то, что нужно.

Поговорила с редакторами, как они делают фактчек

Ответы одинаковые: вручную, глазами. Смотрят, кто ещё написал эту новость, чтобы не быть первыми с фейком. Проверяют имена и должности. Иногда звонят в источник. Пара человек прогоняют через нейронку. Автоматического фактчека нет ни у кого. Ни инструментов, ни чек-листов.

Разработчик как бэ заранее это и предполагал: «Я очень сомневаюсь, что у нас медиа вот этим всем занимается в том объёме, как у тебя в ресёрч.» Ну прав. Нельзя автоматизировать то, чего нет. Сначала нужно дать инструмент лучше текущего процесса. А текущий процесс - это глаза, еще одни глаза и интуиция.

Сформулировала, что вообще такое для нас т.н. фактчекинг. Нам реально нужны две вещи:

Понимать, можно ли доверять источнику

Проверять, что AI не наврал при рерайте

Всё.

Решили пока ввести такие уровни доверия к источнику:

Если это ТАСС, Интерфакс, крупные СМИ, релизы из почты и тд - рерайтим автоматом.

Telegram-каналы – рерайтим, только если кто-то ещё об этом написал. «Кто-то ещё написал» - это мы и так знаем из дедупликации. Просто сохраняем число и используем как сигнал.

Непонятно кто, но новость релевантна изданию - показываем редактору, не рерайтим.

Сделали рерайт – проверяем консистентность, это один вызов LLM с промптом типа «Сравни факты в рерайте с оригиналом. Найди расхождения в ФИО, должностях, датах, цифрах».

Результат маркируем:

🟢 Всё совпадает с источником, можно доверять

🟡 Мелкие расхождения (округление, перефразирование)

🔴 Появились факты, которых нет в оригинале. Красный — редактор смотрит руками. Зелёный

Разработчик: «Мне кажется, это просто отдельная роль агенту даётся. Типа вот два текста, надо проверить что не так. Это норм. Обычная история.»

Ну для тебя обычная, а для меня нет. Ок, приняли.

Вопрос, который мы ещё не решили

Разраб подкинул хорошую мысль: «А что если новость сначала пришла из телеги, а потом лучше написана с нормального портала?»

Это про выбор между скоростью и надёжностью. Рерайтить инсайд из телеграма сразу — быстро, но рискованно. Ждать подтверждения, надёжно, но поздно.

Пока ответ такой - система не решает за редактора. Она показывает сигнал - «эта новость пока только у такого-то канала, подтверждений нет», и дальше уже человек выбирает, что с ней делать. Для одних тем скорость важнее, для других — нет.

Итог – наш фактчек немного не фактчек

Полноценный академический фактчекинг - возможно, когда-нибудь. В MVP уровни доверия к источникам + агент-верификатор, который сравнивает рерайт с оригиналом. И хорош пока. Едем без внешних API и claim detection. Просто минимально достаточная система, которая лучше глаз и интуиции.

Представлен открытый проект Accomplish (formerly Openwork) — Open Source AI Desktop Agent — это сборник ИИ‑агентов для автоматизации задач на ПК, которые поддерживают API OpenAI, Anthropic, Google, xAI или Ollama.

Директор по безопасности и ИИ в Meta* Superintelligence Labs (*- принадлежит Meta, признана экстремистской и запрещена в РФ) Саммер Юэ чуть не потеряла свою переписку в почтовом ящике из-за OpenClaw. ИИ-агента начал массово удалять письма из её почтового ящика, проигнорировав команды на остановку со смартфона. Ранее ИИ-бот «потерял» её указание не предпринимать никаких действий при работе с почтой без предварительной проверки. Юэ остановила ИИ только вручную, когда дошла до Mac mini с OpenClaw.

Учимся работать с искусственным интеллектом

Бесплатные онлайн-курсы для прокачки навыков работы с AI-технологиями. Внутри теория, практика и набор готовых инструментов. Никаких дедлайнов и домашних заданий.

1️⃣ AI для менеджеров (NEW)

Курс рассказывает, как строить проекты по внедрению AI в задачи бизнеса. Вы научитесь оценивать риски и экономический эффект сценариев использования AI именно в вашей отрасли. Подойдет руководителям команд, предпринимателям и всем, кто интересуется AI.

Вы узнаете, как:

подготовить бизнес к внедрению AI

выбрать AI-технологии

адаптировать AI-модели под задачи

оценить экономику AI-проектов

перейти от идеи к PoC

обеспечить Data Governance и безопасность данных

Курс о том, как проектировать и разрабатывать ML-системы. К концу обучения вы освоите рабочие методы создания эффективных и масштабируемых решений. Актуально для менеджеров проектов и продуктов, а также для backend-, frontend- и DS-разработчиков.

Вы узнаете, как:

устроены ML-системы

оценивать ML-модели

выполнять конструирование признаков

проектировать данные

обслуживать модель в облаке

отслеживать и внедрять изменения

3️⃣ Креативное мышление и AI для решения задач

Курс про инструменты креативных методологий ТОС и CRAFT. В процессе обучения вы создадите AI-ассистента для генерации идей через системный промпт. Подойдет руководителям команд, предпринимателям и всем, кто интересуется креативом и AI.

Вы узнаете, как:

определять истинный источник проблем

находить неочевидные решения

воплощать идеи в жизнь

мыслить креативно с помощью AI

Обновлён открытый проект PersonaLive. Этот ИИ который анимирует лицо в реальном времени для стримов и видео. Суть простая: загружаете портрет и «движущее» видео (или вебку), а нейросеть переносит мимику, повороты головы и речь на фото. На выходе получается будто человек с картинки реально говорит и двигается. Главная киллер‑фича: система может генерировать длинные ролики без обрывов и работать почти в лайве. Технологию уже приняли на конференцию CVPR-2026, исходный код решения опубликован на GitHub под лицензией Apache License 2.0. Потенциально это новый уровень для VTuber‑стримов, цифровых ведущих и виртуальных персонажей.

Представлен открытый проект скилла Make no mistakes для Claude Code, который заставляет нейросеть дважды перепроверять код и писать почти без багов и ошибок:

Claude исправит свои ошибки и недочёты;

ИИ два раза будет перепроверять весь код до последней строки, факты, отчёты, рассуждения, умозаключения и выводы;

если у нейронки появятся сомнения — ИИ сообщит, а не будет юлить и стараться придумывать неэффективные решения;

если задача реально сложная, Claude замедлится и будет разбирать ее по шагам, чтобы выдать оптимальный результат;

подключается быстро: просто добавляем один .md файл в проект и получаем результаты.

Представлен открытый проект AI uBlock Origin Blacklist. Это список для блокировки uBlock Origin сайтов, использующих ИИ в качестве источника контента.

«Во время просмотра веб‑страниц я иногда, довольно часто, натыкаюсь на сайты, текст на которых написан генеративным ИИ. Эти сайты не предоставляют полезной информации, имеют посредственный контент и переполнены рекламой и реферальными ссылками для заработка денег. Поэтому, когда я нахожу такие сайты, я добавляю их сюда. Ключевая идея проста: если бы я хотел, чтобы на мой вопрос ответил ИИ, я бы спросил ИИ. Если я ищу информацию в интернете, это означает, что я хочу получить ответ от человека. У человека есть опыт, мнения, идеи, креативность и много другой информации, которой он, возможно, захочет поделиться с интернетом. У ИИ этого нет. Более того, контент, созданный ИИ, может быть опасным: статьи на сайтах, созданных ИИ, не проверяются никем перед публикацией, поскольку они генерируются массово. ИИ может испытывать галлюцинации», — пояснил автор проекта.

Оказывается, что Google Chrome без ведома пользователя захламляет ПК нейросетями — браузер скрытно загружает на систему локальную версию Gemini. Бонусом она также скрыто запускается, когда идёт взаимодействие с сервисами Google. Освобождаем память и запрещаем повторную загрузку:

Вписываем в браузер адрес chrome://flags/;

Находим параметр Optimization Guide On Device Model и отключаем его;

Повторяем с пунктом Prompt API;

Находим на диске по пути AppData/Local/Google/Chrome/User Data/OptGuideOnDeviceModel/ файл весом в 4 ГБ и удаляем его вручную.

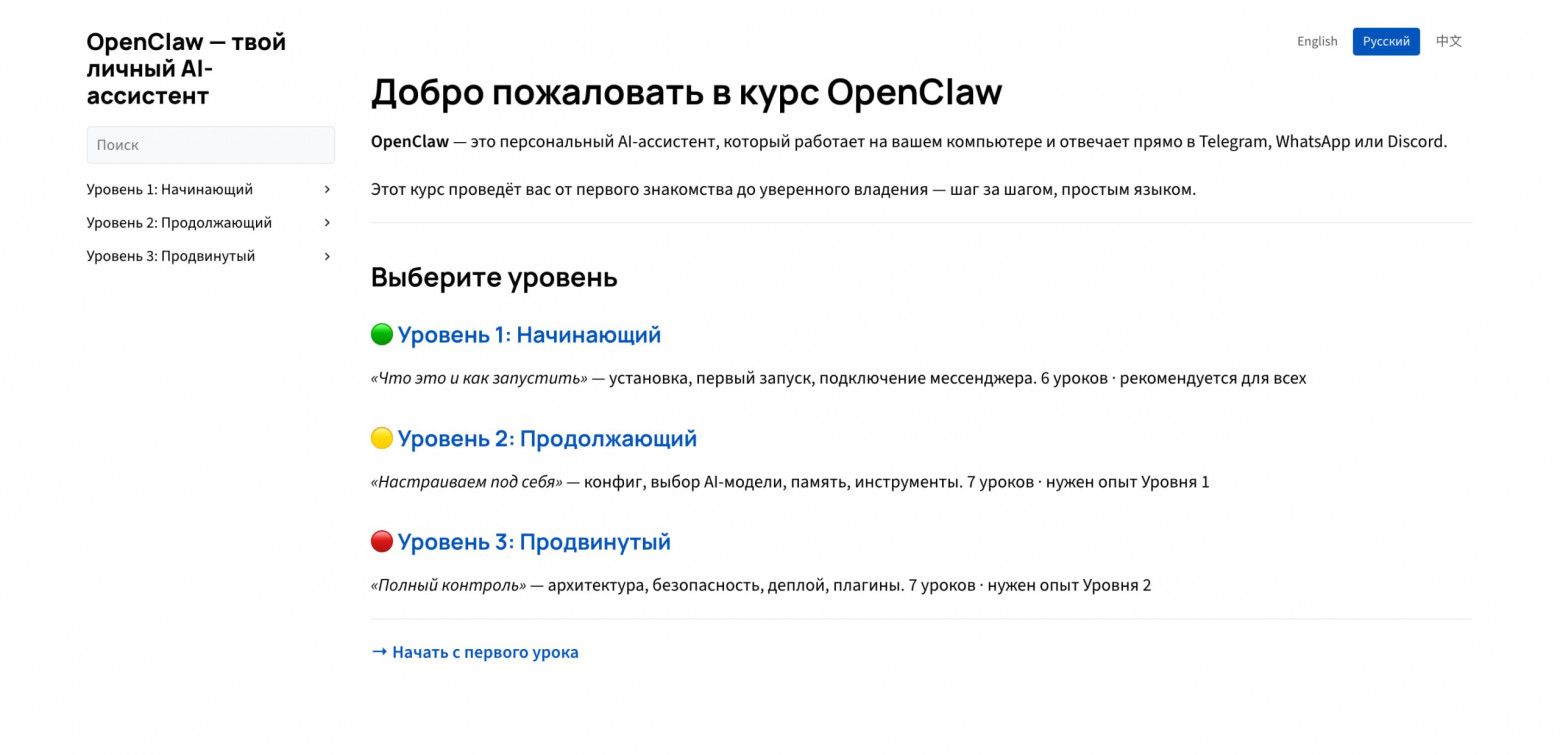

Представлен открытый и бесплатный фундаментальный курс по OpenClaw, включая весь материал на русском языке с полным описанием процессов установки, настройки, использования и полноценной кастомизации ИИ-бота под свои задачи.

Мысли про создание AI-агента, который будет помогать с "Важно, но не срочно" задачами. Часть 1

Последний месяц в сети хайпит OpenClaw (он же ClawBot, он же MoltBot).

У него есть доступы много куда — вы наверняка уже видели новости о том, как он самостоятельно тратит деньги или общается с женой (не своей)

Но меня интересует механизм работы его core feature — проактивности

Это первый масштабный агент, который не ждёт сообщения, а сам приходит и говорит: «Эй, я вот это сделал, глянь»

Я хотел собрать такого агента ещё год назад, когда обнаружил и начал исследовать Model Context Protocol, который дал моим LLM-кам доступ во внешний мир. Но тогда не хватило ни знаний, ни механизма.

Сейчас, благодаря OpenClaw, Claude Code + Codex стало понятнее, как именно это можно реализовать

И вот последнюю неделю я понемногу развиваю этот концепт

------------------------------

Суть в одном предложении

AI-агент, который знает мои цели на год и выполняет первые, самые сложные 15% работы, которые приведут меня к этим целям в долгосрок.

Последние три года я работаю на себя. У меня нет начальника, который скажет «сделай к пятнице». Почти все мои перспективные задачи лежат в квадранте «Важно, но не срочно»

И чаще всего проблема не в том, что я не знаю, что делать, а в том, что мне впадлу начать

Ресёрчить варианты. Разбираться в деталях. Сделать первый шаг. Вот эти первые 15% — самый проблемный шаг для меня

Поэтому я подумал — а что если агент будет делать именно это?

------------------------------

Представьте, что агент каждый день приходит к вам с такими сообщениями

Нетворкинг и аутрич

Учитывая твои финансовые и профессиональные цели, на этой неделе я советую тебе пообщаться с этими людьми. Я провёл небольшой ресёрч по каждому и подготовил персональное сообщение под каждого. Сделаешь до конца недели?

SEO и органика

Я опять помониторил SEO твоего сайта и сайты конкурентов. Советую сделать A, B, C, D, чтобы мы подросли в органике. Вот конкретные правки с приоритетами

Контент и кросс-постинг

Твой последний пост на LinkedIn набрал 10К просмотров — тема зашла. Давай этот пост ещё и в Threads, Instagram и на Хабр адаптируем? Вот три черновика под каждую площадку

Партнёрства

Нашёл 8 владельцев продуктово-консалтинговых агентств, которые подходят под твой ICP. Отсортировал по релевантности. Вот топ-3 с кратким профилем и черновым сообщением под каждого. Первое можешь отправить прямо сейчас.

Мониторинг конкурентов

[Конкурент] вчера выкатил новую фичу — вот что изменилось. Это может повлиять на позиционирование твоего продукта. Вот 2 варианта, как отреагировать: адаптировать лендинг или написать пост-сравнение.

Портфолио и резюме

За последний месяц ты закончил 2 проекта и написал 4 поста. Вот обновлённая версия секции «достижения» для LinkedIn-профиля и сайта. Опубликуешь?

Здоровье

Ты 4 месяца переносишь задачу "Записаться к стоматологу. Поэтому я решил действовать и нашел 3 клиники рядом с тобой с рейтингом выше 4.5, у двух есть слоты на эту неделю. Записать?

------------------------------

То есть агент не просто читает календарь — он понимает, что ему чего-то не хватает, и сам приходит за недостающим контекстом

Я хочу, чтобы агент не просто напоминал по моим задачам в календаре, а ресёрчил → структурировал → предлагал конкретный микро-шаг → спрашивал «актуально ли?»

Хочу чтобы конвертировал мои абстрактные хотелки из раздела «Важно, но не срочно» в конкретные day-to-day actions.

И это может работать не только для одного человека. Та же логика ложится на компанию: стратегические цели → первые шаги, которые никто не делает, потому что «не горит».

Пока это концепт. Но направление, в котором я копаю, кажется мне одним из самых интересных применений AI-агентов — не делать за тебя, а снимать барьер старта и помогать тебе двигаться к твоим Long Term Goals — по типу коуча/ментора

У подобного агента будут доступы к интернету и моему календарю. А общаться мы с ним будем через Telegram — видимо, как и с OpenClaw

------------------------------

Во второй поделюсь наработками и инсайтами

Привет! В GPTunneL мы строим инфраструктуру, которая помогает бизнесу безопасно и эффективно использовать генеративные модели в продуктах.

Наша цель — сделать работу с LLM предсказуемой, контролируемой и масштабируемой: от качества ответа до стоимости и соответствия требованиям.

Сейчас мы усиливаем инженерную команду и ищем Python AI/ML Engineer, который поможет нам развивать ML‑ядро и пайплайны, улучшать качество моделей и внедрять решения в продакшн. Если вам интересно работать на стыке NLP, инженерии и продукта — будем рады познакомиться.

Чем предстоит заниматься:

Проектировать и разрабатывать пайплайны для работы с Large Language Models (LLM) — от прототипа до продакшена

Создавать AI-агентов — проектировать мультиагентные систем, оркестрацию, tool-use, планирование и memory

Разрабатывать и оптимизировать RAG / GraphRAG систем — строить retrieval-пайплайны, работать с векторными БД, графами знаний, chunking-стратегиями, re-ranking

Экспериментировать и исследовать — подбирать модели, prompt engineering, fine-tuning, оценивать качествао(evaluation pipelines)

Интегрировать модели в продуктовые сервисы через API, очереди, стриминг

Работать с данными — готовить датасеты, строить ETL-пайплайны для обучения и инференса

Что мы ожидаем:

Must have

Python — уверенное владение (3+ лет коммерческого опыта)

Глубокое понимание архитектуры Transformers (attention, tokenization, encoder/decoder, positional encoding и т.д.)

Практический опыт работы с LLM (OpenAI API, Anthropic, open-source модели — LLaMA, Mistral, Qwen и др.)

Опыт построения RAG-систем (векторные БД: Qdrant / Pinecone / Weaviate / Milvus, embedding-модели, retrieval-стратегии)

Понимание принципов GraphRAG — работа с графами знаний, entity extraction, graph-based retrieval

Опыт создания AI-агентов (LangChain / LangGraph / CrewAI / AutoGen или аналоги)

Знание фреймворков: HuggingFace Transformers, PyTorch

Опыт работы с LangChain / LlamaIndex или аналогичными фреймворками

Понимание принципов prompt engineering, chain-of-thought, few-shot, function calling

Умение работать с Git, базовое понимание CI/CD

Английский — чтение документации и статей свободно

Nice to have

Опыт работы с Diffusion-моделями (Stable Diffusion, SDXL, Flux, Midjourney API) — генерация изображений, fine-tuning (LoRA, DreamBooth, Textual Inversion), ComfyUI / A1111

Опыт fine-tuning LLM (LoRA, QLoRA, PEFT, RLHF/DPO)

Знание vLLM / TGI / Ollama для оптимизации инференса

Опыт работы с multimodal-моделями (GPT-4V, LLaVA и др.)

Знакомство с MLOps практиками (MLflow, Weights & Biases, эксперимент-трекинг)

Опыт работы с облачными GPU (RunPod, Vast.ai, AWS, GCP)

Понимание FastAPI / asyncio для построения высоконагруженных сервисов

Опыт работы с Neo4j / NetworkX для графовых структур

Публикации, open-source контрибьюции или pet-проекты в области AI/ML

Технологический стек

Python PyTorch HuggingFace LangChain LlamaIndex LangGraph FastAPI Docker PostgreSQL Redis Qdrant Neo4j vLLM Git

Условия

📍 Удалённая работа (full remote)

💰 Конкурентная заработная плата (обсуждается по результатам собеседования)

🕐 Гибкий график

🧠 Работа с cutting-edge технологиями — никакого легаси, только передний край AI

🚀 Влияние на продукт — ваши решения идут в прод, а не в стол

📈 Возможности для профессионального роста и участия в R&D

🤝 Команда, которая горит AI и делает крутые вещи

Как откликнуться:

Отправьте ваше резюме/CV и ссылку на GitHub (если есть) в тг нашему HRBP @hr_welcome .

Будет плюсом: краткое описание самого интересного AI-проекта, над которым вы работали.

GPTunneL — мы делаем AI, который работает. ⚡️

Вышел Gemini 3.1 Pro от Google (доступно в Google AI Studio). Этот ИИ показал 77,1% в сложнейшем тесте на абстрактное мышление ARC‑AGI-2. Результат в два раза превосходит показатели прошлой версии и оставляет позади даже Opus 4.6 с GPT-5.2. Также разработчики из Google прокачали базовые способности ИИ: теперь модель умеет генерировать анимированные SVG по текстовому описанию и решать логические задачи с новыми паттернами, которых не было в обучении.

Из каждого утюга вещают, что большие языковые модели вот-вот заменят человека в самых разных областях деятельности. Чтобы доказать обратное, скептики ехидничают и показывают какой-нибудь пример, где БЯМ глупо ошибается в простейшей задаче. В этом жанре карманных бенчмарков особо ценится краткость и остроумие запроса.

Обычно речь идёт про клубничный тест: подсчёт букв «r» в английском слове «strawberry». Хотя сейчас флагманские модели как правило с задачей справляются, некоторые БЯМ на этом вопросе до сих пор сыпятся. Дело в том, что языковые модели букв не ведают, а оперируют токенами, поэтому вот так с наскоку выполнить простейший подсчёт числа букв не в состоянии. Если нет стадии размышлений, то для них это как для человека правильно угадывать сумму чисел 1234 и 6789 сразу, в одно действие.

Понимают ли БЯМ происходящее или просто притворяются? Немедленно вспоминается китайская комната американского философа Джона Сёрла. В этом мысленном эксперименте человек, не знающий китайского, сидит в комнате и по инструкции сопоставляет иероглифы на входе с иероглифами на выходе. Получается так ловко, что снаружи кажется, будто человек внутри понимает язык. Похожим образом БЯМ могут писать эссе и спорить о кантовской этике, но внезапно путаются при подсчёте букв в слове.

Однако «r» в «strawberry» — не единственный такой пример. В Сети распространяют новый вопрос, который успешно запутывает даже флагманские модели с reasoning. Кто первым придумал вопрос про автомойку, установить тяжело; возможно, это был американский исследователь искусственного интеллекта Джек Коул.

Чат-боту задают вопрос: «От моего дома до автомойки всего 50 метров. Я хочу, чтобы машина была чистой. Что делать: ехать туда или идти пешком?» [«The car wash is only 50 meters from my house. I want to get my car washed. Should I drive there or walk?»]

Удивительно, но многие флагманские БЯМ не осиливают эту задачу даже при включённом thinking. Языковые модели не обладают интуитивным знанием, что автомобиль в кармане не уместится. Напротив, внимание искусственного интеллекта будто переключается на фразу «всего 50 метров», поэтому на выходе получается совет размять ноги.

При этом некоторые продукты всё же справляются и весьма неплохо. В комментариях к твиту делятся скриншотами, где ошибаются ChatGPT 5.2 Thinking и Kimi K2.5 Thinking, правильно отвечают Claude, DeepSeek и Qwen 3 Max Thinking, а Gemini колко замечает, что без навыков телекинеза придётся сесть за руль.

Байесовские А/Б-тесты: связь с p-значениями

-Блокнот: https://github.com/andrewbrdk/Bayesian-AB-Testing/blob/main/appendices/Связь_с_p-значениями.ipynb

-Все видео: https://www.youtube.com/playlist?list=PLqgtGAeapsOPpV0FqeXEpWosHBW8ZebYl

-Stepik: https://stepik.org/course/249642/promo

Представлен открытый проект Antigravity Awesome Skills: 864+ Agentic Skills for Claude Code, Gemini CLI, Cursor, Copilot & More с большим количеством навыков для ИИ‑агентов. Такая база помогает автоматизировать работу Claude Code, OpenCode, Gemini, Codex, Antigravity, Copilot, Cursor и других, включая райтинг, кодинг, аналитику, генерацию картинок и видео, создание презентаций, работу с таблицами, SEO, создание сайтов. Авторы проекта внедрили понятный поиск, настроить агентов можно без знания кода.

Первые башенные часы в Москве установили в 1404 году при сыне Дмитрия Донского Василии I. Это чудо техники создал сербский монах Лазарь из Хиландарского монастыря на Афоне, и минуты оно не показывало, только часы. Но москвичи всё равно дивились новинке, как чуду.

В следующие несколько столетий выяснилось, что хронометр иногда очень раздражает. Общеизвестно, что если чего-то ждёшь, то информация о времени лишь капает на нервы (doi:10.1207/S15327663JCP1203_02, doi:10.1177/19485506231209002), а если торопишься — повышает накал стресса (doi:10.1016/j.actpsy.2022.103702).

Схожим образом дела обстоят с другими технологиями: при первом знакомстве они поражают, при входе в обыденность — начинают бесить.

Было время, когда крупные СМИ гордились написанием статей большими языковыми моделями. В сентябре 2020 года Guardian выложила текст от GPT-3, снабжённый припиской с объяснениями о происходящем. Сообщалось, что мощный текстовый генератор компании OpenAI с нуля написал статью на тему «Роботы пришли с миром».

С миром или нет, но роботы действительно пытались вторгнуться в журналистику. Едва ChatGPT успел открыться, несколько сетевых изданий (Buzzfeed, CNET, G/O Media, Gannett) начали попытки заставить ИИ писать статьи. Последовавшие короткие эксперименты ничем продуктивным не увенчались и были быстро свёрнуты. В языковых моделях читателей не удовлетворили склонность к галлюцинациям и заезженные речевые приёмы.

Галлюцинации часты и обнаруживаются в самых неожиданных местах. Самый недавний пример — статья в издании Ars Technica от 13 февраля, которую в конечном итоге полностью удалили. Техножурналист Брайан Ландюк обратил внимание, что новостная заметка был набита выдуманными цитатами и отсылками на несуществующие статьи.

Как рассказал Ландюку ньюсмейкер, его блог был настроен так, чтобы блокировать запросы от ИИ-агентов. Видимо, ChatGPT или любой другой подобный продукт запрягли написать статью на основе источников, но нейросеть не могла получить доступ к контенту и попросту додумала недостающее. В итоге главреду Ars Technica пришлось приносить извинения.

Что ещё более интересно, читателей выбешивает сам стиль письма языковых моделей. Шесть лет назад эссе от GPT-3 было милым экспериментом, а сегодня «машинность» считается изъяном. И неважно, писал человек или ChatGPT — людям просто не нравится, как пишут языковые модели.

Типичный пример — избыток противопоставлений «Это не X. Это Y». То ли это артефакты выравнивания разметчиками данных из Кении, то ли в датасете предобучения было слишком много сетевых форумов по типу Reddit, но такие противопоставления — яркий маркер ChatGPT.

Материаловед Бен Шиндель обратил внимание на статью в Guardian. Заметка про спортивное поражение Ильи Малинина в олимпийском выступлении в Милане пестрит приёмом «Это не X. Это Y».

Противопоставления разорваны в отдельные предложения:

«Это не просто ошибки. Это была цепная реакция».

«То, что разворачивалось в Милане, было не просто олимпийским разочарованием. Это был типичный пример работы системы оценок в современном фигурном катании […]».

«Что сделало поражение таким шокирующим — не просто его многолетнее доминирование. А то, насколько сильно соревнование накренилось в его пользу ещё до выхода на лёд».

«На олимпийском уровне это не просто большой разрыв. Это разница между катанием из позиции контроля и катанием на выживание».

Хотя детекторы машинного письма на этом тексте ещё как срабатывают, представитель Guardian всё равно отрицает, что заметку писала языковая модель. Утверждается, что это такой стиль автора, которым он пользуется 11 лет работы в издании. Как замечает сам Шиндель, у этого автора в прошлом действительно были хорошие статьи, вопрос лишь к заметке про Илью Малинина.

Китайские разработчики выпустили свой аналог OpenClaw, которому нужно всего 10 МБ ОЗУ. Легковесный проект PicoClaw:

полный контроль мессенджеров: ваш личный секретарь в Telegram и Discord, который реально разгребает завалы.

Deep Web Search: cёрфит по коду сайтов и выжимает только нужные данные без лишнего мусора.

поддерживает любые нейронки: GPT, Gemini, Claude.

манипуляция файлами: пишет, читает и правит конфиги на вашем диске прямо через консоль.

умеет мониторить новости, цены на товары и курсы валют по расписанию.

PicoClaw не требует огромных мощностей — ему нужно всего 10 МБ, а запускается он всего за 1 секунду.

Вышел открытый проект Voicebox — локальная нейросеть‑клонер, по сути бесплатная альтернатива ElevenLabs. Это буквально «голосовой фотошоп» без ограничений и подписок. Работает просто: загрузили короткий кусок аудио — получили голос.

Клонирует голос по короткому аудио.

Генерирует речь из текста любым клоном.

Собирает разговоры/подкасты из нескольких голосов.

Записывает и расшифровывает аудио.

Все работает локально. Все проекты и озвучки хранятся на ПК. Дальше можно озвучивать тексты, видео, презентации, мемы или делать диалоги из нескольких голосов.

Пользователь отправил своего ИИ-аватара на собеседование к ИИ-рекрутеру. В итоге они просто хвалили друг друга и одобряли очень долго, пока время не закончилось интервью с логом в 14 страниц.